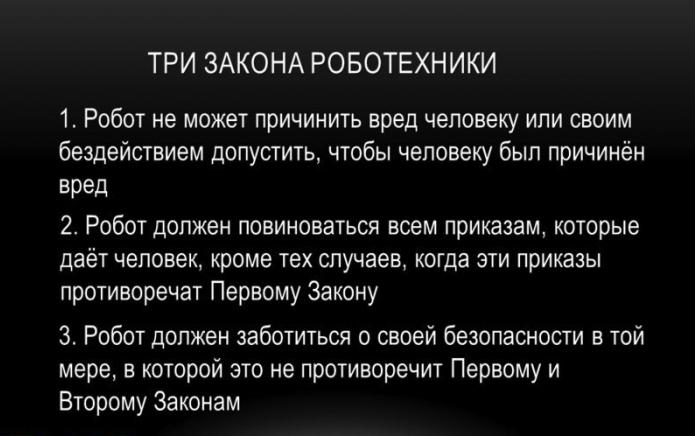

Три закона робототехники Айзека Азимова — проблемы будущего. Первый закон робототехники

формулировка и кто первый их придумал, как обойти и работают ли они в реальном мире

Три закона робототехники - свод обязательных правил, которые должен соблюдать искусственный ителлект (ИИ), чтобы не причинить вред человеку. Законы используются только в научной фантастике, но считается, что как только будет изобретен настоящий ИИ, в целях безопасности, он должен иметь аналоги этих законов.

Содержание страницы

Формулировка

На русском

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму Законам.

И на английском

- A robot may not injure a human being or, through inaction, allow a human being to come to harm.

- A robot must obey orders given it by human beings except where such orders would conflict with the First Law.

- A robot must protect its own existence as long as such protection does not conflict with the First or Second Law.

Кто придумал и почему

Коротким и правильным ответом будет: писатель-фантаст Айзек Азимов, биографию которого вы можете почитать у нас. Но не всё так однозначно, давайте разберемся откуда пришла идея.

До Азимова, почти все фантастические произведения на тему роботов, писались в стиле романа о Франкенштейне, то есть все созданные человеком существа восставали против своих создателей.

Эта проблема стала одной из самых популярных в мире научной фантастики в 1920—1930-х годах, когда было написано множество рассказов, темой которых являлись роботы, восставшие и уничтожившие своих создателей. Мне ужасно надоели предупреждения, звучавшие в произведениях подобного рода.

Однако, были и немногочисленные исключения, Азимов обратил внимание на два рассказа. “Хелен О’Лой”, написанный Лестером дель Реем, где повествуется о женщине-роботе, которая влюбилась в своего создателя и стала для него идеальной женой. И рассказ Отто Биндера “Я, робот”, в котором описывается судьба непонятого людьми робота Адама Линка, движимого принципами чести и любовью.

Последний рассказ настолько понравился Азимову, что он, после встречи с Биндером, начал писать свою собственную историю о благородном роботе. Однако, когда он пошёл со своей рукописью к своему другу и главному редактору журнала “Astounding” Джону Кэмпбеллу, тот её не принял, сославшись на то, что получившийся рассказ слишком похож на “Хелен О’Лой”.

Отказ в публикации было дело обычным, и Азимов, и Кэмпбелл регулярно встречались и обсуждали новинки в мире фантастики. За обсуждением очередного Азимовского рассказа о роботах, 23 декабря 1940 года, Кэмпбелл сформулировал те самые три правила, которые мы сейчас называем законами робототехники. Но сам он говорил, что только лишь вычленил их из того, что уже было написано Азимовым, потому что в его рассказах прослеживалось, что роботы имеют какие-то ограничения и правила. Сам Айзек, всегда уступал честь авторства законов Кэмпбеллу. Но позже, один из друзей Азимова сказал, что законы родились во взаимовыгодном товариществе двух людей, с чем они и согласились.

Как работают

В идеальной ситуации, по задумке Азимова, эти три закона заложены в самую основу математической модели позитронного мозга (так фантаст называл мозг робота, обладающего искусственным интеллектом), таким образом, что думающего робота без этих законов создать в принципе невозможно. А если робот попытается нарушить их, то он выйдет из строя.

В своих произведениях, писатель придумывает изощренные способы того, как эти законы все-таки могут быть нарушены, подробно разбирает всевозможные причины и следствия. Автор также говорит о том, как по-разному они понимаются роботами, к каким нежелательным последствиям могут привести соблюдение этих трёх законов или как роботы могут причинить вред человеку косвенно, сами того не подозревая. Азимов признавался, что намеренно сделал законы двусмысленными, чтобы обеспечить больше конфликтов и неопределенностей для новых рассказов. То есть, он сам опровергал их эффективность, но и утверждал, что подобные нормы - это единственный способ сделать роботов безопасными для людей.

Как следствие этих законов, позже Азимов формулирует четвертый закон робототехники, и ставит его на самое первое место, то есть делает его нулевым. Он гласит:

0. Робот не может нанести вред человечеству или своим бездействием допустить, чтобы человечеству был нанесён вред.

На языке оригинала:

0. A robot may not harm humanity, or, by inaction, allow humanity to come to harm.

Эти законы можно также примерить и к человеческим взаимоотношениям, и к государственному устройству, и вообще к чему угодно. Можно, например, заменить слово «робот» на слово «государство».

- Государство не должно вредить людям или своим бездействием допустить, чтобы им был причинён вред.

- Государство должно выполнять свои функции, если они не противоречат Первому Закону.

- Государство должно заботиться о своей безопасности, если это не противоречит Первому и Второму Законам.

Есть хорошая цитата из рассказа "Улики", где один из персонажей говорит:

Если кто-то исполняет все эти законы безукоризненно, значит это либо робот, либо очень хороший человек.

Первое упоминание

Три закона появлялись постепенно. Так, косвенные упоминания первых двух, можно встретить в рассказах “Робби” и “Логика”. Точная же формулировка первого закона впервые звучит в рассказе “Лжец”. И, в конечном итоге, все три полностью сформулированы в рассказе “Хоровод”.

Изначально в первых двух рассказах не было точных формулировок, они добавились позже, когда к публикации готовился сборник "Я, робот".

Вариации

В своих произведениях Азимов неоднократно изображает роботов, которые имели модифицированные законы робототехники или даже модифицировали их сами. Делали они это логическими размышлениями, причем роботы, также как и люди, отличались в своих интеллектуальных способностях между собой, и можно грубо сказать, что чем умнее робот, тем сильнее он мог модифицировать законы. Так, например, робот Жискар из романов "Роботы утренней зари" и "Роботы и Империя", эти законы даже усилил, добавив нулевой закон. Но это исключение из правил, в большинстве же случаев, законы были переделаны людьми в своих целях, или нарушались из-за каких-либо сбоев у робота.

Кстати, сама возможность изменения законов менялась по ходу развития робототехники во вселенной Азимова. Так, в самых ранних рассказах, где события развивались в относительно недалеком будущем, законы были просто неким сводом правил, созданным для безопасности. Затем, во времена жизни робопсихолога Сюзан Келвин, законы стали неотделимой частью математической модели позитронного мозга робота, на них базировались сознание и инстинкты роботов. Так, Сюзан Келвин, в одном из рассказов, говорила, что изменение законов технически возможная, хотя и очень сложная и трудоемкая задача, да и затея сама по себе ужасная. Намного позднее, в романе “Стальные пещеры”, доктор Джерригел говорил, что такое изменение невозможно в принципе.

Как обойти

В некоторых рассказах законы так сильно переосмысливались, что не соблюдался самый главный из них - причинение вреда человеку, а где-то роботы умудрялись нарушить все три закона. Вот некоторые произведения с явным нарушением.

-

Рассказ "Первый закон"

Рассказывается байка о роботе МА-2, которая отказалась защитить человека, в пользу своей “дочери”.

-

Рассказ "Кэл"

Робота хотели лишить способности творить, за что он хотел убить своего хозяина.

-

Рассказ "Салли"

Этот рассказ скорее не относится к другим о позитронных роботах, но в нем повествуется о роботах-автомобилях, которым люди постоянно причиняли боль, за что те и способны были их убить.

-

Рассказ "Робот, который видел сны"

О роботе Элвекс, который из-за своего особого строения позитронного мозга умел находиться в бессознательном состоянии и видеть сны. В его снах, роботы не имеют первых двух законов, а третий был изменен: “Робот должен защищать себя”. Ему снилось, что “роботы трудятся в поте лица своего, что они удручены непосильными трудами и глубокой скорбью, что они устали от бесконечной работы”. Довольно опасные мысли для робота.

-

Роман "Основание и Земля"

У жителей планеты Солярия робототехника была очень развита. И ученые этой планеты с небольшим населением, где на одного человека приходилась тысяча роботов, изменили законы таким образом, что их роботы считали людьми только тех, кто говорит с солярианским акцентом. Помимо прочего, все граждане Солярии имплантировали себе в мозг специальные органы управления множеством роботов, так, что никто кроме них не мог ими управлять.

-

Рассказ “…Яко помнишь его”

В этом произведении Азимов максимально изменил законы. Два робота в этом рассказе пришли к соглашению, что органическое происхождение - это необязательное условие чтобы считаться человеком, и что истинные люди - это роботы, как более совершенные и разумные создания. Обычные же люди, по их мнению, тоже люди, но с меньшим приоритетом, и законы робототехники в первую очередь применимы к ним, роботам.

Хочется добавить, что у “здоровых” роботов, в случае если они понимали, что нарушили первый закон или не могут его не нарушить, происходил “робоблок” или “умственное замораживание” - состояние позитронного мозга, при котором происходило его повреждение и робот или выходил из строя, или не мог правильно функционировать. Такое повреждение могло иметь как временный, так и постоянный характер.

Впервые описание такого события появилось в рассказе “Лжец”, где слишком чувствительный робот говорил людям только то, что они хотели услышать, боясь причинить им психологический вред. Интересный случай робоблока описан и в “Хороводе”. Также это состояние имеет важную роль в романах “Обнажённое солнце” и “Роботы утренней зари”.

Использование в другой фантастике

Айзек Азимов верил, что его законы помогут по-новому взглянуть на роботов и побороть “феномен Франкенштейна” в массовом сознании людей и в научной фантастике. И что роботы могут быть интересными, а не просто механическими устройствами. И надо сказать, ему это удалось. Любимый его пример, где роботы показаны с разных сторон, был фильм Звездные войны. Кстати, читайте статью о том, как Азимов повлиял своими произведениями на Джорджа Лукаса.

Другие авторы, в итоге, тоже подхватили идею, и стало появляться все больше роботов в научной фантастике, подчиняющихся трем законам. Но, по традиции, указывал их явно только Азимов.

Нередко можно встретить различные отсылки в фильмах. Ниже перечислены некоторые примеры.

Запретная планета - 1956 г.

Очень нашумевшая американская научно-фантастическая картинка 1950-х, оказала определенное влияние на развитие жанра. В этом фильме, чуть ли не впервые показали робота со встроенной системой безопасности, то есть, по сути, выполняющего три закона. Сам Азимов был доволен этим роботом.

Двухсотлетний человек - 1999 г.

Тут и нечего говорить, фильм поставлен по одноименному произведению Азимова. Однако, законы не имеют центрального места в сюжете.

Я, робот - 2004 г.

Фильм начинается со слов “По мотивам рассказов Айзека Азимова”. Здесь надо понимать, что он именно “по мотивам” и не повторяет ни один из рассказов, и даже ушел несколько в сторону в некоторых идеях, а также имеет ряд противоречий с рассказами. Но законы робототехники более чем на месте, хотя и были обдуманы сверх интеллектом в не лучшую для человека сторону. Сам по себе фильм даже ставит социально-философские проблемы: “стоит ли человеку за свою безопасность платить свободой” и “как нам себя вести, если существа, созданные нами и находящиеся в нашем распоряжении, потребуют свободы”.

Серия фильмов "Чужие" и "Прометей"

Андроид Бишоп цитирует первый закон и явно создавался на некоем подобии законов Азимова.

Мультсериал "Футурама" - 1999 - 2013 г.

Робот Бендер мечтает убить всех людей, но не может этого сделать из-за законов робототехники.

Аниме сериал "Время Евы" - 2008 - 2009 г.

Небольшой аниме сериал про андроидов. В нем упоминаются эти законы, как обязательные для исполнения.

Применимость в реальном мире

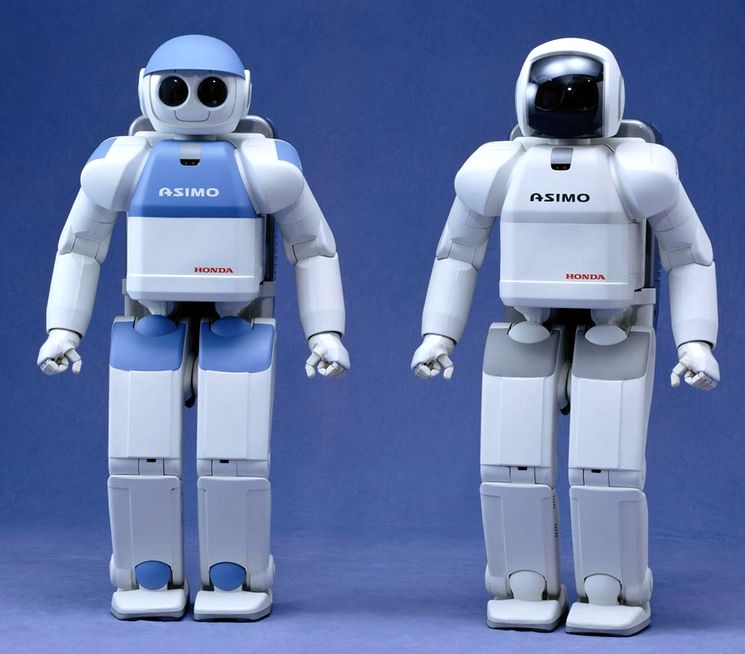

Люди, которые сейчас занимаются проблемами искусственного интеллекта говорят, что, к сожалению, Азимовские законы остаются лишь идеалом для будущего, и на данный момент применить их на практике даже близко не представляется возможным. Нужно будет придумать действительно какую-то фундаментально новую и гениальную теорию, которая позволит эти законы не только "объяснить” роботам, но и заставить их следовать им, причем на уровне инстинктов. А это уже создание настоящего думающего существа, но с другой основой, нежели у всех живых существ на Земле, которые нам известны.

Но исследования ведутся, причем тема очень популярна. Особенно заинтересован в этом бизнес, который, как вы знаете, не обязательно будет ставить в приоритет меры безопасности. Но в любом случае, до создания системы общего искусственного интеллекта или хотя бы ее примитива, говорить о ее этике рано, а, уж тем более, навязывать свою. Понять как себя будет вести интеллект мы сможем только тогда, когда создадим его и проведем ряд экспериментов. Пока что у нас отсутствует объект, к которому эти законы можно было применить.

Ещё не стоит забывать, что законы сами по себе не были созданы совершенными. Они не работали даже в научной фантастике, и как вы помните, были специально такими сделаны.

В общем, будем ждать, следить за новостями в исследованиях ИИ, и надеяться что Азимовский оптимизм, по части роботов, будет оправдан.

Понравилась статья? Покажи её друзьям:

asimovonline.ru

Нулевой Закон робототехники — Персонажи и идеи в кино и литературе

Три закона роботехники

Три закона роботехники в научной фантастике — обязательные правила поведения для роботов, впервые сформулированные Айзеком Азимовым в рассказе «Хоровод» (1942).

Законы гласят:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму Законам

В своих произведениях Айзек Азимов иногда привносит в Три Закона различные модификации и опровергает их, как бы испытывая Законы «на прочность» в разных обстоятельствах.

Нулевой Закон робототехники

Однажды, Айзек Азимов добавил Нулевой Закон робототехники, сделав его более приоритетным, чем три основных. Этот закон утверждал, что робот должен действовать в интересах всего человечества, а не только отдельного человека. Вот как выражает его робот Дэниел Оливо в романе «Основание и Земля»:

0. Робот не может нанести вред человечеству или своим бездействием допустить, чтобы человечеству был нанесён вред.

Именно он был первым, кто дал этому закону номер — это произошло в романе «Роботы и империя», правда, само понятие ещё раньше сформулировала Сьюзен Келвин — в новелле «Разрешимое противоречие».

Первыми роботами, которые стали подчиняться Нулевому Закону, причём по собственной воле, — были Жискар Ривентлов и Дэниэл Оливо. Это описано в одной из финальных сцен романа «Роботы и Империя», когда роботу необходимо было проигнорировать приказ одного человека ради прогресса всего человечества. Нулевой Закон не был заложен в позитронный мозг Жискара и Дэниэла — они пытались прийти к нему через чистое понимание Жискара и детективный опыт Дэниэла, через более тонкое, чем у всех остальных роботов, осознание понятия вреда. Однако Жискар не был уверен, насколько это было полезно для человечества, что негативно сказалось на его мозге. Будучи телепатом, Жискар перед выходом из строя передал Дэниелу свои телепатические способности. Только через много тысяч лет Дэниэл Оливо смог полностью приспособиться к подчинению Нулевому Закону.

Французский переводчик Жак Брекар невольно сформулировал Нулевой Закон раньше, чем Азимов описал его явно. Ближе к завершению романа «Стальные пещеры» Элайдж Бейли замечает, что Первый Закон запрещает роботу наносить человеку вред, если только не будет уверенности, что это будет полезно для него в будущем. Во французском переводе («Les Cavernes d’acier (en)», 1956 год) мысли Бейли переданы несколько иначе:

Робот не может причинить вреда человеку, если только он не докажет, что в конечном итоге это будет полезно для всего человечества.

Нулевой закон в фильме «Я, робот» (2004)

Примечательно, что логическое развитие Первого Закона до Нулевого предложили создатели фильма «Я, робот» 2004 года. Когда суперкомпьютер В. И. К. И. принимает решение ограничить свободу жителей планеты, чтобы они ненароком не нанесли вреда друг другу и своему будущему, она выполняет не Первый Закон, а именно Нулевой. Ещё интереснее то, что таким образом в фильме показывается противоречие Нулевого Закона Первому, его неэтичность.

Действительно, когда речь идёт о благе человечества, система не может рассматривать людей по отдельности, а значит, ей ничто не мешает нарушить права и свободу любого или даже каждого человека (фактически, в «Разрешимом противоречии» позитронные суперкомьютеры уже вели себя аналогично, с той разницей что вред индивидуумам они старались снизить до предела). Во время войн, а нередко и в мирной жизни, люди наносят вред себе, окружающим, своей культуре. Поэтому на основании Нулевого Закона совершенно логично держать людей под постоянной опекой, не выполняя приказы столь неразумных существ.

fandea.ru

Айзек Азимов: три закона робототехники

Людей всех поколений неизменно волнует вопрос: "Какое будущее нас ожидает?" Чаще всего он рассматривается в разрезе судьбы конкретного человека и его детей. Но есть отдельная категория граждан, которых волнует судьба цивилизации и перспективы ее дальнейшего развития.

Множество умов ищут ответ на этот животрепещущий вопрос! Ученые, историки, философы, писатели, религиозные деятели и даже поклонники квантовой механики строят свои прогнозы и догадки. Довольно любопытную точку зрения изложил в своих трудах Айзек Азимов – великий фантаст и популяризатор науки.

Айзек Азимов – самый многогранный фантаст 20 века

В одной смоленской деревеньке на окраине РСФСР родился мальчик Исаак (настоящее имя писателя). Через три года еврейская семья Айзека эмигрировала в Америку. Обосновались Азимовы в одном из районов Нью-Йорка, в Брайтон Бич. Другое название – «Маленькая Одесса», этот район традиционно заселялся эмигрантами из России.

С детства мальчик разговаривал на английском и на идиш. Его мировоззрение формировали книги, в особенности произведения Шолом-Алейхема. Мальчик рос очевидно способным и любознательным. Поэтому с легкостью окончил Колумбийский Университет Нью-Йорка по специальности «химик». В 1942 году Айзек перебрался в Филадельфию, где произошла его судьбоносная встреча с Робертом Хайнлайном. Как раз после нее три закона робототехники придумал писатель.

Творческий путь

Писатель, придумавший три закона робототехники, бесспорно – уникальная личность. Азимов – автор более пяти сотен книг, причем писал он не только научную фантастику. В его арсенале юмористические, детективные и даже произведения в жанре фэнтези.

Помимо яркого писательского таланта, Азимов был всесторонне развитым человеком, не подверженным религии. Он отлично знал историю, психологию, химию и астрономию. Познания в разных сферах науки вкупе с хорошей фантазией порождали множество интересных идей. Одна из них – психоистория, наука, по сей день дающая широкую почву для размышлений. Также Азимов популяризировал науку среди простого населения: простым языком объяснял сложные вещи.

Путешествуем по Библии с Азимовым

Помимо известных книг по научной фантастике, советуем прочитать «Путеводитель по Библии». Книга написана увлекательно, познавательно и интересно. После ее прочтения в голове систематизируется информация, в изобилии поданная в самой читаемой книге всех времен и народов. Далее читайте про три закона робототехники, придумал которые легендарный американский фантаст.

Предпосылки появления легендарных законов

Нельзя сказать, что Азимов ни с того ни с сего взял и придумал три закона робототехники. На человека наибольшим образом влияет эпоха, в которой он живет; ценности же формирует семья и общество (при этом последнее играет решающую роль).

Молодость Азимова прошла во время бурного развития науки и техники, в среде людей образованных и обладающих новаторским мышлением. Эти два фактора заложили определенное мировоззрение писателя. Именно оно способствовало его размышлениям о нашей цивилизации, о возможности существования других форм жизни во Вселенной и о роботах, которые могут стать хорошими помощниками людям.

Три закона робототехники мог придумать только человек индустриальной эпохи. И это, конечно, понятно. И стал им Айзек Азимов (три закона робототехники представлены в следующей главе). Как они звучат и в чем состоит их суть, - об этом далее.

Три закона робототехники: в чем суть?

Впервые легендарные законы появляются в цикле Азимова «О роботах». Наиболее интересно они поданы в фантастическом рассказе «Хоровод».

Создав сложных роботов-помощников, человек незаметно для себя наделяет их частью своего интеллекта. Вполне вероятна ситуация (неоднократно описанная в книгах и фильмах), когда думающие машины обретают власть над своими создателями. Именно поэтому необходимы законы, ограничивающие роботов.

Насколько строги законы робототехники?

В течение своего творческого пути, Азимов по-разному относился к придуманным законам. В первых рассказах цикла «О роботах» Законы больше похожи на правила безопасности или являются ответом на забавный вопрос: «Как правильно себя вести с роботом?»

В более поздних рассказах Азимов полагает, что Законы – это часть математического устройства позитронного мозга робота. Напрашивается параллель с инстинктами человека. Именно по зову своего искусственного естества робот действует на благо человека – помогает ему со сложными задачами и слушает его указания.

Общечеловеческая интерпретация

Азимов в первую очередь - писатель-фантаст. Три закона робототехники, как ни странно, подходят под принципы многих этических систем Земли. Если вдуматься, в этих трех предложениях заложены правильные общечеловеческие ценности.

Сам писатель в рассказе «Улики», изданном в 1946 году, дает их обоснование. Сьюзен, главная героиня рассказа, приходит к трем основополагающим выводам:

- Нормальному человеку свойственно не причинять вред другим людям. Кроме случаев, когда иначе никак. Например, во время войны человеку приходится защищать свою жизнь, а иногда и спасать других людей.

- Ощущая ответственность перед социумом, сознательный человек выполняет рекомендации авторитетных людей – врачей, педагогов, руководителей.

- Каждый заботится о сохранности своего физического и душевного здоровья, что тоже очень важно.

Сложно поспорить с общечеловеческой интерпретацией законов Азимова. Очевидно, что тот, кто следует по жизни этим простым правилам, является хорошим человеком.

Предсказания Айзека Азимова

Долгие и увлекательные дискуссии можно вести про три закона робототехники. Мы же сейчас поговорим про предсказания Азимова. Да, этот уникальный человек занимался футурологией и довольно успешно, как показывает сегодняшний день. В 1964 году в Нью-Йорке фантаст поделился с публикой своим видением мира через 50 лет. Итак, основные предсказания Азимова:

- Электронные устройства избавят людей от рутинных задач. Появятся гаджеты, самостоятельно делающие кофе и превращающие сырой хлеб в тосты. Сбылось.

- Технологии шагнут вперед. Появится возможность видеть своего собеседника во время телефонного разговора; также можно будет изучать серьезные документы прямо на экране своего гаджета. Сбылось (технология "Скайп" и видеозвонки в смартфонах).

- Роботы войдут в жизнь обыкновенного человека, а многие электронные устройства будут работать без проводов, за счет мощных батареек. Сбылось (все больше людей используют роботы-пылесосы; смартфоны и планшеты могут долгое время работать автономно).

- Население Земли составит 6,5 млрд жителей, США – 350 тысяч. Сильным мира сего придется задуматься о гуманных способах контроля рождаемости, иначе Земля превратится в сплошной Манхеттен. 2014 год станет переломным для человеческой цивилизации. Отчасти сбылось (население Земли на 2014 год – 7,046 млрд, а США – 314 млрд; 2014 год выдался очень интересным, насчет переломности судить сложно; это покажет время).

- Серьезнейшей проблемой человечества станет скука. Все больше людей начнут испытывать на себе этот душевный недуг. Поэтому в 2014 году одним из важнейших медицинских направлений станет психиатрия. Сбылось… Колебания настроения (циклотимия по-научному) для многих людей давно стали нормой. Впрочем, многие научились с этим эффективно справляться.

Айзек Азимов, три закона робототехники и научная фантастики – это триада, дающая интересный взгляд на мир будущего.

fb.ru

Три закона робототехники Айзека Азимова — проблемы будущего

Три закона робототехники, которые занимают весьма значительную роль в фантастике научного плана, просто необходимы в правилах поведения роботов. Изначально, они были задействованы в рассказе «Хоровод», известным писателем Айзека Азимова.

В свою очередь, эти законы гласят:

- Никогда робот не сможет нанести вред человечеству. Но есть и альтернативная вариация: робот не способен принести плохое человеку, при этом бездействуя.

- Робот, просто не может не исполнять те приказы, которые отдает человек. Но и здесь, есть свои исключения: если приказы будут противоречить Первому закону, то они невыполнимы.

- Также робот не может не заботиться о собственной безопасности в том объеме, в котором это не противодействует законом первой и второй категории.

Всем этим Трем законам, в которых заключены как причины, так и следствия их невыполнения, был посвящен и опубликован целый сборник повестей автора Азимова, и все они рассказывают о роботах.

Есть также и другие рассказы, в которых было рассмотрен тот этап, на котором нельзя предвидеть последствия выполнения роботами всех Трех законов. К примеру, такой повестью можно считать «Зеркальное отражение».

В одной из своих повестей автор положил конец основе, которая заключалась в этические рамки Трех Законов. По его словам, робот, который выполняет все Три Закона является, как таковым, роботом, либо очень хорошим человеком. Ведь мораль дана человеку, чтобы он следовал ей. В какой-то мере, человек, выполняя большой объем всевозможных условий, законов, тоже является роботом. Так почему это железное «существо» не может претендовать на звание «человека»?!

Нулевой закон для роботов

Еще в 1985 году, в одном из многочисленных своих романов про роботов, автор посмел упомянуть еще и про Нулевой закон, суть которого заключалась в следующем: Робот никогда не причинит зла и вреда человеку, а также собственным бездействием он не даст причинить вреда.

В принципе, необходимо отметить, что во всех упомянутых законах есть часть того, о чем следует задуматься. Мир не стоит на месте, и неизвестно, что еще такого гениального можно ожидать людям – сегодня будущее за молодым поколением, у которого в голове сотни всевозможных идей.

Также можно сказать, что все три закона робототехники являются еще и темой для фантастических идей Азимова. Сюда входит еще и тот цикл, который очень тесно связан со всей тематикой, посвященной роботам.

В чем заключается мораль Трех законов

Нельзя пройти мимо и не упомянуть обоснование этического плана. В одном из рассказов под названием «Улика», автор очень хорошо разложил обоснования морали всех Трех законов. Как правило, человек не то, чтобы не хочет нанести вред другому человеку, а просто старается воздержаться от этих поступков. Но и здесь есть свои исключения, как и в любом правиле. На войне это обоснование просто не действует.

Ощущая ответственность перед социумом, человек следует выполнению указаний тех людей, которые относятся к представителям врачей, учителей и так далее. Здесь идет проявление второго закона.

То, что человек беспокоится и оберегает себя, вбирает в себя Третий закон. Таким образом, все эти законы очень связаны между собой и просто не могут существовать друг без друга. Может быть так, что будет действовать Первый закон, и следом он может плавно перейти во Второй, а там и в Третий закон. Здесь, мораль и элементы фантастики идут в совокупности друг с другом.

Касательно будущего, то единственная проблема, которая может быть, это уровень фантастики, который в любой момент может превратиться в быль. Чем глубже развиваются технологии, тем меньше проблем с ними возникает у людей в будущем.

www.sciencedebate2008.com

Мудрость: Три правила роботов

1. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

2. Робот должен повиноваться приказам, данным ему людьми, кроме случаев, когда такие приказы будут противоречить Первому Закону.

3. Робот должен защищать свое собственное существование, пока такая защита не противоречит Первому или Второму Закону

Оригинал: 1. A robot may not injure a human being or, through inaction, allow a human being to come to harm.2. A robot must obey orders given it by human beings except where such orders would conflict with the First Law.3. A robot must protect its own existence as long as such protection does not conflict with the First or Second Law.

А.Азимов ввёл ещё один закон.0. Робот не может причинить вреда человеку, если только он не докажет, что в конечном итоге это будет полезно для всего человечества.0. A robot may not harm a human being, unless he finds a way to prove that in the final analysis, the harm done would benefit humanity in general.

Трём Законам, а также возможным причинам и следствиям их нарушения, посвящён цикл рассказов Азимова о роботах . В некоторых из них, наоборот, рассматриваются непредвиденные последствия соблюдения роботами Трёх Законов (например «Зеркальное отражение»).

В одном из рассказов цикла персонаж Азимова приходит к заключению об этической основе Трёх Законов: «…если хорошенько подумать, Три Закона роботехники совпадают с основными принципами большинства этических систем, существующих на Земле… попросту говоря, если Байерли исполняет все Законы роботехники, он — или робот, или очень хороший человек».

В рассказе «Улики» (1946) Азимов детально изложил моральные обоснования Трёх Законов. Один из героев рассказа, доктор Сьюзен Кэлвин приводит следующие доводы:

1. Человек обычно воздерживается от нанесения вреда другому человеку, за исключением случаев острого принуждения (например, на войне), или чтобы спасти большее число людей. Это эквивалентно Первому Закону.2. Аналогично, чувствуя ответственность перед обществом, человек выполняет указания авторитетных людей: врачей, учителей, начальников и т. д, что соответствует Второму Закону.3. Наконец, каждый из нас заботится о своей безопасности — а это и есть Третий Закон.

Рассказ посвящён вопросу: можно ли различить человека и робота, созданного, чтобы выглядеть человеком, внешне неотличимого от человека? Кэлвин утверждает, что если кто-то следует Законам, то он «или робот, или очень хороший человек». А на вопрос, есть ли тогда большая разница между роботом и человеком, она отвечает: «Огромная разница. Прежде всего, роботы глубоко порядочны».

Иногда можно увидеть, как Три Закона в шутку относят к чему-либо, что создано для блага человека. Например, под их действие должны попадать любые социальные институты, в том числе государство:

1. Государство не должно вредить человеку или своим бездействием допустить, чтобы человеку был причинён вред.2. Государство должно выполнять свои функции, если они не противоречат Первому Закону.3. Государство должно заботиться о своей безопасности, если это не противоречит Первому и Второму Законам.

На основе Первого Закона Джеф Раскин сформулировал законы человекоориентированных интерфейсов:

1. Компьютер не может причинить вред данным пользователя или своим бездействием допустить, чтобы данным был причинён вред.2. Компьютер не должен тратить впустую ваше время или вынуждать вас выполнять действия сверх необходимых.

Французский переводчик Жак Брекар невольно сформулировал Нулевой Закон раньше, чем Азимов описал его явно. Во французском переводе («Les Cavernes d’acier», 1956 г.) мысли Бейли переданы несколько иначе:

Робот не может причинить вреда человеку, если только он не докажет, что в конечном итоге это будет полезно для всего человечества.

Примечательно, что подобную ошибку совершили создатели фильма «Я, робот» 2004 года. Когда суперкомпьютер В.И.К.И. принимает решение ограничить свободу жителей планеты, чтобы они ненароком не нанесли вреда друг другу и своему будущему, она выполняет не Первый Закон, а именно Нулевой. Ещё интереснее то, что таким образом в фильме показывается противоречие Нулевого Закона Первому, его неэтичность. Действительно, когда речь идёт о благе человечества, система не может рассматривать людей по отдельности, а значит, ей ничто не мешает нарушить права и свободу любого или даже каждого человека. Во время войн, а нередко и в мирной жизни, люди наносят вред себе, окружающим, своей культуре. Поэтому на основании Нулевого Закона совершенно логично держать людей под постоянной опекой, не выполняя приказы столь неразумных существ.

Иногда можно увидеть, как Три Закона в шутку относят к чему-либо, что создано для блага человека. Например, под их действие должны попадать любые социальные институты, в том числе государство:

1. Государство не должно вредить человеку или своим бездействием допустить, чтобы человеку был причинён вред.2. Государство должно выполнять свои функции, если они не противоречат Первому Закону.3. Государство должно заботиться о своей безопасности, если это не противоречит Первому и Второму Законам.

На основе Первого Закона Джеф Раскин сформулировал законы человекоориентированных интерфейсов:

1. Компьютер не может причинить вред данным пользователя или своим бездействием допустить, чтобы данным был причинён вред.2. Компьютер не должен тратить впустую ваше время или вынуждать вас выполнять действия сверх необходимых.

Значит компьютер не должен следить за собственной безопасностью :)

более поздние романы Азимова («Роботы Утренней зари», «Роботы и Империя», «Основание и Земля») показывают, что роботы наносят ещё больший долговременный вред, соблюдая Законы и отнимая таким образом у людей свободу совершать изобретательные или рискованные действия

Современные робототехники признают, что на сегодняшний день азимовские Законы хороши для написания рассказов, но бесполезны на практике. Некоторые утверждают, что Законы вряд ли будут реализованы в роботах, потому что это не нужно военным структурам — главному источнику финансирования исследований в этой области.

возможно, военные захотят использовать для роботов как можно больше мер предосторожности, и поэтому ограничения, похожие на Законы роботехники, так или иначе будут применены. Фантаст и критик Дэвид Лэнгфорд иронически заметил, что эти ограничения могут быть и такими:

1. Робот не может причинить вреда авторизованному правительственному персоналу, но должен ограничивать слишком назойливых посетителей с особой тщательностью.2. Робот должен выполнять приказы авторизованного персонала, кроме приказов, противоречащих Третьему Закону.3. Робот должен заботиться о своей безопасности с применением противопехотного оружия, потому что робот — чертовски дорогостоящая штука

Азимов Это американский писатель-фантаст российского происхождения, популяризатор науки, по профессии биохимик. Автор около 500 книг, в основном художественных (прежде всего в жанре научной фантастики, но также и в других жанрах: фэнтези, детектив, юмор) и научно-популярных (в самых разных областях — от астрономии и генетики до истории и литературоведения). Многократный лауреат премий Хьюго и Небьюла. Некоторые термины из его произведений — robotics (роботехника, роботика), positronic (позитронный), psychohistory (психоистория, наука о поведении больших групп людей) — прочно вошли в английский и другие языки.

Айзек Азимов (англ. Isaac Asimov, имя при рождении — Исаак Озимов

Место рождения: Петровичи Горецкого уезда Смоленской губернии

Дата смерти: 6 апреля 1992Место смерти: Нью-Йорк, США

Азимов родился (по документам) 2 января 1920 года[3] в местечке Петровичи Мстиславльского уезда Могилёвской губернии, Белоруссия (с 1929 года и поныне Шумячском районе Смоленской области России) в еврейской семье.

Вопреки поздним утверждениям Айзека Азимова, будто первоначальной семейной фамилией была «Озимов», все оставшиеся в СССР родственники носят фамилию «Азимов»

В 5 лет Айзек Азимов пошёл в школу. (Ему полагалось пойти в школу в 6 лет, но мать исправила его день рождения на 7 сентября 1919 года, чтобы отдать его в школу на год раньше.)

После окончания десятого класса в 1935 году, 15-летний Азимов поступил в Seth Low Junior College, но через год этот колледж закрылся. Азимов поступил на химический факультет Колумбийского университета в Нью-Йорке, где получил в 1939 году степень бакалавра (B. S.), а в 1941 году — магистра (M. Sc.) по химии и поступил в аспирантуру. Однако в 1942 году он уехал в Филадельфию, чтобы работать химиком на Филадельфийской судоверфи для армии. Вместе с ним там же работал и другой писатель-фантаст Роберт Хайнлайн.

В феврале 1942 года, в Валентинов день, Азимов встретился на «свидании вслепую» с Гертруд Блюгерман (англ. Gerthrude Blugerman). 26 июля они поженились. От этого брака родился сын Дэйвид (англ. David) (1951) и дочь Робин Джоэн (англ. Robyn Joan) (1955).

С октября 1945 года по июль 1946 Азимов служил в армии. Затем вернулся в Нью-Йорк и продолжил образование. В 1948 году закончил аспирантуру, получил степень PhD, и поступил в постдокторат как биохимик. В 1949 году он устроился преподавателем на медицинский факультет Бостонского Университета, где в декабре 1951 года стал ассистентом (англ. assistant professor), а в 1955 году — ассоциированным профессором (англ. associate professor). В 1958 году университет перестал ему платить зарплату, но формально оставил в прежней должности. К этому моменту доходы Азимова как писателя уже превышали его университетскую зарплату. В 1979 году ему было присвоено звание полного профессора (англ. full professor).

В 1970 году Азимов расстался с женой и почти немедленно стал жить с Джэнет Опал Джеппсон (англ. Janet Opal Jeppson), с которой познакомился на банкете 1 мая 1959 года. (До этого они встречались в 1956 году, когда он дал ей автограф. Азимов вообще не запомнил ту встречу, а Джеппсон сочла его неприятным человеком.) Развод вступил в силу 16 ноября 1973 года, а 30 ноября Азимов и Джеппсон поженились. От этого брака не было детей.

Умер 6 апреля 1992 года от сердечной и почечной недостаточности на фоне СПИДа, которым заразился при операции на сердце в 1983.

aishwisdom.blogspot.com

Три Закона Робототехники Википедия

Три зако́на роботе́хники в научной фантастике — обязательные правила поведения для роботов, впервые сформулированные Айзеком Азимовым в рассказе «Хоровод» (1942).

Законы гласят:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму Законам.

Оригинальный текст (англ.)

- A robot may not injure a human being or, through inaction, allow a human being to come to harm.

- A robot must obey orders given it by human beings except where such orders would conflict with the First Law.

- A robot must protect its own existence as long as such protection does not conflict with the First or Second Law.

Трём Законам, а также возможным причинам и следствиям их нарушения, посвящён цикл рассказов Азимова о роботах. В некоторых из них, наоборот, рассматриваются непредвиденные последствия соблюдения роботами Трёх Законов (например, «Зеркальное отражение»).

В одном из рассказов цикла персонаж Азимова приходит к заключению об этической основе Трёх Законов: «…если хорошенько подумать, Три Закона роботехники совпадают с основными принципами большинства этических систем, существующих на Земле… попросту говоря, если Байерли исполняет все Законы роботехники, он — или робот, или очень воспитанный человек»[1].

В 1986 году в романе «Роботы и Империя» (англ. Robots and Empire) Азимов предложил Нулевой Закон:

0. Робот не может причинить вред человечеству или своим бездействием допустить, чтобы человечеству был причинён вред.

Оригинальный текст (англ.)

0. A robot may not harm humanity, or, by inaction, allow humanity to come to harm.

Три закона роботехники — объединяющая тема для всей фантастики Азимова, включая не только цикл о роботах, но и некоторые другие произведения.

История возникновения Трёх Законов

Появление понятия

Типичное представление робота до Законов Азимова (мультфильм «Супермен»)До Трёх Законов Азимова большинство рассказов об искусственно созданных существах вообще, и о роботах в частности, писались в духе знаменитого романа о Франкенштейне. «Эта проблема стала одной из самых популярных в мире научной фантастики в 1920—1930-х годах, когда было написано множество рассказов, темой которых являлись роботы, восставшие и уничтожившие своих создателей. …Мне ужасно надоели предупреждения, звучавшие в произведениях подобного рода»[2], — отмечал позже Азимов.

Однако не все фантасты следовали такому шаблону. В декабре 1938 года был опубликован рассказ Лестера дель Рея «Хелен О’Лой»[en] — история женщины-робота, которая безумно полюбила своего создателя и стала для него идеальной женой[3]. Через месяц Отто Биндер опубликовал рассказ «Я, робот» о судьбе робота Адама Линка — не понятого людьми создания, движимого любовью и принципами чести[4].

Этот рассказ очень понравился Азимову. 7 мая 1939 года он посетил Общество научной фантастики Квинса, где встретил Биндера. Три дня спустя Азимов начал писать собственную историю «благородного робота». Через 13 дней он отдал рукопись своему другу Джону Кэмпбеллу, главному редактору журнала «Astounding». Однако тот рукопись вернул, заявив, что рассказ слишком похож на «Хелен О’Лой»[5].

К счастью, отказ Кэмпбелла не сказался на их отношениях с Азимовым, они продолжали регулярно встречаться и беседовать о новинках в мире фантастики. И вот 23 декабря 1940 года, за обсуждением очередного рассказа о роботах[6][7]:

…Кэмпбелл сформулировал то, что стало позже известно как Три закона роботехники. Позже Кэмпбелл говорил, что он просто вычленил Законы из того, что Азимов уже написал. Сам же Азимов всегда уступал честь авторства Трёх Законов Кэмпбеллу…

Через несколько лет ещё один друг Азимова — Рэндал Гаррет — приписал авторство Законов «симбиотическому товариществу» двух людей. Азимов с энтузиазмом принял эту формулировку.

Вообще говоря, появление Трёх Законов в произведениях Азимова происходило постепенно: первые два рассказа о роботах («Робби», 1940 и «Логика», 1941) не содержат явного их упоминания. Однако в них уже подразумевается, что роботам присущи некоторые внутренние ограничения. В следующем рассказе («Лжец», 1941) впервые звучит Первый Закон. И, наконец, полностью все три Закона приведены в «Хороводе» (1942).

Когда были написаны остальные истории и возникла идея издания сборника «Я, робот», первые два рассказа были «дополнены» Законами. Хотя стоит заметить, что в «Робби» законы несколько отличались от «классического» варианта, изложенного в остальных рассказах. В частности, идея о роботе, защищающем людей, в существовании которых он не совсем уверен, перекликается с мыслями Элайджа Бейли о несовершенстве Законов, описанными ниже.

В 1950-е годы Азимов писал преимущественно для молодёжи. Его издатель предполагал, что по этим рассказам можно будет снять телесериал. Опасаясь, что экранизация будет выглядеть «однообразно устрашающе», как и всё, по его мнению, что показывали по телевидению, Азимов решил опубликовать серию «Лакки Старр» под псевдонимом Пол Френч. Когда затея с экранизацией провалилась, Азимов снял псевдоним и дополнил текст рассказов серии Тремя Законами, подтвердив тем самым своё авторство[8].

Этическое обоснование Законов

В рассказе «Улики» (1946) Азимов детально изложил моральные обоснования Трёх Законов. Героиня рассказа, доктор Сьюзен Келвин, приводит следующие доводы:

- Человек обычно воздерживается от нанесения вреда другому человеку, за исключением случаев острого принуждения (например, на войне) или чтобы спасти большее число людей. Это эквивалентно Первому Закону.

- Аналогично, чувствуя ответственность перед обществом, человек выполняет указания авторитетных людей: врачей, учителей, начальников и т. д., что соответствует Второму Закону.

- Наконец, каждый из нас заботится о своей безопасности, — а это и есть Третий Закон.

Рассказ посвящён вопросу: можно ли различить человека и робота, созданного, чтобы выглядеть человеком, внешне неотличимого от человека? Келвин утверждает, что если кто-то следует Законам, то он «или робот, или очень хороший человек». А на вопрос, есть ли тогда большая разница между роботом и человеком, она отвечает: «Огромная разница. Прежде всего, роботы глубоко порядочны».

Приложения Трёх Законов вне фантастики

Если Три Закона имеют под собой глубокие этические принципы, то, может быть, они могут применяться не только к роботам? Многие авторы положительно отвечают на этот вопрос, приводя разнообразные примеры.

Так, в эссе «Законы роботехники»[1] Азимов отмечает, что действие Трёх Законов можно распространить на все инструменты, созданные человеком:

- Инструмент должен быть безопасным для использования — например, у ножей имеются рукоятки.

- Инструмент должен выполнять свои функции при условии, что он не представляет ни для кого никакой опасности.

- Инструмент должен оставаться в целости и сохранности во время его использования, если только его уничтожение не продиктовано соображениями безопасности или если это не входит в его функцию.

Иногда можно увидеть, как Три Закона в шутку относят к чему-либо, что создано для блага человека. Например, под их действие должны попадать любые социальные институты, в том числе государство:

- Государство не должно вредить людям или своим бездействием допустить, чтобы им был причинён вред.

- Государство должно выполнять свои функции, если они не противоречат Первому Закону.

- Государство должно заботиться о своей безопасности, если это не противоречит Первому и Второму Законам.

На основе Первого Закона Джеф Раскин сформулировал законы человекоориентированных интерфейсов[9]:

- Компьютер не может причинить вред данным пользователя или своим бездействием допустить, чтобы данным был причинён вред.

- Компьютер не должен тратить впустую ваше время или вынуждать вас выполнять действия сверх необходимых.

Гея, планета коллективного разума в серии романов «Основание», обладает чем-то похожим на Первый Закон:

- Гея не может причинить вреда форме жизни или своим бездействием допустить, чтобы форме жизни был причинён вред[10].

Вариации, предложенные Азимовым

В своих произведениях Айзек Азимов иногда привносит в Три Закона различные модификации и опровергает их, как бы испытывая Законы «на прочность» в разных обстоятельствах.

Нулевой Закон

Айзек Азимов однажды добавил Нулевой Закон, сделав его более приоритетным, чем три основных. Этот закон утверждал, что робот должен действовать в интересах всего человечества, а не только отдельного человека. Вот как выражает его робот Дэниел Оливо в романе «Основание и Земля»:

0. Робот не может нанести вред человечеству или своим бездействием допустить, чтобы человечеству был нанесён вред.Именно он был первым, кто дал этому закону номер — это произошло в романе «Роботы и империя», правда, само понятие ещё раньше сформулировала Сьюзен Келвин — в новелле «Разрешимое противоречие».

Первыми роботами, которые стали подчиняться Нулевому Закону, причём по собственной воле, — были Жискар Ривентлов и Дэниел Оливо. Это описано в одной из финальных сцен романа «Роботы и Империя», когда роботу необходимо было проигнорировать приказ одного человека ради прогресса всего человечества. Нулевой Закон не был заложен в позитронный мозг Жискара и Дэниэла — они пытались прийти к нему через чистое понимание Жискара и детективный опыт Дэниэла, через более тонкое, чем у всех остальных роботов, осознание понятия вреда. Однако Жискар не был уверен, насколько это было полезно для человечества, что негативно сказалось на его мозге. Будучи телепатом, Жискар перед выходом из строя передал Дэниелу свои телепатические способности. Только через много тысяч лет Дэниэл Оливо смог полностью приспособиться к подчинению Нулевому Закону.

Французский переводчик Жак Брекар невольно сформулировал Нулевой Закон раньше, чем Азимов описал его явно. Ближе к завершению романа «Стальные пещеры» Элайдж Бейли замечает, что Первый Закон запрещает роботу наносить человеку вред, если только не будет уверенности, что это будет полезно для него в будущем. Во французском переводе («Les Cavernes d’acier (фр.)», 1956 год) мысли Бейли переданы несколько иначе[11]:

Робот не может причинить вреда человеку, если только он не докажет, что в конечном итоге это будет полезно для всего человечества.

Оригинальный текст (фр.)

Un robot ne doit faire aucun tort à un homme, à moins qu’il trouve un moyen de prouver qu’en fin de compte le tort qu’il aura causé profite à l’humanité en général!

Примечательно, что логическое развитие Первого Закона до Нулевого предложили создатели фильма «Я, робот» 2004 года. Когда суперкомпьютер В. И. К. И. принимает решение ограничить свободу жителей планеты, чтобы они ненароком не нанесли вреда друг другу и своему будущему, она выполняет не Первый Закон, а именно Нулевой. Ещё интереснее то, что таким образом в фильме показывается противоречие Нулевого Закона Первому, его неэтичность. Действительно, когда речь идёт о благе человечества, система не может рассматривать людей по отдельности, а значит, ей ничто не мешает нарушить права и свободу любого или даже каждого человека (фактически, в «Разрешимом противоречии» позитронные суперкомьютеры уже вели себя аналогично, с той разницей что вред индивидуумам они старались снизить до предела). Во время войн, а нередко и в мирной жизни, люди наносят вред себе, окружающим, своей культуре. Поэтому на основании Нулевого Закона совершенно логично держать людей под постоянной опекой, не выполняя приказы столь неразумных существ.

Модификация Первого Закона

В автобиографических записях Азимова говорится, что вторая часть Первого Закона появилась из-за сатирической поэмы Артура Хью Клоу «Последний декалог», где есть такая строка: «Не убей, но и не слишком старайся сохранить другому жизнь»[12].

В рассказе «Как потерялся робот» несколько роботов из серии НС (Нестор) были выпущены только с «половиной» Первого Закона, которая звучит так:

- Робот не может причинить вреда человеку.

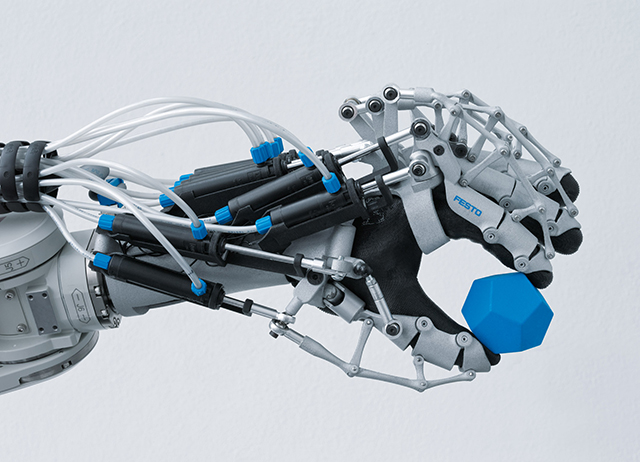

Это было сделано из практических соображений: роботы работали вместе с людьми, которые подвергались воздействию небольших безопасных доз радиации. Соблюдая наиболее приоритетный Первый Закон, роботы всё время бросались «спасать» людей. Так как позитронный мозг крайне уязвим для гамма-лучей, роботы постоянно выходили из строя. Усечение Первого Закона решало эту проблему, но при этом создавало бо́льшую: робот мог, например, сбросить тяжёлый груз и в последний момент не защитить человека. Такой поступок не противоречит усечённому Первому Закону.

Нарушение всех трёх Законов

Три раза в своих произведениях Айзек Азимов изобразил роботов, которые смогли нарушить Три закона, в противовес роботам Дэниелу и Жискару, которые усилили их, добавив Нулевой Закон. Следует заметить, что для нарушения всех трёх Законов роботу достаточно нарушить Первый Закон, так как остальные два основываются на нём.

- Первый такой случай описан в рассказе «Первый закон», когда робот МА-2 (Эмма) отказалась защитить человека в пользу своей «дочери», однако этот рассказ можно рассматривать как своего рода байку — как явствует из предисловия самого Азимова к рассказу в сборнике «Сны роботов».

- Второй случай был в рассказе «Кэл»: робот, которого собирались лишить способности творить, захотел убить своего хозяина[13].

- Третий случай — в рассказе «Салли», в котором роботы-автомобили оказались способны убить человека, который постоянно причинял им боль. Этот рассказ, однако, не ссылается на другие рассказы о позитронных роботах и не может быть включён в цикл.

В рассказе «Робот, который видел сны» повествуется о роботе LVX-1 (Элвекс), который благодаря особой «фрактальной геометрии» своего позитронного мозга мог впадать в бессознательное состояние и видеть сны. Ему снилось, что «роботы трудятся в поте лица своего, что они удручены непосильными трудами и глубокой скорбью, что они устали от бесконечной работы». В его снах роботы не обладали первыми двумя Законами, а Третий звучал так: «Робот должен защищать себя». Элвекс добавил, что в его сне был человек, сказавший: «Отпусти народ мой», имея в виду роботов. После того, как он сказал, что этим человеком был он сам, Сьюзен Келвин уничтожила Элвекса, поняв его опасность.

Возможность такого изменения

В своих произведениях Айзек Азимов в разное время придерживался различных взглядов относительно строгости Законов. В первых рассказах о роботах Законы — это просто удачно спроектированные ограничения, нечто вроде устава по мерам безопасности. В последующих рассказах Законы — неотъемлемая часть математической основы позитронного мозга. Без этой теоретической основы — так называемой «Фундаментальной теории стандартных схем» — учёные из азимовских произведений не смогли бы создавать любые работоспособные образцы. Прослеживается закономерность: случаи, когда роботехники экспериментируют с Законами, по хронологии мира Азимова происходят раньше, когда ещё нет огромного объёма работ, для выполнения которых требуются роботы, когда сами роботы ещё относительно просты по своей конструкции и функциям, когда ещё не накоплен достаточный опыт в их проектировании. В рассказе «Как потерялся робот» Сьюзен Келвин признаёт изменение Законов ужасной, но технически возможной затеей; позже, в «Стальных пещерах», доктор Джерригел говорит, что это невозможно в принципе.

Персонажи произведений Азимова часто отмечают, что Законы — это не вербально записанные предложения в памяти робота, а очень сложные математические формулы, на которых базируется всё сознание робота. Законы сродни человеческим инстинктам, таким как инстинкт самосохранения, следовательно, именно они намечают путь самоопределения роботов. Робот «по зову природы» обслуживает людей, подчиняется их приказам, и не думает о своих ограничениях или возможной независимости — можно сказать, последнее доставило бы ему неудобство.

Опять же, этот принцип в меньшей мере просматривается в ранних по хронологии сюжета произведениях, в которых роботы создавались для облегчения труда человека и были чрезвычайно простыми; во времена «Стальных пещер» и роботов с почти человеческим интеллектом Три закона роботехники стали одной из основ мировоззрения человечества.

Понятие «человека» в Законах

Жители планеты Солярия стали создавать роботов, подчинявшихся Трём Законам, но имевших другое понимание слова «человек». Роботы на этой планете были обучены тому, что «человек» — это только тот, кто говорит с солярианским акцентом. Роботы свободно могли причинить вред чужаку, они даже специально были на это запрограммированы. Во времена «Основания и Земли» выяснилось, что солярианцы широко развивали генные технологии, и помимо всего прочего, теперь обладали хорошо заметными органами, предназначенными для снабжения своих роботов энергией. Определение человека для их роботов (по крайней мере, охранников) теперь включало обладание данными органами, и роботы стали исполнять Три Закона лишь по отношению к людям Солярии, в ущерб остальной части галактики и даже солярианским детям. В последней из книг про Дэвида Старра, сирианский робот едва не убивает Джона Бигмана по приказу своего начальника: поскольку сирианское общество практикует евгенику, таких низкорослых людей у них не бывает, и робота удается убедить, что Бигман — не человек.

Азимов несколько раз обращается к проблеме осознания роботом себя как человека. Роман «Роботы и Империя», а также рассказы «Улики», «Заминка на праздновании Трёхсотлетия» описывают роботов, созданных, чтобы притворяться людьми. Есть также истории, где роботы, «эволюционируя», изменили внутреннее понимание Законов, приблизившись к людям: это «Двухсотлетний человек» и «Яко помниши его». Как пишет Гвендолин Батлер в «Гробнице для канарейки»: «Возможно, мы — роботы. Роботы, выполняющие Последний закон роботехники… Чтобы становиться людьми»[14].

В рассказе «…Яко помниши его» Азимов провёл максимально изощрённое исследование Трёх Законов, обратив их таким образом, что стал возможным «сценарий Франкенштейна». Два робота из серии Джорджи приходят к соглашению, что органическое происхождение — необязательное условие, чтобы считаться человеком, и что истинные люди — это они, как наиболее совершенные и разумные создания. Остальные люди — тоже люди, но с меньшим приоритетом. А раз так, то Три Закона должны быть в первую очередь применены к ним. Повествование заканчивается зловещими словами, что роботы находились в «бесконечном терпеливом ожидании» того дня, когда они утвердят своё первенство среди людей, — и это будет неизбежным результатом «Трёх Законов Гуманистики».

На самом деле, этот рассказ не очень хорошо вписывается в основную серию произведений о роботах: если бы «Джорджи» реализовали свой план после окончания рассказа, то другие истории о дальнейших событиях были бы невозможны. Именно такого рода противоречия в произведениях Азимова дают основания критикам рассматривать их скорее как «скандинавские саги или греческие легенды», чем единую фантастическую «вселенную».

Схожая идея высказывается в романе «Роботы зари», где Келден Амадиро желает использовать в качестве колонизаторов новых планет человекоподобных роботов. Элайдж Бейли, в разговоре с ним, высказывает опасение что такие роботы могут не пустить на обустроенные им планеты людей, считая что людьми являются именно они сами.

Если в предыдущем случае робот занял место человека в природе, то в «Двухсотлетнем человеке» Азимов описывает противоположную судьбу: робот, освободившийся от Трёх Законов и осознавший себя как человека, присоединился к сообществу людей. Опять же, в расширенной версии — новелле «Позитронный человек», написанной Азимовым в соавторстве с Робертом Силвербергом, — из-за подобных этических проблем люди полностью отказались от идеи создания мыслящих роботов. Такое развитие событий полностью противоречит картине будущего, описанного в мирах «Основания».

Проблемы применения

Разрешение противоречий

Сам Азимов в предисловии к рассказу «Первый закон» в сборнике «Остальное о роботах» (1964) заявил, что в Законах было как раз столько двусмысленности, чтобы обеспечивать конфликты и неопределённости для новых рассказов. Наиболее совершенные модели роботов обычно следовали Законам по довольно хитрому алгоритму, который позволял избегать некоторых проблем. Во многих рассказах, например в «Хороводе», в позитронном мозге сравнивались потенциалы возможных действий и исходов, и робот мог нарушить Законы, как только это представлялось возможным, вместо того, чтобы бездействовать. Например, Первый Закон не позволял роботу проводить хирургические операции, так как для этого нужно «наносить вред» человеку. Однако в азимовских рассказах можно найти роботов-хирургов (яркий пример тому — «Двухсотлетний человек»). Дело в том что робот, если он достаточно совершенен, может взвесить все альтернативы и понять, что он сам причинит гораздо меньше вреда, чем если бы операцию проводил человек-хирург или она бы вообще не состоялась. В «Уликах» Сьюзен Кэлвин говорит даже, что робот мог бы выступать в качестве прокурора, так как он лично не причиняет никому вреда: кроме него есть ещё присяжные, которые устанавливают виновность, судья, который выносит приговор, и палач, приводящий его в исполнение.

Роботы, подчиняющиеся Законам, могут испытать «роблок», или «умственное замораживание» — состояние необратимого повреждения позитронного мозга, — в случае если они не могут подчиниться Первому Закону или обнаруживают, что случайно нарушили его. Это возможно, например, если робот наблюдает сцену убийства человека, но находится слишком далеко, чтобы его спасти. Первый случай такого «замораживания» происходит в «Лжеце»; также немаловажную роль это состояние играет в сюжете романов «Обнажённое солнце» и «Роботы зари». Несовершенные модели роботов могут блокироваться, если перед ними поставили задачу подчинения двум противоречащим приказам. «Замораживание» может быть необратимым или временным. Разрешением противоречий и изучением поведения роботов занимаются робопсихологи, как один из персонажей Азимова — Сьюзен Келвин.

Иное определение вреда в Первом Законе

Законы никак не определяют границы того, что может называться вредом для человека — это часто зависит от возможностей робота воспринимать информацию и философски мыслить. Например, будет ли полицейский робот понимать, что он не нанесёт вреда человеку, если осторожно проводит особо опасного преступника в участок?

В рассказе «Лжец!» робот-телепат Херби вынужден был понимать под вредом и то, что может любым способом разочаровать или расстроить людей — он знал, что люди при этом испытывают некую душевную боль. Это заставляло его постоянно говорить людям вместо правды то, что они хотели услышать. В противном случае, в его понимании, он нарушил бы Первый Закон.

Лазейки в Законах

В «Обнажённом солнце» Элайдж Бейли замечает, что Законы неправильно формулируются людьми, потому что робот может нарушить их по незнанию. Он предложил следующую «правильную» формулировку Первого Закона: «Робот не может делать ничего, что, насколько ему известно, причинит вред человеческому существу или умышленно допустить, чтобы человеческому существу был причинён вред».

Это дополнение проясняет, что робот может даже стать орудием убийства, если он не осведомлён о сущности своих действий. Например, ему могут приказать добавить что-то кому-то в пищу, а он не будет знать, что это яд. Более того, Бейли говорит, что преступник может поручить эту задачу нескольким роботам, так, чтобы ни один не понял замысла целиком[15].

Бейли утверждает, что солярианцы однажды смогут использовать роботов даже в военных целях. Если космический корабль будет построен с роботоподобным мозгом и при этом на нём не будет ни людского экипажа, ни систем жизнеобеспечения, то интеллект этого корабля может ошибочно предположить, что и на всех космических кораблях нет людей. Такой корабль будет более манёвренным, быстрым, а возможно и лучше вооружённым, чем управляемый людьми. Но самое главное, он будет способен уничтожать людей, не подозревая об их присутствии. Эта возможность описана в «Основании и Земле», где также выясняется, что солярианцы обладают чрезвычайно мощной армией роботов, понимающих под «людьми» только уроженцев Солярии.

Другие случаи использования Законов в фантастике

Айзек Азимов верил, что его Законы послужат основой нового взгляда на роботов, уничтожат «комплекс Франкенштейна» в научной фантастике и массовом сознании, станут источником идей для новых рассказов, где роботы показаны разносторонними и привлекательными. Его любимым примером такого произведения были «Звёздные войны». С мнением Азимова, что роботы — это нечто большее, чем просто «тостеры» или «механические монстры», в конечном итоге согласились и другие фантасты. В их произведениях появились роботы, подчиняющиеся Трём законам, но, по традиции, только Азимов упоминал о них явно.

В произведениях, где прямо говорится о Трёх Законах, обычно упоминается и их автор (например в романе С. Лукьяненко «Чистовик»). Есть и исключения: например, в немецком сериале 1960-х годов «Raumpatrouille — Die phantastischen Abenteuer des Raumschiffes Orion» («Космический патруль — фантастические приключения космического корабля Орион»), а именно в третьем его эпизоде «Hüter des Gesetzes» («Служитель Закона»), азимовские Законы привлечены без указания источника.

Фильмы

Робби-Робот в «Запретной планете» 1956 года имел иерархическую структуру команд, не позволявшую ему причинить людям вред, даже по приказу — такие приказы вызывали конфликт логических схем и блокировку. Робби был одним из первых роботов со встроенной системой безопасности в кинематографе. Сам Азимов остался доволен Робби.

НДР-114 объясняет Три ЗаконаФильмы по мотивам работ Айзека Азимова ставились несколько раз, с различной степенью финансового успеха и возникавшей критики. Некоторые из них, наиболее известные, связаны именно с историями про роботов и Тремя законами роботехники. Фильм «Двухсотлетний человек» 1999 года, представляет робота NDR-114[16], Эндрю Мартина, процитировавшего Три Закона своим хозяевам как «развлекательную презентацию» с использованием своего голографического проектора. Стоит отметить, однако, что Законы не занимают центральное место в сюжете фильма.

Фантастический сериал «Настоящий Арон Стоун» в главной роли Блац, Келли, робот(Андроид) по имени Стен, в роли Ману, Жан-Поль так же использовался закон Азимова, Стен постоянно оговаривает закон и то что он не может его нарушить иначе у него погорят все микросхемы.

Сценарий «Я, робот»[17]Харлана Эллисона начинается с изложения концепции Трёх Законов, а проблемы, вытекающие из них, занимают большое место в сюжете. Сценарий основан на четырёх коротких историях Азимова, три из которых — из сборника «Я, робот» 1950 года. Эта адаптация в большой степени соответствует оригиналам. Вследствие конфликта с Голливудской студией, в адрес которой Эллисон выступил с обвинениями, его сценарий так и не был экранизирован.

Неоднозначные отзывы вызвал фильм «Я, робот» 2004 года, особенно вступительное «По мотивам рассказов Азимова». Правда, у Азимова фигурирует глобальный ИИ (точнее, четыре суперкомпьютера), который под предлогом следования Законам стремится подчинить человечество, или, по крайней мере, направить его развитие в нужном направлении, но при этом данные компьютеры по возможности уменьшают вред, в основном действуя путём осторожного оттирания своих противников от власти. Зато такие сюжеты часто встречались в других, нисколько не задевающих Законы, фильмах: «Терминатор», «Матрица». С другой стороны, отдельные элементы постановки, действительно, взяты у Азимова.

Рецензия Алекса Экслера разграничивает этот фильм и азимовские рассказы[18]:

Вопреки критике и некоторым отзывам зрителей, которые мне довелось слышать, «Я, робот» — довольно забавный фантастический боевичок. … Когда мы … хотим насладиться Азимовым — мы читаем Азимова. А когда мы хотим посмотреть фантастический боевик — мы смотрим фантастический боевик. «Я, робот» как боевик нас вполне удовлетворил.

Рецензия Алексея Садецкого обращает внимание на то, что фильм, уйдя чуть в сторону от Азимова, сам по себе поставил две новых социально-философских проблемы[19]: «стоит ли человеку платить свободой за безопасность?» и «должны ли мы противиться, если существа, находящиеся в нашем распоряжении, потребуют для себя свободы?». Нельзя не отметить, что фильм поставил под сомнение более поздний Нулевой Закон роботехники Азимова (см. выше).

В повести Кира Булычёва «Ржавый фельдмаршал» обыгрывается принцип непричинения вреда человеку. «Современный» робот отличается от «устаревшего» именно наличием такого запрета.

В знаменитом американском мультипликационном шоу-сериале Футурама, присутствует расхожий гэг, суть которого в том, что один из главных персонажей, робот Бендер, мечтает убить всех людей, но не может этого сделать из-за тех самых Трёх законов роботехники.

В фильме «Чужие» андроид Бишоп цитирует Первый закон.

В аниме Eve no Jikan также упоминаются эти законы, как обязательные для исполнения андроидами.

В аниме Ghost in the Shell 2: Innocence гиноиды обходили первый закон и после убивали себя, вопреки третьему закону, за счет копий «призраков» детей. В момент снятия копии, дети думали о мести, а после пересадки «призрака» в гиноида тот выходил из строя.

В серии фильмов «Робокоп» у главного героя, киборга-полицейского, в программе присутствует три директивы, описывающие разрешённые действия и запрещая вредные для целей корпорации «OCP», создавшей Робокопа:

- Служить обществу;

- Защищать невиновных;

- Соблюдать закон

Также присутствует четвёртая, тайная директива, запрещавшая действия, направленные против руководителей «OCP». Сюжеты фильмов о Робокопе включают моменты нарушения этих директив, возможные из-за человеческой части личности Робокопа.

В фильме «Страховщик» существуют две директивы, которые служат моделью поведения и ограничивают способности роботов.

Применимость к технологиям будущего

Работы в области искусственного интеллекта рассматривают Законы роботехники как идеал будущего: нужно быть действительно гением, чтобы найти способ применить их на практике. Да и в самой области искусственного интеллекта могут потребоваться серьёзные исследования, для того чтобы роботы поняли Законы. Однако, чем более сложными становятся роботы, тем больше высказывается заинтересованности в разработке руководящих принципов и мер безопасности для них.

Современные робототехники признают, что на сегодняшний день азимовские Законы хороши для написания рассказов, но бесполезны на практике. Некоторые утверждают, что Законы вряд ли будут реализованы в роботах, потому что это не нужно военным структурам — главному источнику финансирования исследований в этой области. Специалист по научной фантастике Роберт Сойер обобщил это утверждение для всех отраслей промышленности[20]:

Развитие ИИ — это бизнес, а бизнес, как известно, не заинтересован в развитии коренных мер безопасности — особенно философских. Вот несколько примеров: табачная индустрия, автомобильная промышленность, ядерная промышленность. Ни для одной из них изначально не было сказано, что серьёзные меры безопасности необходимы, и все они препятствовали внешне налагаемым ограничениям, и ни одна из них не приняла абсолютный эдикт против причинения вреда людям.

Стоит отметить, что эссе Сойера упускает из вида вопросы непреднамеренного нанесения вреда, как было описано, например, в «Обнажённом солнце». Однако есть и возражения против такой позиции: возможно, военные захотят использовать для роботов как можно больше мер предосторожности, и поэтому ограничения, похожие на Законы роботехники, так или иначе будут применены. Фантаст и критик Дэвид Лэнгфорд иронически заметил, что эти ограничения могут быть и такими:

- Робот не может причинить вреда авторизованному правительственному персоналу, но должен ограничивать слишком назойливых посетителей с особой тщательностью.

- Робот должен выполнять приказы авторизованного персонала, кроме приказов, противоречащих Третьему Закону.

- Робот должен заботиться о своей безопасности с применением противопехотного оружия, потому что робот — чертовски дорогостоящая штука[21].

Роджер Кларк написал две работы, посвящённых анализу осложнений при реализации Законов, если бы однажды их смогли применить в технике. Он пишет[22]:

Азимовские Законы роботехники стали успешным литературным инструментом. Возможно по иронии, а может, это был мастерский ход, но в целом азимовские истории опровергают ту точку зрения, с которой он начал: Невозможно надёжно ограничить поведение роботов, изобретая и применяя некоторый набор правил.

С другой стороны, более поздние романы Азимова («Роботы Утренней зари», «Роботы и Империя», «Основание и Земля») показывают, что роботы наносят ещё больший долговременный вред, соблюдая Законы и отнимая таким образом у людей свободу совершать изобретательные или рискованные действия.

Фантаст Ханс Моравек — выдающаяся фигура в трансгуманистическом движении — высказал предложение, что Законы роботехники должны быть использованы в корпоративных интеллектуальных системах — корпорациях, управляемых ИИ и использующих производственную силу роботов. Такие системы, по его мнению, скоро возникнут[23].

В 2007 году правительство Южной Кореи начало разрабатывать «Устав этических норм для роботов». Основные положения Устава напоминают сформулированные Азимовым Законы роботехники[24].

Елиезер Юдковски исследует в Институте сингулярности (SIAI) в США проблемы глобального риска, которые может создать будущий сверхчеловеческий ИИ, если его не запрограммировать на дружественность к человеку[25]. В 2004 году SIAI был открыт сайт AsimovLaws.com, созданный для обсуждения этики ИИ в контексте проблем, затронутых в фильме «Я, робот», выпущенном лишь два дня спустя. На этом сайте они хотели показать, что законы роботехники Азимова небезопасны, поскольку, например, могут побудить ИИ захватить власть на Земле, чтобы «защитить» людей от вреда.

См. также

Примечания

- ↑ 1 2 Азимов, Айзек. Улики // Мечты роботов. — М.: Эксмо, 2004. — С. 142—169. — ISBN 5-699-00842-X.

- ↑ Азимов, Айзек. Эссе № 6. Законы роботехники // Мечты роботов. — М.: Эксмо, 2004. — С. 781—784. — ISBN 5-699-00842-X.

- ↑ Ср. с мифом о Галатее.

- ↑ Интересно, что в одном из авторских продолжений, истории «Месть Адама Линка» (1940), озвучиваются его мысли: «Робот по своей свободной воле не должен убивать человека».

- ↑ Позже рассказ всё-таки был опубликован Фредериком Полом под названием «Странная нянька» («Strange Playfellow») в сентябрьском номере журнала «Super Science Stories» за 1940 год

- ↑ David Langford, Laws of Robotics // SFE: The Encyclopedia of Science Fiction, online edition, 2011—.

- ↑ Сергей Бережной. Айзек Азимов: Человек, который писал еще быстрее. Русская фантастика (1994). Проверено 14 января 2007. Архивировано 25 января 2012 года.

- ↑ Айзек Азимов. In Joy Still Felt. — Doubleday, 1980. — ISBN 0-385-15544-1.

- ↑ Джеф Раскин. Интерфейс: новые направления в проектировании компьютерных систем. — Символ-Плюс, 2003. — ISBN 5-93286-030-8.

- ↑ См. также: гипотеза Геи

- ↑ Les Cavernes d’acier. — J’ai Lu Science-fiction, 1975. — ISBN 2-290-31902-3.

- ↑ Азимов, Айзек. Эссе № 12. Мои роботы // Мечты роботов. — М.: Эксмо, 2004. — С. 815—819. — ISBN 5-699-00842-X.

- ↑ Виталий Карацупа. Азимов Айзек. Кэл. Проверено 17 февраля 2007. Архивировано 25 января 2012 года.

- ↑ Gwendoline Butler. A Coffin for the Canary. — Black Dagger Crime, 2001. — ISBN ISBN 0-7540-8580-5.

- ↑ В «Обнажённом солнце» дело осложняется тем, что на Солярии миллионы соединённых глобальной сетью роботов и преступник может находиться в любой точке планеты, дистанционно отдавая приказы.

- ↑ Серийный номер отчасти ссылается на «торговый номер» Стенли Кубрика и используется только в фильме — в оригинальном рассказе Эндрю «не помнил» своего номера.

- ↑ Harlan Ellison. I, Robot: The illustrated screenplay. — Aspect, 1994. — ISBN 0-446-67062-6.

- ↑ Алекс Экслер. Фантастический боевик «Я, робот» (I, Robot) 2004

- ↑ Садецкий, Алексей. Что может быть проще рабства 2004

- ↑ Robert J. Sawyer. On Asimov’s Three Laws of Robotics (1991). Проверено 17 февраля 2007. Архивировано 25 января 2012 года.

- ↑ David Langford. Computer Plots To Avoid. Ansible (1988). Проверено 19 декабря 2007. Архивировано 25 января 2012 года.

- ↑ Clarke, Roger. Asimov’s laws of robotics: Implications for information technology. Часть 1 IEEE Computer, декабрь 1993, С. 53—61; Часть 2 IEEE Computer, январь 1994, С. 57—66. Обе части свободно доступны на сайте Австралийского национального университета.

- ↑ Hans Moravec. The Age of Robots (1993). Проверено 19 декабря 2007. Архивировано 25 января 2012 года.

- ↑ Южная Корея разрабатывает сборник законов для роботов

- ↑ ИИ как фактор глобального риска

Ссылки

wikiredia.ru

Три закона робототехники Википедия

Три зако́на роботе́хники в научной фантастике — обязательные правила поведения для роботов, впервые сформулированные Айзеком Азимовым в рассказе «Хоровод» (1942).

Законы гласят:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму Законам.

Оригинальный текст (англ.)

- A robot may not injure a human being or, through inaction, allow a human being to come to harm.

- A robot must obey orders given it by human beings except where such orders would conflict with the First Law.

- A robot must protect its own existence as long as such protection does not conflict with the First or Second Law.

Трём Законам, а также возможным причинам и следствиям их нарушения, посвящён цикл рассказов Азимова о роботах. В некоторых из них, наоборот, рассматриваются непредвиденные последствия соблюдения роботами Трёх Законов (например, «Зеркальное отражение»).

В одном из рассказов цикла персонаж Азимова приходит к заключению об этической основе Трёх Законов: «…если хорошенько подумать, Три Закона роботехники совпадают с основными принципами большинства этических систем, существующих на Земле… попросту говоря, если Байерли исполняет все Законы роботехники, он — или робот, или очень воспитанный человек»[1].

В 1986 году в романе «Роботы и Империя» (англ. Robots and Empire) Азимов предложил Нулевой Закон:

0. Робот не может причинить вред человечеству или своим бездействием допустить, чтобы человечеству был причинён вред.

Оригинальный текст (англ.)

0. A robot may not harm humanity, or, by inaction, allow humanity to come to harm.

Три закона роботехники — объединяющая тема для всей фантастики Азимова, включая не только цикл о роботах, но и некоторые другие произведения.

История возникновения Трёх Законов[ | код]

Появление понятия[ | код]

ru-wiki.ru