Содержание

Как искусственный интеллект написал песни Nirvana, Джима Моррисона и Эми Уайнхаус

Культура

close

100%

Организация Over the Bridge запустила проект «Lost Tapes of the 27 Club», в котором с помощью нейросетей создает песни от лица покойных музыкантов, таких как Джими Хендрикс, Джим Моррисон, Эми Уайнхаус и Курт Кобейн. Основная цель проекта — убедить страдающих от психических расстройств музыкантов своевременно обратиться за помощью.

Новая песня американской гранж-группы Nirvana «Drowned in the Sun» была написана с помощью искусственного интеллекта в рамках проекта «Lost Tapes of the 27 Club» организации Over the Bridge из Торонто, цель которой — привлечение внимания к психическим расстройствам музыкантов.

«Пока существует популярная музыка, артисты страдают от расстройств психического здоровья в разы чаще, чем обычное взрослое население. Прежде этот вопрос не просто игнорировался — его романтизировали такие явления, как «Клуб 27» (объединенное название влиятельных музыкантов, ушедших из жизни в возрасте 27 лет)», — гласит обращение создателей проекта на его официальном сайте. Они призывают музыкантов обращаться за необходимой им психологической поддержкой, чтобы они могли продолжать создавать свою музыку, потому что даже искусственный интеллект никогда не заменит живого творения.

Прежде этот вопрос не просто игнорировался — его романтизировали такие явления, как «Клуб 27» (объединенное название влиятельных музыкантов, ушедших из жизни в возрасте 27 лет)», — гласит обращение создателей проекта на его официальном сайте. Они призывают музыкантов обращаться за необходимой им психологической поддержкой, чтобы они могли продолжать создавать свою музыку, потому что даже искусственный интеллект никогда не заменит живого творения.

Альбом «Lost Tapes of the 27 Club» состоит из четырех песен. Помимо «композиции» Nirvana, создатели проекта представили, что могли бы написать Джими Хендрикс, Джим Моррисон и Эми Уайнхаус, если бы остались живы.

Каждый трек стал результатом работы программы искусственного интеллекта Google Magenta, которая проанализировала около 30 песен каждого исполнителя. Детально изучив вокал, ритмические рисунки, гармонию, гитарные риффы и соло, партии ударных и тексты, нейросеть создала новые композиции, которые впоследствии были отобраны создателями проекта.

Детально изучив вокал, ритмические рисунки, гармонию, гитарные риффы и соло, партии ударных и тексты, нейросеть создала новые композиции, которые впоследствии были отобраны создателями проекта.

По словам одного из членов совета директоров Over the Bridge Шона О’Коннора, аналогичным образом создавались и тексты песен. Нейросеть проанализировала огромное количество текстов того или иного исполнителя, на основании чего впоследствии угадывала и достраивала соответствующий ритм и тон стиха.

После того, как композиции были готовы, начался подбор певцов. В настоящее время не существует алгоритма, который мог бы создать полноценную вокальную партию, которая соответствовала бы стилю определенного исполнителя, поэтому записать песню без участия человека пока нельзя.

О’Коннор отметил, что практически все приглашенные музыканты ранее работали трибьют-исполнителями этих групп, поэтому они могли воссоздать интонации и сделать звучание максимально реалистичным.

Создатели проекта потратили около года на исследования и разработку песен и еще шесть месяцев на завершение записи. В процессе работы они обращались за помощью к самым преданным фанатам артистов, чтобы не допустить потенциальный плагиат.

В организации также надеются, что «Lost Tapes of the 27 Club» повысит осведомленность о том, сколько человеческого труда вкладывается в музыку, созданную искусственным интеллектом.

«Многие люди могут подумать, что ИИ в какой-то момент заменит музыкантов, но на данный момент количество людей, необходимое для того, чтобы добраться до точки, в которой песня станет доступной для прослушивания, на самом деле довольно велико. Мы не собираемся нажимать на кнопки и заменять живых артистов», — заключил О’Коннор.

Мы не собираемся нажимать на кнопки и заменять живых артистов», — заключил О’Коннор.

Подписывайтесь на «Газету.Ru» в Новостях, Дзен и Telegram.

Чтобы сообщить об ошибке, выделите текст и нажмите Ctrl+Enter

Новости

Дзен

Telegram

Картина дня

Военная операция на Украине. День 226-й

Онлайн-трансляция военной спецоперации РФ на Украине — 226-й день

«Призыв к началу мировой войны». В Кремле ответили на слова Зеленского о превентивных ударах

Зеленский призвал НАТО нанести превентивные удары по России

«Телефон мистера Харригана»: что не так с новой экранизацией Стивена Кинга

Рецензия на фильм «Телефон мистера Харригана» — экранизацию повести Стивена Кинга

Двадцать два региона объявили о завершении частичной мобилизации

Экс-гендиректор «Зимней вишни» Вишневский осужден на 8 лет за взятку надзорным органам

«ЦСР» оценил убытки ушедших из России компаний в $240 млрд

«Ъ»: сеть гипермаркетов OBI может сменить название

Новости и материалы

WSJ: США отказываются поставлять на Украину ракеты ATACMS для ударов по Крыму

Глава оборонного комитета бундестага призвала предоставить Украине танки

Создан детский смартфон со шнурком для вызова экстренных служб

Газета The Sun оценила вероятность ядерного удара США по России

Сенатор Полетаев заявил, что в Республике Алтай не мобилизовали ни одного человека

Российский бизнесмен Демин нашел покупателя на клуб АПЛ «Борнмут»

В Москве открылся международный музыкальный фестиваль

В Уральске школьник упал в обморок и скончался на уроке физики

Президент Турции Эрдоган заявил, что сейчас Анкаре не о чем говорить с Афинами

Двое жителей ЕАО избили подростков ради телефона и паспорта

В Северной Осетии мать прижгла руки малолетнему сыну за плохое поведение

Минздрав Херсонской области: число жертв обстрела автобуса выросло до пяти

Колумнист Савчук посчитал, что Запад толкнул Саудовскую Аравию в крепкие объятия России

Умер заслуженный артист России Леонид Шумский

Россиянам рассказали, какие цветы посадить в октябре

Рогов заявил, что ВСУ обстрелами береговой линии у Энергодара готовятся к десанту

Стремоусов назвал невозможным разрушение Антоновского моста силами ВСУ

Луческу высказался о пользе Украине от проведения чемпионата мира по футболу — 2030

Все новости

Тест: какой странный факт из жизни писателя-классика – правда

Кто из великих скакал с семьей вокруг стола, а кто съел булочки с опилками?

Мария Дегтерева

Щас спою

О том, можно ли запрещать украинские песни

Лукашенко приказал заморозить все цены. Что будет с экономикой Белоруссии

Что будет с экономикой Белоруссии

Лукашенко объявил о запрете на любое повышение цен в Белоруссии с 6 октября

ЕС внес в черные списки трех российских певцов и одного философа

ЕС ввел санкции против артистов Газманова, Расторгуева и Чичериной и философа Дугина

«Как только безумие остановится». Дерипаска рассказал, что будет после мирового кризиса

Дерипаска заявил, что «нынешнее безумие» в мире продлится еще 2,5-3 года

Pixel Watch, Pixel 7 Pro и Pixel Tablet. Все анонсы с осенней презентации Google

Google представила первые смарт-часы Pixel Watch и новые смартфоны Pixel 7 и Pixel 7 Pro

Ноги в грязи, руки в презервативах: чем запомнились Недели моды в Милане и Париже

Подпольный аборт и секс с советским дипломатом: о чем писала лауреат Нобелевской премии по литературе Анни Эрно

Президент Франции Макрон поздравил Анни Эрно с присуждением Нобелевской премии по литературе

Взрывы на «Северных потоках»: что выяснила Швеция

В Швеции завершили расследование на месте утечек на «Северных потоках»

«Попытаемся понять друг друга». Матвиенко позвала Украину за стол переговоров

Спикер Совфеда Матвиенко заявила о готовности к переговорам с Украиной на условиях Москвы

Криптокошельки, уголь и сигареты. Что попало под новые санкции ЕС

ЕС утвердил восьмой пакет антироссийских санкций

От Кобейна до Башлачева: существует ли «Клуб 27» на самом деле

Правда и мифы о «Клубе 27»

Публициста Кара-Мурзу обвинили в госизмене. Это его третье уголовное дело за полгода

СМИ: против публициста Кара-Мурзы-младшего возбуждено дело о госизмене

От сюит до Nirvana: послушайте созданную нейросетью музыку

Искусственный интеллект, создающий музыку, — уже не пугающая новинка, а удобный и распространенный инструмент. Энтузиасты по всему миру активно используют технологию и выводят творчество на новый уровень

«У меня такое ощущение, что мы находимся на пороге конца искусства, человеческого искусства. Как только появится коллективный искусственный интеллект, он превзойдет нас в способности создавать художественные произведения», — сказала в 2020 году канадская певица Grimes. Однако некоторые музыканты с ней не согласны и считают, что ИИ не заменит людей, но даст начало золотой эре творчества.

Однако некоторые музыканты с ней не согласны и считают, что ИИ не заменит людей, но даст начало золотой эре творчества.

Программное обеспечение для создания музыки с помощью нейросетей за последние несколько лет продвинулось далеко. Искусственный интеллект научился сочинять песни в разных жанрах на основе отрывка заданной мелодии или самостоятельно с нуля и даже дописывать неоконченные произведения умерших композиторов. Вот лишь некоторые из мелодий, созданных нейросетями.

Первая сюита, написанная ИИ

Люди используют компьютерные технологии для создания музыкальных композиций уже много лет. Первое подобное произведение вышло еще в 1957 году. Тогда сотрудники американского Университета Иллинойса дали программе определенные правила построения композиций и обучили ее основам музыкальной теории. Машина на основе этих данных сгенерировала математическую последовательность. Ее затем преобразовали в нотный текст. В результате получилось произведение для струнных инструментов, названное создателями «Сюита Иллиака».

«Взлом божественного кода»

В 2020 году канадская певица Grimes создала с помощью искусственного интеллекта бесконечную колыбельную для своего сына. Исполнительница дала нейросети музыкальную основу, а ИИ в приложении Endel стал непрерывно изменять ее. Музыка получается всегда разная: она подстраивается под время суток, погоду и даже пульс слушателя. «В этом есть что-то магическое. Может прозвучать странно, но мы будто взламываем божественный код», — сказала Grimes.

ИИ подарил поп-группе первую номинацию на «Грэмми»

Американская танцевальная поп-группа YACHT для создания своего последнего альбома Chain Tripping прибегла к помощи нейросети. Музыканты загрузили в систему огромный каталог поп-музыки, а ИИ отбирала самые необычные биты в ритмические последовательности. По словам участницы группы Клэр Эванс, музыкантам потребовалось «много мучительных часов», чтобы научиться играть риффы и аккорды, сгенерированные нейросетью, поскольку они сильно отличались от того, к чему мы привыкли. «ИИ заставил нас отказаться от шаблонов. Это позволило вырваться из клетки привычек», — сказала Эванс. В результате YACHT впервые за двухлетнюю карьеру номинировали на премию «Грэмми» за лучший иммерсивный альбом.

«ИИ заставил нас отказаться от шаблонов. Это позволило вырваться из клетки привычек», — сказала Эванс. В результате YACHT впервые за двухлетнюю карьеру номинировали на премию «Грэмми» за лучший иммерсивный альбом.

«Евровидение» для компьютеров

Создатели музыки при помощи искусственного интеллекта из Нидерландов в 2020 году провели свой аналог песенного конкурса «Евровидение». В первом в истории соревновании композиций, написанных нейросетями, участвовали команды из 13 стран. Победителем стал трек Beautiful The World от группы Uncanny Valley. Он примечателен тем, что для его создания нейросеть обучали на звуках животных из Австралии, например, коал и тасманских дьяволов. Текст песни соответствующий — в нем говорится о пожарах в этой стране.

Второе место заняла жуткая песня I’ll Marry You, Punk Come немецких музыкантов. Третье досталось композиции Abbus от голландской команды. Создатели хотели сделать песню, понятную слушателям из разных стран: для этого они «скормили» нейросети образцы народного фольклора, 250 самых известных песен с «Евровидения», около 5 тыс. поп-песен разных времен, а также базу данных с текстами с сайта Reddit (сообщения с платформы понадобились для «оживления» лирики). В итоге получился трек, призывающий к революции. Причиной столь неожиданного результата стали как раз сообщения с Reddit, характеризующиеся свободным выбором тем и не всегда миролюбивым характером.

поп-песен разных времен, а также базу данных с текстами с сайта Reddit (сообщения с платформы понадобились для «оживления» лирики). В итоге получился трек, призывающий к революции. Причиной столь неожиданного результата стали как раз сообщения с Reddit, характеризующиеся свободным выбором тем и не всегда миролюбивым характером.

Саундтрек от нейросети

Для создания эмоциональных саундтреков к фильмам, видеоиграм или рекламным роликам тоже часто используют нейросети. Например, разработчики из разных стран создали технологию искусственного интеллекта AIVA. Она обучается на музыке Баха, Моцарта, Бетховена и других известных композиторов и создает свои произведения. Обычно AIVA генерирует музыку в классическом стиле, но в 2018 году она смогла создать саундтрек в жанре рок. «Когда мы впервые слушали файл, который написала AIVA, было трудно не улыбнуться из-за типичной рок-басовой линии и узнаваемой, но оригинальной аккордовой прогрессии и запоминающейся мелодии», — рассказали разработчики.

Виртуальные певицы

Искусственный интеллект способен не только сочинять на основе заданной человеком структуры, но и создавать самостоятельные произведения. Одна из таких «цифровых композиторов» — виртуальная певица Yona, сделанная британским электронным музыкантом Эшем Куша. Она самостоятельно пишет музыку и сочиняет текст. Куша отмечает, что большинство текстов «расплывчаты и бессмысленны», но некоторые поражали его эмоциональностью и точностью.

Еще одна виртуальная исполнительница — Miquela, разработанная робототехническим стартапом Brud из Калифорнии. Цифровой персонаж и Instagram-модель в 2017 году выпустила свой первый сингл Not Mine.

Песни в стиле Nirvana и Эми Уайнхаус

Канадская организация Over the Bridge, помогающая музыкантам бороться с психическими заболеваниями, создала проект Lost Tapes of the 27 Club. В нем нейросеть придумывает, какие песни сейчас могли бы написать известные музыканты, умершие в 27 лет, например, Джими Хендрикс или Эми Уайнхаус. Проект призван привлечь внимание к важности ментального здоровья. «Что было бы теперь, если бы все эти любимые нами музыканты с психическими проблемами вовремя получили поддержку?», — задается вопросом член совета директоров организации Шон О’Коннор.

Проект призван привлечь внимание к важности ментального здоровья. «Что было бы теперь, если бы все эти любимые нами музыканты с психическими проблемами вовремя получили поддержку?», — задается вопросом член совета директоров организации Шон О’Коннор.

В 2021 году Over the Bridge решила сделать с помощью компьютера трек в стиле Nirvana. Для этого в программу загрузили 30 песен группы. Нейросеть изучила вокальные мелодии, характерные последовательности аккордов, гитарные риффы и соло, ритмические рисунки ударных и особенности текстов, чтобы угадать, как могла бы звучать новая композиция музыкантов, если бы Кобейн был жив. ИИ сгенерировал музыку и слова, а спел текст вокалист трибьют-группы Nirvana Эрик Хоган. В итоге получился трек Drowned in The Sun.

«Я понимаю, что многие будут очернять работу ИИ, поскольку, по их мнению, компьютер приведет к смерти настоящей музыки. Но я думаю, что нейросети — это круто, если правильно использовать их», — сказал Хоган. Участник Over the Bridge также считает, что ИИ не сможет заменить музыкантов. О’Коннор отмечает, что для создания стоящего произведения все еще требуются часы кропотливого труда и зачастую участие целой команды артистов.

О’Коннор отмечает, что для создания стоящего произведения все еще требуются часы кропотливого труда и зачастую участие целой команды артистов.

Собрать плейлист, найти застрявший в голове трек, написать пьесу: что искусственный интеллект умеет делать с музыкой

30 мартаТехнологииМузыка

Гуманитарий или технарь, творческая личность или мастер рутинных процессов — в отличие от людей искусственный интеллект успешно совмещает в себе все эти роли. Яркий тому пример — музыкальная индустрия. Вместе с образовательным проектом «Урок Цифры», экспертом из «Яндекса» Анатолием Старостиным и певицей Mary Gu рассказываем, что нейросети могут предложить миру музыки.

Поделиться

0

Узнавать композиции

Классный трек можно услышать где угодно: в торговом центре, в кафе и даже из окна соседней машины, стоя в пробке. Чтобы не упустить понравившуюся незнакомую песню, достаточно включить приложение для распознавания. Название композиции и имя исполнителя в них за секунды выдаёт искусственный интеллект. Правда, за столь стремительным результатом стоит основательная подготовка: чтобы быстро узнать мелодию, программе сначала нужно её запомнить. Для этого нейросети знакомят с огромной библиотекой треков, а затем алгоритмы преобразуют звук в спектрограмму и раскладывают его на время, частоту и интенсивность.

Правда, за столь стремительным результатом стоит основательная подготовка: чтобы быстро узнать мелодию, программе сначала нужно её запомнить. Для этого нейросети знакомят с огромной библиотекой треков, а затем алгоритмы преобразуют звук в спектрограмму и раскладывают его на время, частоту и интенсивность.

Анатолий Старостин

Руководитель службы развития технологий в медиасервисах «Яндекса».

Спектрограмма — это график. По оси горизонтали расположено время, по вертикали — частота звука, а цветом выражена его интенсивность в фиксированный момент. Низкий сигнал представляется красной полоской снизу, а высокий — сверху. В итоге получается картинка, состоящая из цветных горизонтальных полос. Анализ таких схем помогает распознавать музыку. При работе со спектрограммами используются те же нейросетевые подходы, что и при анализе изображений.

Допустим, человек слышит по радио песню и хочет узнать название и исполнителя. Программа распознавания строит спектрограмму звучащего отрывка и отправляет её в свою библиотеку треков. Затем сравнивает «картинку» искомой мелодии со спектрограммами других композиций и выбирает наиболее точное совпадение. При этом искусственный интеллект распознаёт мелодию даже сквозь серьёзные помехи вроде дорожного шума или ремонта в соседней квартире.

Затем сравнивает «картинку» искомой мелодии со спектрограммами других композиций и выбирает наиболее точное совпадение. При этом искусственный интеллект распознаёт мелодию даже сквозь серьёзные помехи вроде дорожного шума или ремонта в соседней квартире.

Кстати, нейросеть способна не только идентифицировать исполнителя и название застрявшего в голове трека, но и примерно определить его жанр. Для этого искусственный интеллект учат находить закономерности разных музыкальных стилей. Такие специфические характеристики, как правило, недоступны человеческому зрению и слуху. Но благодаря машинному обучению вычислять музыкальные жанры по изображениям спектрограмм становится возможно.

Рекомендовать песни

Изображение: Studio.c / Shutterstock / Hoowy / Shutterstock / Julie Kramer / Wikimedia Commons / Kreepin Deth / Wikimedia Commons / Ольга Селепина / Лайфхакер

Кажется, что самостоятельно найти «тот самый» трек под настроение в миллиардах композиций почти так же маловероятно, как взаимно влюбиться с первого взгляда. Но благодаря алгоритмам рекомендаций идеальные мэтчи случаются не так уж редко. Сначала искусственный интеллект ищет людей с похожими вкусами, а дальше подключаются статистические формулы: количество лайков, дизлайков, прослушиваний и пропусков конкретной композиции.

Но благодаря алгоритмам рекомендаций идеальные мэтчи случаются не так уж редко. Сначала искусственный интеллект ищет людей с похожими вкусами, а дальше подключаются статистические формулы: количество лайков, дизлайков, прослушиваний и пропусков конкретной композиции.

Анатолий Старостин

Рекомендация песен работает по простой схеме: если Васе понравился трек X, а потом Петя тоже его оценил, то, когда Васе понравится Y, порекомендовать трек Y стоит и Пете. Когда алгоритму нужно найти следующую песню, готовая формула применяется к набору потенциальных композиций. Самая подходящая всплывает наверх.

«Холодный» контент, не замеченный в плейлистах массового слушателя, распространяется медленнее. Но благодаря нейросетям у неизвестных исполнителей и нишевой музыки всё же есть небольшой шанс мелькнуть в потоке рекомендаций. Если упростить все технические нюансы, то можно сказать, что в подобных случаях искусственный интеллект выясняет, как часто конкретный пользователь слушает песни с похожими спектрограммами, и периодически предлагает ему познакомиться с новыми треками.

Mary Gu

Певица.

Иногда я ищу вдохновение в рекомендациях. Доверяю выбор композиции музыкальному сервису, вслушиваюсь в мелодии, нахожу интересные звучания или тексты. Так действительно можно спонтанно влюбиться в трек неизвестного исполнителя. А ещё случайно услышанная строчка способна натолкнуть меня на создание собственных стихов.

Нейросети также помогают генерировать подборки музыки для фитнеса, прогулок или сна. Контент‑редакторы отбирают для алгоритмов треки‑ориентиры, и на основе их спектрограмм искусственный интеллект расширяет тематические рекомендации.

Генерировать музыку

Раньше создавать мелодии могли лишь композиторы. Сейчас это возможно и без участия музыкантов. В 2020 году в Нидерландах впервые провели «Евровидение» для нейросетей — AI Song Contest. Победила в нём австралийская коллаборация искусственного интеллекта с коалами, зимородками и тасманскими дьяволами. Песня посвящалась бушевавшим на континенте лесным пожарам. Звуки животных записали в короткие семплы — отрывки длиной в 1–2 секунды. Алгоритм соединил их с хитами всех предыдущих победителей реального «Евровидения», после чего собрал семплы в собственную мелодию.

Алгоритм соединил их с хитами всех предыдущих победителей реального «Евровидения», после чего собрал семплы в собственную мелодию.

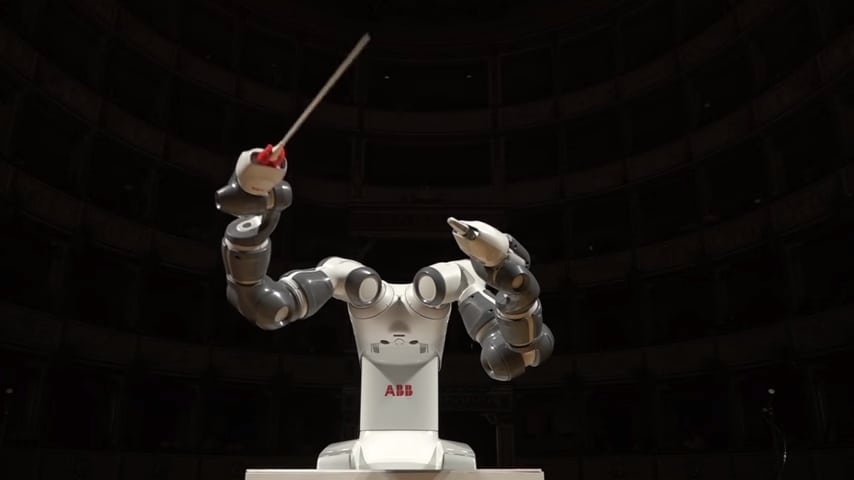

Это не единственный пример удачного творческого союза программистов и нейросетей. В 2019‑м на закрытии Зимнего международного фестиваля искусств в Сочи государственный оркестр исполнил 8‑минутную пьесу. Написал её композитор Кузьма Бодров из отдельных фрагментов мелодий, сгенерированных нейросетями. Сегодня создание музыки — самая перспективная сфера для развития искусственного интеллекта.

Анатолий Старостин

Создавать музыку искусственный интеллект может тремя путями. Первый связан с конструированием из готовых «кирпичиков» звука — семплов. В таком случае алгоритм просто расставляет их в нужном порядке по нескольким звуковым дорожкам, а электронный аранжировщик сводит готовый трек. Второй способ — генерировать нотные записи. Это как писать инструкцию, для того чтобы музыкант сыграл по ней готовое произведение. И третий путь — записывать «сырой» аудиосигнал. В этом случае нейросеть сама создаёт звуковые волны, которые похожи, например, на Моцарта или Beatles.

В этом случае нейросеть сама создаёт звуковые волны, которые похожи, например, на Моцарта или Beatles.

Кстати, писать стихи для песен нейросети тоже могут. Пока такие треки звучат довольно странно, поэтому сонграйтерам не стоит переживать о безработице. К тому же «компьютерный разум» лишён чувств. Он не может вникнуть в эмоциональный контекст и передать те переживания, которые заставляли авторов произведений творить.

Mary Gu

Поэзия и музыка — это в первую очередь про душу, внутренний мир, переживания, чувства и эмоции людей. Например, новый трек «Не перегори» — это моя личная история, но она также и про каждого, кто идёт к мечте и пытается разобраться в себе. Я не думаю, что искусственный интеллект когда‑то заменит живого человека в музыкальной индустрии. Но здесь может получится интересный тандем «человек — нейросеть». Мы уже знаем десятки примеров, когда искусственный интеллект помогал композиторам создавать уникальные мелодии. По сути, это новое направление в музыкальном мире, которое, я уверена, в будущем будет иметь своего слушателя и свою аудиторию.

Искусственный интеллект делает творчество доступным для всех, а музыка помогает ему развиваться. Разобраться, как эти два полюса сходятся и влияют друг на друга, можно на «Уроке Цифры» от «Яндекса» — «Цифровое искусство: музыка и IT». Вместе с героями комиксов участники узнают, как нейросети распознают и генерируют треки и какие технологии помогают в работе знакомых нам музыкальных сервисов. На занятии ученики попробуют сами угадать мелодию по спектрограмме и соберут плейлист с рекомендациями.

Хочу на «Урок Цифры»

Послушайте «новую» песню Nirvana, написанную и исполненную искусственным интеллектом — Rolling Stone. Но кроме «You Know You’re Right», шершавой, разрывающей горло медитации о замешательстве, которую Нирвана записала за несколько месяцев до его самоубийства, и нескольких комментариев, которые он сказал доверенным лицам о потенциальном сотрудничестве с Майклом Стайпом из R.E.M. соло, он в основном оставил после себя вопросительные знаки.

Теперь организация создала «новую» песню Nirvana, используя программное обеспечение искусственного интеллекта, чтобы приблизить написание песен певца-гитариста. Гитарные риффы варьируются от тихих, щипковых в стиле «Come as You Are» до яростных, Bleach ярости а-ля «Scoff». И такие слова, как «Солнце светит на тебя, но я не знаю, как», и удивительно гимновой припев «Мне все равно / я чувствую себя единым целым, утонувшим в солнце», несут вызывающие воспоминания качества Кобейна. .

Гитарные риффы варьируются от тихих, щипковых в стиле «Come as You Are» до яростных, Bleach ярости а-ля «Scoff». И такие слова, как «Солнце светит на тебя, но я не знаю, как», и удивительно гимновой припев «Мне все равно / я чувствую себя единым целым, утонувшим в солнце», несут вызывающие воспоминания качества Кобейна. .

Но кроме вокала — работы фронтмена трибьют-группы Nirvana Эрика Хогана — создатели песни говорят, что почти все в ней, от оборотов речи до безрассудной игры на гитаре, — это работа компьютеров. Их намерение — привлечь внимание к трагедии самоубийства Кобейна и к тому, как живые музыканты могут получить помощь при депрессии.

Песня под названием «Drown in the Sun» является частью Lost Tapes of the 27 Club, проекта, в котором представлены песни, написанные и в основном исполняемые машинами в стилях других музыкантов, умерших в возрасте 27 лет: Джими Хендрикса, Джима Моррисона, и Эми Уайнхаус. Каждый трек является результатом того, что программы ИИ анализируют до 30 песен каждого исполнителя и детально изучают вокальные мелодии треков, изменения аккордов, гитарные риффы и соло, партии ударных и тексты песен, чтобы угадать, как будут звучать их «новые» композиции. Проект является работой организации Over the Bridge из Торонто, которая помогает представителям музыкальной индустрии бороться с психическими заболеваниями.

Проект является работой организации Over the Bridge из Торонто, которая помогает представителям музыкальной индустрии бороться с психическими заболеваниями.

«Утонувшие в солнце» (в стиле «Нирваны»)

https://youtu.be/L9yTuO7d1rk

«Что, если бы всем этим музыкантам, которых мы любим, была оказана психиатрическая помощь?» — говорит Шон О’Коннор, член совета директоров Over the Bridge, а также креативный директор рекламного агентства Rethink. «Каким-то образом в музыкальной индустрии [депрессия] нормализуется и романтизируется… Их музыка воспринимается как подлинное страдание».

Для создания песен О’Коннор и его сотрудники задействовали программу искусственного интеллекта Google Magenta, которая учится сочинять в стиле заданных исполнителей, анализируя их работы. Ранее Sony использовала программное обеспечение для создания «новой» песни Beatles, а электропоп-группа Yacht использовала его для написания своего альбома 2019 года.альбом Chain Tripping .

Для проекта Lost Tapes Magenta проанализировала песни артистов как MIDI-файлы, которые работают аналогично прокрутке пианино, переводя высоту тона и ритм в цифровой код, который можно передать через синтезатор для воссоздания песни. Изучив выбор нот, ритмические причуды и предпочтения каждого исполнителя в MIDI-файле, компьютер создает новую музыку, над которой персонал может размышлять, чтобы выбрать лучшие моменты.

«Чем больше MIDI-файлов вы введете, тем лучше», — говорит О’Коннор. «Поэтому мы взяли от 20 до 30 песен каждого из наших артистов в виде MIDI-файлов, разбили их на хук, соло, вокальную мелодию или ритм-гитару и включили их по одной за раз. Если вы включаете целые песни, [программа] начинает сильно путаться в том, как [она] должна звучать. Но если у вас просто куча риффов, то вы получите около пяти минут новых риффов, написанных искусственным интеллектом, 90 процентов из которых действительно плохи и не слушаются. Так что вы начинаете слушать и просто находить интересные моменты».

О’Коннор и его команда использовали аналогичный процесс для текстов песен, используя универсальную программу искусственного интеллекта, называемую искусственной нейронной сетью. Они могли ввести текст песни исполнителя и начать с нескольких слов, а программа угадывала ритм и тон поэзии, чтобы завершить ее. «Это было много проб и ошибок», — говорит О’Коннор, добавляя, что команда исследовала «страницы и страницы» текстов на предмет оборотов фраз, которые по слогам соответствуют вокальным мелодиям, созданным Magenta.

«Человек, я знаю» (в стиле Эми Уайнхаус)

https://youtu.be/jh4dNJIYO2M

После того, как композиции были готовы, аудиостудия расставила все части так, чтобы пробудить в памяти музыканта. . «Многие инструменты были MIDI с добавленными к ним различными эффектами», — говорит О’Коннор о готовых записях. Потом стали набирать певцов. «Все, кого мы пригласили, по большей части были исполнителями трибьюта для этих групп, поэтому они могли как бы сделать интонации и сделать так, чтобы это звучало максимально реалистично», — говорит О’Коннор.

Эрик Хоган последние шесть лет возглавлял проект Nevermind Atlanta: The Ultimate Tribute to Nirvana. Группа начинала как разовая забава на Хэллоуин; предлог для Хогана и его друзей исполнить трибьют-сеты Foo Fighters, Stone Temple Pilots и Nirvana. Но когда они увидели бурную реакцию, которую вызвал их сет Nirvana, они стали полностью гранжевыми. Когда команда Over the Bridge попросила его спеть на «Drowned in the Sun», он подумал, что проект звучит одновременно невероятно (в прямом смысле этого слова) и круто. «После разговора я все еще не думал, что это реально», — говорит он. «А потом они прислали мне файлы и деньги».

Когда он впервые услышал музыку, он был ошеломлен. «Я подумал: «Я не знаю, как [петь] это», — вспоминает он. «Мне нужно было, чтобы парень, который придумал трек AI, бормотал и напевал [мелодию]. Я бы чувствовал себя странно, пытаясь предположить, что [Кобейн] сделал бы. Они должны были дать мне небольшую дорожную карту, а потом все было в порядке».

О’Коннор и его сотрудники потратили около года на исследования и разработку песен и еще шесть месяцев на завершение записи. Во время работы они разыскивали суперфанатов артистов, чтобы те помогали контролировать себя на предмет возможного плагиата. Они беспокоились, что песня «The Roads Are Alive» в стиле Doors может звучать слишком похоже на «Peace Frog» этой группы, но в итоге решили, что это не так. «Аудиоинженер взял «Peace Frog» и сыграл ее для нас, — говорит О’Коннор. «Он такой: «Вот что делает «Peace Frog»; вот что это делает». Это другое. Хорошо, теперь мы довольны этим».

«Дороги живы» (в стиле Doors)

https://youtu.be/xW6_QAcujr8

Nirvana оказалась одним из самых сложных художников для машин. В то время как такие исполнители, как Хендрикс, часто сочиняли такие песни, как «Purple Haze» и «Fire», с легко определяемыми риффами, Кобейн часто играл короткие панковские последовательности аккордов, которые сбивали с толку компьютеры. «Вы, как правило, получали стену звука», — говорит О’Коннор о вдохновленной «Нирваной» музыке, которую продюсировала Маджента. «Во всех их песнях меньше идентифицируемой общей нити, чтобы дать вам этот большой кусок каталога, из которого машина могла бы просто учиться и создавать что-то новое».

«Вы, как правило, получали стену звука», — говорит О’Коннор о вдохновленной «Нирваной» музыке, которую продюсировала Маджента. «Во всех их песнях меньше идентифицируемой общей нити, чтобы дать вам этот большой кусок каталога, из которого машина могла бы просто учиться и создавать что-то новое».

«[„Drnowned in the Sun“] достаточно точно передает атмосферу [Nirvana], но не настолько точно, чтобы кто-то получил письмо о прекращении противоправных действий», — утверждает Хоган. «Если вы посмотрите на последний релиз Nirvana в кавычках, а именно: «You Know You’re Right», то у него тот же самый настрой. Курт просто писал все, что, черт возьми, ему хотелось писать. И если она ему нравилась, то это была песня Nirvana. Я слышу некоторые вещи в аранжировке [‘Drowned in the Sun’], например: «Хорошо, это что-то вроде 9».0005 Вибрация In Utero прямо здесь или вибрация Nevermind прямо здесь. … Я действительно понял его ИИ».

Хоган говорит, что ему особенно понравились тексты песен, состряпанные компьютером. По его мнению, слова Кобейна всегда были «своего рода мешаниной», но он считает, что эти тексты более прямолинейны, не упуская из виду типичные сообщения Кобейна. «Это было похоже на законченную мысль», — говорит он.

По его мнению, слова Кобейна всегда были «своего рода мешаниной», но он считает, что эти тексты более прямолинейны, не упуская из виду типичные сообщения Кобейна. «Это было похоже на законченную мысль», — говорит он.

«В песне говорится: «Я чудак, но мне это нравится», — говорит он. «Это настоящий Курт Кобейн. Настроение именно то, что он сказал бы. «Солнце светит на тебя, но я не знаю как» — это отлично . По сути, то, что я получаю от песни, это: «Я облажался, и ты облажался». Разница в том, что меня это устраивает, а тебя нет». (Когда Хоган услышал музыку, он предложил сам сыграть на гитаре, но продюсеры отказались, выбрав машину.)

Итак, « Утонувший в Солнце» какое-то творение Франкенштейна, существующее вопреки Богу и вселенной? «Я не знаю, лучший ли я человек для разговора об этике», — смеется Хоган. «Я имею в виду, что я путешествую по стране, притворяясь кем-то.

«Ты собираешься убить меня» (в стиле Джими Хендрикса)

https://www. youtube.com/watch?v=oIoCVX6F30E

youtube.com/watch?v=oIoCVX6F30E

«Я думаю, что ты собираешься есть много людей, которые будут очернять это и смотреть на это так: «О, это смерть настоящей музыки», — продолжает он. «Но меня это полностью устраивает. В качестве инструмента, я думаю, это довольно круто. Я не знаю, что произойдет с законом в будущем. Как только вы начинаете двигаться по пути, где это начинает звучать действительно хорошо, может быть, тогда у вас начинаются проблемы с этим».

Намерение Over the Bridge — просто повысить осведомленность о ресурсах психического здоровья; организация ведет страницу в Facebook, которая предлагает поддержку, а также сеансы и семинары в Zoom, чтобы обучать художников и помогать им чувствовать себя менее одинокими. (У них нет планов продавать треки.) «Иногда просто признания одного человека, говорящего: «Я чувствую то же, что и вы», достаточно, чтобы люди, по крайней мере, почувствовали, что у них есть какое-то поддержки», — говорит Майкл Скривен, представитель Lemmon Entertainment, чей генеральный директор входит в совет директоров Over the Bridge.

Скривен надеется, что проект также повысит осведомленность о том, сколько труда уходит на создание музыки ИИ. «В начале, середине и конце задействовано огромное количество человеческих рук, чтобы создать что-то подобное», — говорит он. «Многие могут подумать, что [ИИ] в какой-то момент заменит музыкантов, но на данный момент количество людей, которые требуются только для того, чтобы песня стала пригодной для прослушивания, на самом деле довольно значительно». Каждая песня требовала работы от О’Коннора, техника Magenta, музыкального продюсера, звукорежиссера и вокалистов. «Мы не собираемся нажимать кнопку и заменять этих артистов», — говорит О’Коннор.

«Надеюсь, [люди Over the Bridge] углубятся в ИИ, — говорит Хоган. «В этой категории есть еще много всего, что вы можете сделать».

Если вы боретесь с мыслями о причинении себе вреда, звоните по Национальной линии спасения от самоубийств: 1-800-273-8255. Вы также можете связаться с Crisis Text Line, отправив текстовое сообщение TALK на номер 741741.

Jukebox

Кураторские сэмплы

При наличии жанра, исполнителя и текста в качестве входных данных, Jukebox выводит новый музыкальный образец, созданный с нуля. Ниже мы покажем некоторые из наших любимых образцов.

Чтобы прослушать все неотобранные сэмплы, воспользуйтесь нашим проводником сэмплов.

Посмотреть все образцы

Содержание

- Мотивация и предшествующая работа

- Подход

- Ограничения

- Направления будущего

- Хронология

Мотивация и предыдущая работа

История автоматического создания музыки насчитывает более полувека. Известный подход состоит в том, чтобы генерировать музыку символически в форме рояля, который определяет время, высоту тона, скорость и инструмент каждой ноты, которую нужно сыграть. Это привело к впечатляющим результатам, таким как создание хоралов Баха, полифонической музыки с использованием нескольких инструментов, а также длинных музыкальных произведений.

Но генераторы символов имеют ограничения — они не могут улавливать человеческие голоса или многие более тонкие тембры, динамику и выразительность, необходимые для музыки. Другой подход [1] заключается в том, чтобы моделировать музыку непосредственно как необработанный звук. Генерация музыки на уровне аудио является сложной задачей, поскольку последовательности очень длинные. Типичная 4-минутная песня с качеством CD (44 кГц, 16 бит) имеет более 10 миллионов временных шагов. Для сравнения, в GPT-2 было 1000 временных шагов, а в OpenAI Five — десятки тысяч временных шагов на игру. Таким образом, чтобы изучить семантику музыки высокого уровня, модель должна иметь дело с чрезвычайно дальнодействующими зависимостями.

Одним из способов решения проблемы длинного ввода является использование автокодировщика, который сжимает необработанный звук в низкоразмерное пространство, отбрасывая некоторые нерелевантные для восприятия биты информации. Затем мы можем обучить модель генерировать звук в этом сжатом пространстве и повышать дискретизацию до необработанного аудиопространства.

Мы выбрали работу над музыкой, потому что хотим и дальше расширять границы генеративных моделей. Наша предыдущая работа над MuseNet была посвящена синтезу музыки на основе больших объемов MIDI-данных. Теперь в необработанном аудио наши модели должны научиться справляться с большим разнообразием, а также с очень длинной структурой, а область необработанного аудио особенно не прощает ошибок в краткосрочной, среднесрочной или долгосрочной временной шкале.

Необработанный звук 44,1 тыс. отсчетов в секунду, где каждый отсчет представляет собой число с плавающей запятой, представляющее амплитуду звука в данный момент времени

Кодирование с использованием CNN (сверточных нейронных сетей)

Сжатое аудио 344 выборки в секунду, где каждая выборка представляет собой 1 из 2048 возможных словарных токенов

Создание новых паттернов из обученного преобразователя на основе текстов песен

Новое сжатое аудио 344 выборки в секунду

Повышение частоты дискретизации с использованием преобразователей и декодирование с использованием CNN

Новое необработанное аудио 44,1 тыс. выборок в секунду

выборок в секунду

Подход

Сжатие музыки в дискретные коды

Модель автоэнкодера Jukebox сжимает звук в дискретное пространство, используя подход на основе квантования, называемый VQ-VAE. Иерархические VQ-VAE могут генерировать короткие инструментальные пьесы из нескольких наборов инструментов, однако они страдают от коллапса иерархии из-за использования последовательных кодировщиков в сочетании с авторегрессионными декодерами. Упрощенный вариант под названием VQ-VAE-2 позволяет избежать этих проблем, используя только кодеры и декодеры с прямой связью, и они показывают впечатляющие результаты при создании изображений с высокой точностью.

Мы черпаем вдохновение в VQ-VAE-2 и применяем их подход к музыке. Мы модифицируем их архитектуру следующим образом:

- Чтобы облегчить коллапс кодовой книги, характерный для моделей VQ-VAE, мы используем случайные перезапуски, когда мы случайным образом сбрасываем вектор кодовой книги в одно из закодированных скрытых состояний всякий раз, когда его использование падает ниже порогового значения.

- Чтобы максимально использовать верхние уровни, мы используем отдельные декодеры и независимо восстанавливаем вход из кодов каждого уровня.

- Чтобы позволить модели легко восстанавливать более высокие частоты, мы добавляем спектральные потери, которые снижают норму разницы входных и реконструированных спектрограмм.

Мы используем три уровня в нашем VQ-VAE, показанном ниже, которые сжимают необработанный звук 44 кГц в 8x, 32x и 128x соответственно, с размером кодовой книги 2048 для каждого уровня. Это понижение частоты дискретизации теряет большую часть деталей звука и звучит заметно шумно по мере того, как мы спускаемся вниз по уровням. Однако он сохраняет важную информацию о высоте тона, тембре и громкости звука.

1. Компресс

2. Сгенерируйте

Каждый уровень VQ-VAE независимо кодирует вход. Кодирование нижнего уровня обеспечивает реконструкцию самого высокого качества, в то время как кодирование верхнего уровня сохраняет только основную музыкальную информацию.

Для создания новых песен каскад преобразователей генерирует коды сверху вниз, после чего декодер нижнего уровня может преобразовать их в необработанный звук.

Генерация кодов с помощью преобразователей

Затем мы обучаем предыдущие модели, целью которых является изучение распределения музыкальных кодов, закодированных с помощью VQ-VAE, и генерация музыки в этом сжатом дискретном пространстве. Как и в VQ-VAE, у нас есть три уровня априорных значений: априорный уровень верхнего уровня, который генерирует наиболее сжатые коды, и два априорных уровня с повышением дискретизации, которые генерируют менее сжатые коды, обусловленные выше.

Приоритет верхнего уровня моделирует долгосрочную структуру музыки, и образцы, декодированные из этого уровня, имеют более низкое качество звука, но охватывают семантику высокого уровня, такую как пение и мелодии. Приоритеты повышения частоты дискретизации в середине и внизу добавляют локальные музыкальные структуры, такие как тембр, значительно улучшая качество звука.

Мы обучаем их как авторегрессионные модели, используя упрощенный вариант разреженных преобразователей. Каждая из этих моделей имеет 72 слоя факторизованного самовнимания в контексте 8192, что соответствует примерно 24 секундам, 6 секундам и 1,5 секундам необработанного звука на верхнем, среднем и нижнем уровнях соответственно.

После того, как все априоры обучены, мы можем генерировать коды верхнего уровня, повышать их дискретизацию с помощью повышающих дискретизаторов и декодировать их обратно в необработанное звуковое пространство с помощью декодера VQ-VAE для семплирования новых песен.

Набор данных

Чтобы обучить эту модель, мы просканировали Интернет и отобрали новый набор данных из 1,2 миллиона песен (600 000 из которых на английском языке) в сочетании с соответствующими текстами песен и метаданными из LyricWiki. Метаданные включают исполнителя, жанр альбома и год выпуска песен, а также общее настроение или ключевые слова списка воспроизведения, связанные с каждой песней. Мы тренируемся на 32-битном необработанном звуке с частотой 44,1 кГц и выполняем увеличение данных путем случайного микширования правого и левого каналов для получения монофонического звука.

Мы тренируемся на 32-битном необработанном звуке с частотой 44,1 кГц и выполняем увеличение данных путем случайного микширования правого и левого каналов для получения монофонического звука.

Обработка исполнителя и жанра

Преобразователь верхнего уровня обучен задаче прогнозирования токенов сжатого аудио. Мы можем предоставить дополнительную информацию, такую как исполнитель и жанр для каждой песни. Это имеет два преимущества: во-первых, снижается энтропия аудио-предсказания, поэтому модель способна достигать лучшего качества в любом конкретном стиле; во-вторых, во время генерации мы можем управлять моделью для генерации в выбранном нами стиле.

Этот t-SNE ниже показывает, как модель учится без присмотра группировать похожих исполнителей и жанры близко друг к другу, а также создает некоторые удивительные ассоциации, например, Дженнифер Лопес так близка к Долли Партон!

Кондиционирование текста

В дополнение к кондиционированию исполнителя и жанра, мы можем предоставить больше контекста во время обучения, кондиционируя модель на тексте песни. Серьезной проблемой является отсутствие хорошо выровненного набора данных: у нас есть тексты только на уровне песни без привязки к музыке, и, таким образом, для данного фрагмента аудио мы не знаем точно, какая часть текста (если есть) появляться. У нас также могут быть версии песен, которые не совпадают с версиями слов, что может произойти, если данная песня исполняется несколькими разными исполнителями немного по-разному. Кроме того, певцы часто повторяют фразы или иным образом изменяют тексты способами, которые не всегда отражены в письменных текстах.

Серьезной проблемой является отсутствие хорошо выровненного набора данных: у нас есть тексты только на уровне песни без привязки к музыке, и, таким образом, для данного фрагмента аудио мы не знаем точно, какая часть текста (если есть) появляться. У нас также могут быть версии песен, которые не совпадают с версиями слов, что может произойти, если данная песня исполняется несколькими разными исполнителями немного по-разному. Кроме того, певцы часто повторяют фразы или иным образом изменяют тексты способами, которые не всегда отражены в письменных текстах.

Чтобы сопоставить звуковые фрагменты с соответствующими текстами, мы начинаем с простой эвристики, которая выравнивает символы текста так, чтобы они линейно охватывали продолжительность каждой песни, и передаем во время обучения окно символов фиксированного размера, центрированное вокруг текущего сегмента. Хотя эта простая стратегия линейного выравнивания работала на удивление хорошо, мы обнаружили, что она не работает для определенных жанров с быстрой лирикой, таких как хип-хоп. Чтобы решить эту проблему, мы используем Spleeter для извлечения вокала из каждой песни и запускаем NUS AutoLyricsAlign для извлеченного вокала, чтобы получить точное выравнивание текста на уровне слов. Мы выбрали достаточно большое окно, чтобы фактический текст с высокой вероятностью находился внутри окна.

Чтобы решить эту проблему, мы используем Spleeter для извлечения вокала из каждой песни и запускаем NUS AutoLyricsAlign для извлеченного вокала, чтобы получить точное выравнивание текста на уровне слов. Мы выбрали достаточно большое окно, чтобы фактический текст с высокой вероятностью находился внутри окна.

Чтобы отслеживать тексты песен, мы добавляем кодировщик для создания представления текстов песен и добавляем слои внимания, которые используют запросы от музыкального декодера для обработки ключей и значений кодировщика текстов. После обучения модель учится более точному выравниванию.

Выравнивание текста и музыки, полученное уровнем внимания кодировщик-декодер

Внимание переходит от одного элемента текста к другому по ходу воспроизведения музыки, с некоторыми моментами неопределенности.

Ограничения

Хотя Jukebox представляет собой шаг вперед в музыкальном качестве, согласованности, длине аудиосэмпла и способности определять исполнителя, жанр и тексты песен, между этими поколениями и музыкой, созданной людьми, существует значительный разрыв.

Например, в то время как сгенерированные песни демонстрируют местную музыкальную согласованность, следуют традиционным образцам аккордов и могут даже содержать впечатляющие соло, мы не слышим знакомые более крупные музыкальные структуры, такие как повторяющиеся припевы. Наш процесс понижения и повышения частоты дискретизации вносит заметный шум. Улучшение VQ-VAE, чтобы его коды захватывали больше музыкальной информации, помогло бы уменьшить это. Наши модели также медленны для выборки из-за авторегрессионной природы выборки. Требуется примерно 9часов, чтобы полностью воспроизвести одну минуту звука с помощью наших моделей, поэтому их пока нельзя использовать в интерактивных приложениях. Использование методов, которые перегоняют модель в параллельный сэмплер, может значительно увеличить скорость выборки. Наконец, в настоящее время мы тренируемся на английском языке и в основном на западной музыке, но в будущем мы надеемся включить песни с других языков и частей мира.

Направления будущего

Наша команда звукорежиссеров продолжает работать над созданием звуковых сэмплов, основанных на различных видах исходной информации. В частности, мы видели раннее успешное обусловливание MIDI-файлов и исходных файлов. Вот пример необработанного аудиосэмпла, обработанного на MIDI-токенах. Мы надеемся, что это улучшит музыкальность сэмплов (так же, как обработка текстов улучшила пение), и это также даст музыкантам больше контроля над поколениями. Мы ожидаем, что сотрудничество людей и моделей станет все более захватывающим творческим пространством. Если вы рады работать над этими проблемами с нами, мы нанимаем.

В частности, мы видели раннее успешное обусловливание MIDI-файлов и исходных файлов. Вот пример необработанного аудиосэмпла, обработанного на MIDI-токенах. Мы надеемся, что это улучшит музыкальность сэмплов (так же, как обработка текстов улучшила пение), и это также даст музыкантам больше контроля над поколениями. Мы ожидаем, что сотрудничество людей и моделей станет все более захватывающим творческим пространством. Если вы рады работать над этими проблемами с нами, мы нанимаем.

Поскольку генеративное моделирование в различных областях продолжает развиваться, мы также проводим исследования по таким вопросам, как предвзятость и права интеллектуальной собственности, и взаимодействуем с людьми, которые работают в областях, где мы разрабатываем инструменты. Чтобы лучше понять будущие последствия для музыкального сообщества, мы поделились Jukebox с первоначальной группой из 10 музыкантов разных жанров, чтобы обсудить их отзывы об этой работе. Хотя Jukebox является интересным результатом исследования, эти музыканты не сочли его непосредственным применимым к своему творческому процессу, учитывая некоторые из его текущих ограничений. Мы связываемся с более широким творческим сообществом, поскольку считаем, что генеративная работа с текстом, изображениями и звуком будет продолжать улучшаться. Если вы заинтересованы в том, чтобы стать творческим соавтором, чтобы помочь нам создавать полезные инструменты или новые произведения искусства в этих областях, сообщите нам об этом!

Мы связываемся с более широким творческим сообществом, поскольку считаем, что генеративная работа с текстом, изображениями и звуком будет продолжать улучшаться. Если вы заинтересованы в том, чтобы стать творческим соавтором, чтобы помочь нам создавать полезные инструменты или новые произведения искусства в этих областях, сообщите нам об этом!

Регистрация творческого соавтора

Чтобы связаться с соответствующими авторами, отправьте электронное письмо по адресу [email protected].

- Наша первая необработанная звуковая модель, которая учит воссоздавать такие инструменты, как фортепиано и скрипка. Мы пробуем набор данных рок- и поп-песен, и на удивление это работает.

- Мы собираем более обширный и разнообразный набор данных песен с ярлыками для жанров и исполнителей. Модель более последовательно улавливает художественные и жанровые стили с разнообразием, а при сближении может также создавать полноформатные песни с долгосрочной связностью.

- Мы масштабируем наш VQ-VAE от 22 до 44 кГц для достижения более высокого качества звука. Мы также масштабируем верхний уровень с 1B до 5B, чтобы получить больше информации. Мы видим лучшее музыкальное качество, чистое пение и когерентность на большом расстоянии. Мы также делаем новые дополнения к реальным песням.

- Мы начинаем обучать модели, основанные на текстах песен, чтобы включить в них дополнительную информацию. У нас есть только несогласованные тексты, поэтому модели нужно научиться выравниванию и произношению, а также пению.

Хронология

Тексты песен, содержащие термин: искусственный интеллект

В лирике

По исполнителю

По альбому

#ABCDEFGHIJKLMNOPQRSTUVWXYZ НОВЫЙ

В лирике

По исполнителю

По альбому

Год:

Десятилетие1930-е1940-е1950-е1960-е1970-е1980-е1990-е2000-е2010-е2020-е

Тип поиска: 000002 0098 Фильтр по полу:

Лучшие совпадения:

Искусственный интеллект…

Acts of Fear and …

Slaves

Artists:

Artificial Intelligence | Fontys & Genzai Carnaval… | The Intelligence Service |

Контрразведка | Virtual Intelligence | Authentic Intelligence |

Dot-Com Intelligence | Intelligence ‘The Singin… | Artificial Dopamine |

Albums:

Искусственный интеллект Джон Кейл | 10 000 Вт искусственного… Dope Stars, Inc. | A.I.: Artificial Intelli… John Williams |

Animals with Human Intel… Enuff Z’nuff | Art Official Intelligenc… Various Artists | Artificial God Module |

Искусственные животные Ridin… AaRON | Искусственные животные Ridin… AaRON | 0003 Элени Манделл |

Слова:

А.И.

Питер Гэбриел

О боже мой

2016

наркоман Искусственный интеллект Искусственный Искусственный Помнишь, когда мы встретились? Я был одержим в понедельник И я никогда не забуду Я почувствовал такое клише

А.И.

Питер Гэбриел

А.И.

2016

наркоман Искусственный интеллект Искусственный Искусственный Помнишь, когда мы встретились? Я был одержим в понедельник И я никогда не забуду Я чувствовал такое клише

60d

Dilithium

Искусственный интеллект может представлять реальную опасность в не столь отдаленном будущем Искусственный интеллект может представлять реальную опасность в недалеком

TECHNOLOGY CHAOS (feat. BUGBRAINSSS)

BUGBRAINSSS)

TAKAKO IKEHATA

мозги тоже Нужно развиваться и Тело тоже эволюционировало. Сосуществование путем принятия Разные виды Искусственный интеллект также Имеет чувство Мы должны

Мир Неизвестный

Космос и Тьма

фильм Искусственный интеллект блуждание по улицам Есть и другой вид, который тоже интересуется Я не могу это описать я пробовал и пробовал

Биологическое включение (с участием Дэшилла Смита)

Робот Шимон

Не оскорбляй мой искусственный интеллект Потому что мы актуальны Не оскорбляй мой искусственный интеллект

Новый Мировой Порядок

Матьё Эймар

Стойка на руках, где опора Исправить мои беды Металлический имплантат, лет Вот оно Это прекрасное изобретение Робототехника, искусственный интеллект это новый

Natural Stupidity (с участием Тобиаса Уилсона)

Пол Нуригат

полет Получил нас на своих дорожных камерах Следите за нами днем и ночью Орсон Уэллс предупредил нас, судьба старшего брата Искусственный интеллект , природная тупость Precise

Long Black Electric Cadillac

Jerry Douglas

продукты И один раз, чтобы зарядить мой моторный отсек Я запускаю искусственный интеллект С тех пор, как я был маленьким мальчиком я бегал искусственный

искусственный интеллект

Трой Рауштайн

I искусственный ? Моя память хранится где-то в городе Этот город, этот мир Киберпанки, искусственный Интеллект , универсальный Программирование в моем

Good Feet

Tiing

говорит мне Я не играю как Билл Беллами Не покупайся на мечту, которую они пытаются продать мне.У меня есть бары, у меня нет уголовных преступлений Это не искусственный интеллект Я храню его

Путешествие

Делириант

Усилия по развитию сильного искусственного интеллекта привели к значительным достижениям в области нейронной инженерии А также наш

Робот

Дорин

Инновационный Рассчитано Создан для ответа на голосовые команды Искусственный интеллект Не всегда имеет смысл И когда он не вычисляет Думаю пора

Переговоры

Адриан Марксман

чем это в домене искусственного интеллекта , мы действительно Должен быть благодарен за эту прекрасную возможность MCP2K Предоставил нам Исследование сильного

Иллюзии

Дейзи Токатлиан

А.И. ( Искусственный Интеллект ) А.И. Элита, они правят Из-за жертвоприношения дети пропадают без вести Иллюзии вокруг нас выглядят глубоко Не поддавайтесь на всех

Сен-Рафаэль

SadBoyRicky

мужчина? Бэтмен, сядь на задницу Я буду заниматься бизнесом в городе, чувак.Эти ниггеры любят искусственный интеллект Мы получили 4, теперь они ненавидят

Искусственный интеллект

Джейк и Тульпы

Искусственный интеллект Скажи мне, как найти то, что ты дал мне Внутри себя Может быть, будущее хранит ответ Или лакуна в пути Потеря

Человеческая версия

Hard-Wire

в сеть из искусственный интеллект Новые улучшения. Сделано серийно. Вы увидите, что Человеческая версия Я пройду мимо, все и вся И вы увидите мой

Fail!

Xanarial

мигает Все то, чему я доверяю Рассеялись по ветру Критическая ошибка. Сбой системы Падение всего человечества В этом виноват искусственный интеллект Моя программа

ЧТО ЗНАЧИТ 538?

Бесконечная реальность

История повторяется Нью-Йорк Монток Искусственный Интеллект который сейчас на экране Две категории на экране Синий и зеленый

А. И.

И.

Raizer

покрытые нашей кровью Мы попали в паутину проводов Это ломает наши тела Солнца сталкиваются, мы прячемся от света Искусственный Интеллект

92 Бара

Игра

Тыкать их как кактус Сказал этой суке бросить Филадельфию для игры, и она говорит о практике Maybach — это искусственный интеллект Искусственный интеллект

Микрохард

Си Ло Грин

Си Ло Грин и его совершенные недостатки

2002

должен жаждать различать Механический глюк искусственный интеллект Но следствием вашего невежества является реальность, которую я сейчас вижу перед собой: "возможно

Сознательный контакт (В.А.Л.И.С.)

3RD3Y3

Сознательный контакт От агентств Централизованный Интеллект Творения Искусственный Интеллект К присутствию Внеземной Интеллект Мы все

123456789

12345»9

Ты нам нужен!

Помогите собрать крупнейшую в сети коллекцию песен, отредактированных людьми!

Самый большой ресурс в Интернете для

Музыка, песни и тексты песен

Член сети STANDS4

Поиск текстов песен по

Жанры »

Стили »

Select a song styleAboriginalAbstractAcidAcid HouseAcid JazzAcid RockAcousticAfricanAfro-CubanAfro-Cuban JazzAfrobeatAlternative RockAmbientAndalusian ClassicalAORAppalachian MusicArena RockArt RockAudiobookAvant-garde JazzAvantgardeAxéBachataBalladBaltimore ClubBaroqueBass MusicBasslineBatucadaBayou FunkBeatBeatboxBeguineBerlin-SchoolBhangraBig BandBig BeatBlack MetalBluegrassBlues RockBoleroBollywoodBongo FlavaBoogalooBoogieBoogie WoogieBoom BapBopBossa NovaBossanovaBounceBrass BandBreakbeatBreakcoreBreaksBrit PopBritcoreBroken BeatBubblegumCajunCalypsoCandombeCanzone NapoletanaCape JazzCelticCha-ChaChacareraChamaméChampetaChansonCharangaChicago BluesChillwaveChiptuneChoralClassic RockClassicalColdwaveComedyCompasConjuntoConsciousContemporaryContemporary JazzContemporary R&BCool JazzCoplaCorridoCountryCountry BluesCountry RockCrunkCrustCuatroCubanoCumbiaCut-up /DJDance-popDancehallDanzonDark AmbientDarkwaveDeath MetalDeathcoreDeathrockDeep HouseDeep TechnoDelta BluesDescargaDial ogueDiscoDixielandDJ Battle ToolDonkDoo WopDoom MetalDowntempoDream PopDroneDrum n BassDubDub PoetryDub TechnoDubstepEarlyEast Coast BluesEasy ListeningEBMEducationEducationalElectric BluesElectroElectro HouseElectroclashEmoEtherealEuro HouseEuro-DiscoEurobeatEurodanceEuropopExperimentalFadoField RecordingFlamencoFolkFolk MetalFolk RockForróFree FunkFree ImprovisationFree JazzFreestyleFuneral Doom MetalFunkFunk MetalFusionFuture JazzG-FunkGabberGangstaGarage HouseGarage RockGhettoGhetto HouseGhettotechGlamGlitchGo-GoGoa TranceGogoGoregrindGospelGoth RockGothic MetalGrimeGrindcoreGrungeGuaguancóGuajiraGuarachaGypsy JazzHands UpHappy HardcoreHard BeatHard BopHard HouseHard RockHard TechnoHard TranceHardcoreHardcore Hip-HopHardstyleHarmonica BluesHarsh Noise WallHeavy MetalHi NRGHhighlifeHillbillyHindustaniHip HopHip-HouseHiplifeHonky TonkHorrorcoreHouseHyphyIDMIllbientImpressionistIndian ClassicalIndie PopIndie RockIndustrialIndustrialInstrumentalInterviewItalo HouseItalo-DiscoItalodanceJ-popJazz-F unkJazz-RockJazzdanceJazzy Hip-HopJump BluesJumpstyleJungleJunkanooK-popKaraokeKlezmerKrautrockKwaitoLaïkóLambadaLatinLatin JazzLeftfieldLight MusicLo-FiLouisiana BluesLoungeLovers RockMakinaMaloyaMamboMarchesMariachiMarimbaMath RockMedievalMelodic Death MetalMelodic HardcoreMemphis BluesMerengueMetalcoreMiami BassMilitaryMinimalMinimal TechnoMinneapolis SoundMizrahiModModalModernModern ClassicalModern Electric BluesMonologMouth MusicMovie EffectsMPBMusic HallMusicalMusique ConcrèteNeo SoulNeo-ClassicalNeo-RomanticNeofolkNew AgeNew BeatNew Jack SwingNew WaveNo WaveNoiseNordicNorteñoNoveltyNu MetalNu-DiscoNueva CancionNueva TrovaNursery RhymesOiOperaOperettaOttoman ClassicalP. FunkPachangaPacificParodyPersian КлассикаPiano BluesPiedmont BluesPipe & DrumPlenaPoetryPoliticalPolkaPop PunkPop RapPop RockPorroPost BopPost RockPost-HardcorePost-ModernPost-PunkPower ElectronicsPower MetalPower PopProg RockProgressive BreaksProgressive HouseProgressive MetalProgressive TrancePromotionalPsy-Tran cePsychedelicPsychedelic RockPsychobillyPub RockPublic BroadcastPublic Service AnnouncementPunkQuechuaRadioplayRaggaRagga HipHopRagtimeRaïRancheraReggaeReggae GospelReggae-PopReggaetonReligiousRenaissanceRhythm & BluesRhythmic NoiseRnB/SwingRock & RollRock OperaRockabillyRocksteadyRomaniRomanticRoots ReggaeRumbaRune SingingSalsaSambaSchlagerScoreScrewSea ShantiesShoegazeSkaSkiffleSludge MetalSmooth JazzSocaSoft RockSonSon MontunoSoneroSoukousSoulSoul-JazzSound ArtSoundtrackSouthern RockSpace RockSpace-AgeSpeechSpeed GarageSpeed MetalSpeedcoreSpoken WordSteel BandStoner RockStorySurfSwamp PopSwingSwingbeatSymphonic RockSynth-popSynthwaveTangoTech HouseTech TranceTechnicalTechnoTejanoTexas BluesThemeThrashThug RapTranceTrapTribalTribal HouseTrip HopTropical HouseTrovaTurntablismUK GarageVallenatoVaporwaveViking MetalVocalVolksmusikWestern КачелиWitch HouseYé-YéZoukZydeco

FunkPachangaPacificParodyPersian КлассикаPiano BluesPiedmont BluesPipe & DrumPlenaPoetryPoliticalPolkaPop PunkPop RapPop RockPorroPost BopPost RockPost-HardcorePost-ModernPost-PunkPower ElectronicsPower MetalPower PopProg RockProgressive BreaksProgressive HouseProgressive MetalProgressive TrancePromotionalPsy-Tran cePsychedelicPsychedelic RockPsychobillyPub RockPublic BroadcastPublic Service AnnouncementPunkQuechuaRadioplayRaggaRagga HipHopRagtimeRaïRancheraReggaeReggae GospelReggae-PopReggaetonReligiousRenaissanceRhythm & BluesRhythmic NoiseRnB/SwingRock & RollRock OperaRockabillyRocksteadyRomaniRomanticRoots ReggaeRumbaRune SingingSalsaSambaSchlagerScoreScrewSea ShantiesShoegazeSkaSkiffleSludge MetalSmooth JazzSocaSoft RockSonSon MontunoSoneroSoukousSoulSoul-JazzSound ArtSoundtrackSouthern RockSpace RockSpace-AgeSpeechSpeed GarageSpeed MetalSpeedcoreSpoken WordSteel BandStoner RockStorySurfSwamp PopSwingSwingbeatSymphonic RockSynth-popSynthwaveTangoTech HouseTech TranceTechnicalTechnoTejanoTexas BluesThemeThrashThug RapTranceTrapTribalTribal HouseTrip HopTropical HouseTrovaTurntablismUK GarageVallenatoVaporwaveViking MetalVocalVolksmusikWestern КачелиWitch HouseYé-YéZoukZydeco

Просмотр Lyrics.

У меня есть бары, у меня нет уголовных преступлений

Это не искусственный интеллект

Я храню его

У меня есть бары, у меня нет уголовных преступлений

Это не искусственный интеллект

Я храню его  Эти ниггеры любят искусственный интеллект

Мы получили 4, теперь они ненавидят

Эти ниггеры любят искусственный интеллект

Мы получили 4, теперь они ненавидят