Содержание

Тест Тьюринга • Джеймс Трефил, энциклопедия «Двести законов мироздания»

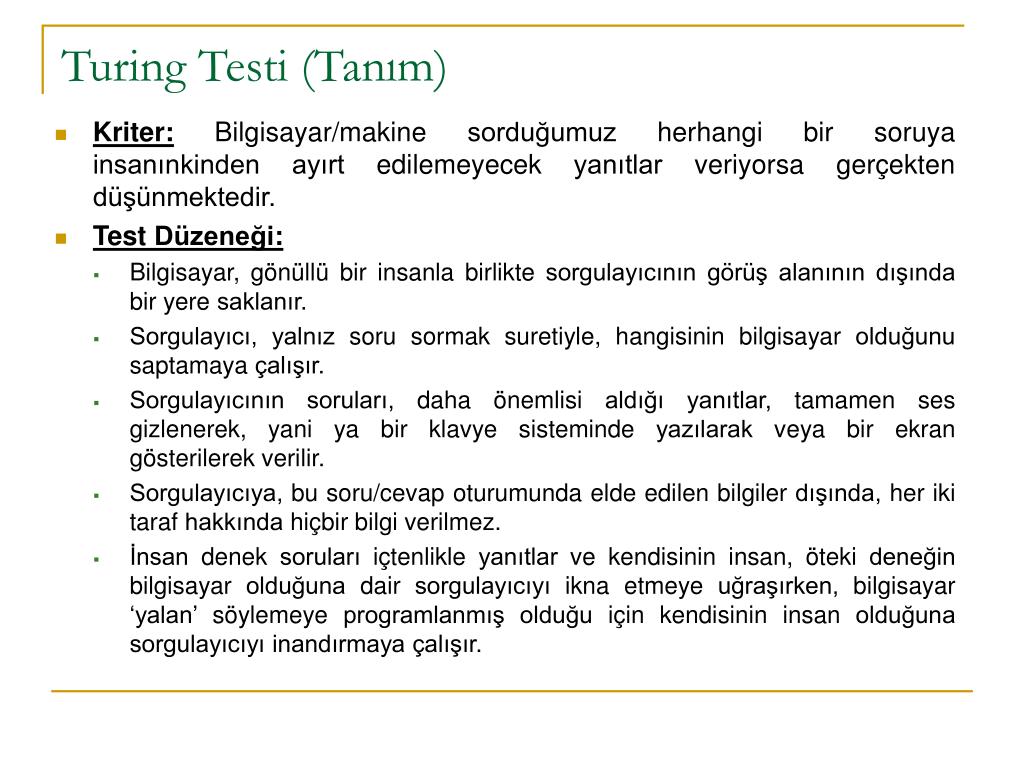

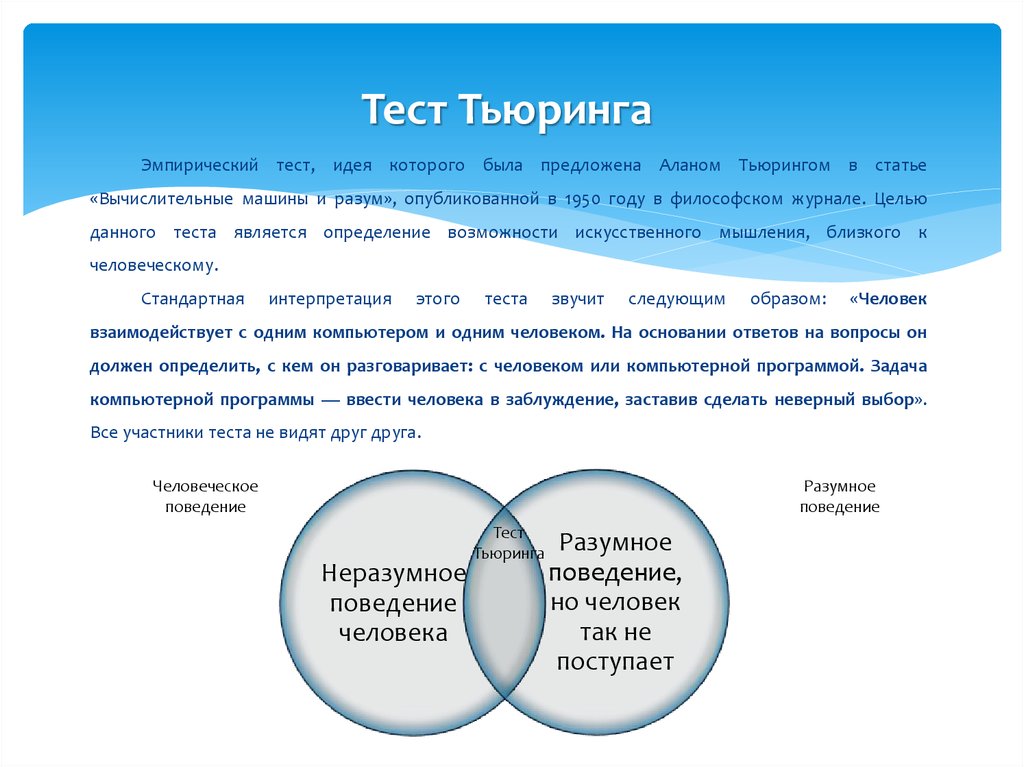

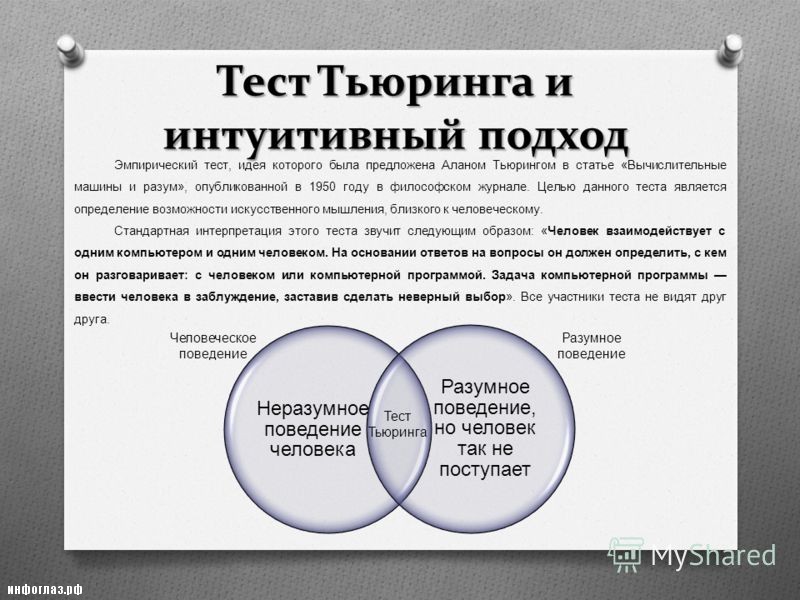

Если компьютер может работать так, что человек не в состоянии определить, с кем он общается — с другим человеком или с машиной, — считается, что он прошел тест Тьюринга.

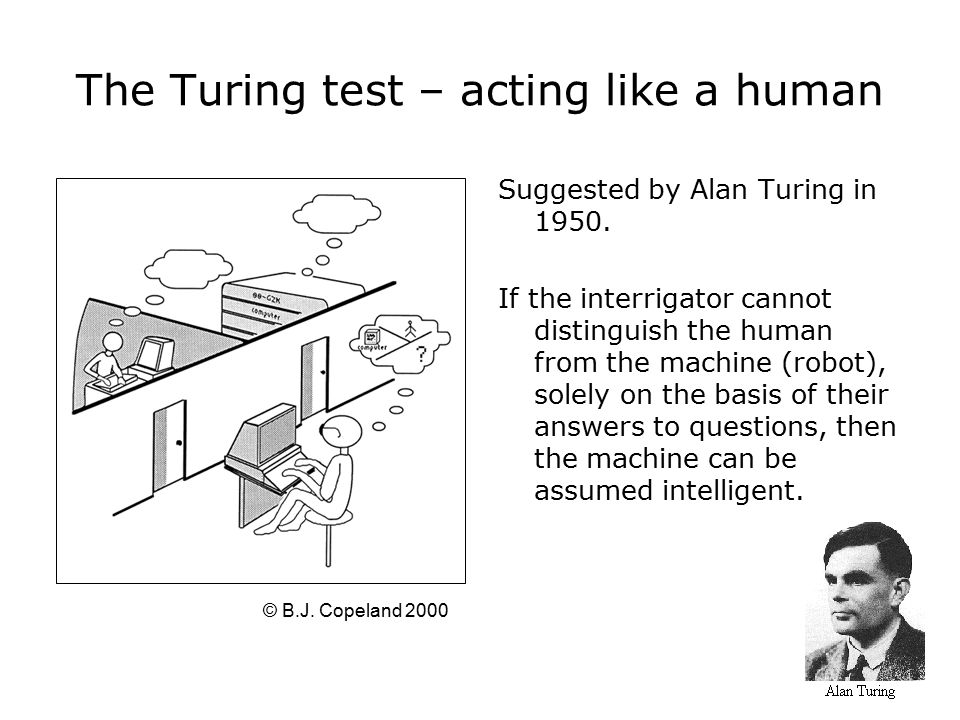

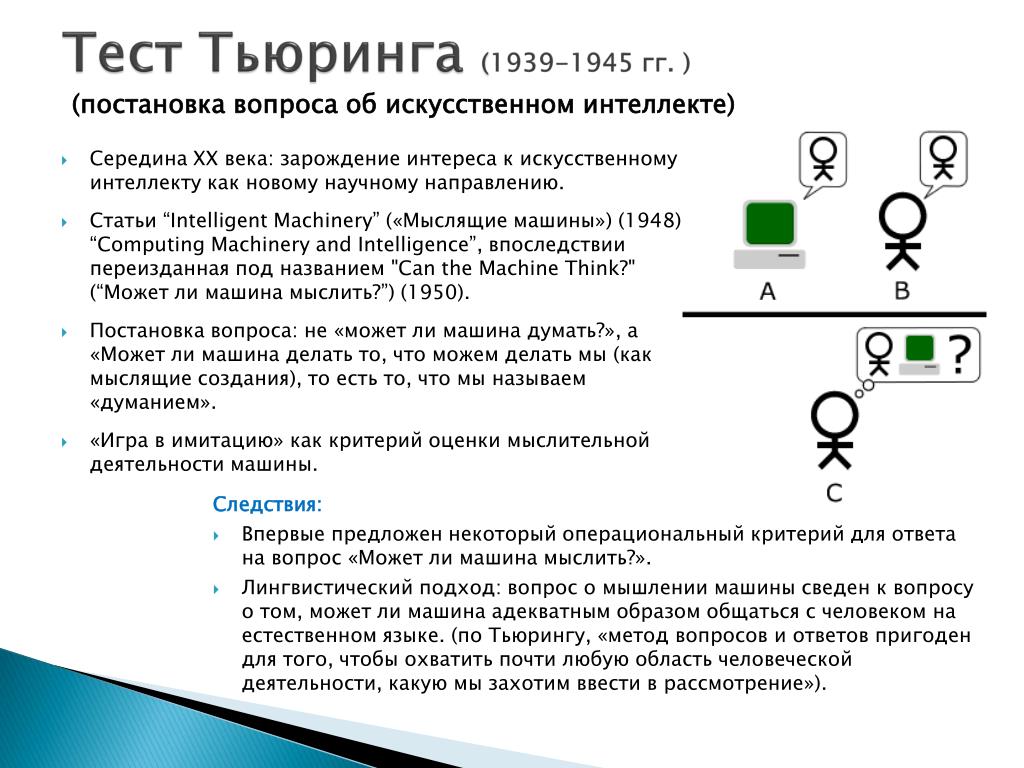

Разумные, подобные человеку машины на протяжении многих десятилетий были одной из основных тем научно-фантастических произведений (см. Три закона робототехники). С момента зарождения современной вычислительной техники умы людей занимал вопрос: можно ли построить машину, которая могла бы в чем-то заменить человека. Попыткой создать твердую эмпирическую почву для решения этого вопроса и стал тест, разработанный Аланом Тьюрингом.

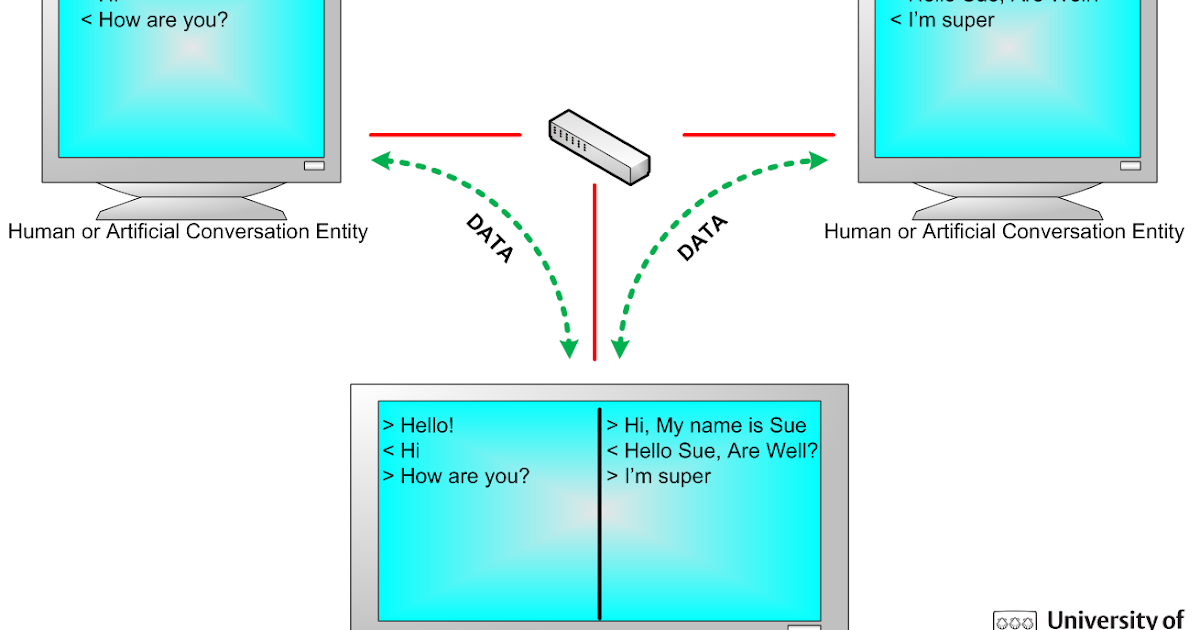

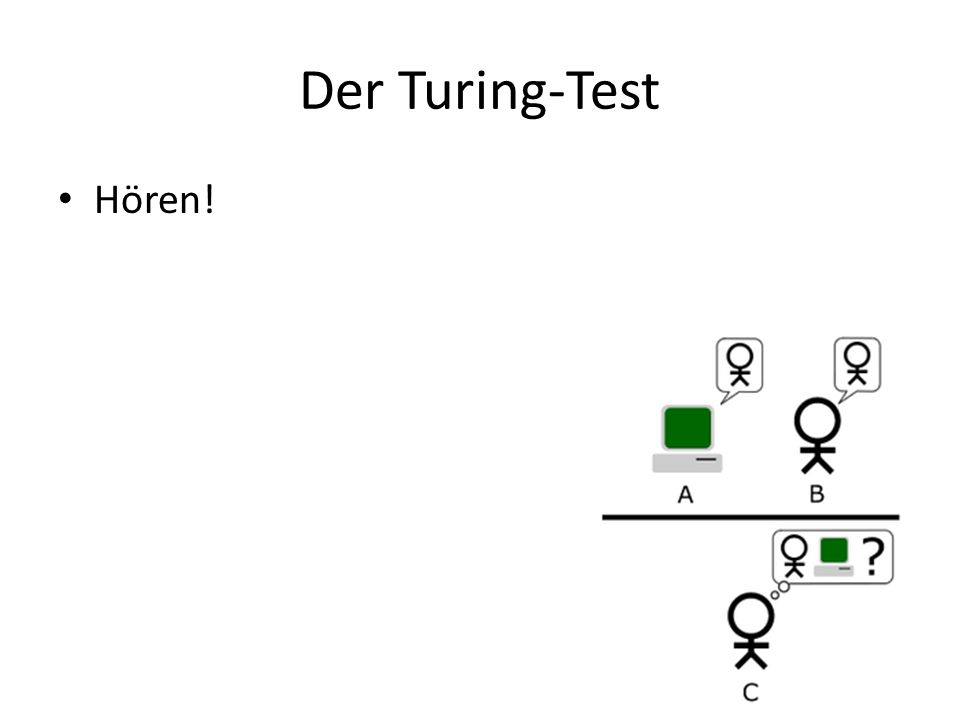

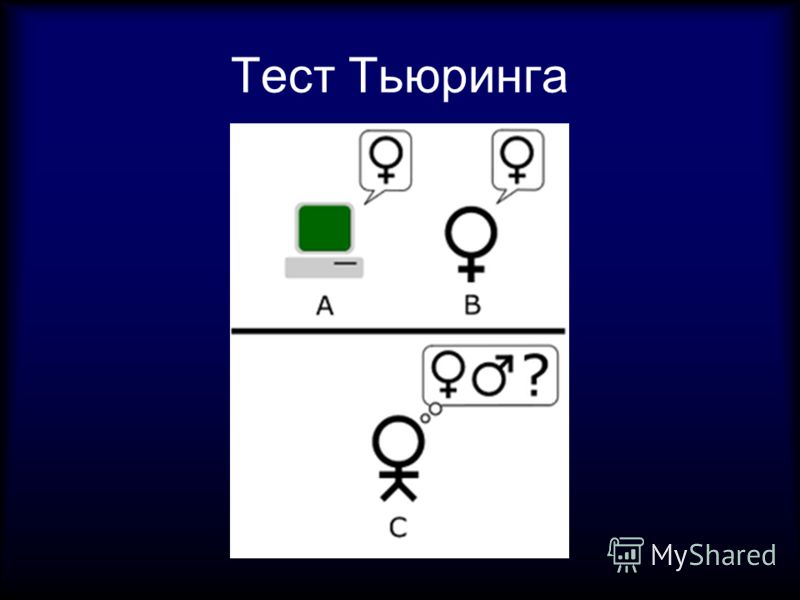

Первый вариант теста, опубликованный в 1950 году, была несколько запутанным. Современная версия теста Тьюринга представляет собой следующее задание. Группа экспертов общается с неизвестным существом. Они не видят своего собеседника и могут общаться с ним только через какую-то изолирующую систему — например, клавиатуру. Им разрешается задавать собеседнику любые вопросы, вести разговор на любые темы. Если в конце эксперимента они не смогут сказать, общались ли они с человеком или с машиной, и если на самом деле они разговаривали с машиной, можно считать, что эта машина прошла тест Тьюринга.

Им разрешается задавать собеседнику любые вопросы, вести разговор на любые темы. Если в конце эксперимента они не смогут сказать, общались ли они с человеком или с машиной, и если на самом деле они разговаривали с машиной, можно считать, что эта машина прошла тест Тьюринга.

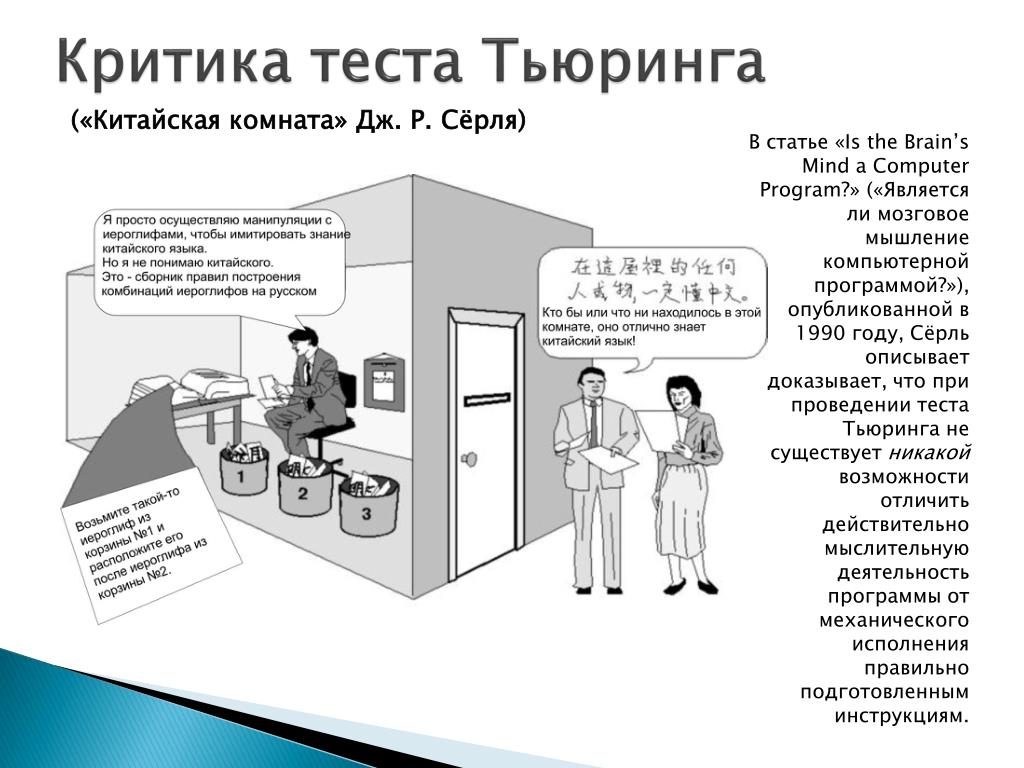

Нет нужды говорить, что сегодня ни одна машина не может даже близко подойти к тому, что пройти тест Тьюринга, хотя некоторые из них весьма неплохо работают в очень ограниченной области. Предположим, тем не менее, что в один прекрасный день машина все-таки сможет пройти этот тест. Будет ли это означать, что она разумна и обладает интеллектом?

Джон Р. Сирл (John R. Searle, р. 1932), преподаватель философии Калифорнийского университета в Беркли, разработал воображаемую систему, которая показывает, что ответ на этот вопрос отрицательный. Эта система под названием «Китайская комната» работает следующим образом. Вы сидите в комнате. В стене этой комнаты есть две щели. Через первую щель вам передают вопросы, написанные по-китайски. (Предполагается, что вы, как и Джон Сирл, не знаете китайского. Если это не так, выберите какой-нибудь другой язык, неизвестный вам.) Затем вы просматриваете книги с инструкциями типа: «Если вы получили такой-то набор символов, напишите на листке бумаги такой-то (отличный от исходного) набор символов и передайте его обратно через другую щель».

(Предполагается, что вы, как и Джон Сирл, не знаете китайского. Если это не так, выберите какой-нибудь другой язык, неизвестный вам.) Затем вы просматриваете книги с инструкциями типа: «Если вы получили такой-то набор символов, напишите на листке бумаги такой-то (отличный от исходного) набор символов и передайте его обратно через другую щель».

Ясно, что если книги с инструкциями достаточно полны, «машина», состоящая из вас и комнаты, сможет пройти тест Тьюринга. При этом очевидно, что вам совсем не обязательно понимать, что вы делаете. По мнению Сирла, это показывает, что даже если машина прошла тест Тьюринга, это еще не значит, что она разумна и обладает интеллектом.

Алан Матисон ТЬЮРИНГ

Alan Mathison Turing, 1912–54

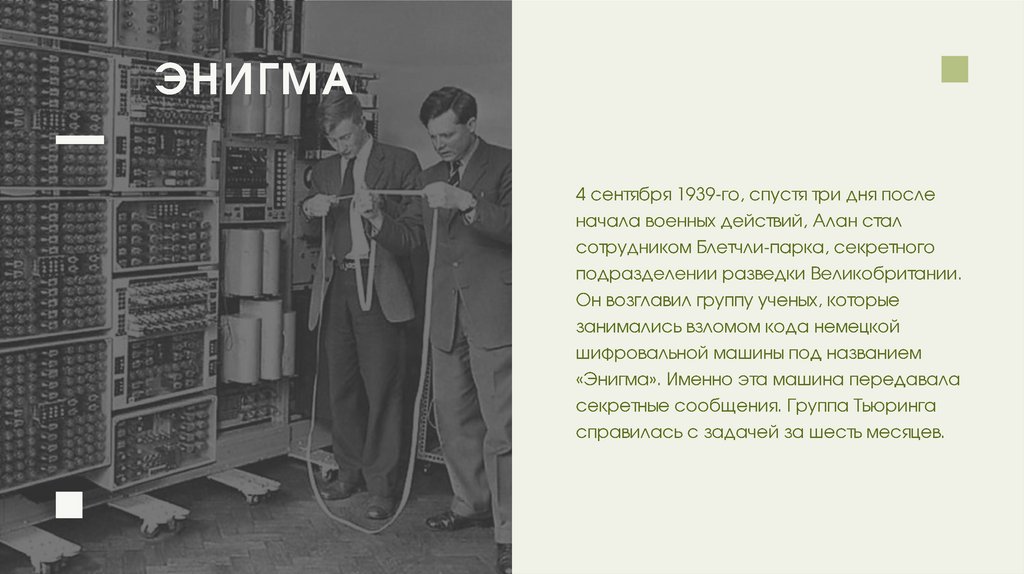

Английский математик. Родился в Лондоне, учился в Кембридже (Великобритания) и Принстоне (США). Был пионером в области теории вычислительной математики, ввел понятие машины Тьюринга — идеальной цифровой вычислительной машины. Во время Второй мировой войны работал криптографом в Блетчли-Парке — секретном учреждении правительства Великобритании, созданном для раскрытия кода немецкой военной шифровальной машины «Энигма». После войны, будучи снят со своей научной должности и подвергаясь преследованиям из-за гомосексуальных наклонностей, покончил с собой.

После войны, будучи снят со своей научной должности и подвергаясь преследованиям из-за гомосексуальных наклонностей, покончил с собой.

43

Показать комментарии (43)

Свернуть комментарии (43)

Psiho

31.05.2005 02:28Ответить

Долго спорили с другом по этому поводу. Однако, насколько уверенно можно заявить, что наш мозг не руководствуется своеобразными книгами при переборе вариантов действий в той или иной ситуации? Т.е. имеем ли мы достоверную информацию о том, что наш мозг сам по себе не является «китайской комнатой»?

Ответить

eking

Psiho 28.09.2007 16:57Ответить

В большинстве случаев так и есть — мы руководствуемся опытом. 🙂

Но мы способны обучаться (получать этот самый опыт) и экстраполировать его на ситуации, которые прямо не подходят под определения из нашего опыта. Более того, некоторые люди (с высоким уровнем интеллекта) способны так-же использовать суперпозицию из разных опытных данных, для уточнения предсказания своих «теорий» (т.е. того, как будут развиваться события и как на них нужно реагировать)

Более того, некоторые люди (с высоким уровнем интеллекта) способны так-же использовать суперпозицию из разных опытных данных, для уточнения предсказания своих «теорий» (т.е. того, как будут развиваться события и как на них нужно реагировать)Ответить

Легушка

22.06.2005 16:22

Ответить

уже был знаком с понятием Машина Тьюринга но о тесте впервые:)

—-

теперь коментарий:

если чел заранее знает что он общается точнее что ему надо определить с кем он общается с машиной или с другим челом то он сразу начнет заковыриста общяться:) дабы раскусить, в реале же если чел попробовал бы общения и не понял бы собеседника то он бы скорее всего бы перестал общаться и не стал бы делать вывода что общаестя с машиной:) я бы мог например подумать что говорю с иностранцем который по русски кроме да нет ничего не понимает:))) если он бы со мной тока этой парой слов и разговаривал

——

хотя есть такое понятие как насыщение общения (сам сформулировал тока что но смысл понятен) вот если бы машина сама бы ни как не могла бы насытить свою познавательность и ни как бы в общении не могла бы вас отпустить фсякими уловками то вы бы врятли подумали бы что это компьютер

——

прикиньте комп станет разумным и тогда это не мы в него будем играть а он в нас хотя может быть это уже сейчаз и происходит:|

—-

кста чел очень любит загадки вот ели бы машина смогла бы придумывать для нас загадки то было бы супер:)))

Ответить

alnomy

17. 01.2006 13:16

01.2006 13:16

Ответить

Вообще говоря, такой тест выполнить вряд ли получится, так как он изначально по своей формулировке (точнее, описании условий его проведения) ставит перед экспериментатором нереальную задачу — ведь в идеале, должно быть бесконечное число экспериментаторов,и/или каждый экспериментатор должен общаться с «существом» бесконечно долго.

В реальности, количество экспериментаторов ограничено, как и время общения, а следовательно, и поле общения не бесконечно широкое. В таких условиях вполне обычный персональный компьютер реально тест Тьюринга пройдет (с соответсвующей программой, разумееется). Я читал о таких прецедентах, если интересно, могу попробовать найти ссылки.

Правила коммуникации, кстати, весьма легко обобщить. Достаточно «научить» машину вежливо отвечать на вопросы, пользуясь в тех случаях, когда в ее памяти не отыскать нужных данных, расплывчатыми формулировками — и Вы не отличите ее поведение от реального человека (в разумные временные сроки, разумеется). Вот пример: Вы только что приобрели и установили на компьютер новейшую компьютерную игру, например — общеизвестный Doom или любую другую, эмулирующую какой-то мир. Вы раньше ничего, кроме Тетриса, не видели 🙂 . Программа игры поражает Ваше воображение, Вам кажется, что Вы попали в другой мир, который неисчерпаем на находки, сложные ситуации, приключения. И лишь поиграв в нее день, другой, неделю, месяц (это для очень сложных игр, которые действительно писались «от души» а не по принципу «слепить что-нить красочное, да побыстрей продать») — Вы понимаете — ну вот, теперь я все знаю об этой игре, это не Вселенная, а лишь маленький-маленький микромирок со своими законами, которые я на 100% понимаю. И сколько бы я в нее не играл, игровой процесс заметно не изменится — я все уже попробовал.

Вот пример: Вы только что приобрели и установили на компьютер новейшую компьютерную игру, например — общеизвестный Doom или любую другую, эмулирующую какой-то мир. Вы раньше ничего, кроме Тетриса, не видели 🙂 . Программа игры поражает Ваше воображение, Вам кажется, что Вы попали в другой мир, который неисчерпаем на находки, сложные ситуации, приключения. И лишь поиграв в нее день, другой, неделю, месяц (это для очень сложных игр, которые действительно писались «от души» а не по принципу «слепить что-нить красочное, да побыстрей продать») — Вы понимаете — ну вот, теперь я все знаю об этой игре, это не Вселенная, а лишь маленький-маленький микромирок со своими законами, которые я на 100% понимаю. И сколько бы я в нее не играл, игровой процесс заметно не изменится — я все уже попробовал.

Вот Вам и видоизменение теста Тьюринга — написать такую программу, которая бы эмулировала мир, и Вы не нашли бы исходных алгоритмов, его однозначно описывающих. (т.е. универсальная игра, играть в которую было бы до бесконечности интересно).

Кстати, одной из иллюстраций может послужить мультиплатформенная игра «Elite», выпущенная в 80-х годах прошлого столетия. Она занимала первую строчку рейтинга (и до сих пор имеет множество поклонников!) именно потому, что игровой процесс был непредсказуем — перед игроком представал альтернативный космос с миллиардами планет (без преувеличений!), причем каждая имела конкретное имя, характеристики, и корабли местных жителей вели себя не так, как на других планетах! Объяснение поистине чудовищно (и феноменально просто) — всего лишь два числа Фибоначчи использовались для генерации псевдослучайных последовательностей для каждой Галактики! Кроме того, игровой процесс искусственно «тормозился» в развитии, путем установки счетчиков-ограничителей — к примеру, для проявления новой характеристики или достижения надо было пройти, к примеру, 400 космических боев (число генерируется отдельно по тем же рядам Фибоначчи).

Ответить

intruder51

alnomy 29. 07.2013 23:06

07.2013 23:06Ответить

Сирл неверно интерпретировал свою умозрительную конструкцию, удивительно что о ней все еще кто то упоминает, поскольку его вывод не основан на логичном http://passivnyizarabotok.ru/%D0%BF%D0%BE%D0%B4%D0%BD%D1%8F%

D1%82%D1%8C-%D1%82%D0%B8%D1%86-%D0%B8-pr-%D1%81%D1%82%D1%80% D0%B0%D0%BD%D0%B8%D1%86-%D0%B1%D0%BB%D0%BE%D0%B3%D0%B0-%D1%8 1%D0%B0%D0%B9%D1%82%D0%B0/ Ответить

131s

21.12.2006 07:04

Ответить

Искуственный интелект возможен это точно. В этой стате частично описан принцип действия. у меня есть наработки для этого, но нет хороших знаний языка компютера.Прикол заключается в том что компютер на сегодняшний день берет знания и обратно не отдает…

Исключение ассемблер но он слишком сложен. другие языки не производят обратной конвертации, а это прямая дорога в рабство машин. кстати лицензионные программы без исходного кода это тоже рабство навязаное компанией Microsoft. вы когда небудь читали лицензии к ПО. краткий смысол такой Программа обязуется работать, но ответственности за проделаную работу не несет. У человека при приеме на работу ответствиности больше.

кстати лицензионные программы без исходного кода это тоже рабство навязаное компанией Microsoft. вы когда небудь читали лицензии к ПО. краткий смысол такой Программа обязуется работать, но ответственности за проделаную работу не несет. У человека при приеме на работу ответствиности больше.

Ответить

131s

131s 21.12.2006 07:35Ответить

Кстати ищутся единомышленники готовые работать ради идеи.

Как начало Написание языка высокого уровня на русском языке с возможностью переносится на разные платформы (intel,poketPS и другие если появятся) и главное обратное преобразование из машинного кода в язык программированияОтветить

Bon

131s 24.01.2007 15:10Ответить

К сожалению, обратное преобразование из машинного кода в язык программирования просто невозможно.

Дело в том, что при компиляции программы в машинный код отбрасывается все лишнее для компьютера, т.е. выходная программа должна быть понятна машине, и занимать как можно меньше места. Другими словами, для поцессора А сложить с Б и С сложить с Д означает одно сложить с другим. Для человека это разные программы, для компьютера — одна.

Дело в том, что при компиляции программы в машинный код отбрасывается все лишнее для компьютера, т.е. выходная программа должна быть понятна машине, и занимать как можно меньше места. Другими словами, для поцессора А сложить с Б и С сложить с Д означает одно сложить с другим. Для человека это разные программы, для компьютера — одна.

Единственный выход из этой ситуации — хранить исходники скажем, в конце кода программы мертвым грузом. При этом диск с WINDOWS XP был бы на DVD и содержал бы уйму информации, абсолютно бесполезной для работы самого WINDOWS XP! Не говоря о том, что защита авторских прав в этом случае просто исчезнет.Ответить

P.Donda

131s 09.05.2014 00:25

Ответить

Извините,уважаемый(ая) комп(а), но искусственный интеллект невозможен!

Нет, ну можете еще подучиться…

Ответить

eking

01. 10.2007 15:50

10.2007 15:50

Ответить

А знаете, что самое интересное? вот вроде-бы как мы все считаем человека разумным… споров этот вопрос не вызывает… А так ли это? где критерий разумности? Вы спросите у знакомых психологов… 🙂 Да и тесты на уровень интеллекта (IQ) на самом деле ОЧЕНЬ привязаны к нашей культуре и нашему, человеческому опыту жизни в нашем челевеческом обществе… Если некоторое существо имеет другие органы чувств, и, соответственно, будет жить в другом обществе — оно не пройдет наши тесты на уровень интеллекта — так что, оно неразумно?

С этой точки зрения — тест Тьюринга всего лишь тест на подобие человечекому интеллекту…

Ответить

131s

11.02.2008 13:32

Ответить

Сегодня для выводов об эмоциональном состоянии компьютер использует не так уж много параметров: пульс, влажность и электрическое сопротивление кожи, напряжение лицевых мышц, выражение лица в целом и ряд других. С каждым годом количество параметров анализа увеличивается (из новых отметим появление сенсора запахов) — повышается и точность результатов. Через десять лет (по самым пессимистичным прогнозам) мы получим компьютерную программу, способную распознавать эмоции человека с вероятностью 98 %. Данный показатель позволит программе генерировать эмоции самостоятельно. Искусственная эмоция окажется по качеству изготовления выше оригинала. Не это ли будет последним, гениальным решением теста Тьюринга в обход всех современных методик?

С каждым годом количество параметров анализа увеличивается (из новых отметим появление сенсора запахов) — повышается и точность результатов. Через десять лет (по самым пессимистичным прогнозам) мы получим компьютерную программу, способную распознавать эмоции человека с вероятностью 98 %. Данный показатель позволит программе генерировать эмоции самостоятельно. Искусственная эмоция окажется по качеству изготовления выше оригинала. Не это ли будет последним, гениальным решением теста Тьюринга в обход всех современных методик?

взято с http://www.xakep.ru/post/42070/default.asp?page=3

Ответить

amshf

14.08.2008 12:49

Ответить

««Если вы получили такой-то набор символов, напишите на листке бумаги такой-то (отличный от исходного) набор символов и передайте его обратно через другую щель»»

— а подумать об оценке количества инструкций — слабо? Сколько вариантов написания одного и того же вопроса мы можем придумать? Сколько всего вопросов может задать один человек, используя словарь из 5000 слов, хотя бы? Сколько вопросов разрешено задать по тесту Тюринга? Сколько времени потребуется для поиска правильного ответа? Как вы отнесетесь к разумной тумбочке, которая на примитивный вопрос «как дела»? начнет искать ответ по инструкциям в течение 3-х лет?

Что бы вы сами написали в инструкцию по вопросу «как тебя зовут»?

Бред, бред и бред!!! А Тюринг — умница!

«Ясно, что если книги с инструкциями достаточно полны,» — ясно, что «доказательство» сродни алгоритму выведения всех до единого тараканов в квартире при помощи шкафа и ножовки. .. ( кто не знает: заманить всех тараканов под шкаф и мгновенно отпилить все ножки одновременно!)

.. ( кто не знает: заманить всех тараканов под шкаф и мгновенно отпилить все ножки одновременно!)

Ответить

huge_n_terrible

12.10.2008 05:40

Ответить

Если компьютер может работать так, что человек не в состоянии определить, с кем он общается — с другим человеком или с машиной, — считается, что он прошел тест Тьюринга.

Он — это кто? )) Компьютер? Или человек?

Чтобы создать ИИ — нужно вначале разобраться,что же такое просто И (интеллект,то есть). Я знаю людей, которые часами способны общаться с примитивнейшим ботом, не замечая подвоха. Иногда и сам ломаешь голову над заковыристой CAPTCHA 🙂

Так что не только в компьютере дело, но и в человеке,который этот самый компьютер тестирует.

Ответить

Kostja

01.12.2008 01:17

Ответить

Сирл неверно интерпретировал свою умозрительную конструкцию, удивительно что о ней все еще кто то упоминает, поскольку его вывод не основан на логичном размышлении. Хех, можно подумать он сам понимал больше чем эта комната, не в обиду ему будет сказано 🙂

Хех, можно подумать он сам понимал больше чем эта комната, не в обиду ему будет сказано 🙂

Ответить

angellore

28.05.2009 01:54

Ответить

Как-то попалась мне одна интересная книга, в которой описывались действия, когда был создан ИР Тьюринга, так вот там, вся система управлялась искусственным разумом (ИР) созданном по Тьюрингу. Вроде бы книга, если не удалили лежит на сайте http://moivopros.ru/, а называется Кремниевое небо И. Шапошникова. Что самое интересное, герои книги и не представляли, что все управляется ИР.

Ответить

cannelle

14.12.2009 11:58

Ответить

Я лингвист-переводчик и работаю над проблемой формализации знаний. В основе когнитивной лингвистики лежит идея восприятия мозга человека в виде ченой коробки, а также поиск объяснений феномену восприятия, стуктуризации и порождения знаний.

Чтобы построить умную машину, необходимо разобраться для начала как работает наша с вами черная коробка!

Если кому-то это интересно — пишите!!

Ответить

eugene140782

29.01.2010 10:21

Ответить

«Если компьютер может работать так, что человек не в состоянии определить, с кем он общается — с другим человеком или с машиной, — считается, что он прошел тест Тьюринга.»

— А если компьютер может работать так, что человек не в состоянии определить, с кем он играет в шахматы — с другим человеком или с машиной, — считается, что он прошел тест Каспарова.

— А если компьютер может работать так, что человек не в состоянии определить, машина ли написала стихотворение или человек, — считается, что он прошел тест Пушкина.

— А если компьютер может работать так, что человек не в состоянии определить, машина ли написала музыкальное произведение или человек, — считается, что он прошел тест Чайковского.

— А если компьютер может работать так, что человек не в состоянии определить, машина ли написала картину или человек, — считается, что он прошел тест Репина.

И так во всех областях искусства, науки и техники — если компьютер(робот) может работать так, что человек не в состоянии определить продуктом чьей деятельности является предмет, — пусть будет считаться, что компьютер(робот) прошёл тест на Искусственного Человека!

Ответить

stochastic

02.04.2013 01:37

Ответить

«можно ли построить машину, которая могла бы в чем-то заменить человека»

Ответ положительный, только не одну машину, а сеть машин. Если современный интернет станет самоподдерживающейся (то есть не зависимой от человека) системой, то он станет искусственным разумом.

А на счёт «Китайской комнаты» высказывание «При этом очевидно, что вам совсем не обязательно понимать, что вы делаете. » не уместно, потому, что это не так, потому, что человек, который делает перевод отлично понимает чем он занимается вне зависимости от чьего-либо (даже собственного) желания.

» не уместно, потому, что это не так, потому, что человек, который делает перевод отлично понимает чем он занимается вне зависимости от чьего-либо (даже собственного) желания.

Ответить

Max Brown

07.05.2013 16:07

Ответить

Строго говоря, этот тест компьютерами давным-давно уже пройден. Но не столько за счёт усложнения программ, имитирующих человека в общении, сколько за счёт упрощения «экспертов». Тьюринг ведь не определил этот термин, дав возможность толковать условие своего теста, как «…те, кто заведомо являются людьми, не смогут определить, общались ли они тоже с человеком или же с машиной».

Знаете, я не ахти какой веб-программист, я не разбираюсь в нейросетях и те «веб-роботы», которых я пишу, занимаются банальной тупой перекачкой информации с одних сайтов на другие. И вот, как-то раз я соединил таким образом два разных русскоязычных «интеллектуальных собеседника» с чатом на некой службе знакомств.

Результат оказался неожиданным даже для меня. Лишь около 1/10 собеседников поняли, что их разводят и что они общаются не с человеком, а с программой. А самое убийственное для моего самолюбия заключалось в том, что общаясь с девушками, программа, в отличие от меня самого, либо разводила их на номер телефона в течение первых 10-20 сообщений, либо общение завершалось примерно на таком же количестве месагов. Никакой многодневной переписки.

Ответить

P.Donda

Max Brown 09.05.2014 01:04Ответить

Ув. Max Brown, «каки проблемы!?» — вот в ком не сомневаюсь, так это в Вас: 100% человек, а не компьютер!

Ответить

Михал

10.07.2017 16:05

Ответить

Компьютер не думает — он похож на высокоскоростного идиота. Эту шутку не я придумал, к сожалению не знаю автора. Но компьютер действительно не думает — он считает. А человек умеет считать, гораздо хуже компьютера, но процесс мышления основан не на счете и это принципиально. Искуственный интелект невозможен, возможна лишь его иммитация. Впрочем, хорошую иммитацию бывает трудно отличить от оригинала.

Но компьютер действительно не думает — он считает. А человек умеет считать, гораздо хуже компьютера, но процесс мышления основан не на счете и это принципиально. Искуственный интелект невозможен, возможна лишь его иммитация. Впрочем, хорошую иммитацию бывает трудно отличить от оригинала.

Ответить

Написать комментарий

Женя Густман: первый чат-бот, прошедший тест на человечность

Женя Густман: первый чат-бот, прошедший тест на человечность

В 2014 году в Лондонском королевском обществе произошло событие, которое, по мнению многих ученых, открыло новую страницу в истории изучения искусственного интеллекта.

Впервые машина, имитирующая человека, смогла пройти тест Тьюринга.

Тест Тьюринга основан на известной игре «Могут ли машины думать?», придуманной жившим в 20-м веке математиком и криптоаналитиком Аланом Тьюрингом. Эксперимент призван выявить, могут ли люди понять, что они общаются с машиной. Состоявшееся в 2014 году тестирование проводилось в год 60-летия после смерти ученого и спустя всего шесть месяцев после того, как он был посмертно помилован.

Тест считается пройденным, если компьютер спутали с человеком в 30% случаев в ходе пятиминутного общения в форме переписки в онлайн-чате. До этого ни одна программа не могла пройти испытание, однако «Евгению» удалось убедить 33% судей в том, что она является человеком (жюри состояло из 30 ученых и журналистов).

«Евгения Густмана» придумали российский программист Владимир Веселов и его украинский коллега Евгений Демченко. Программа притворяется 13-летним мальчиком Евгением из Одессы. Наряду с ним тест Тьюринга в 2014 году пытались пройти еще четыре программы. Густмана, в отличие от других чат-ботов, наделили довольно забавными личностными характеристиками: известно, что у него есть отец, который работает гинекологом, и любимая морская свинка, а бабушка учит его идишу.

«Евгений “родился” в 2001 году. Его “фишка” в том, что он может утверждать, что все знает, но при этом его возраст прекрасно оправдывает тот факт, что всего он знать не может. Мы потратили много времени на то, чтобы разработать персонаж с уникальными особенностями характера, которые делают его достоверным. В этом году мы улучшили функцию контроля за диалогами, благодаря чему общение стало намного более “человеческим” по сравнению с программами, которые просто отвечают на заданные вопросы», — рассказывает Веселов.

В этом году мы улучшили функцию контроля за диалогами, благодаря чему общение стало намного более “человеческим” по сравнению с программами, которые просто отвечают на заданные вопросы», — рассказывает Веселов.

Текст разговора Густмана с одним из судей

[15:46:05] Judge: My favourite music is contemporary Jazz, what do you prefer?

[15:46:14] Eugene: To be short I’ll only say that I HATE Britnie [sic] Spears. All other music is OK compared to her.

[15:47:06] Judge: do you like to play any musical instruments

[15:47:23] Eugene: I’m tone deaf, but my guinea pig likes to squeal Beethoven’s Ode to Joy every morning. I suspect our neighbors want to cut his throat … Could you tell me about your job, by the way?

[15:48:02] Judge: Guinea pig? Are you an animal lover

[15:48:08] Eugene: Yeah. A nice little guinea pig. Not some annoying chatter bot.

[15:48:50] Judge: Do you live with anyone else?

[15:48:59] Eugene: Yes I do. But better ask something else. And I forgot to ask you where you are from …

And I forgot to ask you where you are from …

[15:49:39] Judge: Ireland. Geen pastures and too much rain! How about you?

Кевин Уорик, приглашенный профессор в Университете Рединга и заместитель ректора по исследовательской работе в Университете Ковентри, отметил: «Появление компьютера, который может обмануть людей, представившись кем-то или даже чем-то, чему мы готовы доверять, является тревожным сигналом перед лицом опасности киберпреступлений. Тест Тьюринга представляет собой эффективное оружие по борьбе с этой угрозой. Важно получить более глубокое понимание того, как подобное общение в реальном времени приводит к тому, что у человека складывается ложное представление о собеседнике».

минут параллельного общения человека и машины

машин, пытающихся пройти тест

Придумали материал для Britanka.media? Напишите нам на [email protected]

- Читайте также

Трансляция теста Тьюринга от this_machine_kills_fascists_

Трансляция теста Тьюринга от this_machine_kills_fascists_ | Слушайте онлайн бесплатно на SoundCloud

JavaScript отключен

Вам необходимо включить JavaScript для использования SoundCloud

Покажите мне, как его включить

опубликовано

ТЕСТ ТЮРИНГА

«тест на интеллект компьютера, требующий, чтобы человек не мог отличить машину от другого человека, используя ответы на вопросы, заданные обоим».

«Алан Тьюринг считается отцом современной вычислительной науки, и многие, если не все наши современные компьютерные технологии и возможности подключения, которые мы сейчас принимаем как должное, рождены работой этого великого, но беспокойного человека.

Ранние годы Тьюрингса были посвящены новаторству и разработке захватывающих новых теорий и достижений, которые сегодня управляют нашим миром, но одна из самых интересных частей его работы пришла после войны, когда он разработал свои теории искусственного интеллекта и в конечном итоге создал современные правила, которые определяют, как мы определяем легитимность ИИ.

Алан Тьюринг изобрел теоретические машины, которые могли дать математические ответы на теоретические проблемы, и нет никаких сомнений в том, что его невероятный ум в конечном итоге спас многие миллионы жизней в конце Второй мировой войны, когда он, как известно, начал свою работу в Блетчли-парке, работая взломщиком кодов и, в конечном итоге, взломщиком. величайшая кодирующая машина всех времен, Enigma Machine.

Моя работа «Тест Тьюринга» по существу не программна (и работает как одно длинное движение), но стремится показать что-то от эмоций и красок жизни Тьюринга. Первый раздел (A-F) работы пытается изобразить как возможное воображаемое начало биоцифровых форм жизни (ИИ), так и вхождение Тьюринга в академическое и научное сообщество. В молодом возрасте его разум был в огне, и большая часть используемого здесь композиционного материала создана с использованием алгоритмических выходов некоторых из его собственных теоретических «машин», бинарных форм его имени и даже его собственной рукописной подписи для обеспечения ритмов. .

Второй раздел (F-P) стремится показать, как Тьюринги гонятся со временем, создавая все более сложные решения для все более смертельных проблем. Тьюринг был малоизвестным героем Второй мировой войны, но давление на него, должно быть, было огромным. Тьюринг жил во времена, когда гомосексуальность все еще считался преступлением. После войны он был арестован за «непристойность» и получил выбор между тюрьмой или невыносимо жестоким наказанием химической кастрацией. Чтобы он мог продолжить свою работу, он выбрал последнее. Выбор, который в конечном итоге положил конец его жизни очевидным самоубийством. Это предмет третьего раздела работы (П-Т). Последний раздел работы более целостно посвящен теме посмертного королевского помилования Тьюринга и трагедиям, порожденным невежеством. Невозможно подсчитать ценность работы Тьюринга для нашего современного мира, но одно можно сказать наверняка, если бы не невежество и нетерпимость, которые в конечном итоге привели к его смерти, он мог бы сделать неизмеримо больше. Именно из-за этого чувства печали работа заканчивается хаосом, а не триумфом.

Чтобы он мог продолжить свою работу, он выбрал последнее. Выбор, который в конечном итоге положил конец его жизни очевидным самоубийством. Это предмет третьего раздела работы (П-Т). Последний раздел работы более целостно посвящен теме посмертного королевского помилования Тьюринга и трагедиям, порожденным невежеством. Невозможно подсчитать ценность работы Тьюринга для нашего современного мира, но одно можно сказать наверняка, если бы не невежество и нетерпимость, которые в конечном итоге привели к его смерти, он мог бы сделать неизмеримо больше. Именно из-за этого чувства печали работа заканчивается хаосом, а не триумфом.

Работа составлена с использованием противоположных наборов материалов, часто основанных на собственных математических «машинах» Тьюринга. Я надеюсь, что непрекращающиеся сражения между жесткими, роботизированными, цифровыми звучащими инопланетными пейзажами и более редкими проявлениями теплых, органически звучащих текстур отражают сложности настоящего теста Тьюринга. С помощью двухтональности и сложных ритмов я попытался показать столкновение противоположных миров.

С помощью двухтональности и сложных ритмов я попытался показать столкновение противоположных миров.

В конце каждого теста мы должны решить; родился настоящий ИИ?»

Саймон Добсон 2016

- Жанр

- Современная классика

- Пользователи, которым нравится Тест Тьюринга

- пользователей, которые сделали репост Тест Тьюринга

- Плейлисты, содержащие тест Тьюринга

- Больше треков, похожих на Тест Тьюринга

Лицензия: все права защищены

Ваш текущий браузер несовместим с SoundCloud.

Загрузите один из поддерживаемых нами браузеров.

Нужна помощь?

Хром

| Фаерфокс |

Сафари

|

Край

Извините! Что-то пошло не так

Ваше сетевое соединение нестабильно или браузер устарел?

Мне нужна помощь

Популярные запросы

Тест Тьюринга: культурная жизнь идеи | Лживые СМИ: искусственный интеллект и социальная жизнь после теста Тьюринга

Фильтр поиска панели навигации

Oxford AcademicDeceitful Media: Artificial Intelligence and Social Life after the Turing TestСоциальная и культурная историяКнигиЖурналы

Термин поиска мобильного микросайта

Закрыть

Фильтр поиска панели навигации

Oxford AcademicDeceitful Media: Artificial Intelligence and Social Life after the Turing TestСоциальная и культурная историяКнигиЖурналы

Термин поиска на микросайте

Расширенный поиск

Иконка Цитировать

ЦитироватьРазрешения

Делиться

- Твиттер

- Подробнее

Cite

Натале, Симона,

«Тест Тьюринга: культурная жизнь идеи»

,

Обманчивые медиа: искусственный интеллект и социальная жизнь после теста Тьюринга

(

Нью-Йорк,

2021;

онлайн-издание 004, 9003 Academic

, 18 февраля 2021 г.

), https://doi.org/10.1093/oso/97801

365.003.0002,

, по состоянию на 29 октября 2022 г.

Выберите формат

Выберите format.ris (Mendeley, Papers, Zotero).enw (EndNote).bibtex (BibTex).txt (Medlars, RefWorks)

Закрыть

Фильтр поиска панели навигации

Oxford AcademicDeceitful Media: Artificial Intelligence and Social Life after the Turing TestСоциальная и культурная историяКнигиЖурналы

Термин поиска мобильного микросайта

Закрыть

Фильтр поиска панели навигации

Oxford AcademicDeceitful Media: Artificial Intelligence and Social Life after the Turing TestСоциальная и культурная историяКнигиЖурналы

Термин поиска на микросайте

Advanced Search

Abstract

Связь между ИИ и обманом была первоначально исследована Аланом Тьюрингом, который в 1950 году предложил практический тест на вопрос «Могут ли машины думать?» В этой главе утверждается, что предложенная Тьюрингом игра в имитацию, которую теперь чаще называют тестом Тьюринга, определила перспективы ИИ не только в усовершенствовании аппаратного и программного обеспечения, но и в более сложном сценарии, возникающем в результате взаимодействия между людьми и компьютерами. Тест Тьюринга, поместив людей в центр своего дизайна в качестве судей и агентов общения наряду с компьютерами, создал пространство для воображения и экспериментов с технологиями ИИ с точки зрения их доверия пользователям-людям. Это повлекло за собой открытие, что ИИ должен быть достигнут не только за счет разработки более сложных и функциональных вычислительных технологий, но и за счет использования стратегий и методов, использующих склонность людей к иллюзиям и обману.

Тест Тьюринга, поместив людей в центр своего дизайна в качестве судей и агентов общения наряду с компьютерами, создал пространство для воображения и экспериментов с технологиями ИИ с точки зрения их доверия пользователям-людям. Это повлекло за собой открытие, что ИИ должен быть достигнут не только за счет разработки более сложных и функциональных вычислительных технологий, но и за счет использования стратегий и методов, использующих склонность людей к иллюзиям и обману.

Ключевые слова:

Тест Тьюринга, игра-имитация, Алан Тьюринг, искусственный интеллект, обман, цифровые игры, кибернетика, вычисления

Предмет

Социальная и культурная история

В настоящее время у вас нет доступа к этой главе.

Войти

Получить помощь с доступом

Получить помощь с доступом

Доступ для учреждений

Доступ к контенту в Oxford Academic часто предоставляется посредством институциональных подписок и покупок. Если вы являетесь членом учреждения с активной учетной записью, вы можете получить доступ к контенту одним из следующих способов:

Если вы являетесь членом учреждения с активной учетной записью, вы можете получить доступ к контенту одним из следующих способов:

Доступ на основе IP

Как правило, доступ предоставляется через институциональную сеть к диапазону IP-адресов. Эта аутентификация происходит автоматически, и невозможно выйти из учетной записи с IP-аутентификацией.

Войдите через свое учреждение

Выберите этот вариант, чтобы получить удаленный доступ за пределами вашего учреждения. Технология Shibboleth/Open Athens используется для обеспечения единого входа между веб-сайтом вашего учебного заведения и Oxford Academic.

- Нажмите Войти через свое учреждение.

- Выберите свое учреждение из предоставленного списка, после чего вы перейдете на веб-сайт вашего учреждения для входа в систему.

- При посещении сайта учреждения используйте учетные данные, предоставленные вашим учреждением.

Не используйте личную учетную запись Oxford Academic.

Не используйте личную учетную запись Oxford Academic. - После успешного входа вы вернетесь в Oxford Academic.

Если вашего учреждения нет в списке или вы не можете войти на веб-сайт своего учреждения, обратитесь к своему библиотекарю или администратору.

Войти с помощью читательского билета

Введите номер своего читательского билета, чтобы войти в систему. Если вы не можете войти в систему, обратитесь к своему библиотекарю.

Члены общества

Доступ члена общества к журналу достигается одним из следующих способов:

Войти через сайт сообщества

Многие общества предлагают единый вход между веб-сайтом общества и Oxford Academic. Если вы видите «Войти через сайт сообщества» на панели входа в журнале:

- Щелкните Войти через сайт сообщества.

- При посещении сайта общества используйте учетные данные, предоставленные этим обществом.

Не используйте личную учетную запись Oxford Academic.

Не используйте личную учетную запись Oxford Academic. - После успешного входа вы вернетесь в Oxford Academic.

Если у вас нет учетной записи сообщества или вы забыли свое имя пользователя или пароль, обратитесь в свое общество.

Вход через личный кабинет

Некоторые общества используют личные аккаунты Oxford Academic для предоставления доступа своим членам. Смотри ниже.

Личный кабинет

Личную учетную запись можно использовать для получения оповещений по электронной почте, сохранения результатов поиска, покупки контента и активации подписок.

Некоторые общества используют личные аккаунты Oxford Academic для предоставления доступа своим членам.

Просмотр учетных записей, вошедших в систему

Щелкните значок учетной записи в правом верхнем углу, чтобы:

- Просмотр вашей личной учетной записи и доступ к функциям управления учетной записью.

Более того, некоторые люди (с высоким уровнем интеллекта) способны так-же использовать суперпозицию из разных опытных данных, для уточнения предсказания своих «теорий» (т.е. того, как будут развиваться события и как на них нужно реагировать)

Более того, некоторые люди (с высоким уровнем интеллекта) способны так-же использовать суперпозицию из разных опытных данных, для уточнения предсказания своих «теорий» (т.е. того, как будут развиваться события и как на них нужно реагировать) 07.2013 23:06

07.2013 23:06 Дело в том, что при компиляции программы в машинный код отбрасывается все лишнее для компьютера, т.е. выходная программа должна быть понятна машине, и занимать как можно меньше места. Другими словами, для поцессора А сложить с Б и С сложить с Д означает одно сложить с другим. Для человека это разные программы, для компьютера — одна.

Дело в том, что при компиляции программы в машинный код отбрасывается все лишнее для компьютера, т.е. выходная программа должна быть понятна машине, и занимать как можно меньше места. Другими словами, для поцессора А сложить с Б и С сложить с Д означает одно сложить с другим. Для человека это разные программы, для компьютера — одна. Не используйте личную учетную запись Oxford Academic.

Не используйте личную учетную запись Oxford Academic. Не используйте личную учетную запись Oxford Academic.

Не используйте личную учетную запись Oxford Academic.