Содержание

Сканер радужки глаза в Samsung Galaxy S8 можно обмануть с помощью фото

Samsung смартфон безопасность

Сканер радужки глаза в Samsung Galaxy S8 можно обмануть с помощью фото

Alexander Antipov

Samsung смартфон безопасность

Для обмана датчика нужны лишь фотография глаза, контактная линза и клей.

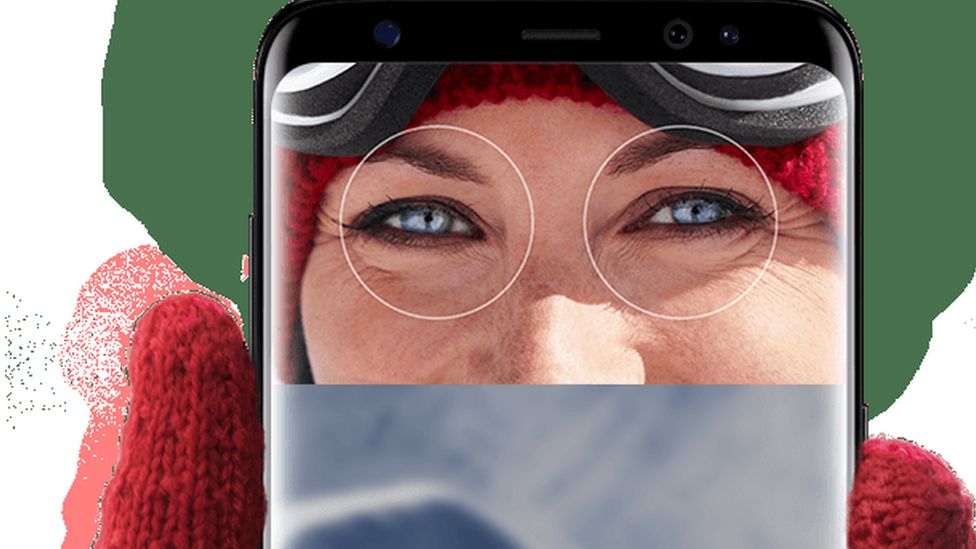

Как сообщают исследователи из Chaos Computer Club (CCC), фотографии глаза вполне достаточно для того, чтобы обмануть сканер радужной оболочки в новых Samsung Galaxy S8. Предназначенный для аутентификации пользователя сканер радужки глаза впервые появился в прошлогодних фаблетах Galaxy Note 7. Функцию так и не успели оценить по достоинству, поскольку из-за проблем с самовозгорающимися аккумуляторами устройства были отозваны, а их выпуск прекращен.

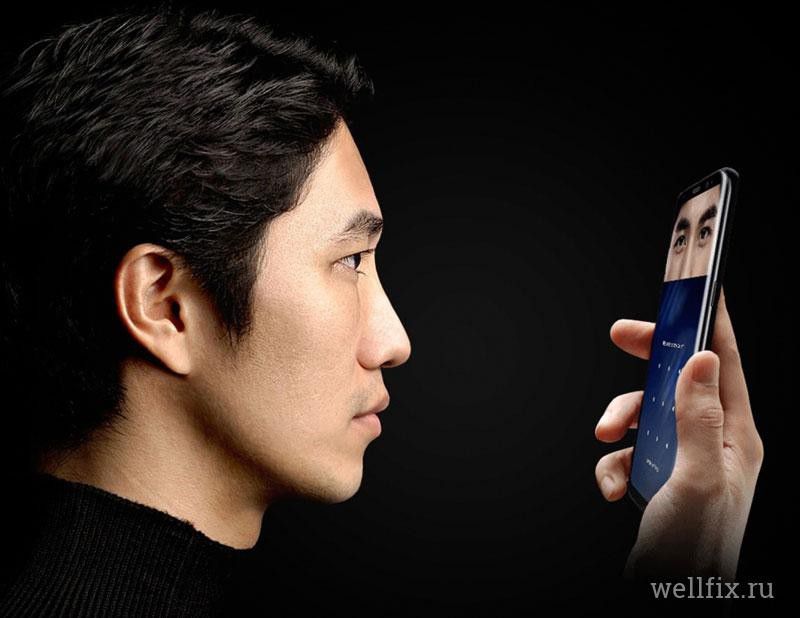

Для обмана сканера радужной оболочки глаза экспертам потребовалось менее двух месяцев. Как предположил один из исследователей Ян Крисслер (Jan Krissler), кто угодно может сфотографировать лицо владельца Galaxy S8, распечатать снимок на бумаге, поднести его к фронтальной камере смартфона и тем самым разблокировать устройство. Однако здесь кроется загвоздка. Современные сканеры радужки глаза способны отличать объемное изображение от плоского. Поскольку глаз человека круглый, датчик не срабатывает, если поднести к нему плоскую фотографию.

Крисслеру удалось решить данную проблему. Исследователь взял обычную контактную линзу, приклеил ее поверх фотографии глаза и таким образом сделал изображение объемным. Этого оказалось вполне достаточно для разблокировки телефона.

Для лучшего результата Крисслер рекомендует фотографировать глаз в режиме ночной съемки. В данном режиме радужка глаза у темноглазых людей получится отчетливее. По иронии судьбы, наиболее качественное изображение эксперт получил, распечатав снимок на лазерном принтере производства все той же Samsung. Фотографировать лучше всего цифровым фотоаппаратом с 200 мм объективом на расстоянии до 5 метров. Отметим, учитывая огромное количество доступных в интернете качественных сэлфи, вовсе необязательно подстерегать жертву с целью сделать снимок.

По иронии судьбы, наиболее качественное изображение эксперт получил, распечатав снимок на лазерном принтере производства все той же Samsung. Фотографировать лучше всего цифровым фотоаппаратом с 200 мм объективом на расстоянии до 5 метров. Отметим, учитывая огромное количество доступных в интернете качественных сэлфи, вовсе необязательно подстерегать жертву с целью сделать снимок.

Подобная атака представляет опасность не только потому, что позволяет разблокировать чужой смартфон. Samsung планирует использовать аутентификацию по радужке глаза для подтверждения платежей через Samsung Pay, а значит, атаку наверняка возьмут на вооружение жаждущие наживы хакеры.

Samsung Pay – разработанная Samsung служба мобильных платежей, позволяющая пользователям оплачивать покупки с помощью поддерживаемых телефонов и других устройств компании.

Мир сходит с ума и грянет киберапокалипсис. Подпишись на наш Телеграм канал, чтобы узнать первым, как выжить в цифровом кошмаре!

Поделиться новостью:

Новости по теме

Путин на совещании с Совбезом обсудил подготовку кадров для обеспечения информационной безопасности

Белые хакеры заработали $681 250 за два дня Pwn2Own 2022 в Торонто

Рекордно быстрый взлом Samsung Galaxy S22 и $989 тысяч призовых

Первый день Pwn2Own стал последним для защиты Samsung Galaxy S22

Америка постепенно отказывается от TikTok из-за угрозы национальной безопасности

Минюст США потребует от компаний контролировать общение сотрудников

Сертификаты Samsung и LG используются для подписи вредоносных приложений

IBM будет сотрудничать с Японией для производства 2-нм чипов

Военная образовательная платформа будет использоваться для обучения гражданских сотрудников Армии США

Подпишитесь на email рассылку

Подпишитесь на получение последних материалов по безопасности от SecurityLab. ru —

ru —

новости, статьи, обзоры уязвимостей и мнения аналитиков.

Ежедневный выпуск от SecurityLab.Ru

Еженедельный выпуск от SecurityLab.Ru

Нажимая на кнопку, я принимаю условия соглашения.

Как включить сканирование радужной оболочки глаза и разблокировку лица на Galaxy S8

Galaxy Note 7 (RIP) был первым устройством Samsung с биометрической разблокировкой, но наряду со сканированием радужной оболочки Galaxy S8 возвращает старый трюк: разблокировка лица. Оба быстры и безопасны, и компенсируют неудобное размещение датчика отпечатка пальца. Вот как их использовать для разблокировки телефона.

Биометрия на Galaxy S8 объяснена

Как включить разблокировку радужной оболочки на Galaxy S8

- На главном экране проведите пальцем вниз по уведомлению .

- Нажмите значок настроек (в форме винтика).

Прокрутите вниз и коснитесь экрана блокировки и безопасности .

- Нажмите на сканер Iris .

- Введите свой пароль, PIN-код или шаблон .

Нажмите Зарегистрировать ирисы .

- Согласитесь с отказом от ответственности.

- Нажмите продолжить .

- Посмотрите на фронтальную камеру, чтобы зарегистрировать ирисы.

- Нажмите Включить, если разблокировка лица уже включена.

- (Необязательно) Включите разблокировку Iris при включении экрана, чтобы ускорить процесс разблокировки.

- (Необязательно) Включите учетную запись Samsung, чтобы использовать ирис для разблокировки учетной записи Samsung.

Как изменить маску экрана, которую вы видите при разблокировке телефона

Samsung включает в себя ряд интересных (и несколько удобных для детей) масок, которые можно использовать для улучшения функции разблокировки радужной оболочки. Вот как можно изменить один из них по умолчанию.

Вот как можно изменить один из них по умолчанию.

- На главном экране проведите пальцем вниз по уведомлению .

- Нажмите значок настроек (в форме винтика).

Прокрутите вниз и коснитесь экрана блокировки и безопасности .

- Нажмите на сканер Iris .

- Введите свой пароль, PIN-код или шаблон .

- Нажмите « Маска экрана предварительного просмотра» .

- Выберите новый шаблон маски .

Как включить разблокировку лица на Galaxy S8

- На главном экране проведите пальцем вниз по уведомлению .

- Нажмите значок настроек (в форме винтика).

Прокрутите вниз и коснитесь экрана блокировки и безопасности .

- Нажмите на распознавание лиц .

- Введите свой пароль, PIN-код или шаблон .

Нажмите Зарегистрировать свое лицо .

- Нажмите продолжить .

- Посмотрите на фронтальную камеру, чтобы зарегистрировать лицо.

- Нажмите « Включить», если сканер радужной оболочки уже включен.

- (Необязательно) Включите функцию разблокировки лица при включении экрана, чтобы ускорить процесс разблокировки.

Это оно! Но есть несколько вещей, которые нужно иметь в виду.

Как улучшить сканирование радужной оболочки или разблокировку лица

Несмотря на то, что сканер радужной оболочки глаза и разблокировка лица на Galaxy S8 быстрые и безопасные, есть способы улучшить впечатления.

- При регистрации ирисов снимайте очки или снимайте контакты. Это облегчает для системы видеть реального вас. Вы знаете, внутри.

- Убедитесь, что ваши глаза полностью открыты — если вы находитесь на солнце, переместитесь в тенистую область, чтобы вам не пришлось щуриться.

- Не пытайтесь разблокировать свою радужную оболочку под прямыми солнечными лучами. Если вы собираетесь находиться на улице в течение длительного периода времени, переключитесь на разблокировку лицом, которая быстрее при хороших условиях освещения.

- Не пытайтесь использовать разблокировку лица в условиях низкой освещенности. Если вы собираетесь находиться в помещении в течение длительного периода времени, переключитесь на сканирование радужной оболочки.

- Это кажется очевидным, но не размазывайте переднюю камеру или какие-либо передние датчики.

- Если вы получаете много сбоев при сканировании радужной оболочки или разблокировке лица, удалите зарегистрированные данные, переместитесь в более освещенное место (в помещении, с хорошим освещением) и попробуйте снова.

Это оно! Надеюсь, ваш биометрический опыт разблокировки великолепен, но если это не так, всегда есть задний датчик отпечатков пальцев, на который можно вернуться. Вы уже настроили это, не так ли?

Основной

- Galaxy S8 и S8 + обзор!

- Характеристики Galaxy S8 и S8 +

- Все, что вам нужно знать о камерах Galaxy S8

- Познакомьтесь с Samsung Bixby

- Присоединяйтесь к нашим форумам Galaxy S8

- Verizon

- AT & T

- T-Mobile

- спринт

- разблокирована

Мы можем заработать комиссию за покупки, используя наши ссылки. Узнайте больше

Узнайте больше

Безопасность — Сканер радужной оболочки глаза | Samsung Galaxy S8 и S8+

ПРЕДВАРИТЕЛЬНАЯ РЕГИСТРАЦИЯ

ПРЕДВАРИТЕЛЬНЫЙ ЗАКАЗ

КУПИ СЕЙЧАС

ПРЕДВАРИТЕЛЬНАЯ РЕГИСТРАЦИЯ

ПРЕДВАРИТЕЛЬНЫЙ ЗАКАЗ

Мы очень заботимся о вашей конфиденциальности. Поэтому мы внедрили эффективные механизмы, которые предотвращают нежелательное отслеживание и делают его удивительно удобным для вас. Есть сканирование радужной оболочки глаза для надежной защиты, распознавание лиц для немедленной разблокировки телефона и защита уровня защиты, которая стоит на страже круглосуточно.

- ИРИС

- Распознавание лиц

- Отпечаток пальца

- Узор

- Пароль

- PIN-код

Сканер радужной оболочки глаза

Откройте глазами

Поднимите свой Galaxy S8 или S8+ и совместите глаза с двойными кругами на экране, чтобы сканировать радужную оболочку. Ваш телефон разблокирован взглядом.

Ваш телефон разблокирован взглядом.

Сканирование радужной оболочки глаза

Распознавание лиц

Открыть лицом

Поднимите телефон, как будто делаете селфи, чтобы использовать распознавание лиц. Это быстрый и легкий способ разблокировать Galaxy S8 или S8+.

*Распознавание лиц менее безопасно, чем графический ключ, PIN-код или пароль.

Сканер отпечатков пальцев

Открыть одним касанием

Когда вы берете Galaxy S8 или S8+, ваш палец естественным образом касается датчика отпечатков пальцев на задней панели, и он разблокируется одним плавным движением. Вам даже не нужно сначала будить телефон.

Нокс Контейнер

SE для Android

ТИМА

Безопасная загрузка и доверенная загрузка

Аппаратный корень доверия

- Многоуровневая защита

- Защита в режиме реального времени

- Аппаратное шифрование

- Всемирная сертификация

*Данные государственной сертификации актуальны по состоянию на март 2017 г.

*Для активации Knox Container необходимо приобрести лицензию Knox.

*TIMA — это архитектура измерения целостности на основе TrustZone.

S8

|

S8+

|

S8 с двумя SIM-картами

|

S8+ с двумя SIM-картами

Предыдущий

Камера

Следующий

Производительность

Компания, стоящая за сканером радужной оболочки глаза Samsung Galaxy S8

Теперь, когда записанный звук стал повсеместным, мы почти не задумываемся об этом. Смартфоны, умные колонки, телевизоры, радиоприемники, проигрыватели дисков и автомобильные аудиосистемы — прочное и приятное присутствие в нашей жизни. В 2017 году опрос, проведенный компанией Nielsen, показал, что около 90 процентов населения США регулярно слушает музыку, и в среднем они делают это 32 часа в неделю.

За этим свободно текущим удовольствием стоят огромные отрасли, применяющие технологии для достижения давней цели воспроизведения звука с максимально возможным реализмом. Начиная с фонографа Эдисона и рупорных динамиков 1880-х годов, последующие поколения инженеров в погоне за этим идеалом изобретали и использовали бесчисленные технологии: триодные вакуумные лампы, динамические громкоговорители, картриджи магнитных фонографов, схемы полупроводниковых усилителей с множеством различных топологий, электростатические громкоговорители. , оптические диски, стерео и объемный звук. И за последние пять десятилетий цифровые технологии, такие как

сжатие и потоковая передача звука изменили музыкальную индустрию.

И все же даже сейчас, после 150 лет разработки, звук, который мы слышим даже из высококачественной аудиосистемы, далеко не соответствует тому, что мы слышим, физически присутствуя на живом музыкальном представлении. В таком случае мы находимся в естественном звуковом поле и можем легко заметить, что звуки разных инструментов исходят из разных мест, даже когда звуковое поле пересекается смешанными звуками от нескольких инструментов. Есть причина, по которой люди платят значительные суммы, чтобы послушать живую музыку: это более приятно, захватывающе и может произвести большее эмоциональное воздействие.

Есть причина, по которой люди платят значительные суммы, чтобы послушать живую музыку: это более приятно, захватывающе и может произвести большее эмоциональное воздействие.

Сегодня исследователи, компании и предприниматели, в том числе и мы, наконец приближаемся к записанному звуку, который действительно воссоздает естественное звуковое поле. В группу входят крупные компании, такие как Apple и Sony, а также более мелкие фирмы, такие как

Творческий. Netflix недавно сообщил о партнерстве с Sennheiser, в рамках которого сеть начала использовать новую систему Ambeo 2-Channel Spatial Audio, чтобы повысить звуковой реализм таких телешоу, как «Очень странные дела» и «Ведьмак».

В настоящее время существует по меньшей мере полдюжины различных подходов к созданию высокореалистичного звука. Мы используем термин «звуковая сцена», чтобы отличить нашу работу от других аудиоформатов, таких как пространственное аудио или иммерсивное аудио. Они могут воспроизводить звук с большим пространственным эффектом, чем обычное стерео, но обычно они не включают подробных признаков местоположения источника звука, которые необходимы для воспроизведения действительно убедительного звукового поля.

Мы верим, что звуковая сцена — это будущее записи и воспроизведения музыки. Но прежде чем произойдет такая радикальная революция, необходимо будет преодолеть огромное препятствие: удобное и недорогое преобразование бесчисленных часов существующих записей, независимо от того, являются ли они монофоническими, стереофоническими или многоканальными с объемным звуком (5.1, 7.1). , и так далее). Никто точно не знает, сколько песен было записано, но, согласно развлекательным метаданным концерна Gracenote,

сейчас на планете Земля доступно более 200 миллионов записанных песен. Учитывая, что средняя продолжительность песни составляет около 3 минут, это эквивалентно примерно 1100 годам музыки.

Измерение передаточной функции головы

Чтобы обеспечить высокую степень пространственного реализма для слушателя, вам необходимо точно отобразить детали того, как уникальная форма головы, ушей и носовой полости этого слушателя влияет на то, как он или она слышит звук.![]() Это делается путем определения передаточной функции, связанной с головой слушателя, которая достигается путем воспроизведения звуков под разными углами и записи того, как голова пользователя влияет на звуки в каждом положении.

Это делается путем определения передаточной функции, связанной с головой слушателя, которая достигается путем воспроизведения звуков под разными углами и записи того, как голова пользователя влияет на звуки в каждом положении.

Питер Ли

Это партий музыки. Любая попытка популяризировать новый аудиоформат, каким бы многообещающим он ни был, обречена на провал, если только она не включает в себя технологию, которая позволяет нам слушать весь этот существующий звук с той же легкостью и удобством, с которыми мы сейчас наслаждаемся стереомузыкой — в наши дома, на пляже, в поезде или в машине.

Мы разработали такую технологию. Наша система, которую мы называем 3D Soundstage, позволяет воспроизводить музыку в звуковой сцене на смартфонах, обычных или умных колонках, наушниках, наушниках, ноутбуках, телевизорах, звуковых панелях и в транспортных средствах. Он не только может преобразовывать моно- и стереозаписи в звуковую сцену, но и позволяет слушателю, не имеющему специальной подготовки, реконфигурировать звуковое поле в соответствии со своими предпочтениями с помощью графического пользовательского интерфейса. Например, слушатель может назначить расположение каждого инструмента и источника звука вокала и отрегулировать громкость каждого — изменяя относительную громкость, скажем, вокала по сравнению с инструментальным сопровождением. Система делает это, используя искусственный интеллект (ИИ), виртуальную реальность и цифровую обработку сигналов (подробнее об этом чуть позже).

Например, слушатель может назначить расположение каждого инструмента и источника звука вокала и отрегулировать громкость каждого — изменяя относительную громкость, скажем, вокала по сравнению с инструментальным сопровождением. Система делает это, используя искусственный интеллект (ИИ), виртуальную реальность и цифровую обработку сигналов (подробнее об этом чуть позже).

Чтобы убедительно воспроизвести звук, исходящий, скажем, от струнного квартета в двух небольших динамиках, таких как наушники, требуется большое техническое мастерство. Чтобы понять, как это делается, давайте начнем с того, как мы воспринимаем звук.

Когда звук достигает ваших ушей, уникальные характеристики вашей головы — ее физическая форма, форма наружного и внутреннего ушей и даже форма носовых полостей — изменяют звуковой спектр исходного звука. Кроме того, существует очень небольшая разница во времени прихода звука от источника к вашим ушам. По этому спектральному изменению и разнице во времени ваш мозг воспринимает местоположение источника звука. Спектральные изменения и разница во времени могут быть математически смоделированы как передаточные функции, связанные с головой (HRTF). Для каждой точки в трехмерном пространстве вокруг вашей головы есть пара HRTF, одна для левого уха, а другая для правого.

Спектральные изменения и разница во времени могут быть математически смоделированы как передаточные функции, связанные с головой (HRTF). Для каждой точки в трехмерном пространстве вокруг вашей головы есть пара HRTF, одна для левого уха, а другая для правого.

Итак, мы можем обработать фрагмент аудио, используя пару HRTF, одну для правого уха и одну для левого. Чтобы воссоздать первоначальный опыт, нам нужно было бы принять во внимание расположение источников звука относительно записывающих их микрофонов. Если мы затем воспроизведем этот обработанный звук, например, через пару наушников, слушатель услышит звук с исходными репликами и воспримет, что звук исходит из тех направлений, с которых он был изначально записан.

Если у нас нет исходной информации о местоположении, мы можем просто назначить местоположения для отдельных источников звука и получить практически тот же опыт. Слушатель вряд ли заметит незначительные сдвиги в расположении исполнителя — более того, он может предпочесть свою собственную конфигурацию.

Даже сейчас, после 150 лет разработки, звук, который мы слышим даже из высококачественной аудиосистемы, далеко не соответствует тому, что мы слышим, физически присутствуя на живом музыкальном представлении.

Существует множество коммерческих приложений, использующих HRTF для создания пространственного звука для слушателей, использующих головные телефоны и наушники. Одним из примеров является Spatialize Stereo от Apple. Эта технология применяет HRTF для воспроизведения звука, чтобы вы могли воспринимать пространственный звуковой эффект — более глубокое звуковое поле, более реалистичное, чем обычное стерео. Apple также предлагает версию с отслеживанием головы, в которой используются датчики на iPhone и AirPods для отслеживания относительного направления между вашей головой, на которую указывают AirPods в ушах, и вашим iPhone. Затем он применяет HRTF, связанные с направлением вашего iPhone, для создания пространственных звуков, чтобы вы воспринимали, что звук исходит от вашего iPhone. Это не то, что мы бы назвали звуком звуковой сцены, потому что звуки инструментов все еще микшируются. Вы не можете воспринимать, что, например, скрипач находится слева от альтиста.

Это не то, что мы бы назвали звуком звуковой сцены, потому что звуки инструментов все еще микшируются. Вы не можете воспринимать, что, например, скрипач находится слева от альтиста.

Однако у Apple есть продукт, который пытается обеспечить звук звуковой сцены: Apple Spatial Audio. Это значительное улучшение по сравнению с обычным стереозвуком, но, на наш взгляд, у него все еще есть несколько проблем. Во-первых, он включает в себя Dolby Atmos, технологию объемного звука, разработанную Dolby Laboratories. Spatial Audio применяет набор HRTF для создания пространственного звука для наушников и наушников. Однако использование Dolby Atmos означает, что вся существующая стереофоническая музыка должна быть переработана для этой технологии. Ремастеринг миллионов песен, уже записанных в моно и стерео, практически невозможен. Еще одна проблема с Spatial Audio заключается в том, что он может поддерживать только наушники, но не динамики, поэтому он бесполезен для людей, которые склонны слушать музыку дома и в машине.

Так как же наша система обеспечивает реалистичный звук звуковой сцены? Мы начинаем с использования программного обеспечения для машинного обучения, чтобы разделить звук на несколько изолированных дорожек, каждая из которых представляет один инструмент или певца, или одну группу инструментов или певцов. Этот процесс разделения называется повышающим микшированием. Затем продюсер или даже слушатель, не имеющий специальной подготовки, может рекомбинировать несколько дорожек, чтобы воссоздать и персонализировать желаемое звуковое поле.

Рассмотрим песню с участием квартета, состоящего из гитары, баса, ударных и вокала. Слушатель может решить, где «найти» исполнителей, и настроить громкость каждого в соответствии со своими личными предпочтениями. Используя сенсорный экран, слушатель может виртуально расположить источники звука и положение слушателя в звуковом поле для достижения приятной конфигурации. Графический пользовательский интерфейс отображает фигуру, представляющую сцену, на которую наложены значки, указывающие на источники звука — вокал, ударные, бас, гитары и т. д. В центре есть значок головы, указывающий положение слушателя. Слушатель может коснуться и перетащить значок головы, чтобы изменить звуковое поле в соответствии со своими предпочтениями.

д. В центре есть значок головы, указывающий положение слушателя. Слушатель может коснуться и перетащить значок головы, чтобы изменить звуковое поле в соответствии со своими предпочтениями.

Перемещение значка головы ближе к барабанам делает звук барабанов более заметным. Если слушатель переместит значок головы на значок, представляющий инструмент или певца, слушатель услышит этого исполнителя как соло. Дело в том, что, позволяя слушателю переконфигурировать звуковое поле, 3D Soundstage добавляет новые измерения (если вы простите за каламбур) к наслаждению музыкой.

Преобразованный звук звуковой сцены может быть двухканальным, если он предназначен для прослушивания через наушники или обычную систему с левым и правым каналами. Или он может быть многоканальным, если он предназначен для воспроизведения на многоканальной системе. В этом последнем случае звуковое поле звуковой сцены может быть создано двумя, четырьмя или более динамиками. Количество отдельных источников звука в воссозданном звуковом поле может быть даже больше, чем количество динамиков.

Этот многоканальный подход не следует путать с обычным объемным звуком 5.1 и 7.1. Обычно они имеют пять или семь отдельных каналов и динамик для каждого, а также сабвуфер («.1»). Несколько динамиков создают звуковое поле, которое является более захватывающим, чем стандартная стереофоническая установка с двумя динамиками, но им все еще не хватает реализма, возможного при записи настоящей звуковой сцены. При воспроизведении через такую многоканальную настройку наши записи 3D Soundstage обходят 5.1, 7.1 или любые другие специальные аудиоформаты, включая стандарты многодорожечного сжатия звука.

Несколько слов об этих стандартах. Недавно были разработаны новые стандарты для лучшей обработки данных для улучшенных приложений объемного звука и иммерсивного звука. К ним относится стандарт 3D-аудио MPEG-H для иммерсивного пространственного звука с кодированием пространственных аудиообъектов (SAOC). Эти новые стандарты пришли на смену различным многоканальным аудиоформатам и соответствующим им алгоритмам кодирования, таким как Dolby Digital AC-3 и DTS, которые были разработаны несколько десятилетий назад.

При разработке новых стандартов экспертам пришлось учитывать множество различных требований и желаемых характеристик. Люди хотят взаимодействовать с музыкой, например, изменяя относительную громкость различных групп инструментов. Они хотят транслировать разные виды мультимедиа, по разным сетям и через разные конфигурации динамиков. SAOC был разработан с учетом этих функций, что позволяет эффективно хранить и транспортировать аудиофайлы, сохраняя при этом возможность для слушателя настраивать микс в соответствии со своим личным вкусом.

Однако для этого требуется множество стандартизированных методов кодирования. Для создания файлов SAOC использует кодировщик. Входными данными кодировщика являются файлы данных, содержащие звуковые дорожки; каждая дорожка представляет собой файл, представляющий один или несколько инструментов. Кодер по существу сжимает файлы данных, используя стандартные методы. Во время воспроизведения декодер в вашей аудиосистеме декодирует файлы, которые затем преобразуются обратно в многоканальные аналоговые звуковые сигналы с помощью цифро-аналоговых преобразователей.

Наша технология 3D Soundstage обходит это. В качестве входных данных мы используем моно-, стерео- или многоканальные файлы аудиоданных. Мы разделяем эти файлы или потоки данных на несколько дорожек изолированных источников звука, а затем преобразуем эти дорожки в двухканальный или многоканальный выход, в зависимости от предпочтительных конфигураций слушателя, для управления наушниками или несколькими громкоговорителями. Мы используем технологию искусственного интеллекта, чтобы избежать многодорожечной перезаписи, кодирования и декодирования.

На самом деле, одна из самых больших технических проблем, с которыми мы столкнулись при создании системы 3D Soundstage, заключалась в написании программного обеспечения для машинного обучения, которое разделяет (или микширует) обычную моно-, стерео- или многоканальную запись на несколько изолированных дорожек в реальном времени. . Программное обеспечение работает на нейронной сети. Мы разработали этот подход для разделения музыки в 2012 году и описали его в патентах, выданных в 2022 и 2015 годах (номера патентов США: 11 240 621 B2 и 9). ,131,305 В2).

,131,305 В2).

Слушатель может решить, где «найти» исполнителей, и может отрегулировать громкость каждого в соответствии со своими личными предпочтениями.

Типичная сессия состоит из двух компонентов: обучение и повышающее микширование. В учебном сеансе большая коллекция смешанных песен вместе с их изолированными инструментальными и вокальными треками используется в качестве входных и целевых выходных данных для нейронной сети соответственно. В обучении используется машинное обучение для оптимизации параметров нейронной сети, чтобы выходные данные нейронной сети — набор отдельных треков изолированных инструментальных и вокальных данных — соответствовали целевому выходу.

Нейронная сеть очень слабо смоделирована на основе мозга. Он имеет входной слой узлов, которые представляют собой биологические нейроны, а затем множество промежуточных слоев, называемых «скрытыми слоями». Наконец, после скрытых слоев есть выходной слой, где появляются окончательные результаты. В нашей системе данные, подаваемые на входные узлы, представляют собой данные микшированной звуковой дорожки. По мере того как эти данные проходят через уровни скрытых узлов, каждый узел выполняет вычисления, в результате которых получается сумма взвешенных значений. Затем над этой суммой выполняется нелинейная математическая операция. Этот расчет определяет, передаются ли и как аудиоданные от этого узла узлам следующего уровня.

По мере того как эти данные проходят через уровни скрытых узлов, каждый узел выполняет вычисления, в результате которых получается сумма взвешенных значений. Затем над этой суммой выполняется нелинейная математическая операция. Этот расчет определяет, передаются ли и как аудиоданные от этого узла узлам следующего уровня.

Этих слоев десятки. По мере того, как аудиоданные переходят от слоя к слою, отдельные инструменты постепенно отделяются друг от друга. В конце выходного слоя каждая отдельная звуковая дорожка выводится на узел выходного слоя.

В любом случае, это идея. Пока нейронная сеть обучается, вывод может быть неверным. Это может быть не изолированная инструментальная дорожка — например, она может содержать звуковые элементы двух инструментов. В этом случае индивидуальные веса в схеме взвешивания, используемой для определения того, как данные передаются от скрытого узла к скрытому узлу, настраиваются, и обучение запускается снова. Это итеративное обучение и настройка продолжаются до тех пор, пока результат не будет более или менее точно соответствовать целевому результату.

Как и в случае с любым набором обучающих данных для машинного обучения, чем больше количество доступных обучающих выборок, тем эффективнее будет обучение. В нашем случае для обучения нам понадобились десятки тысяч песен и их отдельных инструментальных треков; таким образом, общие наборы обучающих музыкальных данных исчислялись тысячами часов.

После обучения нейронной сети, получив на вход песню со смешанными звуками, система выводит несколько разделенных дорожек, пропуская их через нейронную сеть, используя систему, установленную во время обучения.

После разделения записи на составные дорожки следующим шагом является их повторное микширование в запись звуковой сцены. Это достигается процессором сигналов звуковой сцены. Этот процессор звуковой сцены выполняет сложную вычислительную функцию для генерации выходных сигналов, которые управляют динамиками и создают звук звуковой сцены. Входные данные для генератора включают изолированные дорожки, физическое расположение динамиков и желаемое расположение слушателя и источников звука в воссозданном звуковом поле. Выходы процессора звуковой сцены представляют собой многодорожечные сигналы, по одному на каждый канал, для управления несколькими динамиками.

Выходы процессора звуковой сцены представляют собой многодорожечные сигналы, по одному на каждый канал, для управления несколькими динамиками.

Звуковое поле может находиться в физическом пространстве, если оно создается динамиками, или в виртуальном пространстве, если оно создается наушниками. Функция, выполняемая в процессоре звуковой сцены, основана на вычислительной акустике и психоакустике и учитывает распространение звуковых волн и интерференцию в желаемом звуковом поле, а также HRTF для слушателя и желаемого звукового поля.

Например, если слушатель собирается использовать наушники, генератор выбирает набор HRTF на основе конфигурации желаемых местоположений источников звука, а затем использует выбранные HRTF для фильтрации дорожек изолированных источников звука. Наконец, процессор звуковой сцены объединяет все выходы HRTF для создания левой и правой дорожек для наушников. Если музыка будет воспроизводиться на колонках, то нужно как минимум две, но чем больше колонок, тем лучше звуковое поле. Количество источников звука в воссоздаваемом звуковом поле может быть больше или меньше количества динамиков.

Количество источников звука в воссоздаваемом звуковом поле может быть больше или меньше количества динамиков.

Мы выпустили наше первое приложение звуковой сцены для iPhone в 2020 году. Оно позволяет слушателям настраивать, слушать и сохранять музыку звуковой сцены в режиме реального времени — обработка не вызывает заметной временной задержки. Приложение под названием

3D Musica преобразует стереофоническую музыку из личной музыкальной библиотеки слушателя, облака или даже потоковой музыки в звуковую сцену в режиме реального времени. (Для караоке приложение может удалить вокал или вывести любой изолированный инструмент.)

Ранее в этом году мы открыли веб-портал,

3dsoundstage.com, который предоставляет все функции приложения 3D Musica в облаке, а также интерфейс прикладного программирования (API), делающий эти функции доступными для поставщиков потоковой музыки и даже для пользователей любого популярного веб-браузера. Теперь любой может слушать музыку в звуковой сцене практически на любом устройстве.

Когда звук достигает ваших ушей, уникальные характеристики вашей головы — ее физическая форма, форма наружного и внутреннего ушей и даже форма носовых полостей — изменяют звуковой спектр исходного звука.

Мы также разработали отдельные версии программного обеспечения 3D Soundstage для автомобилей, домашних аудиосистем и устройств, чтобы воссоздать трехмерное звуковое поле с использованием двух, четырех и более динамиков. Помимо воспроизведения музыки, мы возлагаем большие надежды на эту технологию в видеоконференциях. У многих из нас был утомительный опыт посещения видеоконференций, на которых мы плохо слышали других участников или не понимали, кто говорит. С помощью звуковой сцены звук можно настроить так, чтобы каждого человека было слышно из определенного места в виртуальной комнате. Или же «местоположение» можно просто назначить в зависимости от положения человека в сетке, типичной для Zoom и других приложений для видеоконференций. По крайней мере, для некоторых видеоконференцсвязь будет менее утомительной, а речь станет более разборчивой.

Точно так же, как звук перешел от моно к стерео и от стерео к объемному и пространственному звуку, теперь он начинает переходить к звуковой сцене. В те ранние эпохи аудиофилы оценивали звуковую систему по ее точности, основанной на таких параметрах, как полоса пропускания,

гармонические искажения, разрешение данных, время отклика, сжатие данных без потерь или с потерями и другие факторы, связанные с сигналом. Теперь звуковая сцена может быть добавлена как еще одно измерение достоверности звука — и, осмелимся сказать, самое фундаментальное. Для человеческого уха влияние звуковой сцены с ее пространственными репликами и захватывающей непосредственностью гораздо важнее, чем постепенное улучшение точности воспроизведения. Эта исключительная функция предлагает возможности, ранее недоступные даже самым состоятельным меломанам.

Технологии способствовали предыдущим революциям в аудиоиндустрии, и теперь они запускают еще одну. Искусственный интеллект, виртуальная реальность и цифровая обработка сигналов подключаются к психоакустике, чтобы дать аудиоэнтузиастам возможности, которых у них никогда не было.