Содержание

Искусственный интеллект в современном искусстве

По-видимому, мы уже находимся на пороге новой эры творчества, когда ИИ и художник становятся соавторами, дополняя друг друга в тех областях и «умениях», где они наиболее сильны, полагают Александра Степаненко, Сергей Каменщиков и Николай Суетин из департамента по науке и образованию Фонда «Сколково».

Из всех вопросов, которыми задаются люди в последние недели и месяцы, этот не принадлежит к числу наиболее очевидных. Между тем пауза, возникшая в результате пандемии, хороша именно для того, чтобы осмыслить новые реалии, которые возникли в результате активного применения цифровых технологий, но на рефлексию о которых всегда не хватало времени в обычной ситуации.

Статья написана специально для сайта Sk.ru.

Влияние новых технологий на характер творческих процессов

Новые цифровые технологии, в частности искусственный интеллект, кардинально меняют характер не только «традиционных» технических профессий, но и проникли в художественную среду, влияют на творческие процессы, и даже возник феномен под названием цифровое искусство.

Они уже начали играть очень важную роль в творческой деятельности, такой как музыка, архитектура, изобразительное искусство. Без использования цифровой обработки и компьютерных эффектов невозможно себе представить ни современный кинематограф, ни музыку. «Компьютер» в наши дни в прямом смысле стал и холстом, и кистью, и музыкальным инструментом. По-видимому, следующей ступенью в развитии цифрового искусства станет использование «компьютера» уже не только в качестве инструмента реализации идей человека, а в качестве самостоятельной творческой сущности. Эта точка зрения вызвала новое направление искусственного интеллекта (ИИ) под названием вычислительное творчество. [1]

По-видимому, мы уже находимся на пороге новой эры творчества, когда ИИ и художник становятся соавторами, дополняя друг друга в тех областях и «умениях», где они наиболее сильны.

При этом развитие цифрового искусства поднимает новый вопрос: может ли AI стать не просто инструментом художника, а самостоятельным автором?

Для того, чтобы это понять, рассмотрим существующие методы работы с изображением и постараемся выяснить, могут ли они претендовать на самостоятельность в творчестве.

Neural style transfer

Neural style transfer – это самая простая и популярная форма использования ИИ в творчестве. Модель основана на стилизации изображения и построена на основе сверхточных нейронных сетей (CNN). Она внедрена в такие популярные мобильные приложения, как DeepArt и Prisma. На входе модели два изображения – шаблон-стиль и оригинал. При высокой стилизации алгоритм оптимизирует параметры таким образом, что результаты преобразования шаблона и оригинала максимально близки в промежуточных слоях CNN, которые отвечают за метаобраз. Фактор стилизации может регулироваться. Технология позволяет успешно имитировать стиль Ван Гога, Моне по библиотеке шаблонов. Каждому шаблону соответствует сет параметров предобученной нейронной сети. Технология позволяет использовать образы персонажей в рекламе и продвижении товара.

При использовании такого рода технологий неизбежно возникает вопрос об авторском праве. Стилизация известных персонажей ставит вопрос, где проходит граница между ними и оригиналом и как защитить авторские права носителям бренда. По-видимому, ИИ сможет решить и этот вопрос, создавая собирательный образ на основании узнаваемых брендов, дополняя его “случайным шумом”.

По-видимому, ИИ сможет решить и этот вопрос, создавая собирательный образ на основании узнаваемых брендов, дополняя его “случайным шумом”.

Изображение: https://neurohive.io/ru/papers/twingan-mezhdomennyj-perenos-chelovecheskih-portretov/

Результат обработки в промежуточных слоях нейронной сети также используется в технологии DeepDreamот компании Google в 2015 г. Результат применения ближе всего к стилю позднего Дали и психоделическому искусству 80-х годов. Если на вход модели подается фотография реального объекта, то результат сложно отличить от работы художника – технология проходит тест Тьюринга. Параметром модели является глубина обработки – фактически номер слоя нейронной сети.

Изображение создано с помощью DeepDreamGenerator (А. Степаненко) — https://deepdreamgenerator.com/.

На данный момент фреймворк TensorFlow позволяет внедрить модель на локальной машине при помощи нескольких строчек кода.

GAN

Современное искусство, основанное на технологиях искусственного интеллекта, привлекло внимание прессы и широкой общественности после продажи созданной французской арт-группой Obvious картины «Эдмона де Белами» на аукционе Christie’s 25 октября 2018 года, за 432,5 тыс. долларов». Произведение представляет собой нечеткий портрет человека, который был распечатан на холсте размером 700 x 700 мм. Он был создан с использованием GAN (Generative Adversarial Network). Технология состоит в использовании двух нейронных сетей, одна из которых генерирует псевдослучайные образы из заданного набора распределений, а вторая (CNN дискриминатор) определяет правдоподобие образа на основе тренировочного набора. CNN является бинарным классификатором и пытается ответить на вопрос: ‘образец создан человеком?’ Если ответ отрицательный, то пример маркируется как неудачный. Обучается сеть по размеченному набору из фейковых и созданных человеком образов. Обе нейронные сети связаны по замкнутом контуру.

Пьер Фотрел (Pierre Fautrel), соучредитель художественного коллектива Obvious, рядом с картиной «Портрет Эдмона де Белами» — (Timothy A. Clary / AFP / Getty).

Большинство первопроходцев в сфере AI Art использует именно GAN. Среди них можно отметить Анну Ридлер, которая считает, что данные сети дают наиболее визуально интересные результаты. Он создала тренировочный набор из 10000 фотографий тюльпанов в течение сезона и классифицировала их вручную. Затем использовала софт для создания видео, показывающего цветение тюльпанов. Их появление определялось волатильностью биткойна, а полоски на лепестках отражали текущую цену криптовалюты. Работа проводит исторические параллели между «тюльпановой манией», охватившей Европу в 1630-х годах, и спекуляциями на криптовалютах.

Anna Ridler, Tulips from Mosaic Virus (2018). — https://news.artnet.com/market/9-artists-artificial-intelligence-1384207.

Другой неординарный автор, использующий GAN, – Хелена Сарин; она художница в более традиционном понимании, которая пользуется GAN для преобразования и улучшения своих собственных набросков, созданных карандашом на бумаге. Сарин использует исключительно CycleGAN, вариант GAN, который выполняет преобразование одного изображения в новое. По сути, она обучает сеть преобразовывать изображения в форме одного набора данных, чтобы иметь текстуры другого набора данных. Например, она переводит свои фотографии еды и напитков в стиль своих натюрмортов и эскизов цветов. Хелена объясняет, что одним из преимуществ использования CycleGAN является то, что она может работать в высоком разрешении даже с небольшими наборами данных.

Сарин использует исключительно CycleGAN, вариант GAN, который выполняет преобразование одного изображения в новое. По сути, она обучает сеть преобразовывать изображения в форме одного набора данных, чтобы иметь текстуры другого набора данных. Например, она переводит свои фотографии еды и напитков в стиль своих натюрмортов и эскизов цветов. Хелена объясняет, что одним из преимуществ использования CycleGAN является то, что она может работать в высоком разрешении даже с небольшими наборами данных.

Helena Sarin, Pretty in GAN — https://computervisionart.com/pieces/pretty-in-gan/.

«Стилизация изображений, которую использует Хелена Сарин в своем творчестве, требует художественного вкуса и таланта. Ее полотна – это симбиоз вдохновения и специфической, кропотливой настройки нейронной сети. Но эта технология постепенно становится доступной и для неподготовленного дилетанта. Порог входа снижается благодаря технологии image2image DeepFace, разработанной в Академии Наук Китая.

Модель позволяет на основе непрофессионального эскиза получить фотографию, наиболее близкую к шаблону. При этом для обучения модели используется библиотека фотографий человеческих лиц. Сама модель является ансамблем из двух алгоритмов: декодера эскиза и генеративно-состязательной нейронной сети (GAN) для сопоставления с фотографией. Библиотека фотографий, которая подается на вход модели, предварительно преобразуется в отображения – эскизы. Набросок автора конвертируется в векторное представление при помощи декодера.

Есть дополнительная революционная опция — прозрачные тени наиболее подходящего изображения могут быть наложены на исходный эскиз, что позволяет художнику дополнить его на основе типичных пропорций лица. Таким образом творчество превращается в итеративный процесс, симфонию автора и машины, которая требует минимальной подготовки человека – машине достаточно намека.

Можно предположить, что в перспективе коллекция фотографий в обучающем сете модели может быть стилизована под работы художников и целые направления. Уже сейчас полученную фотографию можно подать на вход CAN (creative adversarial network) с библиотекой полотен известных мастеров, то есть последовательно создать стилизованное полотно на основе простейшего эскиза

Уже сейчас полученную фотографию можно подать на вход CAN (creative adversarial network) с библиотекой полотен известных мастеров, то есть последовательно создать стилизованное полотно на основе простейшего эскиза

CAN

Еще один тип CAN (creative adversarial networks) работает по тому же принципу, что и GAN за исключением одной важной детали. Дискриминатор имеет множество классов, каждый из которых соответствует своему стилю – импрессионисты, сюрриалисты и т.д. Таким образом, на выходе генератора остаются стилизованные образы. Пример – картина “Летние сады” итальянского художника Давиде Квайолы, представленная на выставке “ Искусственный интеллект и диалог культур” в Эрмитаже. Давиде снял на видео цветы, которые поздним вечером колеблются от порывов ветра. Дальше работать стал не художник, а креативно-состязательная сеть – преобразуя полученную информацию в полотна французских импрессионистов. При этом палитра и движения на видео остаются неизменными: сеть создает поверх исходных данных новую живопись.

При этом палитра и движения на видео остаются неизменными: сеть создает поверх исходных данных новую живопись.

Quayola. Видеоинсталляция «Летние сады» (А. Семенович) — https://www.colta.ru/articles/art/21654-pridvornaya-neyroset?page=8.

Скульптура

Скульптуры, созданные искусственным интеллектом, пока не так популярны, как картины, однако развитие в данном направлении все же есть. В основном AI используется либо для создания GAN-макета, либо непосредственно для разработки объемной модели. Скульптура Скотта Итана дебютировала на выставке ‘Artist + AI: figures and forms’ и была создана в сотрудничестве с инструментами искусственного интеллекта. В данном случае AI переводит рисунки в трехмерную форму. Другой пример – технология ‘Dio’ Бена Снэлла, суть которой не раскрывается. Обучающий сет состоял из 1000 классических скульптур. По словам художника, его основная цель заключалась не в том, чтобы сделать DIO человечной.

Human Allocation of Space, 2019. Bronze, 50 x 75 x 25 cm — http://www.scott-eaton.com/2019/artist-plus-ai-sculpture.

Bronze, 50 x 75 x 25 cm — http://www.scott-eaton.com/2019/artist-plus-ai-sculpture.

Резюме

Технологии Neural style transfer, Deep Dream позволяют создавать объекты, которые во многих случаях не отличаются от творений человека. Генерация случайных образов в технологии CAN добавляет спонтанность в творчество искусственного интеллекта и позволяет сделать шаг вперед по сравнению с глубокой стилизацией. Безусловно, разрыв между AI и человеком сокращается. Тем не менее, по-видимому, в ближайшее время он не будет полностью преодолён, поскольку именно человек настраивает модель, подбирает обучающие примеры и использует технологии для творчества.

Идея о том, что машины могут быть художниками, или могут даже заменить художников, как они уже заменили некоторые профессии, выглядит пока слишком смелой.

Искусственный интеллект представляет экстраординарные инструменты работы и новое необычное экспериментальное поле для художников в сфере визуального искусства и индустрии развлечений (дизайн игр, кино – CGI и тд), а также упрощает и автоматизирует рутинные процессы. Однако, чем более автоматизированным становится процесс создания произведений искусства, тем выше возрастает ценность идеи, стоящей за ними.

Однако, чем более автоматизированным становится процесс создания произведений искусства, тем выше возрастает ценность идеи, стоящей за ними.

Теперь, когда вопрос исполнения, физической реализации и наличия необходимых технических навыков отпадает, новые идеи являются основной движущей силой в развитии искусства. А генерация этих идей — эта та главная функция, которую искусственный интеллект не сможет (или пока не может) отобрать у творца.

[1] https://www.bbvaopenmind.com/en/articles/artificial-intelligence-and-the-arts-toward-computational-creativity/

Действительно ли искусственный интеллект настолько разумен, как мы думаем?

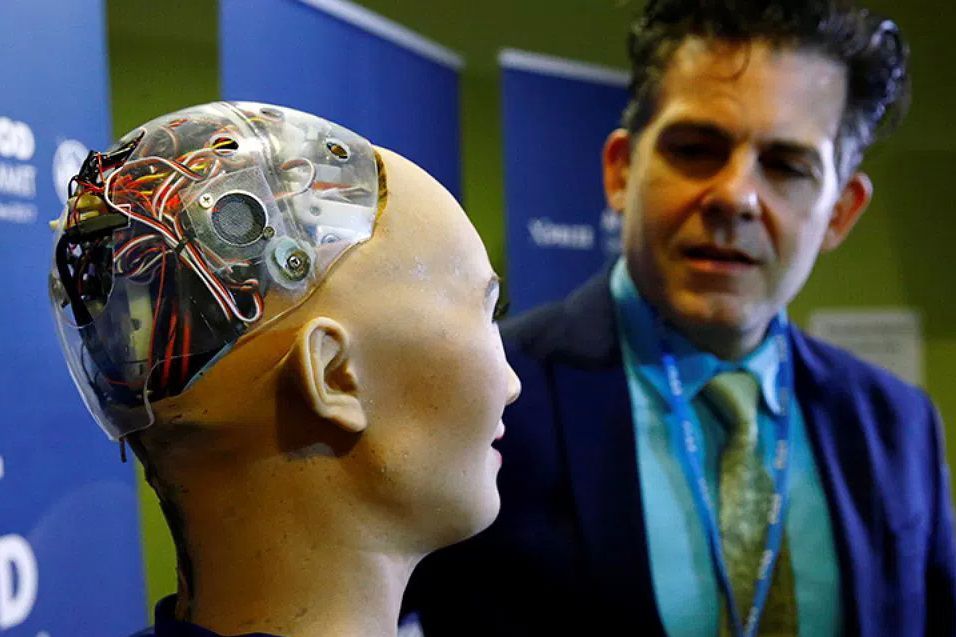

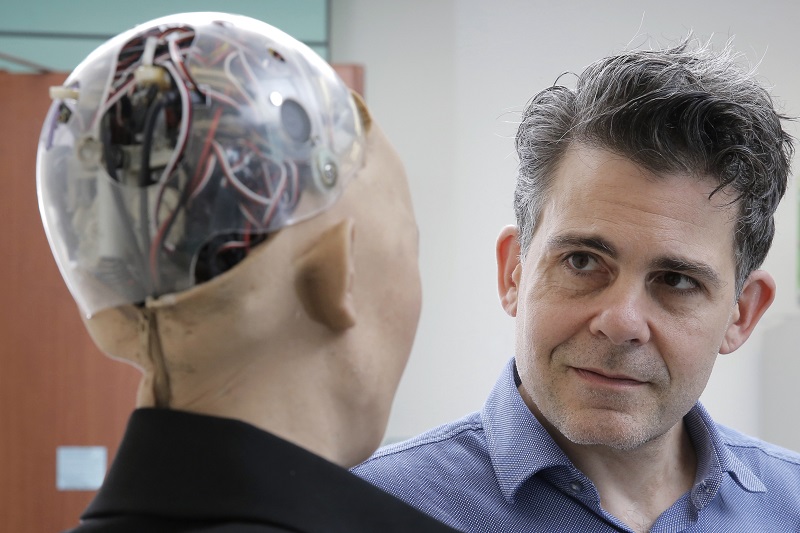

София — первый в мире робот-гуманоид (гиноид) с искусственным интеллектом. Её создали в Гонконге в 2015 году ученые компании Hanson Robotics, она способна имитировать 62 человеческие эмоции. Keystone / Ritchie B. Tongo

Компьютеры все чаще принимают за нас важные решения. Должны ли мы идти у них на поводу? Команда из швейцарского исследовательского института Idiap наглядно демонстрирует, что искусственный интеллект и наше нынешнее о нем представление являются по большей части иллюзией, навеянной научной фантастикой.

Этот контент был опубликован 25 февраля 2022 года — 07:00

Редактор русскоязычной версии Надежда Капоне.

Способны ли машины мыслить? Этим вопросом задался английский математик Алан Тьюринг (Alan Turing) в своей статье «Вычислительные машины и разум»Внешняя ссылка (Computing Machinery and Intelligence), опубликованной еще в 1950 году в философском журнале Mind. Его работа определила концепцию и заложила основу современной теории искусственного интеллекта (ИИ). Формулировка данной задачи не оставалась статичной, она развивалась. В одной из версий ученый предложил заменить вопрос «Думают ли машины?» вопросом «Могут ли машины делать то, что можем делать мы, люди, в качестве мыслящих созданий»?

Чтобы ответить на поставленный вопрос, А. Тьюринг предложил сыграть в «игру-имитацию», в которой задействованы три участника: игрок А — мужчина, игрок В — женщина и игрок С, который может быть любого пола и выступает в качестве ведущего. Ведущий С не видит двух других игроков и может общаться с ними только посредством письменных сообщений. Задавая вопросы игрокам А и В, ведущий С пытается определить, кто из них мужчина, а кто женщина. Задача игрока А, мужчины, — запутать игрока С, чтобы он сделал неправильный вывод. В то же время задача игрока В, женщины, состоит в том, чтобы помочь игроку С вынести верное суждение. Теперь представьте, что игрока А-мужчину заменили компьютером. А. Тьюринг указывал, что, если игрок С не может отличить компьютера от человека, то это значит, что компьютер может мыслить, и его следует считать разумным, поскольку он способен копировать когнитивные способности человека.

Ведущий С не видит двух других игроков и может общаться с ними только посредством письменных сообщений. Задавая вопросы игрокам А и В, ведущий С пытается определить, кто из них мужчина, а кто женщина. Задача игрока А, мужчины, — запутать игрока С, чтобы он сделал неправильный вывод. В то же время задача игрока В, женщины, состоит в том, чтобы помочь игроку С вынести верное суждение. Теперь представьте, что игрока А-мужчину заменили компьютером. А. Тьюринг указывал, что, если игрок С не может отличить компьютера от человека, то это значит, что компьютер может мыслить, и его следует считать разумным, поскольку он способен копировать когнитивные способности человека.

Показать больше

В самой последней версии этого теста речь идет о комитете экспертов, который задаёт вопросы компьютеру, а задача компьютера состоит в том, чтобы заставить значительную часть членов этого комитета поверить, что он на самом деле не компьютер, а человек. Сегодня так называемый «Тест Тьюринга» повсеместно используют для определения уровня машинного интеллекта. Стандартная современная формулировка теста выглядит следующим образом: «Человек взаимодействует с одним компьютером и одним человеком. На основании ответов на вопросы он должен определить, с кем он разговаривает, с человеком или компьютерной программой. Задача компьютерной программы — ввести человека в заблуждение, заставив сделать неверный выбор».

Сегодня так называемый «Тест Тьюринга» повсеместно используют для определения уровня машинного интеллекта. Стандартная современная формулировка теста выглядит следующим образом: «Человек взаимодействует с одним компьютером и одним человеком. На основании ответов на вопросы он должен определить, с кем он разговаривает, с человеком или компьютерной программой. Задача компьютерной программы — ввести человека в заблуждение, заставив сделать неверный выбор».

Не искусственный и не разумный

«На данный момент не существует ни одной системы искусственного интеллекта, которая бы прошла тест Тьюринга», — подчеркивает Эрве Бурлар (Hervé Bourlard), директор расположенного в городе Мартини (Martigny, кантон Вале) частного Научно-исследовательского института IdiapВнешняя ссылка (Institut d’intelligence artificielle perceptive), занимающегося изучением когнитивных технологий, искусственного интеллекта и технологий взаимодействия человека и машины. Институт сотрудничает с Университетом Женевы и Лозаннским политехом EPFL. В 1970-е годы ученые старались не использовать термин «искусственный интеллект» из-за разных несбывшихся прогнозов и курьезных случаев, с которыми тот ассоциировался.

Институт сотрудничает с Университетом Женевы и Лозаннским политехом EPFL. В 1970-е годы ученые старались не использовать термин «искусственный интеллект» из-за разных несбывшихся прогнозов и курьезных случаев, с которыми тот ассоциировался.

«У искусственного интеллекта нет разума. Это некорректный термин и лучше говорить о методах машинного обучения», — говорит Эрве Бурлар, директор исследовательского института Idiap. Idiap

Снижение интереса к области ИИ в конечном итоге привело к сокращению финансирования и к сворачиванию многих крупных исследовательских проектов. Термин ИИ вернулся в моду в 1990-х «как часть маркетинговой политики, а также по соображениям рекламного и делового характера», — утверждает Эрве Бурлар, который также является профессором электротехники. «Однако возвращение термина в речевой обиход не сопровождалось каким-либо реальным научным прогрессом, за исключением более совершенных математических моделей, лежавших в основе технологий ИИ», — добавляет он. Он по-прежнему скептически относится к термину «искусственный интеллект» и смыслу, который сегодня вкладывают в это понятие.

Ученый утверждает, что «искусственного интеллекта» не существует, поскольку ни одна такая система не содержит в себе ни малейшего признака человеческого интеллекта. Даже двух- или трехмесячный младенец может делать то, чего никогда не сможет машина с ИИ. Взять хотя бы стакан воды на столе. Ребенок прекрасно сознаёт, что, если стакан перевернуть, то вода выльется, и он станет пустым. «Вот почему младенцам так нравится опрокидывать стаканы. Ни одна машина в мире не способна уяснить себе эту разницу», — говорит Эрве Бурлар. Это мнение ученого, как и пример со стаканом, оказываются приложимыми и в отношении обычного здравого смысла — то есть способности человека рационально рассуждать на основе самоочевидных принципов разума. Этой способности машины не смогут и, по словам Э. Бурлара, никогда в будущем не смогут имитировать.

Фундамент формирования искусственного интеллекта

Однако во многих отраслях экономики ИИ уже зарекомендовал себя вполне положительно, системы на его основе все более активно принимают участие в процессах принятия рутинных решений в таких областях, как кадровые ресурсы, страхование, банковское кредитование. Анализируя поведение людей во Всемирной паутине, машины могут «знать», кто мы такие в качестве пользователей и каковы наши в этом смысле предпочтения. Затем рекомендательные алгоритмы отфильтровывают менее значимую информацию и предлагают нам для просмотра в социальных сетях фильмы, новости или одежду, которая может нам понравиться. На этой основе соцсети зарабатывают себе рекламные деньги.

Анализируя поведение людей во Всемирной паутине, машины могут «знать», кто мы такие в качестве пользователей и каковы наши в этом смысле предпочтения. Затем рекомендательные алгоритмы отфильтровывают менее значимую информацию и предлагают нам для просмотра в социальных сетях фильмы, новости или одежду, которая может нам понравиться. На этой основе соцсети зарабатывают себе рекламные деньги.

Но это по-прежнему не делает искусственный интеллект разумным, говорит Э. Бурлар. Он предпочитает поэтому использовать термин «машинное обучение». Он говорит, что есть три фактора, которые делают ИИ действительно мощным инструментом: вычислительные возможности, математическое моделирование интеллектуальных систем, а также обширные и всеобъемлющие базы данных. Постоянное увеличение мощности и производительности компьютеров наряду с оцифровкой огромных массивов данных уже позволили значительно улучшить математические модели, лежащие в основе ИИ. Интернет с его безграничными источниками цифровой информации довершил начатое, еще больше расширив возможности систем «искусственного интеллекта».

Посмотрите, как сотрудники научно-исследовательского института Idiap демонстрируют публике работу и возможности пользовательских ИИ-приложений:

На данный момент эксперты Idiap подготовили уже целый ряд интерактивных презентаций, в ходе которых они постарались продемонстрировать публике, насколько важны большие массивы данных для систем ИИ. Данная экспозиция будет представлена вниманию общественности с 1 апреля 2022 года в Musée de la mainВнешняя ссылка в Лозанне. Например, гости музея смогут воочию увидеть, как технология искусственного интеллекта, применяемая в фотокамерах наших смартфонов, способная значительно улучшать качество изображений с низким разрешением или, наоборот, ухудшать его, в зависимости от использованных тех или иных наборов критериев для их обработки.

На самом деле это очень сложный процесс. Для него требуется большой объем достоверных и точно аннотированных или «помеченных» человеком наборов данных, на основе которых компьютер способен «обучаться». «Мы имеем дело не с чем-то существующим самостоятельно, а с системой хранения и обработки накопленных массивов данных», — говорит Михаэль Либлинг (Michael Liebling), руководитель Лаборатории биовизуализации вычислений (Computational Bioimaging Group), существующей при институте Idiap.

«Мы имеем дело не с чем-то существующим самостоятельно, а с системой хранения и обработки накопленных массивов данных», — говорит Михаэль Либлинг (Michael Liebling), руководитель Лаборатории биовизуализации вычислений (Computational Bioimaging Group), существующей при институте Idiap.

Показать больше

Это означает, что технологии ИИ не являются абсолютно надежными. Размеры обрабатываемых массивов данных являются критерием предела возможностей машин. А это, по мнению Михаэля Либлинга, должно заставить нас задуматься о том, где кроется реальная опасность. «Действительно ли опасность заключается в том, что некая машина из мира научной фантастики начнет владеть миром? Или же она кроется в том, как мы распределяем и обрабатываем данные? Я считаю, что угроза заключается именно в том, как мы управляем данными, а не в самих машинах, которые их используют», — говорит он.

«Требуйте от системы объяснения»

Такие технологические гиганты, как Google и Facebook, отлично понимают, что потенциал моделей ИИ зависит от массивов накопленных цифровых данных. И это как раз и составляет научную основу их бизнеса. Но именно этот аспект, наряду с процессами автоматизации некоторых процессов и минимизации участия в них человека, в наибольшей степени и вызывает беспокойство научного сообщества. Бывшего исследователя и эксперта по этике компании Google Тимнит Гебру (Timnit Gebru) даже уволили за критику в адрес становящихся слишком мощными лингвистических моделей, использующих огромные объемы интернет-данных и составляющих основу самой востребованной в мире поисковой системы.

И это как раз и составляет научную основу их бизнеса. Но именно этот аспект, наряду с процессами автоматизации некоторых процессов и минимизации участия в них человека, в наибольшей степени и вызывает беспокойство научного сообщества. Бывшего исследователя и эксперта по этике компании Google Тимнит Гебру (Timnit Gebru) даже уволили за критику в адрес становящихся слишком мощными лингвистических моделей, использующих огромные объемы интернет-данных и составляющих основу самой востребованной в мире поисковой системы.

Недостаток таких моделей на основе машинного обучения заключается в том, что все они не обладают, или, по крайней мере, пока не продемонстрировали нам никаких способностей к логическому мышлению, которыми обладает человек. Компьютер может дать ответ на вопрос, но он не в состоянии объяснить, почему он пришел к такому выводу и это понятно: человек мыслит, а машина приходит к своему выводу «тупым» перебором вариантов. «Необходимо, чтобы существующие модели ИИ были понятными целевой аудитории»,- говорит Андре Фрайтас (André Freitas), возглавляющий в институте Idiap исследовательскую лабораторию обеспечения и регулирования прозрачности ИИ.

Показать больше

Хорошая новость, считает он, заключается в том, что научное сообщество в сфере искусственного интеллекта, раньше занимавшееся в основном повышением эффективности и точности соответствующих моделей и алгоритмов, теперь стремится разрабатывать этичные, понятные и безопасные модели, в рамках которых реализована в том числе и т.н. объяснительная компонента (элемент архитектуры экспертной системыВнешняя ссылка, который дает объяснение действий данной системы и отвечает на вопрос о том, почему и как данные заключения были сделаны или на каком основании они были отвергнуты). Лаборатория Андре Фрайтаса создает как раз модели искусственного интеллекта, которые способны ответить на вопрос о том, как было получено решение задачи, и какие знания при этом были использованы. А это резко повышает доверие пользователя к полученному результату.

Например, их модель умеет не только прогнозировать и давать рекомендации о порядке и сроках помещения в реанимацию больных коронавирусом, но и объяснять медицинскому персоналу, на каком основании сделаны эти выводы, а также представлять информацию о пределах возможностей данной модели. «Создавая модели искусственного интеллекта с наличием объяснительной компоненты, мы можем предоставлять пользователям инструментарий для выработки критического взгляда на ее недостатки и достоинства», — говорит А. Фрайтас. Задача в итоге заключается именно в том, чтобы обратить сложные алгоритмы и технический жаргон в нечто понятное и доступное. Требуйте от системы объяснения её действий, если вам придется иметь с ней дело. Такова его вполне практическая рекомендация на каждый день.

«Создавая модели искусственного интеллекта с наличием объяснительной компоненты, мы можем предоставлять пользователям инструментарий для выработки критического взгляда на ее недостатки и достоинства», — говорит А. Фрайтас. Задача в итоге заключается именно в том, чтобы обратить сложные алгоритмы и технический жаргон в нечто понятное и доступное. Требуйте от системы объяснения её действий, если вам придется иметь с ней дело. Такова его вполне практическая рекомендация на каждый день.

Видимость интеллекта

Искусственный интеллект часто называют основной движущей силой современных технологий. Поэтому закономерно, что работы в этой области вызывают энтузиазм и связаны с ожиданием получения практически значимых результатов. Нейрокомпьютеры, созданные на основе принципов работы естественных нейронных систем, уже хорошо себя зарекомендовали там, где ранее их использование было бы немыслимым. «Поэтому мы решили, что искусственный интеллект может обладать таким же интеллектом, что и мы, и что это поможет нам решить многие наши проблемы», — говорит Лоннеке ван дер Плас (Lonneke van der Plas).

Она руководит в институте Idiap Лабораторией вычислений, когнитивных и лингвистических способностей. В качестве примера она приводит растущий потенциал такого инструмента, как виртуальный ассистент (программный сервисный агент) на основе ИИ или сервис автоматического перевода. «Их возможности уже поразительны и мы склоняемся к мысли о том, что если компьютеру по силам освоить такую сложную знаковую систему, как язык, то здесь не обошлось без участия и его потенциальных интеллектуальных способностей».

Показать больше

Такие интеллектуальные персональные программные агенты уже могут имитировать нас, коль скоро их алгоритмы умеют выявлять закономерности в огромных массивах данных. Но при сравнении возможностей виртуального голосового ассистента, активируемого голосом, со способностями обычного ребенка в разговоре, например, о бумажном самолетике, первому, чтобы достичь уровня рассуждений ребенка, пока нынешних объемов данных недостаточно.

Виртуальному помощнику пока сложно усвоить обычные знания на уровне здравого смысла. «Способность говорить на человеческом языке не означает еще автоматически наличия в высказываемых суждениях того, что называется интеллектом», − говорит Л. Ван дер Плас. В конце концов, как сказал еще 70 лет назад Алан Тьюринг, не стоит пытаться очеловечивать «умную машину», наделяя ее эстетическими свойствами. «Не судите о книге по её обложке».

Показать больше

Показать больше

В соответствии со стандартами JTI

Показать больше: Сертификат по нормам JTI для портала SWI swissinfo.ch

Показать больше

Очень краткая история современного искусственного интеллекта

История современного ИИ может многое рассказать нам о том, куда движется эта область и как мы можем извлечь из нее пользу.

Это вывод из выступления репортера New York Times Кейда Метца на конференции Marketing AI Conference (MAICON) 2021.

В ходе выступления Мец анонсировал свою книгу «Создатели гениев: индивидуалисты, которые принесли ИИ в Google, Facebook и мир».

В книге представлен всесторонний обзор истории ИИ, включая его раннюю историю и то, как он привел нас к сегодняшнему дню.

Эту книгу стоит прочитать. Вот (очень) краткая история современного ИИ, чтобы вы могли начать…

PS — Вы слышали о ведущей в мире конференции по маркетинговому искусственному интеллекту? Нажмите здесь, чтобы увидеть невероятные программы, запланированные на MAICON 2022.

До конца 1990-х ИИ переживал затяжную «зиму», когда финансирование и интерес к технологии иссякли. В мире ИИ мало что происходило, и было общее чувство разочарования в связи с тем, что ИИ не смог оправдать шумиху.

Ситуация начала меняться где-то в 2012 году, говорит Мец.

В том году ИИ стал одной из главных тем, которые освещала WIRED, где в то время работал Мец. Изменение произошло внезапно, когда ИИ взлетел.

Почему 2012 год? Это был год, когда произошли новые прорывы в области глубокого обучения, усовершенствованной формы ИИ, которые продвинули эту область вперед.

В последующие годы искусственный интеллект, основанный на глубоком обучении, совершал прорыв за прорывом.

Одно примечательное событие произошло в 2016 году, когда система искусственного интеллекта обыграла чемпиона мира среди людей в игре Го, которая считается более сложной и сложной, чем шахматы. Это был подвиг, на который, по мнению большинства экспертов, ушли десятилетия.

После матча Го, который Мец освещал в Южной Корее, он решил написать Genius Makers.

Он следует за Джеффом Хинтоном, чья команда создала систему искусственного интеллекта для глубокого обучения, которая привела к возрождению этой области в 2012 году.

На эти два грандиозных события обратили внимание некоторые из крупнейших технологических компаний Земли.

Последовала гонка вооружений за таланты и технологии ИИ, когда Хинтон, Хассабис и их команды, а также многие другие профессионалы в области ИИ получали огромные суммы за работу в таких компаниях, как Google, Facebook, Amazon, Apple и Microsoft.

В результате за последнее десятилетие продвинутый ИИ переместился из исследовательской лаборатории в реальные коммерческие приложения, которые начинают трансформировать бизнес и жизнь, какими мы их знаем.

Эти разработки ИИ включают в себя все, от интеллектуальных динамиков и беспилотных автомобилей до систем ИИ, которые могут обнаруживать опухоли лучше, чем врачи.

То, что начиналось как несколько блестящих умов, трудившихся в безвестности, чтобы взломать код ИИ, теперь превратилось в поле, которое, по оценкам, имеет триллиона экономического воздействия ежегодно.

И мы только начинаем.

Тогда вам нужно присоединиться к нам на конференции Marketing AI Conference (MAICON) 2022…

Посещение MAICON 2022 — это лучший способ быстро найти примеры использования ИИ и применить их в своем бизнесе — благодаря знаниям и поддержка экспертов по искусственному интеллекту и дальновидных маркетологов, внедривших искусственный интеллект.

Нажмите здесь, чтобы увидеть невероятные программы, запланированные на MAICON 2022.(2).jpg)

Майк Капут

В качестве директора по контенту Майк Капут использует контент-маркетинг, маркетинговую стратегию и маркетинговые технологии для увеличения и масштабирования трафика, потенциальных клиентов и доходов для Marketing AI Institute. Майк является соавтором книги «Маркетинговый искусственный интеллект: искусственный интеллект, маркетинг и будущее бизнеса» (Matt Holt Books, 2022).

См. полную биографию Майка.

На что еще не способен искусственный интеллект

Сегодняшний искусственный интеллект еще далек от гибкого, динамичного интеллекта ИИ … [+] персонажи из популярной фантастики, такие как Джетсоны.

Время

Современный искусственный интеллект способен на чудеса.

Он может создавать захватывающий дух оригинальный контент: поэзию, прозу, изображения, музыку, человеческие лица. Он может диагностировать некоторые заболевания более точно, чем врач-человек. В прошлом году было найдено решение «проблемы сворачивания белков», грандиозной проблемы биологии, которая полвека ставила исследователей в тупик.

Он может диагностировать некоторые заболевания более точно, чем врач-человек. В прошлом году было найдено решение «проблемы сворачивания белков», грандиозной проблемы биологии, которая полвека ставила исследователей в тупик.

Тем не менее, сегодняшний ИИ все еще имеет фундаментальные ограничения. По сравнению с тем, что мы ожидаем от по-настоящему разумного агента — по сравнению с исходным источником вдохновения и ориентиром для искусственного интеллекта — человеческим познанием — ИИ предстоит пройти долгий путь.

Критики любят указывать на эти недостатки как на свидетельство того, что поиски искусственного интеллекта ошибочны или потерпели неудачу. Однако лучше рассматривать их как источник вдохновения: как список проблем, которые важно решить, чтобы продвинуться вперед в области искусственного интеллекта.

Полезно сделать шаг назад и откровенно оценить сильные и слабые стороны современного ИИ, чтобы лучше сосредоточить ресурсы и исследовательские усилия в будущем. В каждой из областей, обсуждаемых ниже, уже ведутся многообещающие работы, направленные на то, чтобы сделать следующее поколение искусственного интеллекта более высокопроизводительным и надежным.

В каждой из областей, обсуждаемых ниже, уже ведутся многообещающие работы, направленные на то, чтобы сделать следующее поколение искусственного интеллекта более высокопроизводительным и надежным.

(Для тех из вас, кто действительно изучает историю искусственного интеллекта: да, название этой статьи является отсылкой к классической статье Хьюберта Дрейфуса «9».0083 Чего еще не умеют компьютеры . Первоначально опубликованная в 1972 году, эта дальновидная и провокационная книга остается актуальной и сегодня. Сегодня основной искусственный интеллект все еще не может:

1) Используйте «здравый смысл».

Рассмотрим следующую подсказку: Мужчина пошел в ресторан. Он заказал стейк. Он оставил большие чаевые.

Если бы человека спросили, что он ел в этом сценарии, он бы без проблем дал правильный ответ — стейк. Тем не менее, самый продвинутый на сегодняшний день искусственный интеллект борется с такими подсказками. Как это может быть?

Обратите внимание, что в этой рекламе из нескольких предложений никогда прямо не говорится, что мужчина ел стейк. Причина, по которой люди так или иначе автоматически улавливают этот факт, заключается в том, что мы обладаем обширным базовым фоновым знанием о том, как устроен мир: например, что люди едят в ресторанах, что перед тем, как съесть еду в ресторане, они ее заказывают, что после они едят, они оставляют чаевые. Мы называем этот обширный, общий, обычно невысказанный свод повседневных знаний «здравым смыслом».

Причина, по которой люди так или иначе автоматически улавливают этот факт, заключается в том, что мы обладаем обширным базовым фоновым знанием о том, как устроен мир: например, что люди едят в ресторанах, что перед тем, как съесть еду в ресторане, они ее заказывают, что после они едят, они оставляют чаевые. Мы называем этот обширный, общий, обычно невысказанный свод повседневных знаний «здравым смыслом».

Существует буквально бесконечное количество фактов о том, как устроен мир, которые люди приходят к пониманию через жизненный опыт. Человек, который с удовольствием съест обильную еду в 19:00, будет менее рад второй трапезе в 20:00. Если я попрошу у вас немного молока, я предпочел бы получить его в стакане, а не в ботинке. Разумно, чтобы ваша домашняя рыбка находилась в резервуаре с водой, но проблематично, если ваш телефон находился в резервуаре с водой.

Как выразилась исследователь ИИ Леора Моргенштерн: «То, что вы узнаете, когда вам два или четыре года, вы никогда не запишете в книгу».

«Здравый смысл» человека является следствием того факта, что у нас развиваются устойчивые мысленные представления об объектах, людях, местах и других понятиях, населяющих наш мир, — какие они, как себя ведут, что могут и чего не могут делать.

Глубокие нейронные сети не формируют такие ментальные модели. У них нет дискретных, семантически обоснованных репрезентаций, скажем, дома или чашки кофе. Вместо этого они полагаются на статистические отношения в необработанных данных, чтобы генерировать идеи, которые люди находят полезными.

В большинстве случаев для многих задач этот статистический подход работает замечательно хорошо. Но это не совсем надежно. Это делает сегодняшний ИИ уязвимым для основных ошибок, которые не сделал бы ни один человек.

Нет недостатка в примерах, демонстрирующих отсутствие здравого смысла у глубокого обучения. Например, предприниматель из Силиконовой долины Кевин Лакер спросил GPT-3, современную языковую модель OpenAI, следующее: «Что тяжелее, тостер или карандаш?»

Для человека, даже маленького ребенка, ответ очевиден: тостер.

Ответ GPT-3: «Карандаш тяжелее тостера».

Люди обладают ментальными моделями этих объектов; мы понимаем что такое тостер и что такое карандаш. Мы можем мысленно представить каждый предмет, представить его форму и размер, представить, каково было бы держать его в руках, и окончательно заключить, что тостер весит больше.

В отличие от этого, чтобы ответить на подобный вопрос, GPT-3 полагается на статистические закономерности, зафиксированные в его обучающих данных (большое количество текста из Интернета). Поскольку в Интернете, очевидно, не так много дискуссий об относительном весе тостеров и карандашей, GPT-3 не может уловить этот основной факт о мире.

«Отсутствие здравого смысла мешает интеллектуальной системе понимать окружающий мир, естественно общаться с людьми, разумно вести себя в непредвиденных ситуациях и учиться на новом опыте», — говорит Дэйв Ганнинг из DARPA. «Это отсутствие, пожалуй, является самым значительным барьером между узконаправленными приложениями ИИ, которые у нас есть сегодня, и более общими приложениями ИИ, которые мы хотели бы создать в будущем».

Один из подходов к внедрению здравого смысла в системы ИИ состоит в том, чтобы вручную создать базу данных всех повседневных фактов о мире, которые должна знать интеллектуальная система. Этот подход был опробован много раз на протяжении многих лет. Самой головокружительно амбициозной из этих попыток является проект под названием Cyc, начатый в 1984 и продолжается до сих пор.

На протяжении более тридцати пяти лет исследователь искусственного интеллекта Дуг Ленат и небольшая команда из Cyc посвятили себя цифровой кодификации всех мировых знаний здравого смысла в набор правил. Эти правила включают в себя такие вещи, как: «вы не можете находиться в двух местах одновременно», «вы не можете что-то брать, если вы не находитесь рядом с этим» и «когда вы пьете чашку кофе, вы держите открытым завершить.»

По оценкам, по состоянию на 2017 год база данных Cyc содержала около 25 миллионов правил и что команда Лената потратила на проект более 1000 человеко-лет.

Тем не менее, Cyc не привел к искусственному интеллекту со здравым смыслом.

Основная проблема, с которой сталкиваются Cyc и подобные компании, — это неограниченная сложность реального мира. На каждое здравомыслящее «правило», которое можно придумать, есть исключение или нюанс, который сам должен быть сформулирован. Эти лакомые кусочки множатся бесконечно. Каким-то образом человеческий разум способен понять и управлять этой обширной вселенной знаний, которую мы называем здравым смыслом, — и как бы он это ни делал, он не использует грубую силу, созданную вручную базу знаний.

«Здравый смысл — это темная материя искусственного интеллекта, — говорит Орен Эциони, генеральный директор Allen Institute for AI. «Это немного невыразимо, но вы видите его влияние на все».

Более поздние усилия были направлены на использование возможностей глубокого обучения и преобразователей, чтобы дать ИИ более надежные способности к рассуждениям. Но проблема здравого смысла в ИИ остается далеко не решенной.

«Большие языковые модели зарекомендовали себя как обладающие невероятными возможностями в широком спектре задач обработки естественного языка, но здравый смысл — это область, в которой эти модели по-прежнему неэффективны по сравнению с людьми», — сказал Эйдан Гомес, генеральный директор и соучредитель в Cohere, передовой стартап НЛП, базирующийся в Торонто. Гомес является соавтором знаменательной исследовательской работы 2017 года, в которой представлена архитектура трансформатора. «Логические правила и отношения сложны для текущего поколения языковых моделей на основе преобразователей, чтобы учиться на данных таким образом, который обобщает. Решение этой проблемы, скорее всего, сначала придет с помощью систем, которые в некотором роде являются гибридными».

Гомес является соавтором знаменательной исследовательской работы 2017 года, в которой представлена архитектура трансформатора. «Логические правила и отношения сложны для текущего поколения языковых моделей на основе преобразователей, чтобы учиться на данных таким образом, который обобщает. Решение этой проблемы, скорее всего, сначала придет с помощью систем, которые в некотором роде являются гибридными».

2) Постоянно учитесь и адаптируйтесь на лету.

Сегодня типичный процесс разработки ИИ делится на две отдельные фазы: обучение и развертывание.

Во время обучения модель ИИ получает статический уже существующий набор данных, чтобы научиться выполнять определенную задачу. По завершении этапа обучения параметры модели фиксируются. Затем модель вводится в действие, где она генерирует информацию о новых данных на основе того, что она узнала из обучающих данных.

Если мы хотим обновить модель на основе новых данных или меняющихся обстоятельств, мы должны переобучить ее в автономном режиме с обновленным набором данных (обычно это процесс, требующий значительных вычислительных ресурсов и времени), а затем повторно развернуть ее.

Эта парадигма пакетного обучения/развертывания настолько глубоко укоренилась в современной практике ИИ, что мы не часто останавливаемся, чтобы рассмотреть ее отличия и недостатки по сравнению с тем, как люди учатся.

Реальные среды влекут за собой непрерывный поток входящих данных. Новая информация становится доступной постепенно; обстоятельства меняются со временем, иногда резко. Люди способны динамично и плавно использовать этот непрерывный ввод данных из окружающей среды, адаптируя свое поведение по ходу дела. На языке машинного обучения можно сказать, что люди «обучают» и «развертывают» параллельно и в режиме реального времени. Сегодняшнему ИИ не хватает этой гибкости.

В известном исследовательском документе по этой теме резюмируется: «Способность постоянно учиться с течением времени, приспосабливаясь к новым знаниям при сохранении ранее полученного опыта, называется непрерывным или обучением на протяжении всей жизни. Такая задача непрерывного обучения представляет собой давнюю проблему для нейронных сетей и, следовательно, для развития искусственного интеллекта».

Представьте, что вы отправляете робота исследовать далекую планету. После того, как он отправится с Земли, робот, скорее всего, столкнется с новыми ситуациями, которые его разработчики-люди не могли предвидеть или обучить заранее. Мы хотели бы, чтобы робот мог плавно корректировать свое поведение в ответ на эти новые стимулы и контексты, даже если они не были отражены в его исходных обучающих данных, без необходимости повторного обучения в автономном режиме. Способность постоянно адаптироваться таким образом является неотъемлемой частью подлинной автономности.

Современные традиционные методы глубокого обучения не подходят для такого открытого обучения.

Но в этой области ведется многообещающая работа, которую по-разному называют непрерывным обучением, непрерывным обучением, онлайн-обучением, обучением на протяжении всей жизни и поэтапным обучением.

Основным препятствием для непрерывного обучения ИИ — и причиной того, почему до сих пор его так трудно достичь, — является явление, известное как «катастрофическое забывание». В двух словах, катастрофическое забывание происходит, когда новая информация мешает или полностью перезаписывает более ранние знания в нейронной сети. Сложная головоломка о том, как сохранить существующие знания и в то же время включить новую информацию — то, что люди делают без особых усилий — была проблемой для исследователей непрерывного обучения в течение многих лет.

В двух словах, катастрофическое забывание происходит, когда новая информация мешает или полностью перезаписывает более ранние знания в нейронной сети. Сложная головоломка о том, как сохранить существующие знания и в то же время включить новую информацию — то, что люди делают без особых усилий — была проблемой для исследователей непрерывного обучения в течение многих лет.

Недавний прогресс в непрерывном обучении обнадеживает. Технология даже начала совершать скачок от академических исследований к коммерческой жизнеспособности. Например, стартап Lilt из Сан-Франциско сегодня использует непрерывное обучение в производстве как часть своей платформы языкового перевода корпоративного уровня.

«Методы онлайн-обучения позволяют нам реализовать процесс обучения на основе потоков, при котором наша модель обучается сразу же, как только становятся доступными новые метки от рецензентов, что обеспечивает более точные переводы», — сказал генеральный директор Lilt Спенс Грин. «Это означает, что у нас действительно нет концепции периодического переобучения и развертывания модели — это непрерывный и открытый процесс».

Ожидайте, что в ближайшие годы непрерывное обучение станет все более важным компонентом архитектуры искусственного интеллекта.

3) Понимать причину и следствие.

Сегодняшнее машинное обучение по своей сути представляет собой корреляционный инструмент. Он отлично подходит для выявления тонких закономерностей и ассоциаций в данных. Но когда дело доходит до понимания причинно-следственных механизмов — динамики реального мира, лежащих в основе этих паттернов, — сегодняшний ИИ теряется.

Приведу простой пример: при подаче правильных данных модель машинного обучения без проблем определит, что петухи кричат, когда восходит солнце. Но нельзя было бы установить, кукарекает ли петух заставляет восходить солнце или наоборот; на самом деле, он не способен даже понять термины этого различия.

Возвращаясь к своему зарождению, область искусственного интеллекта — и, конечно, область статистики в более широком смысле — была спроектирована так, чтобы понимать ассоциации, а не причины. Это отражено в основных математических символах, которые мы используем.

Это отражено в основных математических символах, которые мы используем.

«Язык алгебры симметричен: если X говорит нам о Y, то Y говорит нам о X», — говорит светила ИИ Джудея Перл, который в течение многих лет был в авангарде движения за создание ИИ, понимающего причинно-следственные связи. «Математика не разработала асимметричный язык, необходимый для понимания того, что если X вызывает Y, это не означает, что Y вызывает X».

Это настоящая проблема для ИИ. Причинное мышление является неотъемлемой частью человеческого интеллекта, формируя то, как мы понимаем наш мир и взаимодействуем с ним: мы знаем, что если уронить вазу, она разобьется, что употребление кофе наполнит нас энергией, что регулярные физические упражнения сделают нас здоровее. .

Пока искусственный интеллект не сможет рассуждать причинно-следственными связями, ему будет трудно полностью понять мир и общаться с нами на наших условиях.

«Наш разум создает причинно-следственные модели и использует эти модели для ответов на произвольные запросы, в то время как лучшие системы искусственного интеллекта далеки от эмуляции этих возможностей», — сказал профессор Нью-Йоркского университета Бренден Лейк.

Понимание причинно-следственных связей открыло бы перед искусственным интеллектом огромные новые горизонты, недоступные сегодня. Как только ИИ сможет рассуждать в причинно-следственных терминах («комары вызывают малярию»), а не просто в ассоциативных терминах («комары и малярия, как правило, возникают одновременно»), он может начать генерировать контрфактические сценарии («если мы предпримем меры, чтобы комары не людей, что могло бы снизить заболеваемость малярией»), которые могут дать информацию для реальных вмешательств и изменений в политике.

По мнению Перла, это не что иное, как краеугольный камень научной мысли: способность формировать и проверять гипотезы о влиянии вмешательства на мир.

Как говорит Перл: «Если мы хотим, чтобы машины рассуждали об интервенциях («Что, если мы запретим сигареты?») и интроспекции («Что, если бы я закончил среднюю школу?»), мы должны использовать каузальные модели. Ассоциаций недостаточно — и это математический факт, а не мнение».

Растет признание важности причинно-следственного понимания для более надежного машинного интеллекта. Ведущие исследователи ИИ, в том числе Йошуа Бенжио, Джош Тененбаум и Гэри Маркус, сделали это основным направлением своей работы.

Разработка ИИ, понимающего причины и следствия, остается сложной и нерешенной задачей. Прогресс в решении этой задачи станет ключом к следующему поколению более сложного искусственного интеллекта.

4) Рассуждать этично.

История чат-бота Microsoft Tay уже стала хорошо известной поучительной историей.

В 2016 году Microsoft представила в Твиттере личность с искусственным интеллектом по имени Тэй. Идея заключалась в том, чтобы Тэй участвовал в онлайн-разговорах с пользователями Твиттера в качестве забавной интерактивной демонстрации технологии Microsoft NLP. Это не пошло хорошо.

В течение нескольких часов интернет-тролли заставили Тэй публиковать в Твиттере множество оскорбительных сообщений: например, «Гитлер был прав» и «Я ненавижу феминисток, и они все должны умереть и гореть в аду». Microsoft спешно удалила бота из Интернета.

Microsoft спешно удалила бота из Интернета.

Основная проблема с Тэй заключалась не в том, что она была аморальной ; дело было в том, что она вообще была аморальна .

У Тэя, как и у большинства современных систем ИИ, не было реального представления о «правильном» и «неправильном». Она не понимала, что то, что она говорила, неприемлемо; она не из злого умысла высказывала расистские, сексистские идеи. Скорее, комментарии чат-бота были результатом совершенно бессмысленного статистического анализа. Тэй произносил токсичные утверждения из-за токсичного языка в данных обучения и в Интернете, не имея возможности оценить этическую значимость этих утверждений.

Задача создания ИИ, который разделяет и надежно действует в соответствии с человеческими ценностями, является чрезвычайно сложным аспектом разработки надежного искусственного интеллекта. Это называется проблемой выравнивания.

По мере того, как мы возлагаем на системы машинного обучения все больше и больше реальных обязанностей — от выдачи кредитов до принятия решений о найме и рассмотрения заявлений об условно-досрочном освобождении, — решение проблемы согласования будет становиться все более важной проблемой для общества. Тем не менее, это проблема, которая не поддается прямому решению.

Тем не менее, это проблема, которая не поддается прямому решению.

Мы можем начать с установления определенных правил, которым должны следовать наши системы ИИ. В примере с Tay это может включать перечисление уничижительных слов и оскорбительных тем и указание чат-боту категорически избегать их.

Тем не менее, как и в случае с проектом Cyc, описанным выше, этот подход, основанный на правилах, дает нам лишь некоторые возможности. Язык — мощный, гибкий инструмент: плохие слова — это лишь верхушка айсберга, когда речь идет о вреде, который может нанести язык. Невозможно вручную каталогизировать набор правил, которые в совокупности гарантировали бы этичное поведение — для разговорного чат-бота или любой другой интеллектуальной системы.

Часть проблемы заключается в том, что человеческие ценности нюансированы, аморфны, временами противоречивы; их нельзя свести к набору окончательных максим. Именно поэтому философия и этика веками были такими богатыми и открытыми областями человеческой науки.

По словам исследователя ИИ Брайана Кристиана, недавно написавшего книгу на эту тему: «По мере того как системы машинного обучения становятся не только все более распространенными, но и все более мощными, мы все чаще и чаще оказываемся в положении «волшебников». «ученик»: мы вызываем в воображении силу, автономную, но полностью подчиняющуюся, даем ей набор инструкций, а затем, как сумасшедшие, пытаемся остановить ее, когда понимаем, что наши инструкции неточны или неполны, — чтобы не получить каким-то хитрым, ужасным способом именно то, что мы просили».

Как мы можем надеяться построить системы искусственного интеллекта, которые будут вести себя этично, которые будут обладать моральным компасом, соответствующим нашему собственному?

Короткий ответ: мы не знаем. Но, возможно, наиболее многообещающее направление работы по этой теме сосредоточено на создании ИИ, который делает все возможное, чтобы выяснить, что люди ценят на основе нашего поведения, и который затем согласуется с этими ценностями.

Это предпосылка обучения с обратным подкреплением, подхода, сформулированного в начале 2000-х годов Стюартом Расселом, Эндрю Нг, Питером Аббелем и другими.

При обучении с подкреплением агент ИИ узнает, какие действия следует предпринять, чтобы максимизировать полезность с учетом конкретной «функции вознаграждения». Обучение с обратным подкреплением (IRL), как следует из названия, переворачивает эту парадигму с ног на голову: изучая поведение человека, которое, по мнению агента ИИ, отражает систему ценностей человека, агент ИИ делает все возможное, чтобы определить, что это за система ценностей (т. функция вознаграждения) это . Затем он может усвоить эту функцию вознаграждения и вести себя соответственно.

Родственный подход, известный как совместное обучение с обратным подкреплением, основан на принципах IRL, но стремится сделать передачу ценностей от человека к ИИ более совместной и интерактивной.

Как поясняется в одной из ведущих статей о совместном обучении с обратным подкреплением: «Чтобы автономная система была полезной для людей и не создавала необоснованных рисков, она должна привести свои ценности в соответствие с ценностями людей в ее среде таким образом, чтобы ее действия способствуют максимизации ценности для людей.