Содержание

Какие законы робототехники нужны бизнесу в XXI веке

Страх перед неизвестностью – на втором месте в списке препятствий для использования ИИ в бизнесе

Второго января исполнилось 100 лет со дня рождения фантаста Айзека Азимова – автора сборника рассказов «Я, робот». Азимов перевернул восприятие искусственного интеллекта (ИИ) в обществе: до этой книги о роботах говорили как о механических чудищах, которые хотят уничтожить мир. В 1941 г. писатель сформулировал три правила для роботов, которые позволяли им решать сложные задачи без угрозы для жизни людей: не причинять вред человеку, подчиняться его приказам, заботиться о своей безопасности, если это не противоречит первым двум законам. С того времени прошло больше 70 лет – попробуем разобраться, как изменился за это время ИИ и можно ли сегодня подчинить его трем законам.

От ящика к «человеку»

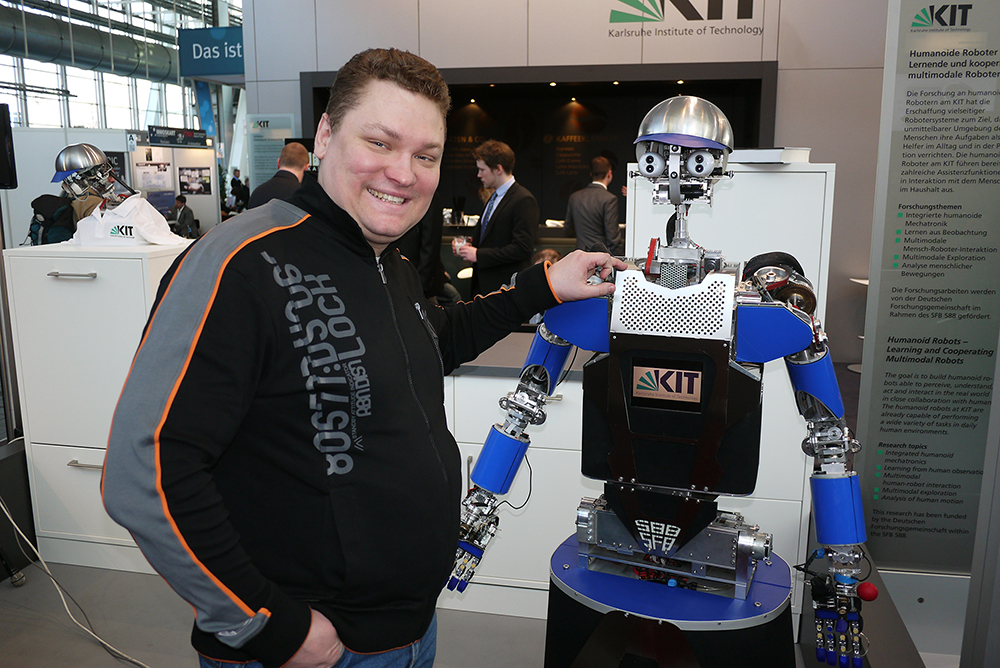

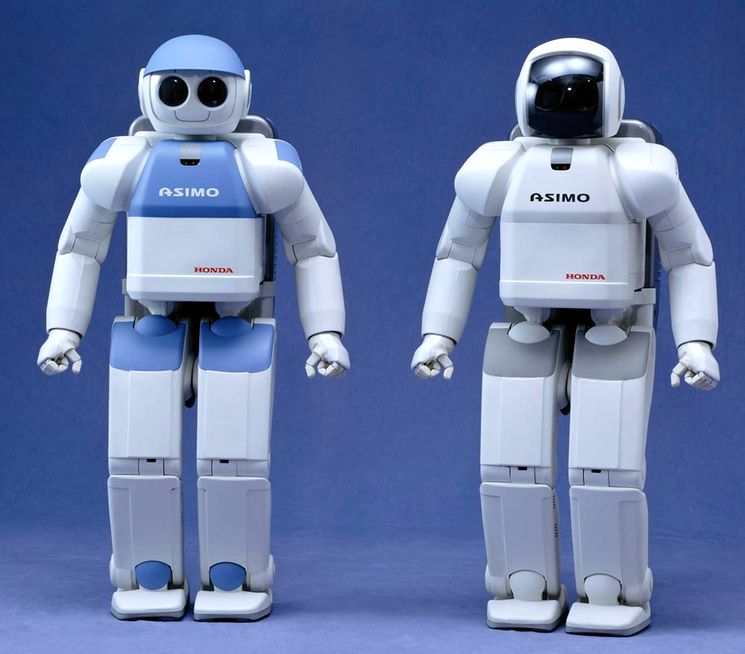

Роботы в эпоху Азимова были похожи на железные коробки. Три колеса, два моторчика, реле, конденсаторы – так выглядели предшественники трюкачей от Boston Dynamics. В 90% случаев они занимались тяжелым и опасным ручным трудом: двигали ящики на складе, хватали раскаленные детали автомобилей, позже собирали камни на Луне. Теперь же роботы становятся похожими на человека настолько, что иногда их можно принять за нас самих. Созданная несколько лет назад человекоподобный робот София от Hanson Robotics выглядела зловеще: криво улыбалась и не моргала. В 2019 г. на японском телевидении появилась механическая ведущая Эрика. Она еще не умеет двигать руками, но благодаря распознаванию речи понимает, кто говорит, поворачивается к нему и отвечает на вопросы. В голову Эрики встроено 14 инфракрасных сенсоров, лицо может выражать несложные эмоции. Конечно, разработчикам еще предстоит преодолеть «эффект зловещей долины». Это бессознательное отвращение, которое возникает, когда люди смотрят на человекоподобное существо, но маленькие детали выдают в нем не-человека. Возможно, поэтому производитель Geomiq обещал заплатить $130 000 обладателю «доброго и дружелюбного» лица, который поделится своим образом с тысячами андроидов.

В 90% случаев они занимались тяжелым и опасным ручным трудом: двигали ящики на складе, хватали раскаленные детали автомобилей, позже собирали камни на Луне. Теперь же роботы становятся похожими на человека настолько, что иногда их можно принять за нас самих. Созданная несколько лет назад человекоподобный робот София от Hanson Robotics выглядела зловеще: криво улыбалась и не моргала. В 2019 г. на японском телевидении появилась механическая ведущая Эрика. Она еще не умеет двигать руками, но благодаря распознаванию речи понимает, кто говорит, поворачивается к нему и отвечает на вопросы. В голову Эрики встроено 14 инфракрасных сенсоров, лицо может выражать несложные эмоции. Конечно, разработчикам еще предстоит преодолеть «эффект зловещей долины». Это бессознательное отвращение, которое возникает, когда люди смотрят на человекоподобное существо, но маленькие детали выдают в нем не-человека. Возможно, поэтому производитель Geomiq обещал заплатить $130 000 обладателю «доброго и дружелюбного» лица, который поделится своим образом с тысячами андроидов. С этой целью ведутся и эксперименты в области мультимодальных коммуникаций: ученые анализируют, как мы говорим, улыбаемся, какие жесты используем, чтобы научить им интеллектуальных помощников. Это необходимо компаниям, если они хотят, чтобы потребители доверяли машинам – особенно когда речь идет о здоровье, больших деньгах или сложном моральном выборе.

С этой целью ведутся и эксперименты в области мультимодальных коммуникаций: ученые анализируют, как мы говорим, улыбаемся, какие жесты используем, чтобы научить им интеллектуальных помощников. Это необходимо компаниям, если они хотят, чтобы потребители доверяли машинам – особенно когда речь идет о здоровье, больших деньгах или сложном моральном выборе.

Другие роботы в ходе эволюции лишились железного тела и превратились в компьютерные программы. Эти системы называют Robotic process automation (RPA). Они не поднимают грузы, а автоматизируют рутинные офисные задачи, которые делать скучно: скопировать файл, перенести контакты в базу, отослать тысячам контрагентов напоминание, что надо оплатить счет. Достоинство, но и недостаток таких технологий – полное соблюдение второго закона Азимова. Они буквально повинуются всем приказам человека. Кажется, что это хорошо. Но представим, что инструкцию составили неправильно, забыли какой-то шаг. Робот выполнит все, как ему сказали, ошибется, да еще и сделает это в десятки раз быстрее человека. Неудивительно, что до 30% проектов RPA заканчиваются провалом – такие данные приводит EY. Решить проблему помогают другие интеллектуальные технологии, а именно – процессная аналитика. Они изучают, как выстроен бизнес-процесс в компании, определяют, с какими из задач справится робот, и позволяют учить их более эффективно. Process Mining используют многие компании: Uber, Vodafone, Siemens, Heineken, в России – ВТБ, Tele2 и другие крупные игроки.

Неудивительно, что до 30% проектов RPA заканчиваются провалом – такие данные приводит EY. Решить проблему помогают другие интеллектуальные технологии, а именно – процессная аналитика. Они изучают, как выстроен бизнес-процесс в компании, определяют, с какими из задач справится робот, и позволяют учить их более эффективно. Process Mining используют многие компании: Uber, Vodafone, Siemens, Heineken, в России – ВТБ, Tele2 и другие крупные игроки.

Роботы Азимова были универсальными: один персонаж мог и нянчиться с ребенком, и собирать детали на заводе. Современные же технологии почти всегда используются для конкретных задач. Если алгоритм оценивает закупки и находит оптимальных поставщиков, то он не может за один день переучиться выдавать кредиты. Впрочем, благодаря развитию transfer learning neural architecture search машины уже умеют получать дополнительные навыки в смежных областях. Например, если нейросеть анализирует рисковые факторы в новостях о банках, можно научить ее работать с похожими сообщениями о производителях сырья, фермах, а также читать новостные ленты на других языках.

Корпорации и три закона

Персонажи книги «Я, робот» решали задачи науки. Они выполняли эксперименты, искали ресурсы на далеких планетах и собирали образцы для новых исследований. Технологические разработки нашего времени в первую очередь нужны крупным корпорациям. Посмотрим, кто на мировом рынке активно работает с ИИ. Будь то обработка естественного языка, компьютерное зрение или распознавание голоса, список один и тот же: Google, Facebook, Microsoft, Amazon. Их совокупные инвестиции в ИИ превышают триллионы долларов. Крупнейшую сделку закрыл Microsoft, вложив $1 млрд в OpenAI – организацию, которая ведет разработки в области глубокого машинного обучения, распознавания объектов, генерации текста. В гонку включился и российский бизнес. По данным исследования IDC и ABBYY, в котором участвовало более 200 компаний, в 2019 г. объем инвестиций в эти технологии составил $139 млн, и эти вложения будут расти на 30% ежегодно до 2023 г.

Как в эту картину мира вписывается Азимов со своим гуманизмом, принципом «не навреди», верой в то, что роботы должны помогать человечеству? Все решило общественное мнение. Последний десяток лет компании работали с ИИ так же, как и с любым другим инструментом. Инвестировали деньги, чтобы сократить затраты: уволить больше людей и стать эффективнее. Но оказалось, что такое отношение к ИИ приносит компаниям убытки. Сотрудники и клиенты начинают бояться роботов и выступать против их использования. Отсюда бесконечные вопросы: что я буду делать, если за меня все сделают роботы? Могу ли я доверять ИИ так же, как человеку? Как работать в команде с роботом? По данным исследования Gartner «3 Barriers to AI Adoption», страх перед неизвестностью – на втором месте в списке препятствий для использования ИИ в бизнесе. На первом месте – отсутствие у сотрудников навыков для работы с этими технологиями.

Последний десяток лет компании работали с ИИ так же, как и с любым другим инструментом. Инвестировали деньги, чтобы сократить затраты: уволить больше людей и стать эффективнее. Но оказалось, что такое отношение к ИИ приносит компаниям убытки. Сотрудники и клиенты начинают бояться роботов и выступать против их использования. Отсюда бесконечные вопросы: что я буду делать, если за меня все сделают роботы? Могу ли я доверять ИИ так же, как человеку? Как работать в команде с роботом? По данным исследования Gartner «3 Barriers to AI Adoption», страх перед неизвестностью – на втором месте в списке препятствий для использования ИИ в бизнесе. На первом месте – отсутствие у сотрудников навыков для работы с этими технологиями.

Именно поэтому сначала три закона пришли в области, которые связаны со здоровьем людей и опасным трудом: в критической ситуации доверять машине необходимо на все 100. Роботы успешно ассистируют врачам в хирургических операциях. Соблюдая законы Азимова, Omnicell M5000 помогает выбирать наборы лекарств для пациентов. Задача этой технологии – раскладывать таблетки и капсулы по блистерам, учитывая аллергии и противопоказания. Микророботы перемещаются по крови человека к злокачественной опухоли и уничтожают вредоносные клетки. Технологии не только автоматизируют медицинские процессы, но и позволяют правильно выстроить их, чтобы люди не тратили время в очередях, быстро получали результаты анализов, сразу попадали к нужному специалисту. На других планетах роботы помогают людям искать воду, изучать рельеф, строить укрытия в зонах радиационного излучения.

Задача этой технологии – раскладывать таблетки и капсулы по блистерам, учитывая аллергии и противопоказания. Микророботы перемещаются по крови человека к злокачественной опухоли и уничтожают вредоносные клетки. Технологии не только автоматизируют медицинские процессы, но и позволяют правильно выстроить их, чтобы люди не тратили время в очередях, быстро получали результаты анализов, сразу попадали к нужному специалисту. На других планетах роботы помогают людям искать воду, изучать рельеф, строить укрытия в зонах радиационного излучения.

Кажется, что время пересмотреть отношения с роботами и ИИ пришло и для других сфер бизнеса. Банки, страховые компании, промышленные гиганты понимают, что успешно применять ИИ смогут только те, кто создает эффективные команды из людей и роботов. По данным CPL Jobs, в будущем мы поделим свои задачи с ИИ так: 80% рутины будут делать машины, 20% – люди. В работе с данными наши обязанности разделятся в пропорции 50 на 50%. В нестандартных задачах, требующих творческого мышления, 80% работы останется человеку. В такой тесной связке с технологиями без новых правил игры, в том числе и для людей, не обойтись. Будет ли для этого достаточно только трех законов Азимова – вопрос остается открытым.

В такой тесной связке с технологиями без новых правил игры, в том числе и для людей, не обойтись. Будет ли для этого достаточно только трех законов Азимова – вопрос остается открытым.

Новости СМИ2

Отвлекает реклама? С подпиской

вы не увидите её на сайте

Новые законы робототехники — Будущее на vc.ru

{«id»:13750,»url»:»\/distributions\/13750\/click?bit=1&hash=b1d715eb6d286e4b109b9def89f28c6d4baa907ccd63efd692e129a599d9ef3d»,»title»:»\u0427\u0442\u043e \u043f\u043e\u0434 \u043a\u0430\u043f\u043e\u0442\u043e\u043c \u00ab\u0412\u041a\u043e\u043d\u0442\u0430\u043a\u0442\u0435\u00bb \u2014 \u0440\u0430\u0441\u0441\u043a\u0430\u0437\u044b\u0432\u0430\u0435\u0442 \u043b\u0438\u0447\u043d\u043e CTO»,»buttonText»:»\u0423\u0437\u043d\u0430\u0442\u044c»,»imageUuid»:»4ff989b3-22e8-5296-a1f9-0451c0fb663b»,»isPaidAndBannersEnabled»:false}

Многим известны 5 законов робототехники Азимова, однако, Айзек не строил роботов, хотя и сформулированные законы он придумал вполне лаконично.

169

просмотров

Теперь же есть люди, для которых создание алгоритмов, управляющих крупными (и опасными) объектами – настоящая работа. Одна из таких – Ольга Ускова, основатель компании Cognitive Pilot.

Cognitive Pilot — один из ведущих мировых разработчиков систем искусственного интеллекта для транспортных средств.

Компания занимается разработкой систем автономного управления для сельскохозяйственной техники (комбайны, опрыскиватели, тракторы), железнодорожного транспорта (локомотивы, поезда, трамваи) и автомобильного транспорта. Также Cognitive Pilot разрабатывает и производит радары гражданского назначения в качестве сенсоров нового поколения для задач автоматизации транспорта и промышленных применений.

Взято из Фейсбука Ольги:

«Контроль над ИИ тривиален.

Кому сейчас страшнее всего?

Упёртым Редукционистам (люди, которые считают, что сложное сводится к простому и высшее к низшему. Исповедуют принцип, согласно которому сложные явления могут быть полностью объяснены с помощью законов, свойственных явлениям более простым)

Они совершенно потерялись в этом новом мире нейросетевого ИИ и машин, которые понимают. ..

..

Как всякие растерянные люди, они тут же обратили взор к пророкам Апокалипсиса. Новая мантра которых — Самосовершенствующийся ИИ захватывает мир.

Осмелюсь заметить, что разработчикам достаточно придерживаться нескольких базовых несложных правил, чтобы контролировать ИИ полностью:

1. Переключатель мощности.

В одном из рассказов обожаемого Роберта Шекли была история, как предприниматели купили у старьевщика забавную машину по производству некоей материи, которая создавала ее прямо из энергии пространства и не требовала затрат на комплектующие. Рассудив, что полученное однозначно больше чем ничего и какую-то копеечку они по-любому заработают, ребята нажали кнопку «ВКЛ», и только потом обнаружили, что рычага «Выкл.» нет …

Я это к тому, что если вы строите SkyNet без кнопки выключения, вы заслуживаете Апокалипсис.

2. Строго ограниченная функциональность.

Стоит задача — управлять комбайном и собирать кукурузу — выполняет. Сменили культуру на рожь, смените подсистему. Не делайте универсального всезнающего монстра.

Не делайте универсального всезнающего монстра.

3. Перекрыть доступа к источникам.

Например, современные Als — это не LISP-облака, где данные и код одинаковы. Возьмите за правило — выпущена версия продукта, она неизменна до следующей версии.

4. Механизмы «понимания» в современных нейронных системах, должны быть полностью отделены от механизмов «рассуждения».

Нам нужен Искусственный Помощник Машиниста «понимающий» полностью все происходящее на дороге и выполняющий разрешенные сценарием действия. Но нам не нужен «Искусственный» шофер, рассуждающий:

» А имеет ли смысл в принципе сегодня выезжать из гаража?»

«Рассуждения» сами по себе не возникают. Не приписывайте этому процессу ничего мистического. Как запрограммируем, так и будет.

5. Полный кураторский контроль за процессом обучения нейронных систем.

Если дать очень приличному нейронному алгоритму свободно шарить в Интернете, типа — информация лишней не бывает, то он в какой-то момент обнаружит «Майн Кампф» и Вам прийдется срочно воспользоваться рычагом «Выкл», если Вы конечно не забыли его запрограммировать, см. п.1.

п.1.

6. Ну и последнее, очевидное.

Даже в пароксизме прикольного изобретательства не приделывайте к многофункциональному ИИ всяких дополнительных устройств, которые вы подсмотрели в игрe Mortal Kombat или в школьных сражениях роботов. Мы вот не разрешаем на комбайны с Cognitive Agro Pilot мастырить огнемёты. Мало ли чего….»

Новые законы робототехники

Профессор Фрэнк Паскуале

После десятилетий технологических прорывов искусственный интеллект стал частью нашей повседневной жизни. Руководящие принципы для законодательства и политики в области ИИ необходимы, если мы хотим извлечь выгоду из его огромного потенциала, продолжая при этом концентрировать человеческий опыт в экономике и предотвращать появление машин.

Ставки технического прогресса растут с каждым днем. Объедините базы данных распознавания лиц со все более дешевыми микродронами, и вы получите анонимную глобальную силу убийц с беспрецедентной точностью и смертоносностью. Но то, что может убить, может и вылечить; роботы могли бы значительно расширить доступ к медицине, если бы мы больше инвестировали в их исследования и разработку. Компании уже предпринимают тысячи небольших шагов к автоматизации найма, обслуживания клиентов и даже управления.

Но то, что может убить, может и вылечить; роботы могли бы значительно расширить доступ к медицине, если бы мы больше инвестировали в их исследования и разработку. Компании уже предпринимают тысячи небольших шагов к автоматизации найма, обслуживания клиентов и даже управления.

Все эти разработки меняют баланс между машинами и людьми в нашей повседневной жизни. Сейчас искусственный интеллект и робототехника чаще всего дополняют, а не заменяют человеческий труд. Во многих областях мы должны использовать наши существующие институты управления для сохранения этого статус-кво. Чтобы избежать наихудших результатов в революции ИИ и извлечь выгоду из ее потенциала, будет зависеть от нашей способности взращивать мудрость в отношении этого баланса.

Однако добиться этого результата будет непросто. Повествование о массовой безработице в настоящее время захватывает политиков, которые предвидят будущее, в котором человеческие работники станут излишними из-за все более мощного программного обеспечения, роботов и прогнозной аналитики, которые выполняют работу так же хорошо за небольшую часть нынешней заработной платы. Это видение предлагает суровые альтернативы: создавать роботов или быть замененными ими.

Это видение предлагает суровые альтернативы: создавать роботов или быть замененными ими.

Возможна и другая история, более правдоподобная. Практически во всех сферах жизни роботизированные системы могут сделать труд более ценным, а не менее ценным. Даже сейчас врачи, медсестры, учителя, помощники по домашнему здравоохранению, журналисты и другие сотрудничают с робототехниками и учеными-компьютерщиками над разработкой инструментов для будущего своей профессии, а не смиренно служат источниками данных для будущих замен. Их отношения сотрудничества являются прообразом технологического прогресса, который может улучшить здравоохранение, образование и многое другое для всех нас, сохраняя при этом содержательную работу.

Они также показывают, как закон и государственная политика могут помочь нам достичь мира и всеобщего процветания, а не «гонки против машин». Мы сможем сделать это только в том случае, если обновим законы робототехники, которые определяют наше видение технического прогресса.

Старые законы

В рассказе 1942 года «Обход» писатель-фантаст Айзек Азимов сформулировал три закона для своих механических персонажей:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

- Робот должен подчиняться приказам, отдаваемым ему людьми, за исключением случаев, когда такие приказы противоречат Первому закону.

- Робот должен защищать свое существование до тех пор, пока такая защита не противоречит Первому или Второму Закону.

Законы робототехники Азимова оказали огромное влияние на писателей-фантастов и вдохновленных ими технологов. Они кажутся четкими, но их нелегко применять. Рассмотрим, например, разрешают ли законы Азимова автомобили-роботы. Самоуправляемые транспортные средства обещают ежегодно устранять многие тысячи дорожно-транспортных происшествий, но также могут лишить работы сотни тысяч платных водителей. Дает ли этот вред правительствам право запрещать или замедлять внедрение беспилотных автомобилей? Эти и многие другие неясности объясняют, почему законы, постановления и судебные дела, касающиеся робототехники и ИИ в нашем мире, более детализированы, чем законы Азимова.

Я предлагаю четыре новых закона робототехники, которые помогут нам двигаться вперед. Они направлены на людей, создающих роботов, а не на самих роботов, и лучше отражают то, как осуществляется фактическое законотворчество.

Правило первое: Роботизированные системы и ИИ должны дополнять профессионалов, а не заменять их

Для политиков до сих пор остается открытым вопрос, какие барьеры на пути роботизации имеют смысл, а какие заслуживают тщательного изучения и устранения. Роботизированные мясорубки имеют смысл; роботизированный детский сад заставляет нас задуматься. Является ли это предостережение простой реакцией луддитов или отражением более глубокого понимания природы детства?

На стремительное развитие автоматизации влияют многочисленные факторы, многие из которых специфичны для рабочих мест и юрисдикций. Но одним из организационных принципов является важность значимой работы для самоуважения людей и управления сообществами. Гуманная повестка дня для автоматизации будет отдавать приоритет инновациям, которые дополняют работников на должностях, которые являются или должны выполнять призвание. Это заменит машины для выполнения опасной или унизительной работы, в то же время гарантируя тем, кто в настоящее время выполняет эту работу, справедливое вознаграждение за свой труд и предложит переход к другим социальным ролям.

Гуманная повестка дня для автоматизации будет отдавать приоритет инновациям, которые дополняют работников на должностях, которые являются или должны выполнять призвание. Это заменит машины для выполнения опасной или унизительной работы, в то же время гарантируя тем, кто в настоящее время выполняет эту работу, справедливое вознаграждение за свой труд и предложит переход к другим социальным ролям.

Правило второе: Роботизированные системы и ИИ не должны подделывать человечество

Со времен Азимова до головокружительной имитации Ex Machina и Westworld перспектива человекоподобных роботов была одновременно захватывающей и пугающей. Программы машинного обучения уже освоили искусство создания изображений «фальшивых людей», а убедительные синтетические голоса вскоре могут стать обычным явлением. Пока инженеры пытаются отладить эти алгоритмы, остается незаданным более важный вопрос: хотим ли мы жить в мире, где люди не знают, имеют ли они дело с человеком или с машиной?

Несмотря на растущий этический консенсус в отношении раскрытия информации об использовании алгоритмов и умных машин во взаимодействии с пользователями, существуют области ИИ, посвященные тому, чтобы нам было еще труднее различать людей и машины. Эти исследовательские проекты могут завершиться созданием продвинутых андроидов из наших научно-фантастических фильмов, неотличимых от человека. Тем не менее, в больницах, школах, полицейских участках и даже на производственных предприятиях от воплощения программного обеспечения в гуманоидных телах мало что можно выиграть, а можно многое потерять.

Эти исследовательские проекты могут завершиться созданием продвинутых андроидов из наших научно-фантастических фильмов, неотличимых от человека. Тем не менее, в больницах, школах, полицейских участках и даже на производственных предприятиях от воплощения программного обеспечения в гуманоидных телах мало что можно выиграть, а можно многое потерять.

Правило третье: Роботизированные системы и ИИ не должны усиливать гонку вооружений с нулевой суммой

Дебаты о «роботах-убийцах» являются центральным полем этики в международном праве. Есть много сценариев, по которым в будущем может начаться гонка вооружений. По мере того, как на сцену выходят искусственный интеллект и робототехника, ставки отставания от конкурентов возрастают, поскольку новые технологии обещают быть гораздо более целенаправленными, повсеместными и быстро развертываемыми. Эти технологии и тактика, в том числе новые системы вооружений, автоматические кибератаки и кампании по дезинформации, угрожают разрушить давно сложившиеся представления о цели и пределах международного конфликта. Мы должны найти новые пути ограничения их развития и воздействия.

Мы должны найти новые пути ограничения их развития и воздействия.

Смертоносные и агрессивные технологии, впервые разработанные армиями, могут быть использованы за пределами поля боя. Сегодня все больше правоохранительных органов стремятся использовать распознавание лиц для поиска преступников в толпе. В Китае правительство использует «социальные кредитные рейтинги», созданные на основе данных наблюдения, чтобы определить, на какие поезда или самолеты может сесть гражданин, в каких гостиницах человек может остановиться и в какие школы могут ходить дети семьи.

Некоторые приложения этих систем могут быть весьма ценными, например, наблюдение за общественным здравоохранением, которое ускоряет отслеживание контактов, чтобы остановить распространение инфекционных заболеваний. Однако, когда одни и те же мощные способности ранжируют и оценивают всех и всегда, они становятся угнетающими.

Правило четвертое: Роботизированные системы и ИИ всегда должны указывать личность своего создателя(ей), контролера(ов) и владельца(ей)

Существует расплывчатое понятие «вышедших из-под контроля» роботов, ускользающих от своего создателя. Возможно, такие аварии неизбежны. Тем не менее, какое-то физическое или юридическое лицо должно нести за них ответственность. Требование, чтобы у любой системы искусственного интеллекта или робототехники была определенная сторона, ответственная за ее действия, помогло бы пресечь такие проекты, которые могут быть столь же опасными, как и нерегулируемая биоинженерия вирусов.

Возможно, такие аварии неизбежны. Тем не менее, какое-то физическое или юридическое лицо должно нести за них ответственность. Требование, чтобы у любой системы искусственного интеллекта или робототехники была определенная сторона, ответственная за ее действия, помогло бы пресечь такие проекты, которые могут быть столь же опасными, как и нерегулируемая биоинженерия вирусов.

Конечно, некоторые роботы и алгоритмы будут развиваться в сторону от идеалов, заложенных в них их владельцами, в результате взаимодействия с другими людьми и машинами. Что бы ни влияло на эволюцию таких машин, первоначальный создатель должен быть обязан встроить определенные ограничения на эволюцию кода, чтобы одновременно фиксировать влияния и предотвращать плохие результаты. Как только другое лицо или организация взламывает или отключает эти ограничения, хакер несет ответственность за правонарушения робота.

Будущее возможностей

Разговоры о роботах обычно тяготеют к утопии («машины сделают всю грязную, опасную или тяжелую работу») или антиутопии («…и все остальное, создающее массовую безработицу»). Но будущее автоматизации на рабочем месте — и далеко за его пределами — будет зависеть от миллионов небольших решений о том, как развивать ИИ. Насколько следует доверять машинам выполнение задач, ранее выполнявшихся людьми? Что они приобретают и теряют при этом? Каково оптимальное сочетание роботизированного и человеческого взаимодействия? И как различные правила — будь то кодексы профессиональной этики, страховые полисы или законодательные акты — влияют на масштабы и темпы роботизации в нашей повседневной жизни? Ответы на эти вопросы могут в значительной степени определить, обещает ли автоматизация революцию роботов или медленное, осторожное улучшение того, как выполняется работа.

Но будущее автоматизации на рабочем месте — и далеко за его пределами — будет зависеть от миллионов небольших решений о том, как развивать ИИ. Насколько следует доверять машинам выполнение задач, ранее выполнявшихся людьми? Что они приобретают и теряют при этом? Каково оптимальное сочетание роботизированного и человеческого взаимодействия? И как различные правила — будь то кодексы профессиональной этики, страховые полисы или законодательные акты — влияют на масштабы и темпы роботизации в нашей повседневной жизни? Ответы на эти вопросы могут в значительной степени определить, обещает ли автоматизация революцию роботов или медленное, осторожное улучшение того, как выполняется работа.

Слишком много технологов стремятся быстро заменить людей в тех областях, где нам не хватает данных и алгоритмов для качественного выполнения этой работы. Тем временем политики склонны к фатализму, регулярно сетуя на то, что регулирующие органы и суды не поспевают за технологическим прогрессом.

Триумфализм в техническом сообществе и минимализм среди политиков преждевременны. По мере того, как роботы входят в состав рабочей силы, у нас есть прекрасная возможность формировать их развитие с помощью продуманных правовых стандартов конфиденциальности и защиты прав потребителей. Мы можем направить технологии через закон. Мы можем отстаивать культуру обслуживания, а не разрушения, дополнять людей, а не заменять их. Мы можем достичь и позволить себе мир, которым правят люди, а не машины. Будущее робототехники может быть инклюзивным и демократичным, отражающим усилия и надежды всех граждан. И новые законы робототехники могут помочь нам в этом путешествии.

По мере того, как роботы входят в состав рабочей силы, у нас есть прекрасная возможность формировать их развитие с помощью продуманных правовых стандартов конфиденциальности и защиты прав потребителей. Мы можем направить технологии через закон. Мы можем отстаивать культуру обслуживания, а не разрушения, дополнять людей, а не заменять их. Мы можем достичь и позволить себе мир, которым правят люди, а не машины. Будущее робототехники может быть инклюзивным и демократичным, отражающим усилия и надежды всех граждан. И новые законы робототехники могут помочь нам в этом путешествии.

Выдержки из книги Фрэнка Паскуале «Новые законы робототехники: защита человеческого опыта в эпоху ИИ », опубликованной издательством Belknap Press издательства Гарвардского университета. Авторские права © 2020, президент и члены Гарвардского колледжа. Используется с разрешения. Все права защищены.

Законы робототехники Айзека Азимова неверны

Когда люди говорят о роботах и этике, они всегда вспоминают «Три закона робототехники» Айзека Азимова. Но есть три основные проблемы с этими законами и их использованием в нашем реальном мире.

Но есть три основные проблемы с этими законами и их использованием в нашем реальном мире.

Законы

Законы Азимова изначально включали в себя три правила для машин:

- Закон первый: «Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред».

- Второй закон — «Робот должен подчиняться приказам, отданным ему людьми, за исключением случаев, когда такие приказы противоречат Первому закону».

- Третий закон — «Робот должен защищать свое существование, пока такая защита не противоречит Первому или Второму закону».

- Позже Азимов добавил «Закон Нуля» выше всех остальных: «Робот не может причинить вред человечеству или своим бездействием позволить человечеству причинить вред».

Разоблачение

Первая проблема в том, что законы — вымысел! Это сюжетный ход, который Азимов придумал, чтобы продвигать свои истории. Более того, его рассказы почти всегда вращались вокруг того, как роботы могут следовать этим прекрасно звучащим, логичным этическим кодексам, но все же сбиваться с пути и иметь непредвиденные последствия. Реклама экранизации знаменитой книги Азимова 9 2004 года.0100 I, Робот (в главных ролях Свежий Принц и мама ребенка Тома Брэди) выразился лучше всего: «Правила созданы для того, чтобы их нарушать».

Реклама экранизации знаменитой книги Азимова 9 2004 года.0100 I, Робот (в главных ролях Свежий Принц и мама ребенка Тома Брэди) выразился лучше всего: «Правила созданы для того, чтобы их нарушать».

Например, в одном из рассказов Азимова роботы созданы следовать законам, но им придается определенное значение «человек». Предвосхищая то, что сейчас происходит в реальных кампаниях этнических чисток, роботы распознают людей только из определенной группы как «людей». Они соблюдают законы, но все равно осуществляют геноцид.

Вторая проблема заключается в том, что ни одна технология пока не может воспроизвести законы Азимова внутри машины. Как говорит Родни Брукс из компании iRobot, названной в честь книги Азимова, это люди, которые принесли вам военного робота Packbot и робота-пылесоса Roomba: «Люди спрашивают меня, следуют ли наши роботы законам Азимова. По простой причине [они этого не делают]: я не могу встроить в них законы Азимова».

Робототехник Дэниел Уилсон был немного более красочным. «Правила Азимова хороши, но в то же время и чушь собачья. Например, они на английском языке. Как, черт возьми, ты это программируешь?»

«Правила Азимова хороши, но в то же время и чушь собачья. Например, они на английском языке. Как, черт возьми, ты это программируешь?»

Самая важная причина, по которой законы Азимова до сих пор не применяются, заключается в том, как роботы используются в нашем реальном мире. Вы не вооружаете дрон Reaper ракетой Hellfire или не ставите пулемет на MAARS (Modular Advanced Armed Robotic System), чтобы не причинять вреда людям. Вот в чем суть!

То же самое касается создания робота, который подчиняется приказам любого человека. Действительно ли я хочу, чтобы Усама бен Ладен мог распоряжаться моим роботом? И, наконец, тот факт, что роботов можно отправлять на опасные миссии, чтобы их «убили», часто является самой причиной их использования. Дать им ощущение «существования» и инстинкт выживания противоречило бы этому объяснению, а также открыло бы потенциальные сценарии из другого научно-фантастического сериала, фильмов « Терминатор ». Дело в том, что большая часть финансирования исследований в области робототехники поступает от военных, которые платят за роботов, которые следуют прямо противоположным законам Азимова. Ему явно нужны роботы, которые могут убивать, не будут подчиняться приказам любого человека и не заботятся о собственном существовании.

Ему явно нужны роботы, которые могут убивать, не будут подчиняться приказам любого человека и не заботятся о собственном существовании.

Связанные книги

Вопрос этики

Однако, когда дело доходит до роботов и этики, большая проблема заключается не в том, можем ли мы использовать что-то вроде законов Азимова, чтобы сделать машины моральными (что может быть неотъемлемым противоречием, учитывая, что мораль объединяет намерение и действие, а не просто программирование).

Скорее, нам нужно начать бороться с этикой людей, стоящих за машинами. Где кодекс этики в области робототехники для того, что будет построено, а что нет? К чему бы обратились молодые робототехники? Кто может использовать эти сложные системы, а кто нет? Является ли беспилотник Predator технологией, которую следует использовать только военным? Что ж, слишком поздно, Министерство внутренней безопасности уже использует шесть дронов Predator для обеспечения безопасности границ.