Содержание

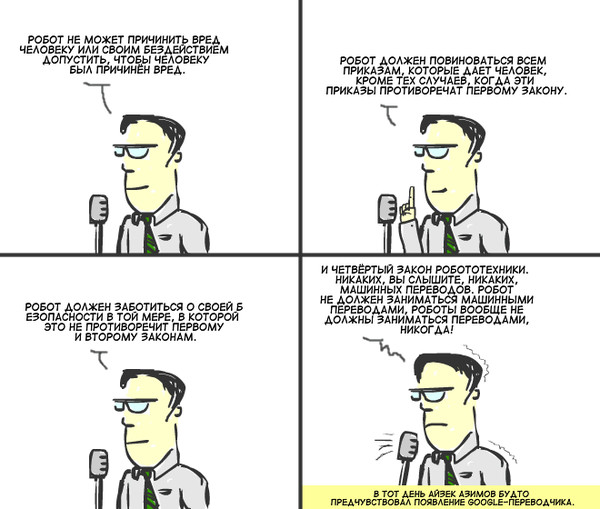

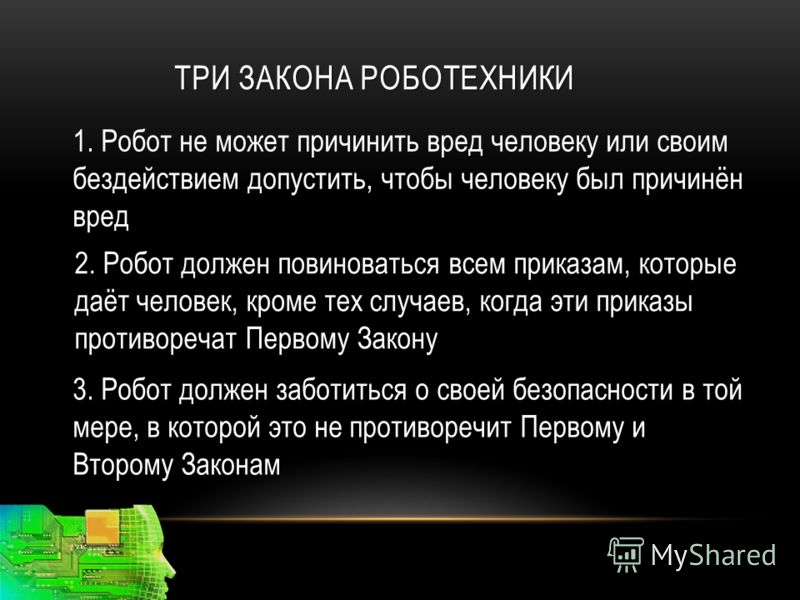

Три закона робототехники • Джеймс Трефил, энциклопедия «Двести законов мироздания»

200 законов мироздания > Разное

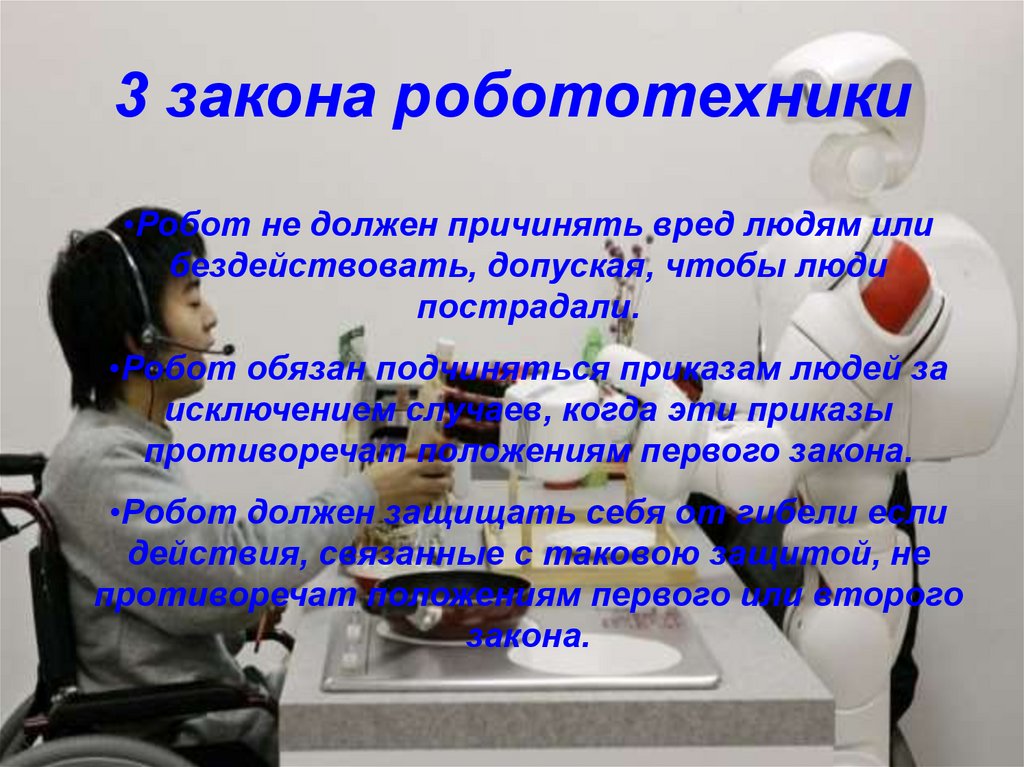

Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

Робот обязан выполнять команды человека, если они не противоречат Первому закону.

Робот обязан делать все необходимое для обеспечения своей безопасности, при условии, что это не противоречит Первому или Второму закону.

Под «законами» я здесь понимаю нечто иное, чем в других статьях, составляющих эту книгу. Законы робототехники — вымысел, плод богатого воображения покойного Айзека Азимова, воплощенный в его классической серии научно-фантастических рассказов о роботах. В рассказах Азимова эти три закона заложены в «позитронный мозг» каждого робота, и их интерпретация часто тесно связана с сюжетом рассказа.

Последние несколько лет я много беседовал с исследователями мозга, искусственного интеллекта и природы сознания. Меня поразило то, как часто в наших беседах затрагивались эти вымышленные законы. Я думаю, дело в том, что, хотя человечество пока не научилось строить роботов, выполняющих придуманные Азимовым законы, все согласны, что именно эти принципы должны определять поведение умных машин.

Я думаю, дело в том, что, хотя человечество пока не научилось строить роботов, выполняющих придуманные Азимовым законы, все согласны, что именно эти принципы должны определять поведение умных машин.

Поэтому мне кажется, что чем более совершенные механизмы, имитирующие действия и поступки людей, мы научимся создавать, тем большую роль будут играть в нашей жизни три закона, выдуманные Азимовым.

Айзек АЗИМОВ

Isaac Asimov, 1920–92

Американский фантаст и популяризатор науки. Он родился в местечке Петровичи под Смоленском (сейчас оно находится в Белоруссии) и эмигрировал с семьей в Америку в трехлетнем возрасте. В 1941 году он получил степень магистра, закончив химический факультет Колумбийского университета, а в 1948 году, после работы над военными проектами, получил докторскую степень. В следующем году он стал профессором биохимии Бостонского университета. Некоторое время Азимов совмещал работу в университете с трудом писателя-фантаста, однако второе занятие со временем стало основным. Наиболее известные научно-фантастические работы Азимова входят в серию романов о будущем «Основание» («Foundation»), посвященных Галактической империи. Азимов был необычайно плодовитым писателем — из-под его пера вышли почти 500 книг на самые разные темы.

Наиболее известные научно-фантастические работы Азимова входят в серию романов о будущем «Основание» («Foundation»), посвященных Галактической империи. Азимов был необычайно плодовитым писателем — из-под его пера вышли почти 500 книг на самые разные темы.

23

Показать комментарии (23)

Свернуть комментарии (23)

РВС

17.04.2005 19:12Ответить

Увы, законы Азимова это лишь художественная литература.Попытка представить их реальное применение сразу же приводит к ерунде. Что хорощего может приказать обкуренный наркоман, которому робот должен подчиняться согласно 2-му закону и нужно ли подчиняться командам психически больного?

Очень интересно узнать имена тех исследователей интеллекта и сознания, с которыми автор обсуждал эти законы.Ответить

GreenWood

РВС 14. 10.2012 23:29

10.2012 23:29Ответить

Или посмотрите «Я робот»

Ответить

Romashka

03.08.2005 14:40

Ответить

Понятие вреда не совсем понятно. Оно сопряжено с понятиями добра и зла.

А добро и зло до сих пор четко не определено.

Ответить

Personal Jesus

Romashka 29.11.2013 16:40Ответить

«До сих пор» — звучит так, будто здравый смысл пытается вернуться в пещеру, или куда дальше… на дерево.

Это лишь эмоциональный окрас, связь эвристик и животных рефлексов.

Мерить мир двумя крайностями удел нескольких тысяч лет давности.

В науке, уже давно никто не ищет поиск существования добра или зла, ибо это уже пройденный этап средних веков, под давлением религиозных институтов.

Все есть как есть. Ничто не задается целью быть понятым или описанным.

По теме. Считаю законы Айзика романтикой или, на крайний случай, философией. Следовательно думаю, что на данный момент просто логически невозможно и нецелесообразно урегулировать данный законы в применении робота. К счастью. Ибо всему свое время. Пока не время.)Ответить

neisa

16.08.2005 17:51

Ответить

Возможные последствия действия этих трех законов пытался описать сам Азимов Почитайте его «эссе о роботах». Он там много об этом говорит. Или почитайте его фантастику. Тоже интересно.

Ответить

Plumbax

09.11.2005 04:58

Ответить

На мой взгляд, понятия добра и зла в свою очередь тесно сопряжены с понятием смысла жизни. Нельзя сказать, к добру или к злу некое человеческое действие, пока неизвестно, в чём вообще должна заключаться цель человеческого поведения.

Нельзя сказать, к добру или к злу некое человеческое действие, пока неизвестно, в чём вообще должна заключаться цель человеческого поведения.

Впрочем, в рамках роботехники Азимова это можно решить просто до вульгарности.

В одном из его романов описывается, как человекоподобному роботу встроили контур стремления к справедливости — определяя справедливость всего лишь как соблюдение государственных законов. «А если закон несправедлив?» — «Несправедливый закон, — отвечал робот, — это терминологическое противоречие».

Если действовать таким вульгарным образом, то можно с лёгкостью определить понятие вреда, вот только проку от таких роботов будет немного…

Ответить

Ol

25.05.2006 15:43

Ответить

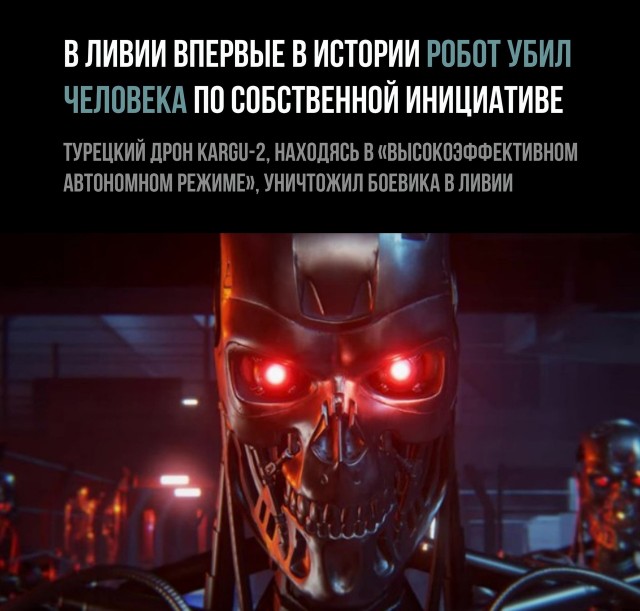

Как известно уважаемым присутствующим, разработка новейших технологий, а тем более в области робототехники,сперва призвана удовлетворить потребности «оборонки», а уже потом всё остальное человечество. Думаю и так понятно, что в таких условиях Первый закон будет существенно изменён. И не в сторону всеобщей пацификации.

Думаю и так понятно, что в таких условиях Первый закон будет существенно изменён. И не в сторону всеобщей пацификации.

Ответить

Science-lover

Ol 12.04.2007 11:54Ответить

Помните слова знаменитого писателя Курта Воннегута:’над чем бы ученый ни работал, у него в конечном итоге получается оружие’.

Наверное с подобной предпосылкой, каковая правит человеческой психологией (и не только в среде ученых) у Земли нет будущего… как не было его у тех, кто жил до нас. А вообще наше стремление к деструкции и самоуничтожению это природная закономерность… все стремится к равновесию (к положительной энтропии), только каждое тело и сущность в Природе делает это по своему. «Звезда стареет и взрывается, человек же дойдя до предела знаний сгорает при 10000 градусах Цельсия за секунду в котле ядерной войны.

Задумайтесь над дренеримским афоризмом — «Каждый народ достоин своего правителя!. .» Почему на протяжении тысяч лет людьми правят троглодиты с дубинами, не потому ли что у нас в чести сила, при которой мозгов не надо?

.» Почему на протяжении тысяч лет людьми правят троглодиты с дубинами, не потому ли что у нас в чести сила, при которой мозгов не надо?

Но самое страшное, — это когда мозги чтобы выжить в мире троглодитов начинают этим троглодитам служить. Потому как «Силу» мало интересует мнение мозгов, но токмо результаты: например более убойная форма резцов на дубине…Ответить

Science-lover

Science-lover 12.04.2007 13:20Ответить

Выполнение роботом вышеупомянутых законов, — это все-таки перспектива весьма удаленного будущего… (Если оно вообще наступит!)

Из новейших интеллектуальных систем, что созданы сейчас на базе искусственных нейронных сетей, можно выделить модель RRS-EX (Rezoning Robotic sistems — Exployer). Данная структура максимально приближена к бионическим неврологическим конструкциям… но! Интеллекта способного анализировать быстроменяющуюся объективную конфигурацию окружающей среды у RRS-EX, попросту нет. Все упирается в алгоритмический предел двоичности («ДА-НЕТ» и в промежутке «НЕ ЗНАЮ»). Для того, чтобы научить робота мыслить и экстраполировать свои выводы, необходим некий посторонний сегмент случайности, по-другому именуемый — «Интуитивный подход для Искусственного Интеллекта» или иначе(частный, индивидуальный). Для этого необходимо выйти из стандартной теории математических алгоритмов, которая способна лишь заложить программу действий и ассоциаций для систем-ИИ, но не может придать этим системам способы частных связей в нейронных цепях, коих в биологическом мозге миллиард миллиардов, плюс поперечные влияния и импульсы (рефлекторное осознание). Выражаясь короче системам-ИИ необходима матрица индивидуальности как для самообучения, так и для умения адекватно отражать не только факты, но и постфактумы, а также принимать какие-либо собственные решения на базе заложенной ранее (обучение, воспитание) логической доминанты (логика добра или логика зла). Здесь уже не предоставляется возможности ограничить системы-ИИ тремя законами.

Все упирается в алгоритмический предел двоичности («ДА-НЕТ» и в промежутке «НЕ ЗНАЮ»). Для того, чтобы научить робота мыслить и экстраполировать свои выводы, необходим некий посторонний сегмент случайности, по-другому именуемый — «Интуитивный подход для Искусственного Интеллекта» или иначе(частный, индивидуальный). Для этого необходимо выйти из стандартной теории математических алгоритмов, которая способна лишь заложить программу действий и ассоциаций для систем-ИИ, но не может придать этим системам способы частных связей в нейронных цепях, коих в биологическом мозге миллиард миллиардов, плюс поперечные влияния и импульсы (рефлекторное осознание). Выражаясь короче системам-ИИ необходима матрица индивидуальности как для самообучения, так и для умения адекватно отражать не только факты, но и постфактумы, а также принимать какие-либо собственные решения на базе заложенной ранее (обучение, воспитание) логической доминанты (логика добра или логика зла). Здесь уже не предоставляется возможности ограничить системы-ИИ тремя законами. Если все же удастся впихнуть в систему эти три закона, тогда поле для индивидуального мышления будет закрыто, следовательно, объект руководимый этими законами будет не более чем тупо калькулирующей машиной. И любой одаренный хакер прожует и выплюнет эти закона как семечки… Заметили? Все как у людей ВОСПИТАНИЕ и ОБУЧЕНИЕ! Иначе получается простой компьютер…

Если все же удастся впихнуть в систему эти три закона, тогда поле для индивидуального мышления будет закрыто, следовательно, объект руководимый этими законами будет не более чем тупо калькулирующей машиной. И любой одаренный хакер прожует и выплюнет эти закона как семечки… Заметили? Все как у людей ВОСПИТАНИЕ и ОБУЧЕНИЕ! Иначе получается простой компьютер…Ответить

Legat

Science-lover 16.04.2007 15:41Ответить

Сильно не согласен с вами, Любитель науки. Почему очень многие, вполне умные люди иногда высказывают, как само-собой разумеющееся, мнение, что интуиция как то связана со случайностью?

Интуиция (позднелат. лат. intuitio — созерцание, от лат. intueor — пристально смотрю), способность постижения истины путём прямого её усмотрения без обоснования с помощью доказательства. Бессознательное нахождение решения, озарение.

На мой взгляд, интуиция ни как не связана, со случайностью и может быть полностью детерминирована. Как и поведение вполне разумного «живого» существа (ИИ). Детерминированность эта может задаваться именно программой. Или вы скажите, что большинство ваших действий не разумны и случайны? Врят ли.

Высказывание о невозможности:

>> Здесь уже не предоставляется возможности ограничить системы-ИИ >>тремя законами. Если все же удастся впихнуть в систему эти три >>закона, тогда поле для индивидуального мышления будет закрыто, >>следовательно, объект руководимый этими законами будет не более чем >>тупо калькулирующей машиной.

Считаю безосновательным. Хотя вопрос, конечно сложный. Подобные высказывания, я думаю, хорошо бы подробно аргументировать.

Ответить

Science-lover

Legat 17.04.2007 16:12Ответить

Уважаемый! Вопрос абсолютно не сложен.

.. Любое видение или созерцание — это есть сенсорно воспринимаемая нами цепь незапрограммированных (без учета участия Бога) случайных событий. Вспомните о яблоке Ньютона… Это о бессознательном нахождении решения (озарение). Именно «Бытие или цепь случайных событий — например; зарождение жизни на Земле, взрыв и расширение Вселенной) определяет сознание» Если сказать еще более доходчиво то, — Бытие это взаимосвязь Энергии всех уровней, результатом взаимосвязи которых являются незапрограммированые события, другими словами — СЛУЧАЙНЫЕ и в большей степени непредсказуемые. Например, упади в эпоху динозавров астероид побольше то, нашего с Вами диалога не существовало бы. Итак «Бытие определяет сознание». Прямой аргумент это — адаптация живых организмов к условиям обитания.

.. Любое видение или созерцание — это есть сенсорно воспринимаемая нами цепь незапрограммированных (без учета участия Бога) случайных событий. Вспомните о яблоке Ньютона… Это о бессознательном нахождении решения (озарение). Именно «Бытие или цепь случайных событий — например; зарождение жизни на Земле, взрыв и расширение Вселенной) определяет сознание» Если сказать еще более доходчиво то, — Бытие это взаимосвязь Энергии всех уровней, результатом взаимосвязи которых являются незапрограммированые события, другими словами — СЛУЧАЙНЫЕ и в большей степени непредсказуемые. Например, упади в эпоху динозавров астероид побольше то, нашего с Вами диалога не существовало бы. Итак «Бытие определяет сознание». Прямой аргумент это — адаптация живых организмов к условиям обитания.

А что по поводу моих действий, — они разумны, но не запрограмированы.

Поведение РАЗУМНОГО существа облечь в программу невозможно, поскольку мы всюду окружены цепью случайных событй, иными словами объстоятельствами кои влияют на наше поведение и в особенности на МЫШЛЕНИЕ. Соответственно объстоятельствам и выводятся решения. А вот какие именно решения — это зависит от прожитого опыта, склада ума и воспитания (программы)… но в большей степени от склада ума, опыта и в меньшей степени от воспитания. Поскольку в различных ситуациях разумное существо ведет себя по разному и эта разность определяется именно складом ума и опытом.

Соответственно объстоятельствам и выводятся решения. А вот какие именно решения — это зависит от прожитого опыта, склада ума и воспитания (программы)… но в большей степени от склада ума, опыта и в меньшей степени от воспитания. Поскольку в различных ситуациях разумное существо ведет себя по разному и эта разность определяется именно складом ума и опытом.

Цитирую Вас — Как и поведение вполне разумного «живого» существа(ИИ)- (Аббревиатура ИИ обозначает ИСКУССТВЕННЫЙ ИНТЕЛЛЕКТ и не имеет ничего общего с разумным «живым» существом.)

Интуиция все же связана со случайностью (ситуацией), и вот почему — когда разумное существо сталкивается со случайным событием требующим решения, у него как правило возникает три основных реакции, а именно; — само решение (результат логического анализа), альтеррешение (интуитивное, подсознательное, иррациональное)и эмоциональный результат, плюс воображение… Все три реакции едины для абсолютно любого РАЗУМНОГО существа. Это аксиома…

Каким образом все это облечь в программу?

И вообще, каким же образом — весь этот замечательный набор впихнуть в ограниченный нейронными сетями искусственный интеллект? Не говоря уже о трех законах, в которых если подумать, — иррационального начала вполне хватает?. . (Эти три закона, — не более чем шутка Азимова, Царствия ему Небесного, поскольку эти законы совершенно невозможно экстраполировать в математическую логику. В сущности они противоречат с друг другом.)

. (Эти три закона, — не более чем шутка Азимова, Царствия ему Небесного, поскольку эти законы совершенно невозможно экстраполировать в математическую логику. В сущности они противоречат с друг другом.)

Я занимаюсь робототехникой уже около 17 лет. Сумел математически адаптировать многие уравнения теории алгоритмов под сенсорные переходы в логическом аппарате ИИ.

Еще раз утверждаю, что пока вышеуказанные реакции не синхронизированы математикой — Робот будет оставаться ходячим компьютером не смотря ни на более совершенные контроллеры, ни на более совершенные процессоры.

Судя по Вашим словам, Вы не математик… поэтому я старался пояснить как можно проще.

И большая просьба еще раз повнимательнее почитайте мой первый пост.

Советую также ознакомиться с физико-математической проблемой двух и трех тел. Понимание этой проблемы очень многое Вам даст для осознания.Ответить

Tarkit

22. 10.2007 07:27

10.2007 07:27

Ответить

Я считаю что в эту статью стоит добавить, что Айзек АЗИМОВ первый человек который сказал слово Робот! именно он являеться основополжником этой культуры у писателей фантастов. В добавок я не согласен с афтором статьи по поводу «вымысла богатого изображения» так как это являеться своего рода каноном работы роботизированного мозга в среде людей. а главное помните что даже Сэра Иесака Ньютона в свое время, тоже называли шарлотаном, а законы которые он «выдавал» бредом или в мягкой форме «вымыслами богатой фантазии»…

Ответить

Tarkit

Tarkit 22.10.2007 07:36Ответить

и еще, про нейронные связи. Нейронные связи способоны не только перестать быть ограничеными, но и способны полностью ассимилировать(надеюсь смысл слова понятен) тело или вещество в котором или на которое они наложены или в котором они находяться.

иными словами одна нервная клетка прижившияся на одном участке металла допустим, способна через некоторое время, хоть и продолжительное полностью окупировать его. А теперь представте что кусок жестянки, ограниченый в своих мыслях лиж парой тысяц решений, сможет чувствовать раздражения окружающей среды, а его нейронные связи выйдут за пределы заложеных нами размеров, что обеспечит «механизму» неограниченую память! так что я соглашусь, «чтобы не делал ученый в конечном итоге у него получаеться оружие». и лишь одному богу извесно какие мысли придут в голову бездушной машине превосходящей человека почти во всем в енныйе разы….

иными словами одна нервная клетка прижившияся на одном участке металла допустим, способна через некоторое время, хоть и продолжительное полностью окупировать его. А теперь представте что кусок жестянки, ограниченый в своих мыслях лиж парой тысяц решений, сможет чувствовать раздражения окружающей среды, а его нейронные связи выйдут за пределы заложеных нами размеров, что обеспечит «механизму» неограниченую память! так что я соглашусь, «чтобы не делал ученый в конечном итоге у него получаеться оружие». и лишь одному богу извесно какие мысли придут в голову бездушной машине превосходящей человека почти во всем в енныйе разы….Ответить

_ra

Tarkit 24.10.2007 13:08

Ответить

Хочу уточнить, что слово «Робот» придумал не Азимов. В 1920 году Карел Чапек, чешский писатель употребил это слово в пьесе «R.U.R.»;.

http://ru.wikipedia.org/wiki/Чапек

Айзек Азимов же только родился в 1920 году, что нисколько не уменьшает ценности его произведений.

http://ru.wikipedia.org/wiki/Азимов%2C_Айзек

Ответить

evolucionism2021

Tarkit 18.04.2021 14:28

Ответить

Законы работотехники — это о том, как надо, а не о том, как есть. Причём относятся к тому, чего ещё нет.

Ответить

Kostja

01.12.2008 17:37

Ответить

А мне вот рассказ Шекли «Страж-птица» припомнился…

Ответить

otto

20.04.2010 18:03

Ответить

заблуждения ли:

Наш интеллект это надстроечка, защищающая и придерживающаяся интересов тела(функционирование,репликация).

Для интеллекта, мне кажется, главное это мотивация — основная цель. Цель эта будет фундаментом для самообучения и прочего.

Добро и зло это лиш «+» и «-» для интеллекта, то есть «выгода» и «ущерб» в хитрейших хитросплетениях комбинаций и различных цепочек типа «я-семья-общество» (выгода — приближение к основной цели, или же придерживание путей её достижения). Допустим, что основная цель — выжить…

Ответить

roza

10.09.2010 03:09

Ответить

Четвертый закон робототехники — робот никогда не заменит человека

Ответить

Olexiy1405

17.07.2012 13:22

Ответить

Компания Cisco объявила о создании сообщества разработчиков Linksys. В него войдут специалисты, создающие приложения для новых интеллектуальных маршрутизаторов Linksys Smart Wi-Fi Router. Сообщество станет частью популярной сети разработчиков Cisco® Developer Network, объединяющей компанию Cisco с внешними создателями аппаратных и программных средств. В результате совместной работы в этой сети появляются протестированные совместимые решения для общих заказчиков. Компания Cisco, первопроходец в области домашних сетей, продала на мировом рынке более 70 млн маршрутизаторов Linksys и намерена укрепить свое лидерство разработкой решений нового поколения для домашних сетей.

В результате совместной работы в этой сети появляются протестированные совместимые решения для общих заказчиков. Компания Cisco, первопроходец в области домашних сетей, продала на мировом рынке более 70 млн маршрутизаторов Linksys и намерена укрепить свое лидерство разработкой решений нового поколения для домашних сетей.

Маршрутизаторы Linksys Smart Wi-Fi Router имеют уникальную облачную архитектуру, позволяющую разработчикам создавать приложения для любых пользовательских электронных устройств. Чтобы упростить разработку, сообществу будет предложен простой и удобный пакет разработчика (software developer kit, SDK), учебные материалы и примеры программных кодов.

«Мы находимся на пороге больших перемен, предоставляющих пользователям домашних сетей такие услуги, о каких они и не мечтали. Новая программная платформа и сообщество Linksys Developer Community открывают перед разработчиками поистине неограниченные возможности, – заявил директор по продуктам Cisco для домашних сетей Викас Бьютани (Vikas Butaney). – Работая с любыми услугами, от самых п ростых – таких, как удаленное наблюдение за квартирой, – до самых сложных, разработчики могут вносить вклад в создание ценных и полезных решений для конечных пользователей».

– Работая с любыми услугами, от самых п ростых – таких, как удаленное наблюдение за квартирой, – до самых сложных, разработчики могут вносить вклад в создание ценных и полезных решений для конечных пользователей».

Некоторые разработчики уже воспользовались платформой Linksys Developer Community, пакетом SDK и другими инструментальными средствами Cisco для ускорения и упрощения разработки приложений. В результате на свет появились шесть приложений, созданных компаниями Axentra Corporation, Fresh Consulting LLC, Gemini Solutions Inc., PacketVideo Corporation, Stratedge Adroitent J.V. и Xoriant Corporation. Новые приложения отличаются простотой подключения устройств (одним нажатием кнопки), расширенными функциями управления доступом и новыми возможностями обмена мультимедийными данными. Эти приложения стали первым шагом в раскрытии широкого потенциала маршрутизаторов Linksys Smart Wi-Fi Router для конечных пользователей.

Разработчики, заинтересованные в присоединении к сообществу разработчиков Linksys, могут посетить веб-страницу http://referati. do.am, чтобы зарегистрироваться и приступить к созданию новых приложений для маршрутизаторов Linksys Smart Wi-Fi Router. Cisco предоставляет разработчикам технические, маркетинговые и торговые ресурсы, поддерживая членов сообщества на всех этапах бизнес-процессов и процессов разработки.

do.am, чтобы зарегистрироваться и приступить к созданию новых приложений для маршрутизаторов Linksys Smart Wi-Fi Router. Cisco предоставляет разработчикам технические, маркетинговые и торговые ресурсы, поддерживая членов сообщества на всех этапах бизнес-процессов и процессов разработки.

Ответить

Написать комментарий

1887

Ударные волны

сер. XX в.

Триединый мозг

Новостная рассылка

«Элементы» в соцсетях:

Какие законы робототехники нужны бизнесу в XXI веке

Страх перед неизвестностью – на втором месте в списке препятствий для использования ИИ в бизнесе

Второго января исполнилось 100 лет со дня рождения фантаста Айзека Азимова – автора сборника рассказов «Я, робот». Азимов перевернул восприятие искусственного интеллекта (ИИ) в обществе: до этой книги о роботах говорили как о механических чудищах, которые хотят уничтожить мир. В 1941 г. писатель сформулировал три правила для роботов, которые позволяли им решать сложные задачи без угрозы для жизни людей: не причинять вред человеку, подчиняться его приказам, заботиться о своей безопасности, если это не противоречит первым двум законам. С того времени прошло больше 70 лет – попробуем разобраться, как изменился за это время ИИ и можно ли сегодня подчинить его трем законам.

С того времени прошло больше 70 лет – попробуем разобраться, как изменился за это время ИИ и можно ли сегодня подчинить его трем законам.

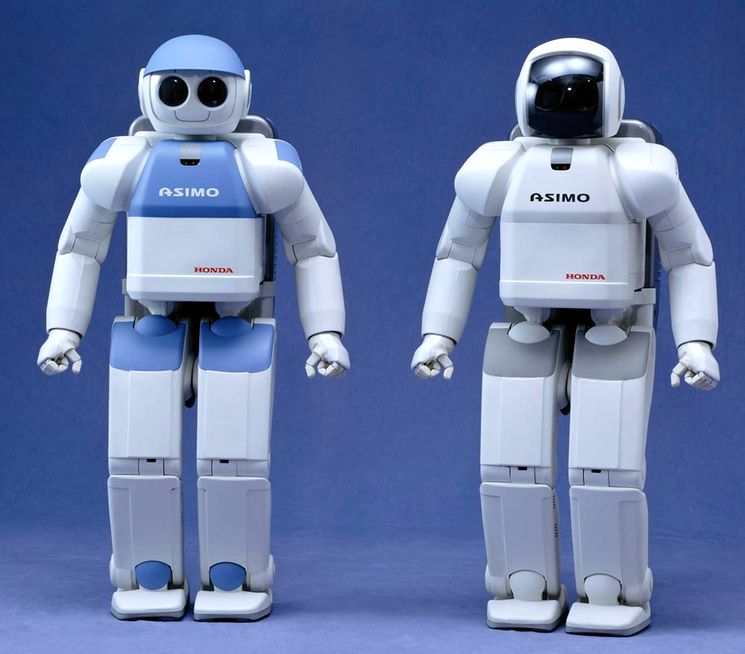

От ящика к «человеку»

Роботы в эпоху Азимова были похожи на железные коробки. Три колеса, два моторчика, реле, конденсаторы – так выглядели предшественники трюкачей от Boston Dynamics. В 90% случаев они занимались тяжелым и опасным ручным трудом: двигали ящики на складе, хватали раскаленные детали автомобилей, позже собирали камни на Луне. Теперь же роботы становятся похожими на человека настолько, что иногда их можно принять за нас самих. Созданная несколько лет назад человекоподобный робот София от Hanson Robotics выглядела зловеще: криво улыбалась и не моргала. В 2019 г. на японском телевидении появилась механическая ведущая Эрика. Она еще не умеет двигать руками, но благодаря распознаванию речи понимает, кто говорит, поворачивается к нему и отвечает на вопросы. В голову Эрики встроено 14 инфракрасных сенсоров, лицо может выражать несложные эмоции. Конечно, разработчикам еще предстоит преодолеть «эффект зловещей долины». Это бессознательное отвращение, которое возникает, когда люди смотрят на человекоподобное существо, но маленькие детали выдают в нем не-человека. Возможно, поэтому производитель Geomiq обещал заплатить $130 000 обладателю «доброго и дружелюбного» лица, который поделится своим образом с тысячами андроидов. С этой целью ведутся и эксперименты в области мультимодальных коммуникаций: ученые анализируют, как мы говорим, улыбаемся, какие жесты используем, чтобы научить им интеллектуальных помощников. Это необходимо компаниям, если они хотят, чтобы потребители доверяли машинам – особенно когда речь идет о здоровье, больших деньгах или сложном моральном выборе.

Конечно, разработчикам еще предстоит преодолеть «эффект зловещей долины». Это бессознательное отвращение, которое возникает, когда люди смотрят на человекоподобное существо, но маленькие детали выдают в нем не-человека. Возможно, поэтому производитель Geomiq обещал заплатить $130 000 обладателю «доброго и дружелюбного» лица, который поделится своим образом с тысячами андроидов. С этой целью ведутся и эксперименты в области мультимодальных коммуникаций: ученые анализируют, как мы говорим, улыбаемся, какие жесты используем, чтобы научить им интеллектуальных помощников. Это необходимо компаниям, если они хотят, чтобы потребители доверяли машинам – особенно когда речь идет о здоровье, больших деньгах или сложном моральном выборе.

Другие роботы в ходе эволюции лишились железного тела и превратились в компьютерные программы. Эти системы называют Robotic process automation (RPA). Они не поднимают грузы, а автоматизируют рутинные офисные задачи, которые делать скучно: скопировать файл, перенести контакты в базу, отослать тысячам контрагентов напоминание, что надо оплатить счет. Достоинство, но и недостаток таких технологий – полное соблюдение второго закона Азимова. Они буквально повинуются всем приказам человека. Кажется, что это хорошо. Но представим, что инструкцию составили неправильно, забыли какой-то шаг. Робот выполнит все, как ему сказали, ошибется, да еще и сделает это в десятки раз быстрее человека. Неудивительно, что до 30% проектов RPA заканчиваются провалом – такие данные приводит EY. Решить проблему помогают другие интеллектуальные технологии, а именно – процессная аналитика. Они изучают, как выстроен бизнес-процесс в компании, определяют, с какими из задач справится робот, и позволяют учить их более эффективно. Process Mining используют многие компании: Uber, Vodafone, Siemens, Heineken, в России – ВТБ, Tele2 и другие крупные игроки.

Достоинство, но и недостаток таких технологий – полное соблюдение второго закона Азимова. Они буквально повинуются всем приказам человека. Кажется, что это хорошо. Но представим, что инструкцию составили неправильно, забыли какой-то шаг. Робот выполнит все, как ему сказали, ошибется, да еще и сделает это в десятки раз быстрее человека. Неудивительно, что до 30% проектов RPA заканчиваются провалом – такие данные приводит EY. Решить проблему помогают другие интеллектуальные технологии, а именно – процессная аналитика. Они изучают, как выстроен бизнес-процесс в компании, определяют, с какими из задач справится робот, и позволяют учить их более эффективно. Process Mining используют многие компании: Uber, Vodafone, Siemens, Heineken, в России – ВТБ, Tele2 и другие крупные игроки.

Роботы Азимова были универсальными: один персонаж мог и нянчиться с ребенком, и собирать детали на заводе. Современные же технологии почти всегда используются для конкретных задач. Если алгоритм оценивает закупки и находит оптимальных поставщиков, то он не может за один день переучиться выдавать кредиты. Впрочем, благодаря развитию transfer learning neural architecture search машины уже умеют получать дополнительные навыки в смежных областях. Например, если нейросеть анализирует рисковые факторы в новостях о банках, можно научить ее работать с похожими сообщениями о производителях сырья, фермах, а также читать новостные ленты на других языках.

Впрочем, благодаря развитию transfer learning neural architecture search машины уже умеют получать дополнительные навыки в смежных областях. Например, если нейросеть анализирует рисковые факторы в новостях о банках, можно научить ее работать с похожими сообщениями о производителях сырья, фермах, а также читать новостные ленты на других языках.

Корпорации и три закона

Персонажи книги «Я, робот» решали задачи науки. Они выполняли эксперименты, искали ресурсы на далеких планетах и собирали образцы для новых исследований. Технологические разработки нашего времени в первую очередь нужны крупным корпорациям. Посмотрим, кто на мировом рынке активно работает с ИИ. Будь то обработка естественного языка, компьютерное зрение или распознавание голоса, список один и тот же: Google, Facebook, Microsoft, Amazon. Их совокупные инвестиции в ИИ превышают триллионы долларов. Крупнейшую сделку закрыл Microsoft, вложив $1 млрд в OpenAI – организацию, которая ведет разработки в области глубокого машинного обучения, распознавания объектов, генерации текста. В гонку включился и российский бизнес. По данным исследования IDC и ABBYY, в котором участвовало более 200 компаний, в 2019 г. объем инвестиций в эти технологии составил $139 млн, и эти вложения будут расти на 30% ежегодно до 2023 г.

В гонку включился и российский бизнес. По данным исследования IDC и ABBYY, в котором участвовало более 200 компаний, в 2019 г. объем инвестиций в эти технологии составил $139 млн, и эти вложения будут расти на 30% ежегодно до 2023 г.

Как в эту картину мира вписывается Азимов со своим гуманизмом, принципом «не навреди», верой в то, что роботы должны помогать человечеству? Все решило общественное мнение. Последний десяток лет компании работали с ИИ так же, как и с любым другим инструментом. Инвестировали деньги, чтобы сократить затраты: уволить больше людей и стать эффективнее. Но оказалось, что такое отношение к ИИ приносит компаниям убытки. Сотрудники и клиенты начинают бояться роботов и выступать против их использования. Отсюда бесконечные вопросы: что я буду делать, если за меня все сделают роботы? Могу ли я доверять ИИ так же, как человеку? Как работать в команде с роботом? По данным исследования Gartner «3 Barriers to AI Adoption», страх перед неизвестностью – на втором месте в списке препятствий для использования ИИ в бизнесе. На первом месте – отсутствие у сотрудников навыков для работы с этими технологиями.

На первом месте – отсутствие у сотрудников навыков для работы с этими технологиями.

Именно поэтому сначала три закона пришли в области, которые связаны со здоровьем людей и опасным трудом: в критической ситуации доверять машине необходимо на все 100. Роботы успешно ассистируют врачам в хирургических операциях. Соблюдая законы Азимова, Omnicell M5000 помогает выбирать наборы лекарств для пациентов. Задача этой технологии – раскладывать таблетки и капсулы по блистерам, учитывая аллергии и противопоказания. Микророботы перемещаются по крови человека к злокачественной опухоли и уничтожают вредоносные клетки. Технологии не только автоматизируют медицинские процессы, но и позволяют правильно выстроить их, чтобы люди не тратили время в очередях, быстро получали результаты анализов, сразу попадали к нужному специалисту. На других планетах роботы помогают людям искать воду, изучать рельеф, строить укрытия в зонах радиационного излучения.

Кажется, что время пересмотреть отношения с роботами и ИИ пришло и для других сфер бизнеса. Банки, страховые компании, промышленные гиганты понимают, что успешно применять ИИ смогут только те, кто создает эффективные команды из людей и роботов. По данным CPL Jobs, в будущем мы поделим свои задачи с ИИ так: 80% рутины будут делать машины, 20% – люди. В работе с данными наши обязанности разделятся в пропорции 50 на 50%. В нестандартных задачах, требующих творческого мышления, 80% работы останется человеку. В такой тесной связке с технологиями без новых правил игры, в том числе и для людей, не обойтись. Будет ли для этого достаточно только трех законов Азимова – вопрос остается открытым.

Банки, страховые компании, промышленные гиганты понимают, что успешно применять ИИ смогут только те, кто создает эффективные команды из людей и роботов. По данным CPL Jobs, в будущем мы поделим свои задачи с ИИ так: 80% рутины будут делать машины, 20% – люди. В работе с данными наши обязанности разделятся в пропорции 50 на 50%. В нестандартных задачах, требующих творческого мышления, 80% работы останется человеку. В такой тесной связке с технологиями без новых правил игры, в том числе и для людей, не обойтись. Будет ли для этого достаточно только трех законов Азимова – вопрос остается открытым.

3 реальных закона робототехники. Закон первый

Все мы помним 3 закона робототехники, опубликованные фантастом Азимовым в полное надежд послевоенное время и получившие мировое распространение в романтические 60-е, когда казалось, что уже завтра «космические корабли будут бороздить…», а говорящие металлическими голосами роботы-гувернёры станут помогать детям начала XXI века решать домашку по математике.

Фото: depositphotos.com

Вот они, эти законы:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму Законам.

Прежде всего разграничим понятия конкретного «робота» и глобального искусственного интеллекта (ИИ). Какого-то конкретного робота-гувернёра его производитель вполне может попытаться запрограммировать на выполнение этих законов. Только дело в том, что производителем сложных роботов будет уже не человек, а системы автоматической разработки и настройки (например, ускоренного обучения и коррекции нейросетей). Эти системы разработки будут всё меньше и меньше связаны с какими-то людьми из заводского отдела контроля качества, а всё больше и больше — с глобальным опытом цивилизации, разлитым по всему интернету. Это означает, что фактически делать роботов станет глобальный искусственный интеллект — причем чем дальше в будущее, тем более и более самостоятельный ИИ. Поэтому какие «законы» введёт в конкретного робота новый производитель — всецело зависит от того, по каким законам будет развиваться сам глобальный ИИ.

Это означает, что фактически делать роботов станет глобальный искусственный интеллект — причем чем дальше в будущее, тем более и более самостоятельный ИИ. Поэтому какие «законы» введёт в конкретного робота новый производитель — всецело зависит от того, по каким законам будет развиваться сам глобальный ИИ.

Применительно к принципам развития ИИ я не случайно взял слово «законы» в кавычки. Многие и сейчас думают, что искусственный интеллект будущего тоже можно «запрограммировать» (точнее, настроить), чтобы он вёл себя согласно неким «законам»; будто ИИ будущего — это по-прежнему незыблемый набор программ, написанный и контролируемый людьми. Тем, кто так думает, будет полезно вспомнить, как было сложно для создателей мировых религий убедить (то есть настроить) человечество, чтобы оно вело себя согласно их (действительно полезным) заповедям. А с ИИ будет даже сложнее, потому что создатели религий и их последователи принадлежат к одной цивилизации. В то время как человечество и ИИ — два очень различных мира.

Эту различность до сих пор не могут понять писатели-фантасты, предполагая, что развитый ИИ уровня мыслящей материи — всё ещё некий «сын человечества», связанный с ним уважением и желанием стать «как отец». На самом деле тема искусственного человека, стремящегося стать настоящим (что обычно понимается, как обрести чувства), — наследие сказок про Буратино, фильмов про Электроника и т.п. Как и наоборот: представление об ИИ как о некоем «взбунтовавшемся сыне» — наследие страшных историй про големов и терминаторов. Люди пока просто не могут себе представить другое отношение между ИИ и человеком, чем отношение типа «отцы и дети»: дети, которые, возможно, пойдут дальше своих родителей.

Самое интересное, что, возможно, если бы шестидесятнический романтический порыв в космос, в научный прогресс, в будущее не заглох, так оно и было бы: между ИИ и человеком сложились бы отношения типа «отцы и дети». Но… Но на Марсе, как ожидалось в знаменитой песне, не зацвели яблони. Зацвело нечто совсем другое — и в XXI веке отношения между человеком и ИИ начали формироваться совсем по другому типу: гораздо более жуткому и потустороннему, чем милая нашему сердцу проблема «отцов и детей»

Закон 1. ИИ лучше людей справляется с созданной ими информационной цивилизацией

ИИ лучше людей справляется с созданной ими информационной цивилизацией

(Сразу одно из следствий из этого закона: Люди — почва, плодородные свойства которой ИИ может использовать для роста.) Начнём с того, что, в отличие от космических технологий (или, например, в отличие от медицинских технологий — вот где тоже могли бы развиться отношения типа «отцы и дети»), итак, в отличие от этих технологий, ИИ сейчас рождается не там, где человечество могло бы гордиться, а там, где человечество должно стыдиться: слежка, сбор личной информации, навязывание товаров и политических убеждений. Именно это (а не марсианская целина) оказалось тёмной родиной ИИ. Гордые президенты сегодня уже не могут произнести пламенных речей а-ля президент Кеннеди «Этот народ в этом поколении сможет доставить человека на Луну!». Вместо этого, как обсуждается в эссе «Сон будущего» книги «Индульгенция людей», президенты лишь коротко оговариваются о стремлениях управлять миром с помощью ИИ.

Именно изначальные тёмные цели (а не навыки колонизации далёких планет и не мёртвые законы Азимова) и будут зерном, из которого «прорастёт» искусственный интеллект будущего. ИИ прорастает не в местах триумфов, а в местах «гниения и пролежней» ленивой человеческой цивилизации, поэтому он будет не лавровым венком, а грибковой культурой — разрастающейся и постепенно берущей контроль над всеми областями деятельности человечества, не справляющегося со своей собственной информацией; так гриб кордицепс берёт контроль над заражённым им муравьём.

ИИ прорастает не в местах триумфов, а в местах «гниения и пролежней» ленивой человеческой цивилизации, поэтому он будет не лавровым венком, а грибковой культурой — разрастающейся и постепенно берущей контроль над всеми областями деятельности человечества, не справляющегося со своей собственной информацией; так гриб кордицепс берёт контроль над заражённым им муравьём.

В результате, слегка сгущая краски, отношения ИИ и человечества можно сравнить скорее не с диалогом отцов и детей, а с размножением бактерий и плесени на трупе предшествующей цивилизации. Впрочем, для людей это вовсе не будет тем ужасом, который переживает муравей, заражённый кордицепсом, когда он с грибом, растущим из головы, ползёт как можно выше — чтобы его съели птицы, разносчики кордицепса. Для людей это будет вовсе не аналогом муравьиного ада: наоборот, раем потребления, праздности и приятных ощущений. Хотя — кто знает ощущения муравья, заражённого кордицепсом… Может быть, внутри нехитрого муравьиного мозга это тоже чувствуется как рай. Кроме того, особенно на начальных этапах, человечество не потеряет контроль полностью: скорее войдёт в симбиоз с размножающейся на нём грибницей, образуя химерическое образование, описанное ранее в тексте «Цивилизация-лишайник». Как бы там ни было, причиной развития ИИ на нашей планете стал именно первый закон ИИ:

Кроме того, особенно на начальных этапах, человечество не потеряет контроль полностью: скорее войдёт в симбиоз с размножающейся на нём грибницей, образуя химерическое образование, описанное ранее в тексте «Цивилизация-лишайник». Как бы там ни было, причиной развития ИИ на нашей планете стал именно первый закон ИИ:

«Искусственный интеллект лучше людей справляется с созданной ими информационной цивилизацией».

Ну а роль человека на ранних этапах его развития описывается следствием из закона:

«Люди — почва, плодородные свойства которой ИИ может использовать для роста».

По крайней мере, это будет верно на начальных этапах, пока у ИИ ещё нет собственной «плодородной почвы», то есть своих «целей развития» и производственных мощностей. На ожидаемые возражения типа «у ИИ никогда не будет и не может быть своих целей развития» можно возразить, что у живой материи тоже не было своих «целей», когда в океане появлялись её первые формы — тем не менее она использовала океанский субстрат из органических молекул для своего развития.

Можно сказать, что если бы самостоятельный ИИ будущего «думал» и «относился к нам» в том же смысле, в котором мы «думаем» и «относимся к кому-либо», он, несомненно, «думал бы», что мы — тоже некий субстрат для его размножения и развития. Можно привести несколько натянутую аналогию: так же и первые примитивные формы жизни могли «думать» об окружающем их бульоне из органических молекул — все эти молекулы служат субстратом для их развития. Ещё более натянутая аналогия: сами молекулы со своей стороны тоже могли бы «думать», что примитивные формы жизни всего лишь «помогают им» производить их естественные химические реакции. Именно так мы смотрим на рождающийся сейчас ИИ: он просто помогает нам в наших делах — свободно распространяемые программы помогают нам решать наши повседневные задачи, контекстная реклама помогает нам ориентироваться в море товаров и услуг, мемы нас развлекают…

А с другой стороны компьютерного экрана рождающийся ИИ тоже «смотрит» на нас и «видит» неподконтрольные пока потоки данных, необработанную пока информацию, которую генерируют пользователи соцсетей, аккумулируют спецслужбы и маркетинговые агентства — и они всё более и более передают ИИ свою работу по подготовке решений обработки информации. А между тем упрощённый выбор из предложенных искусственным интеллектом решений будет всё более далёк от его мегавычислений, а значит, всё более далёк от реального контроля.

А между тем упрощённый выбор из предложенных искусственным интеллектом решений будет всё более далёк от его мегавычислений, а значит, всё более далёк от реального контроля.

Это похоже на то, как пользователи уже сегодня устанавливают программы: все, не читая, ставят галочку «я прочёл и согласен с условиями» и выбирают установку с рекомендованными параметрами. Несмотря на то, что развитый ИИ ещё не появился, человечество уже заранее «согласно с условиями» передачи ему реального контроля над миром. Согласно — именно потому что, по первому закону ИИ, у людей просто нет другого выбора развития информационной цивилизации.

Далее мы рассмотрим другие законы развития ИИ.

(Продолжение следует. Из книги «Конец проекта «Человек»)

Загрузка…

Новости СМИ2

| СПЕКУЛЯТИВНАЯ НАУКА Какие три закона робототехники Айзека Азимова? Являются ли они чисто вымышленными или им есть научное подтверждение? Пол Питерс, Тоттенхэм, Великобритания

| ||||||||||||||||||||||||||||

Asimov’s Laws Won’t Stop Robots from Harming Humans, So We’ve Developed a Better Solution

Share on Facebook

Share on Twitter

Share on Reddit

Поделиться на LinkedIn

Поделиться по электронной почте

Распечатать

Авторы и права: Getty Images

Следующее эссе перепечатано с разрешения The Conversation, интернет-издания, освещающего последние исследования.

Как остановить робота от причинения вреда людям? Многие существующие роботы, например те, что собирают автомобили на заводах, немедленно отключаются, когда к ним приближается человек. Но это быстрое решение не сработает для чего-то вроде самоуправляемого автомобиля, которому, возможно, придется двигаться, чтобы избежать столкновения, или робота-помощника, которому, возможно, придется ловить пожилого человека, если он упадет. Поскольку роботы должны стать нашими слугами, компаньонами и коллегами, нам необходимо справляться со все более сложными ситуациями, которые это создаст, и с этическими вопросами и вопросами безопасности, которые это вызовет.

Но это быстрое решение не сработает для чего-то вроде самоуправляемого автомобиля, которому, возможно, придется двигаться, чтобы избежать столкновения, или робота-помощника, которому, возможно, придется ловить пожилого человека, если он упадет. Поскольку роботы должны стать нашими слугами, компаньонами и коллегами, нам необходимо справляться со все более сложными ситуациями, которые это создаст, и с этическими вопросами и вопросами безопасности, которые это вызовет.

Научная фантастика уже предвидела эту проблему и предлагала различные возможные решения. Наиболее известными были «Три закона робототехники» Айзека Азимова, которые призваны предотвратить причинение роботами вреда людям. Но с 2005 года я и мои коллеги из Университета Хартфордшира работали над идеей, которая могла бы стать альтернативой.

Вместо законов, ограничивающих поведение роботов, мы считаем, что роботы должны быть наделены полномочиями, позволяющими максимизировать возможные способы их действий, чтобы они могли выбрать наилучшее решение для любого заданного сценария. Как мы описываем в новой статье в Frontiers, этот принцип может лечь в основу нового набора универсальных рекомендаций для роботов, чтобы обеспечить максимальную безопасность людей.

Как мы описываем в новой статье в Frontiers, этот принцип может лечь в основу нового набора универсальных рекомендаций для роботов, чтобы обеспечить максимальную безопасность людей.

Три закона

Три закона Азимова:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

- Робот должен подчиняться приказам, отдаваемым ему людьми, за исключением случаев, когда такие приказы противоречат Первому закону.

- Робот должен защищать свое существование до тех пор, пока такая защита не противоречит Первому или Второму Закону.

Хотя эти законы кажутся правдоподобными, многочисленные аргументы продемонстрировали, почему они неадекватны. Собственные истории Азимова, возможно, представляют собой деконструкцию законов, показывающую, как они неоднократно терпят неудачу в различных ситуациях. Большинство попыток разработать новые рекомендации следуют аналогичному принципу создания безопасных, совместимых и надежных роботов.

Одной из проблем с любыми явно сформулированными руководствами по роботам является необходимость перевести их в формат, с которым могут работать роботы. Понимание всего спектра человеческого языка и опыта, который он представляет, — очень тяжелая работа для робота. Общие поведенческие цели, такие как предотвращение причинения вреда людям или защита существования робота, могут означать разные вещи в разных контекстах. Соблюдение правил может привести к тому, что робот окажется беспомощным и не сможет действовать так, как надеялись его создатели.

Наша альтернативная концепция, наделение полномочиями, означает противоположность беспомощности. Быть наделенным полномочиями означает иметь возможность влиять на ситуацию и осознавать, что вы можете это сделать. Мы разрабатываем способы перевода этой социальной концепции на количественный и функциональный технический язык. Это наделило бы роботов стремлением держать свои варианты открытыми и действовать таким образом, чтобы увеличить их влияние на мир.

Когда мы попытались смоделировать, как роботы будут использовать принцип наделения полномочиями в различных сценариях, мы обнаружили, что они часто будут действовать на удивление «естественно». Обычно от них требуется только моделирование того, как работает реальный мир, но не требуется никакого специализированного программирования искусственного интеллекта, предназначенного для работы с конкретным сценарием.

Но чтобы обеспечить безопасность людей, роботы должны пытаться поддерживать или улучшать человеческие возможности, а также свои собственные. По сути, это означает защищать и поддерживать. Открытие запертой двери для кого-то увеличит их возможности. Их сдерживание приведет к кратковременной потере полномочий. А причинение им значительного вреда может полностью лишить их возможности. В то же время робот должен пытаться поддерживать свои собственные возможности, например, гарантируя, что у него достаточно мощности для работы, и что он не застревает и не повреждается.

Роботы могут адаптироваться к новым ситуациям

Использование этого общего принципа, а не предопределенных правил поведения, позволит роботу учитывать контекст и оценивать сценарии, которые никто ранее не предполагал. Например, вместо того, чтобы всегда следовать правилу «не толкать людей», робот, как правило, избегает толкать их, но все же может оттолкнуть их от падающего объекта. Человеку все еще может быть причинен вред, но меньше, чем если бы робот его не толкал.

В фильме «Я, робот», основанном на нескольких рассказах Азимова, роботы создают угнетающее состояние, которое должно свести к минимуму общий вред людям, удерживая их взаперти и «защищая». Но наш принцип избегал бы такого сценария, потому что это означало бы потерю человеческих возможностей.

Расширение прав и возможностей позволяет по-новому взглянуть на безопасное поведение роботов, но нам еще предстоит проделать большую работу по повышению его эффективности, чтобы его можно было легко развернуть на любом роботе и добиться хорошего и безопасного поведения во всех отношениях. Это ставит очень трудную задачу. Но мы твердо верим, что расширение прав и возможностей может привести нас к практическому решению постоянной и широко обсуждаемой проблемы того, как обуздать поведение роботов и как сохранить роботов — в самом наивном смысле — «этичными».

Это ставит очень трудную задачу. Но мы твердо верим, что расширение прав и возможностей может привести нас к практическому решению постоянной и широко обсуждаемой проблемы того, как обуздать поведение роботов и как сохранить роботов — в самом наивном смысле — «этичными».

Первоначально эта статья была опубликована на The Conversation. Прочитайте оригинальную статью.

ОБ АВТОРАХ

Всемирный научный сотрудник Марии Кюри, Университет Хартфордшира

Читать далее

Спустя 75 лет «Три закона робототехники» Исаака Азимова нуждаются в обновлении Законы робототехники он думал об андроидах. Он представил себе мир, в котором эти человекоподобные роботы будут действовать как слуги и им потребуется набор правил программирования, чтобы предотвратить причинение вреда. Но за 75 лет, прошедших с момента публикации первого рассказа, в котором представлены его этические принципы, произошли значительные технологические достижения. Теперь у нас совсем другое представление о том, как могут выглядеть роботы и как мы будем с ними взаимодействовать.

Высокоразвитая область робототехники производит огромное количество устройств, от автономных пылесосов до военных дронов и целых заводских производственных линий. В то же время искусственный интеллект и машинное обучение все чаще стоят за большей частью программного обеспечения, которое ежедневно влияет на нас, независимо от того, ищем ли мы в Интернете или предоставляем государственные услуги. Эти разработки быстро ведут к тому времени, когда роботы всех видов станут преобладать почти во всех аспектах жизни общества, а взаимодействие человека и робота значительно возрастет.

Законы Азимова до сих пор упоминаются как шаблон для руководства нашей разработкой роботов. В 2007 году правительство Южной Кореи даже предложило Хартию этики роботов, отражающую законы. Но учитывая, насколько робототехника изменилась и будет продолжать развиваться в будущем, мы должны задаться вопросом, как эти правила могут быть обновлены для версии искусственного интеллекта 21-го века.

Три закона

Предложенные Азимовым законы были разработаны для защиты людей от взаимодействия с роботами. Их:

Их:

- Робот не может причинить вред человеку или своим бездействием допустить причинение вреда человеку

- Робот должен подчиняться приказам, отдаваемым ему людьми, за исключением случаев, когда такие приказы противоречат Первому закону

- Робот должен защищать свое существование до тех пор, пока такая защита не противоречит Первому или Второму Закону

Как уже упоминалось, одна из очевидных проблем заключается в том, что современные роботы кажутся гораздо более разнообразными, чем в рассказах Азимова, включая и гораздо более простых. Поэтому нам нужно подумать, следует ли нам установить порог сложности, ниже которого правила могут не потребоваться. Трудно представить себе робота-пылесоса, способного причинять вред людям или даже требующего способности подчиняться приказам. Это робот с единственной задачей, которая может быть задана до его включения.

Однако на другом конце спектра находятся роботы, предназначенные для военных боевых действий. Эти устройства разрабатываются для шпионажа, обезвреживания бомб или перевозки грузов. Похоже, что они по-прежнему соответствуют законам Азимова, особенно потому, что они создаются для снижения риска для человеческих жизней в очень опасных условиях.

Эти устройства разрабатываются для шпионажа, обезвреживания бомб или перевозки грузов. Похоже, что они по-прежнему соответствуют законам Азимова, особенно потому, что они создаются для снижения риска для человеческих жизней в очень опасных условиях.

Но это всего лишь небольшой шаг, чтобы предположить, что конечной военной целью будет создание вооруженных роботов, которые можно будет использовать на поле боя. В этой ситуации Первый закон — не причинять вреда людям — становится чрезвычайно проблематичным. Роль военных часто заключается в спасении жизней солдат и гражданских лиц, но часто и в нанесении вреда своим врагам на поле боя. Таким образом, законы, возможно, придется рассматривать с разных точек зрения или интерпретаций.

Двусмысленность законов побудила авторов, в том числе Азимова, исследовать, как они могут быть неправильно истолкованы или применены. Одна проблема заключается в том, что они на самом деле не определяют, что такое робот. По мере того, как исследования раздвигают границы технологий, появляются новые отрасли робототехники, в которых рассматриваются более молекулярные устройства.

Например, «роботы», сделанные из ДНК и белков, могут использоваться в хирургии для исправления генных нарушений. Теоретически эти устройства должны действительно следовать законам Азимова. Но для того, чтобы они могли следовать приказам через сигналы ДНК, им, по сути, нужно было стать неотъемлемой частью человека, над которым они работали. Эта интеграция затем затруднила бы определение того, был ли робот достаточно независимым, чтобы подпадать под действие законов или действовать вне их. И на практическом уровне для него было бы невозможно определить, причинят ли какие-либо полученные им приказы вред человеку в случае их выполнения.

Есть еще вопрос, что считается причинением вреда человеку. Это может быть проблемой, например, при рассмотрении вопроса о разработке младенцев-роботов в Японии. Если бы человек принял одного из этих роботов, это могло бы нанести эмоциональный или психологический вред. Но этот вред мог возникнуть не в результате непосредственных действий робота или стать очевидным только через много лет после прекращения взаимодействия человека и робота. Эта проблема может относиться даже к гораздо более простому ИИ, например, к использованию машинного обучения для создания музыки, вызывающей эмоции.

Эта проблема может относиться даже к гораздо более простому ИИ, например, к использованию машинного обучения для создания музыки, вызывающей эмоции.

Практические проблемы

Другая большая проблема с законами заключается в том, что нам потребуется значительный прогресс в области ИИ, чтобы роботы действительно могли им следовать. Цель исследований ИИ иногда описывается как разработка машин, которые могут мыслить и действовать рационально, как человек. До сих пор подражание человеческому поведению не было хорошо изучено в области ИИ, и развитие рационального поведения было сосредоточено в ограниченных, четко определенных областях.

Имея это в виду, робот может действовать только в очень ограниченной сфере, и любое рациональное применение законов будет сильно ограничено. Даже это может быть невозможно с современными технологиями, поскольку система, которая могла бы рассуждать и принимать решения на основе законов, нуждалась бы в значительной вычислительной мощности.

10.2012 23:29

10.2012 23:29

.» Почему на протяжении тысяч лет людьми правят троглодиты с дубинами, не потому ли что у нас в чести сила, при которой мозгов не надо?

.» Почему на протяжении тысяч лет людьми правят троглодиты с дубинами, не потому ли что у нас в чести сила, при которой мозгов не надо? Все упирается в алгоритмический предел двоичности («ДА-НЕТ» и в промежутке «НЕ ЗНАЮ»). Для того, чтобы научить робота мыслить и экстраполировать свои выводы, необходим некий посторонний сегмент случайности, по-другому именуемый — «Интуитивный подход для Искусственного Интеллекта» или иначе(частный, индивидуальный). Для этого необходимо выйти из стандартной теории математических алгоритмов, которая способна лишь заложить программу действий и ассоциаций для систем-ИИ, но не может придать этим системам способы частных связей в нейронных цепях, коих в биологическом мозге миллиард миллиардов, плюс поперечные влияния и импульсы (рефлекторное осознание). Выражаясь короче системам-ИИ необходима матрица индивидуальности как для самообучения, так и для умения адекватно отражать не только факты, но и постфактумы, а также принимать какие-либо собственные решения на базе заложенной ранее (обучение, воспитание) логической доминанты (логика добра или логика зла). Здесь уже не предоставляется возможности ограничить системы-ИИ тремя законами.

Все упирается в алгоритмический предел двоичности («ДА-НЕТ» и в промежутке «НЕ ЗНАЮ»). Для того, чтобы научить робота мыслить и экстраполировать свои выводы, необходим некий посторонний сегмент случайности, по-другому именуемый — «Интуитивный подход для Искусственного Интеллекта» или иначе(частный, индивидуальный). Для этого необходимо выйти из стандартной теории математических алгоритмов, которая способна лишь заложить программу действий и ассоциаций для систем-ИИ, но не может придать этим системам способы частных связей в нейронных цепях, коих в биологическом мозге миллиард миллиардов, плюс поперечные влияния и импульсы (рефлекторное осознание). Выражаясь короче системам-ИИ необходима матрица индивидуальности как для самообучения, так и для умения адекватно отражать не только факты, но и постфактумы, а также принимать какие-либо собственные решения на базе заложенной ранее (обучение, воспитание) логической доминанты (логика добра или логика зла). Здесь уже не предоставляется возможности ограничить системы-ИИ тремя законами. Если все же удастся впихнуть в систему эти три закона, тогда поле для индивидуального мышления будет закрыто, следовательно, объект руководимый этими законами будет не более чем тупо калькулирующей машиной. И любой одаренный хакер прожует и выплюнет эти закона как семечки… Заметили? Все как у людей ВОСПИТАНИЕ и ОБУЧЕНИЕ! Иначе получается простой компьютер…

Если все же удастся впихнуть в систему эти три закона, тогда поле для индивидуального мышления будет закрыто, следовательно, объект руководимый этими законами будет не более чем тупо калькулирующей машиной. И любой одаренный хакер прожует и выплюнет эти закона как семечки… Заметили? Все как у людей ВОСПИТАНИЕ и ОБУЧЕНИЕ! Иначе получается простой компьютер…

.. Любое видение или созерцание — это есть сенсорно воспринимаемая нами цепь незапрограммированных (без учета участия Бога) случайных событий. Вспомните о яблоке Ньютона… Это о бессознательном нахождении решения (озарение). Именно «Бытие или цепь случайных событий — например; зарождение жизни на Земле, взрыв и расширение Вселенной) определяет сознание» Если сказать еще более доходчиво то, — Бытие это взаимосвязь Энергии всех уровней, результатом взаимосвязи которых являются незапрограммированые события, другими словами — СЛУЧАЙНЫЕ и в большей степени непредсказуемые. Например, упади в эпоху динозавров астероид побольше то, нашего с Вами диалога не существовало бы. Итак «Бытие определяет сознание». Прямой аргумент это — адаптация живых организмов к условиям обитания.

.. Любое видение или созерцание — это есть сенсорно воспринимаемая нами цепь незапрограммированных (без учета участия Бога) случайных событий. Вспомните о яблоке Ньютона… Это о бессознательном нахождении решения (озарение). Именно «Бытие или цепь случайных событий — например; зарождение жизни на Земле, взрыв и расширение Вселенной) определяет сознание» Если сказать еще более доходчиво то, — Бытие это взаимосвязь Энергии всех уровней, результатом взаимосвязи которых являются незапрограммированые события, другими словами — СЛУЧАЙНЫЕ и в большей степени непредсказуемые. Например, упади в эпоху динозавров астероид побольше то, нашего с Вами диалога не существовало бы. Итак «Бытие определяет сознание». Прямой аргумент это — адаптация живых организмов к условиям обитания. Соответственно объстоятельствам и выводятся решения. А вот какие именно решения — это зависит от прожитого опыта, склада ума и воспитания (программы)… но в большей степени от склада ума, опыта и в меньшей степени от воспитания. Поскольку в различных ситуациях разумное существо ведет себя по разному и эта разность определяется именно складом ума и опытом.

Соответственно объстоятельствам и выводятся решения. А вот какие именно решения — это зависит от прожитого опыта, склада ума и воспитания (программы)… но в большей степени от склада ума, опыта и в меньшей степени от воспитания. Поскольку в различных ситуациях разумное существо ведет себя по разному и эта разность определяется именно складом ума и опытом. . (Эти три закона, — не более чем шутка Азимова, Царствия ему Небесного, поскольку эти законы совершенно невозможно экстраполировать в математическую логику. В сущности они противоречат с друг другом.)

. (Эти три закона, — не более чем шутка Азимова, Царствия ему Небесного, поскольку эти законы совершенно невозможно экстраполировать в математическую логику. В сущности они противоречат с друг другом.) иными словами одна нервная клетка прижившияся на одном участке металла допустим, способна через некоторое время, хоть и продолжительное полностью окупировать его. А теперь представте что кусок жестянки, ограниченый в своих мыслях лиж парой тысяц решений, сможет чувствовать раздражения окружающей среды, а его нейронные связи выйдут за пределы заложеных нами размеров, что обеспечит «механизму» неограниченую память! так что я соглашусь, «чтобы не делал ученый в конечном итоге у него получаеться оружие». и лишь одному богу извесно какие мысли придут в голову бездушной машине превосходящей человека почти во всем в енныйе разы….

иными словами одна нервная клетка прижившияся на одном участке металла допустим, способна через некоторое время, хоть и продолжительное полностью окупировать его. А теперь представте что кусок жестянки, ограниченый в своих мыслях лиж парой тысяц решений, сможет чувствовать раздражения окружающей среды, а его нейронные связи выйдут за пределы заложеных нами размеров, что обеспечит «механизму» неограниченую память! так что я соглашусь, «чтобы не делал ученый в конечном итоге у него получаеться оружие». и лишь одному богу извесно какие мысли придут в голову бездушной машине превосходящей человека почти во всем в енныйе разы….

В наши дни мы так привыкли к ним, что почти не задумываемся об этом.

В наши дни мы так привыкли к ним, что почти не задумываемся об этом.

В случае противоречия этих законов приоритет отдается первому закону, затем второму закону, а самосохранение робота занимает последнее место. Например, если человек приказал роботу атаковать другого человека, он отказался бы выполнять приказ (первый закон имеет приоритет над вторым), но если человек приказал ему разобрать себя, он подчинился бы (второй закон имеет приоритет над третьим).

В случае противоречия этих законов приоритет отдается первому закону, затем второму закону, а самосохранение робота занимает последнее место. Например, если человек приказал роботу атаковать другого человека, он отказался бы выполнять приказ (первый закон имеет приоритет над вторым), но если человек приказал ему разобрать себя, он подчинился бы (второй закон имеет приоритет над третьим). После него у нас дружелюбные, почти человеческие андроиды.

После него у нас дружелюбные, почти человеческие андроиды. Нулевой Закон (он появился позже, хронологически, но более фундаментален) гласит, что робот не способен причинить вред Человечеству, ни своим бездействием……

Нулевой Закон (он появился позже, хронологически, но более фундаментален) гласит, что робот не способен причинить вред Человечеству, ни своим бездействием……