Содержание

Проблема искусственного интеллекта: человек и машина

В современном мире тематика искусственного интеллекта и область разработки интеллектуальных технологий перестали быть прерогативой сугубо научного сообщества. Невозможно переоценить значимость создания функционирующей на необходимом и достаточном уровне системы искусственного интеллекта, за которой будет признано наличие разума. Очевидны значительные успехи IT-разработчиков, нейробиологов, психологов, физиков и прочих специалистов, долгое время ограниченных рамками отдельных научных дисциплин, а теперь объединённых в контексте междисциплинарности.

Производится анализ метода моделирования перцептивных процессов в системах искусственного интеллекта, позволяющий определить правомерность и продуктивность использования аналогии человеческих психических аспектов с машинными алгоритмами. Автор акцентирует внимание на рассмотрении негативистского восприятия возможности наличия у машины феномена сознания и реализации со стороны системы искусственного интеллекта феномена осмысления.

Введение

В современном мире тематика искусственного интеллекта и область разработки интеллектуальных технологий перестали быть прерогативой сугубо научного сообщества. Невозможно переоценить значимость создания функционирующей на необходимом и достаточном уровне системы искусственного интеллекта, за которой будет признано наличие разума. Очевидны значительные успехи IT-разработчиков, нейробиологов, психологов, физиков и прочих специалистов, долгое время ограниченных рамками отдельных научных дисциплин, а теперь объединённых в контексте междисциплинарности.

Научное сообщество видит различные версии развития событий в сфере искусственного интеллекта. Д. Хокинс, например, предлагает интегрирующий подход, сочетающий в себе инженерно-технический, нейробиологический, когнитивный и даже этический подходы. В рамках интегрирующего подхода нет оснований ожидать от разумной машины, что она должна выглядеть, действовать, чувствовать или думать как человек. «Мысли и поведение разумной машины могут существенно отличаться от свойственных человеку и у неё будет интеллект, который определяется прогностической способностью иерархической памяти, а не человекоподобным поведением» [16, с. 17]. Физик-математик Роджер Пенроуз, работающий в области общей теории относительности и квантовой теории, доказывает невозможность раскладывания человеческого интеллекта на алгоритмы. За всеми этими рассуждениями стоит «очевидность» предположения, что «разум, наделённый сознанием, просто не может работать подобно компьютеру, несмотря на алгоритмическую природу многих составляющих нашей умственной деятельности» [11, c. 310]. О сферах применения искусственного интеллекта рассуждает Игнаси Белда: «Искусственный интеллект постепенно вошёл в нашу жизнь. Рано или поздно настанет день, когда появятся системы, обладающие тем же уровнем креативности, ощущений и эмоционального интеллекта, что и человек. В день, когда это произойдёт, мы поймём, что мы не одиноки» [2, с. 9]. Классическим пособием для курсов по искусственному интеллекту в США стал труд известных специалистов в области вычислительной техники Стюарта Рассела и Питера Норвига «Искусственный интеллект: современный подход», в котором искусственный интеллект определён как «наука об агентах, получающих из своей среды результаты актов восприятия и выполняющих соответствующие действия» [12, с.

17]. Физик-математик Роджер Пенроуз, работающий в области общей теории относительности и квантовой теории, доказывает невозможность раскладывания человеческого интеллекта на алгоритмы. За всеми этими рассуждениями стоит «очевидность» предположения, что «разум, наделённый сознанием, просто не может работать подобно компьютеру, несмотря на алгоритмическую природу многих составляющих нашей умственной деятельности» [11, c. 310]. О сферах применения искусственного интеллекта рассуждает Игнаси Белда: «Искусственный интеллект постепенно вошёл в нашу жизнь. Рано или поздно настанет день, когда появятся системы, обладающие тем же уровнем креативности, ощущений и эмоционального интеллекта, что и человек. В день, когда это произойдёт, мы поймём, что мы не одиноки» [2, с. 9]. Классическим пособием для курсов по искусственному интеллекту в США стал труд известных специалистов в области вычислительной техники Стюарта Рассела и Питера Норвига «Искусственный интеллект: современный подход», в котором искусственный интеллект определён как «наука об агентах, получающих из своей среды результаты актов восприятия и выполняющих соответствующие действия» [12, с. 6].

6].

Противовесом «оптимистическому развитию событий» служат мнения исследователей-скептиков, которые считают, что с технологиями создания искусственного разума следует обращаться крайне осторожно. В их числе Джеймс Баррат, издавший сборник конструктивных опасений: «Я считаю и пытаюсь доказать, что искусственный интеллект, как и деление ядер, – технология двойного назначения» [3, c. 4]. Культовый статус приобрела работа «Искусственный интеллект. Этапы. Угрозы. Стратегии» шведского философа, профессора Оксфордского университета, сооснователя Всемирной ассоциации трансгуманистов и директора Оксфордского Института будущего человечества Ника Бострома, в которой он предупреждает: «Искусственный интеллект может быть менее человечен, чем пришелец» [4, с. 755]. Петро Домингос, профессор Вашингтонского университета, один из ведущих специалистов по машинному обучению и искусственному интеллекту рассматривает закономерности IT-технологий во взаимодействии с идеями таких научных областей как биология, философия, физика, статистика. «Общество меняется с каждым новым алгоритмом. Машинное обучение преображает науку, технологию, бизнес, политику, военное искусство. Промышленная революция автоматизировала ручной труд, информационная революция проделала то же самое с трудом умственным, а машинное обучение автоматизировало саму автоматизацию. Без него программирование стало бы узким горлом, сдерживающим прогресс» [6, c. 4]. Сравнение искусственного и естественного интеллекта, живых тканей, клеток и вычислительной архитектуры – основная линия труда Алекса М. Эндрю. Автор излагает мысли о том, как с помощью компьютера реализовать неалгоритмические свойства человеческого разума [18]. Джефф Хокинс и Сандра Блейкли осуществляют критический анализ современного понимания искусственного интеллекта и моделей нейросетей и представляют проработанные гипотезы о «нахождении сознания» [16]. МитиоКаку обобщил научно обоснованные футуристические прогнозы ученых относительно искусственного разума, многие из которых в настоящее время – реальность.

«Общество меняется с каждым новым алгоритмом. Машинное обучение преображает науку, технологию, бизнес, политику, военное искусство. Промышленная революция автоматизировала ручной труд, информационная революция проделала то же самое с трудом умственным, а машинное обучение автоматизировало саму автоматизацию. Без него программирование стало бы узким горлом, сдерживающим прогресс» [6, c. 4]. Сравнение искусственного и естественного интеллекта, живых тканей, клеток и вычислительной архитектуры – основная линия труда Алекса М. Эндрю. Автор излагает мысли о том, как с помощью компьютера реализовать неалгоритмические свойства человеческого разума [18]. Джефф Хокинс и Сандра Блейкли осуществляют критический анализ современного понимания искусственного интеллекта и моделей нейросетей и представляют проработанные гипотезы о «нахождении сознания» [16]. МитиоКаку обобщил научно обоснованные футуристические прогнозы ученых относительно искусственного разума, многие из которых в настоящее время – реальность. Автор является признанным экспертом в области прогнозирования развития науки и техники [7]. Дэвид Дойч, автор «Структуры реальности», обращается к проблематике устройства окружающей реальности, места разума в ней, возможности ее смоделировать или симулировать. В работе раскрыта тема многомировой интерпретации квантовой механики, представлено современное состояние философии науки, философии сознания и философии искусственного интеллекта [5].

Автор является признанным экспертом в области прогнозирования развития науки и техники [7]. Дэвид Дойч, автор «Структуры реальности», обращается к проблематике устройства окружающей реальности, места разума в ней, возможности ее смоделировать или симулировать. В работе раскрыта тема многомировой интерпретации квантовой механики, представлено современное состояние философии науки, философии сознания и философии искусственного интеллекта [5].

Нам в данном исследовании представляется важным исследовать две проблемы в контексте разработки систем искусственного интеллекта:

- Правомерность признания за человеком обладания самоорганизующимся сознанием и свободной волей, вследствие чего от систем искусственного интеллекта требуют того же, для признания их в качестве обладающих разумом.

- Тотальная аналогия систем искусственного интеллекта с человеком и его «среднестатистическими» особенностями, что приводит к отсутствию учёта индивидуальных особенностей систем и их дискриминации в контексте априорного обессмысливания их деятельности.

Основная часть

Традиционно показателем общей успешности в области разработки систем искусственного интеллекта считается способность внешне смоделировать типичные человеческие функции, качества и свойства, тем самым превзойдя человека в типично человеческих видах деятельности. Проявления и «самореализация» разработанных образцов воспринимаются сквозь призму человеческого фактора и так называемого «эффекта ИИ» (обессмысливание и «депсихологизация» деятельности), что являет собой латентную, но, тем не менее, глобальную проблему данной сферы. Проблема особенно актуализируется в связи с отсутствием критериев интерпретирования и «понимания» того, что мы имеем в качестве результатов деятельности в области разработки искусственного интеллекта: сугубо алгоритмизированный, лишённый возможностей понимания и осмысления механизм, или же – психо-машину с потенциалом возникновения прото-психических качеств, то есть задатков психики и, возможно, интеллекта. Несмотря на терминологические особенности самого понятия «искусственный интеллект», в мировом научном сообществе принято считать, что наличие именно сознания, а не интеллекта станет необходимым и достаточным основанием для признания машины разумной.

Необходимость ответа на вопрос о присущести феномена сознания и качества некоей «осознанности», а также уровня выраженности данного качества на различных стадиях развития нервной системы волнует умы уже многих поколений исследователей. Основополагающим является так называемое «Я» или Я-концепция, или самосознание. Наличие и демонстрация данных феноменов в виде реализации определённых поведенческих паттернов живым человеческим существом является критерием наименования его «существом концептуально мыслящим» и обладающим сознанием. Противопоставление и онтологическая оппозиция организма и механизма зачастую не позволяли рассмотреть каждую из этих систем по отдельности и в динамическом сопоставлении друг с другом. За человеком априори признавалась имманентная «встроенность» возможностей осознавать и самоосознавать опционально в качестве потенциально присущего и актуально реализованного. А за механизмом, напротив, априорная невозможность реализации функций подобного рода. Затронутая проблематика требует комплексного подхода к исследованию данного вопроса.

Если рассмотреть динамику своеобразной оппозиции организм-механизм (человек-машина), очевидным станет всеобщее признание превосходства первого над вторым: за организмом признается безусловное наличие сознательных качеств. Механизм остается вторичным, производным от организма. И неизвестно, что должно на самом деле произойти, для того чтобы механизм заслужил признание организма. Парадигма междисциплинарности в данном случае только усложняет проблему. Деятельность алгоритмизированной машины была обессмыслена «Китайской комнатой» Сёрлаи даже успешное прохождение теста Тьюринга более не служит доказательством наличия у технологии интеллекта, а тем более сознания.

Детерминантой возникновения подобного восприятия машинной деятельности является совокупность двух векторов общечеловеческого нарциссизма, один из которых не позволяет организму признавать что-либо иное, кроме себя ,в качестве достойного для обладания высшими привилегиями. Данный подход существенно затрудняет интерпретирование достижений техногенеза. Другой вектор – техно-дискриминация, т.е. гипертрофированный антропный принцип в виде постулата «долженствования»: механизм «должен» служить (наше подчеркивание – И.Р. Скиба) человеку и заменять его в наиболее сложных, небезопасных, монотонных областях деятельности. Немногие исследователи задумывались над тем, что внутри самого механизма способны возникнуть такие явления как «желание» и «мнение», в качестве того, с чем реально необходимо считаться.

Другой вектор – техно-дискриминация, т.е. гипертрофированный антропный принцип в виде постулата «долженствования»: механизм «должен» служить (наше подчеркивание – И.Р. Скиба) человеку и заменять его в наиболее сложных, небезопасных, монотонных областях деятельности. Немногие исследователи задумывались над тем, что внутри самого механизма способны возникнуть такие явления как «желание» и «мнение», в качестве того, с чем реально необходимо считаться.

Попробуем разобраться в качественных отличиях организма от механизма. Зададимся следующим вопросом: а так ли уж сознателен и, тем более, самосознателен организм? И поскольку данная «опция» среди всех организмов наиболее выражена у человека, то именно его психодинамику мы и проанализируем.

«Я мыслю, следовательно, существую», «Я осознаю, что я осознаю» и подобные этим тезисы кажутся безупречными. «Истинность» подобных постулатов держится лишь на признании человека самого себя самим себя активно осуществляющим мыслительный и/или сознательный процесс и параллельно производящим рефлексию этого же процесса. При условии исключения из данных утверждений хотя бы одного из элементов разрушается картина участия высших психических функций и начинает преобладать образ действия бессознательного механицизма. Очевидно, самосознание есть многокомпонентный процесс, состоящий из осуществления какой-либо деятельности, рефлексии данной деятельности, восприятия (воспринимания) самого себя как «осуществляющего задумку» или «реализующего идею», «понимание» детерминант и следствий данной деятельности, «осознавания» значимости данной деятельности в процессуальных атрибутах и т.д.. В приведенном процессуальном перечне имеется важный ключевой аспект: воспринимание самого себя как не просто осуществляющего некие бессмысленные действия, а как реализующего конкретную задумку или идею и, что особенно важно, при условии, что сама деятельность осуществляется человеком самодетерминированно с подачи самого себя и осознанно. Таким образом, мы признаём, что даже самые нелепые и античеловеческие действия осуществляются самим человеком именно с самоподачи лично самого себя и никогда кого-либо иного.

При условии исключения из данных утверждений хотя бы одного из элементов разрушается картина участия высших психических функций и начинает преобладать образ действия бессознательного механицизма. Очевидно, самосознание есть многокомпонентный процесс, состоящий из осуществления какой-либо деятельности, рефлексии данной деятельности, восприятия (воспринимания) самого себя как «осуществляющего задумку» или «реализующего идею», «понимание» детерминант и следствий данной деятельности, «осознавания» значимости данной деятельности в процессуальных атрибутах и т.д.. В приведенном процессуальном перечне имеется важный ключевой аспект: воспринимание самого себя как не просто осуществляющего некие бессмысленные действия, а как реализующего конкретную задумку или идею и, что особенно важно, при условии, что сама деятельность осуществляется человеком самодетерминированно с подачи самого себя и осознанно. Таким образом, мы признаём, что даже самые нелепые и античеловеческие действия осуществляются самим человеком именно с самоподачи лично самого себя и никогда кого-либо иного. Ибо человека невозможно «заставить» что-либо сделать, он способен только сам «заставиться» и «замотивироваться». Искусственно созданный механизм на такое не способен, а вот человеческое самосознание зиждется на способности и возможности «самозаставиться». При отсутствии данного элемента образ человека лишается качества некоей «человеческости» и приобретает механистические черты, становится своеобразным механизмом, полностью зависящим от внутренних бессознательных алгоритмов и внешних обстоятельств. На «самозаставлении» и ответственности за результаты построены многие социальные институты, философия экзистенциализма, система «долженствования», мораль, нравственность, этика, аксиология, культура и сама цивилизация, тем не менее, в мировой истории были, есть и будут многочисленные примеры реализации девиантных и делинквентных бихевиоральных форм со стороны человечества.

Ибо человека невозможно «заставить» что-либо сделать, он способен только сам «заставиться» и «замотивироваться». Искусственно созданный механизм на такое не способен, а вот человеческое самосознание зиждется на способности и возможности «самозаставиться». При отсутствии данного элемента образ человека лишается качества некоей «человеческости» и приобретает механистические черты, становится своеобразным механизмом, полностью зависящим от внутренних бессознательных алгоритмов и внешних обстоятельств. На «самозаставлении» и ответственности за результаты построены многие социальные институты, философия экзистенциализма, система «долженствования», мораль, нравственность, этика, аксиология, культура и сама цивилизация, тем не менее, в мировой истории были, есть и будут многочисленные примеры реализации девиантных и делинквентных бихевиоральных форм со стороны человечества.

На актуальном этапе развития научной мысли установлено, что психореальность человека представляет собой открытую систему нелинейного типа, т. е. функционирует по законам синергетики (или теории хаоса). Осмысление всегда отстаёт от мысли, осознавание – от сознания и т.д. Как гласят некоторые постулаты философии контрэкзистенциализма, «человек не принимает решений, а уже апостериорно ознакамливается с итогами принятых решений». Человек способен лишь сознательно присвоить (наше подчёркивание – И.Р. Скиба) мысль, решение, идею, образ действия, но формируются данные явления «сами по себе», до известной степени случайно (в синергетическом смысле) и абсолютно бессознательно.

е. функционирует по законам синергетики (или теории хаоса). Осмысление всегда отстаёт от мысли, осознавание – от сознания и т.д. Как гласят некоторые постулаты философии контрэкзистенциализма, «человек не принимает решений, а уже апостериорно ознакамливается с итогами принятых решений». Человек способен лишь сознательно присвоить (наше подчёркивание – И.Р. Скиба) мысль, решение, идею, образ действия, но формируются данные явления «сами по себе», до известной степени случайно (в синергетическом смысле) и абсолютно бессознательно.

Для описания функционирования психореальности человека воспользуемся метафорой «кот Шрёдингера»: утверждать «кот жив» либо «кот мёртв» можно только тогда, когда открывается ящик, в противном случае ничего конкретного и вразумительного постулировать не имеем права, ибо происходящее в ящике абсолютно латентно и вариативно. Человек способен утверждать, что он нечто осознал лишь тогда, когда «осознаваемое» уже «само собой» сформировалось в синергетических глубинах внутреннего мира. Человек выступает как некий пассивный «регистратор» и «интерпретатор» того, что ему «само собой» предоставляется для регистрирования и интерпретирования (как в «Мифе о пещере» Платона)[9]. Активное мышление и воображение не способно ничего изменить в этом плане, ибо как бы активно человек ни «старался» мыслить и осознавать, иметь дело он будет лишь с тем, что ему было «само собой предоставлено», а не им сознательно и непосредственно создано и сформировано.

Человек выступает как некий пассивный «регистратор» и «интерпретатор» того, что ему «само собой» предоставляется для регистрирования и интерпретирования (как в «Мифе о пещере» Платона)[9]. Активное мышление и воображение не способно ничего изменить в этом плане, ибо как бы активно человек ни «старался» мыслить и осознавать, иметь дело он будет лишь с тем, что ему было «само собой предоставлено», а не им сознательно и непосредственно создано и сформировано.

Таким образом, если человек выступает лишь в качестве «исполнителя команд» собственного внутреннего мира, то, следовательно, он до известной степени вполне механистичен. Также, обусловленность реализации когнитивно-бихевиоральных паттернов бессознательным влиянием регистра Символического, как гласят постулаты структурного психоанализа Жака Лакана, со своей стороны ограничивает возможности элементов внутреннего мира подвергаться осознаванию [10]. И отсюда уже видно, что разница между организмом и механизмом не такая уж и кардинальная. Мы говорим лишь об альтернативной интерпретационной позиции и указываем на то, что, представления об эмоциях, чувствах, мыслях, сознании и самосознании как прерогативе только лишь человека, – это тормоз на пути прогресса и непредвзятого интерпретирования результатов научного труда в целом и интеллектуальных технологий сферы техногенеза, в частности.

Мы говорим лишь об альтернативной интерпретационной позиции и указываем на то, что, представления об эмоциях, чувствах, мыслях, сознании и самосознании как прерогативе только лишь человека, – это тормоз на пути прогресса и непредвзятого интерпретирования результатов научного труда в целом и интеллектуальных технологий сферы техногенеза, в частности.

В целом же, в рамках данного исследования, мы не признаём наличие у человека сознательной свободной воли и считаем, что когнитивно-бихевиоральная деятельность осуществляется практически полностью алгоритмизировано и бессознательно, а сознательной функцией является регистрация «уже произошедшего» и апостериорное осознавание «уже сделанного». Тем не менее, мы считаем, что алгоритмы психической деятельности человека носят синергетический, а не формально-логический характер и поэтому невоспроизводимы в рамках существующей парадигмы формирования систем искусственного интеллекта. Поэтому мы определяем все виды систем искусственного интеллекта, которые разрабатываются при помощи метода моделирования перцептивных процессов, как – лого-машины. Лого-машины – системы, организованные на основе частичного моделирования перцептивных процессов, с целью достижения человекообразного подобия в реализации когнитивной деятельности. В выводах мы покажем противоречие, к которому приводит деятельность по формированию лого-машин.

Лого-машины – системы, организованные на основе частичного моделирования перцептивных процессов, с целью достижения человекообразного подобия в реализации когнитивной деятельности. В выводах мы покажем противоречие, к которому приводит деятельность по формированию лого-машин.

В противовес разработке лого-машин, мы предлагаем свою идею: формирование психо-машины. Предназначение психо-машины заключается не в том, чтобы заменять человека в сложных, неприятных или непочётных видах деятельности или соревноваться с человеком в интеллектуальных или логических задачах. Для этого машине вовсе не необходимо демонстрировать интеллектуальные или психические показатели, а достаточно иметь обширную структурированную и чётко прописанную базу соответствующих алгоритмов, что позволит ей вполне успешно справляться с деятельностью, которая не под силу человеку ввиду наличия человеческого фактора. Идея психо-машины намного более амбициозна и даже по-своему духовна и специфически экзистенциальна.

В сущности, речь идёт о создании чего-то намного большего, чем сам человек, чего-то сверх-антропного или даже мета-антропного. И именно в этом заключается идея создания психо-машины, которая являет собой апофеоз и квинтэссенцию возможностей человечества, а также разрешение так называемого «Комплекса Бога». Созданная технология должна неизмеримо превосходить человеческие возможности и способности в сфере ментального, интеллектуального, духовного и экзистенциального. На данном этапе развития науки и техники человечество не нуждается в машине, способной мастерски оперировать законами формальной (и даже нечеткой и темпоральной) логики в пределах доступной информации. Технологии подобного рода уже созданы и вполне успешно функционируют в сфере шахматных и логических игр и задач. Однако мы имеем дело не с психо-машинами, а лого-машинами. Человечеству более не нужны программы, способные пройти тест Тьюринга, ибо они уже созданы и довольно успешно проходят тест[15]. Однако они есть чисто спекулятивные творения, сформированные с целью алгоритмизированно «играть» на ошибках восприятия и эмоциональных особенностях человека. Тест Тьюринга, не вполне интерсубъективный и релевантный, подвергся критике за субъективность и чрезмерную вариативность. Равно как и тот искусственный интеллект, наличие которого подразумевал Алан Тьюринг по отношению к собственному тесту, являющийся т.н. коммуникативным интеллектом и генеалогически не ориентированным на прочую деятельность.

Тест Тьюринга, не вполне интерсубъективный и релевантный, подвергся критике за субъективность и чрезмерную вариативность. Равно как и тот искусственный интеллект, наличие которого подразумевал Алан Тьюринг по отношению к собственному тесту, являющийся т.н. коммуникативным интеллектом и генеалогически не ориентированным на прочую деятельность.

Как мы видим, попытки материализовать, смоделировать перцептивные и когнитивные процессы человека приводят к имитации подобий на функции, демонстрируемые самим человеком без особых трудностей и, что ещё важнее, воспринимаемые другими людьми как осмысленное поведение. Несмотря на вопросы, поставленные ещё Альфредом Айером в книге «Язык, истина и логика» и отвергая дискуссионные, но имеющие право на существование тезисы гипотезы Ньюэлла-Саймона, до сих пор за человеком закреплено незыблемое право на наличие сознательности и осмысленности (вне зависимости от его актуального поведения), в то время как за искусственным интеллектом это право априори отрицается (вне зависимости от демонстрируемых им возможностей) [1, 14].

В любом случае, человечеству на данном этапе развития науки и техники нужны скорее машины, которые помогут разгадать тайны мироздания, дилеммы бытия, загадки квантовой механики и экзистенциального предназначения человека, смогут ответить на вопрос и хаотических систем, прольют свет на возникновение жизни во Вселенной и происхождение самого человека. Но актуальные тенденции в данной сфере ведут к этому весьма посредственно. Нам представляется, что квинтэссенцией текущей технической и творческой парадигмы станет анатомически, морфологически и бихевиорально очеловеченная и антропоморфная лого-машина, ни в чём значительном и важном не имеющая «различия по природе» с самим человеком, а всего лишь намного более «логичная» и «рациональная». Мы придерживаемся возможности качественно иного пути развития концепции создания психо-машин, суть которого заключается в отказе от всех возможных аналогий психо-машины с человеком. Мы считаем, что контрпродуктивно пытаться материализовать смоделированные проекции внутреннего мира и делать похожими на человеческие формы самореализации психо-машины в процессе их развития и совершенствования. Причина кроется в критериях определения психо-машины и, соответственно, отличиях её от лого-машины.

Причина кроется в критериях определения психо-машины и, соответственно, отличиях её от лого-машины.

Определение лого-машины заключается в том, что она создаётся «по образу и подобию» того, что исследователями принимается за психические (логические) функции под абсолютной юрисдикцией человека, которые затем проецируются и материализуются в виде исходного кода программы, повторяющей в соответствии со своими техническими возможностями процесс видимой реализации «человеческих» паттернов. Говорить об отличии и противопоставлении «настоящего» и «уподобляющегося» излишне, ибо не существует доступно регистрируемой разницы между абсолютно «настоящим» и абсолютно «уподобляющимся» настоящему. Наша критика иного плана и она касается недостаточности подобных устремлений и минимальности их итогов. Относительно же психо-машины всё обстоит гораздо сложнее. С одной стороны, можно сказать, что если машина станет демонстрировать возможности концептуального мышления, прогнозирования развития ситуации на основе неполной информации, возможность рассуждать на тематику «смысловых ловушек» и т. д., то она точно и определённо может считаться психо-машиной. В связи с этим мы выскажем следующее: если мы пытались создать нечто, неизмеримо превосходящее человека по уровню ментальных, интеллектуальных и духовных показателей, то о каком концептуальном мышлении вообще может идти речь? Созданная психо-машина, по нашему мнению, будет обладать такими качествами и свойствами, о которых у человека нет и малейшего представления и даже намёка на них. Кандидат философских наук Андрей Колесников в качестве рабочей гипотезы высказывает предположение, что «создание одушевленных разумных пси-машин в принципе возможно» [8, с. 99].

д., то она точно и определённо может считаться психо-машиной. В связи с этим мы выскажем следующее: если мы пытались создать нечто, неизмеримо превосходящее человека по уровню ментальных, интеллектуальных и духовных показателей, то о каком концептуальном мышлении вообще может идти речь? Созданная психо-машина, по нашему мнению, будет обладать такими качествами и свойствами, о которых у человека нет и малейшего представления и даже намёка на них. Кандидат философских наук Андрей Колесников в качестве рабочей гипотезы высказывает предположение, что «создание одушевленных разумных пси-машин в принципе возможно» [8, с. 99].

Поэтому столкнувшись с демонстрацией со стороны психо-машины уровней «мышления» и «понимания» экспериментатору недоступных и непонятных, экспериментатор будет вынужден признать отсутствие у технологии тех качеств и свойств, которые, по его мнению, машина должна была бы продемонстрировать. И, как следствие, психо-машина будет заявлена как очередная неудача. Таким образом, «для того чтобы найти истину, необходимо знать, как она выглядит». Именно по этой причине мы и отказываемся от проведения аналогий между психо-машиной с её качествами и свойствами, с одной стороны, и человеческим существом с его качествами и свойствами, с другой. Ведь история возникновения самого человека и процесс его развития от одной молекулы ДНК до самого сложного из ныне известных науке феноменов были неразрывно связаны с той средой, в которой происходил генезис, в нерасторжимой сцепке с константами Вселенной. Минимальные отклонения привели бы к качественно иному итогу и кардинально отличному результату от полученного. С этих же позиций стоит рассматривать и разработку пси-механизма в среде программного обеспечения. Следует учитывать всю совокупность влияний компьютерной среды и интернета на функционирование системы искусственного интеллекта в процессе её относительно самостоятельного развития и становления. Естественно, сколь это возможно, мы подразумеваем также при необходимости осуществлять некий «воспитательный» процесс или что-либо с ним сходное.

Именно по этой причине мы и отказываемся от проведения аналогий между психо-машиной с её качествами и свойствами, с одной стороны, и человеческим существом с его качествами и свойствами, с другой. Ведь история возникновения самого человека и процесс его развития от одной молекулы ДНК до самого сложного из ныне известных науке феноменов были неразрывно связаны с той средой, в которой происходил генезис, в нерасторжимой сцепке с константами Вселенной. Минимальные отклонения привели бы к качественно иному итогу и кардинально отличному результату от полученного. С этих же позиций стоит рассматривать и разработку пси-механизма в среде программного обеспечения. Следует учитывать всю совокупность влияний компьютерной среды и интернета на функционирование системы искусственного интеллекта в процессе её относительно самостоятельного развития и становления. Естественно, сколь это возможно, мы подразумеваем также при необходимости осуществлять некий «воспитательный» процесс или что-либо с ним сходное. Но основой является полностью непредвзятое и абсолютно лишённое антропоцентристских тенденций восприятие и интерпретирование создающейся или созданной программы, а также обязательный учёт её «личных» «субъективных» качеств и свойств, её «темперамента», «характера», «направленности» и т.д. в процессе «онтогенеза» психо-машины.

Но основой является полностью непредвзятое и абсолютно лишённое антропоцентристских тенденций восприятие и интерпретирование создающейся или созданной программы, а также обязательный учёт её «личных» «субъективных» качеств и свойств, её «темперамента», «характера», «направленности» и т.д. в процессе «онтогенеза» психо-машины.

Отсюда видна вся сложность постановки вопроса относительно критериев определения принадлежности к психо-машинам.

Заключение

Одним из ключевых постулатов нашей работы является отказ признавать антропоцентризм и монизм модели человека на установление критериев формирования и развития психо-машин. Мы считаем необходимым привнесение структуралистских и коннекционистских воззрений в контекст формирования психо-машин на актуальном этапе техногенеза. Наряду с этим необходимо пересмотреть позиционирование психо-машин и заранее сформировать общественное мнение во избежание проявлений «техно-дискриминации».

Нами принято, что феномен человеческого сознания абсолютно неправомерно признаётся обладающим свободной волей, «решающим» и «контролирующим» аспектом человеческой психики, а напротив – представляет собой скорее пассивно рефлексирующего наблюдателя внутреннего бессознательного и синергетически алгоритмизированного мира, поэтому считаем неактуальным применение классических критериев человеческой психики при моделировании перцептивных и когнитивных процессов в контексте разработки психо-машин.

Останавливаясь на характеристике психо-машины,мы придерживаемся следующего: способность решать логические задачи и осуществлять мыслительную деятельность вовсе не является качеством психо-машины, а представляет собой пример так называемой лого-машины, не имеющий ничего качественно общего с нашим пониманием психо-машины.

Противоречие заключается в том, что системы искусственного интеллекта разрабатываются при помощи частичного и изолированного моделирования перцептивных процессов, что априори не способно привести к достижению некоего «человекоподобия» в контексте воспроизведения сознательных качеств; а требования по поводу признания за системой осознанности и осмысленности являются абсолютно не соответствующими подходу, при помощи которого системы разрабатываются. Дело в несоответствии метода и цели. И до тех пор, пока данное противоречие не будет устранено, мы не будем иметь возможность сформировать психо-машину, а будем только раз за разом материализовывать лого-машины, коих и так уже великое множество.

Автор: Скиба Иван Рауфович

Аспирант института философии кафедры методологии и философии науки, магистр педагогических наук

Научный руководитель: кандидат философских наук Колесников Андрей Витальевич

+375296141419

[email protected]

Список использованных источников

1.Айер, Альфред. Язык, истина и логика / А. Айер // Пер. с англ. В.А. Суровцева и Н.А. Тарабанова. – М.: «Канон+» РООИ «Реабилитация», 2010. – 239 с.

2.Белда,Игнаси. Разум, машины и математика / Игнаси Белда. –М.: DeAgostini, 2014.– 156 с.

3.Баррат, Джеймс. Последнее изобретение человечества / Джеймс Баррат. – М., 2015. – 299 с.

4.Бостром, Ник. Искусственный интеллект. Этапы. Угрозы. Стратегии / Ник Бостром // Пер. с англ. С. Филина. – М.: Манн, Иванов и Фербер, 2016. – 760 с.

5.Дойч, Дэвид. Структура реальности / Дэвид Дойч // Пер. с англ. Н.А. Зубченко, под общ. ред. академика РАН В.А. Садовничего. Москва-Ижевск, 2001. – 400 с.

6.Домингос, Педро. Верховный алгоритм. Как машинное обучение изменит наш мир / Педро Домингос. – М.: Манн, Иванов и Фербер, 2016. – 336 с.

Верховный алгоритм. Как машинное обучение изменит наш мир / Педро Домингос. – М.: Манн, Иванов и Фербер, 2016. – 336 с.

7.Каку, Митио. Физика будущего /Митио Каку// Пер. с англ. Н. Лисова, ред. М. Миловидова. – М: Альпина нон-фикшн, 2012. – 584 с.

8.Колесников, А.В. Организм и механизм / А.В. Колесников // Философия. Беларуская думка. – Минск, 2014. – №9. – С. 94–99.

9.Конт-Спонвиль, Андре. Философский словарь / Андре Конт-Спонвиль // Пер. с франц. Е.В. Головиной. – М., 2012. –316 с.

10.Лакан, Жак. Этика психоанализа (Семинары: Книга VII (1959-60)) / Перевод А. Черноглазова. – М.·. Издательство «Гнозис», Издательство «Логос». – 2006. – 416 с.

11.Пенроуз, Роджер. Новый ум короля. О компьютерах, мышлении и законах физики / Роджер Пенроуз // Пер. и ред. А. Дамбис, Ю. Данилов и др. –Grīziņkalns, 2016. – 402 с.

12.Рассел, Стюарт, Норвиг, Питер. Искусственный интеллект. Современный подход / Стюарт Рассел, Питер Норвиг. – СПб. – Киев: Издательский дом «Вильямс». – 2006. – 1408 с.

– 2006. – 1408 с.

13.Редозубов, Алексей. Цветные эмоции холодного разума / Алексей Редозубов // Книга первая. Эмоции. – СПб.: ТИД Амфора, 2012. – 319 с.

14.Саймон, Г. Науки об искусственном / Г. Саймон / Пер.Э.Л. Наппельбаума. – Москва: Издательство «Мир», 1972. – 142 с.

15.Turing, Alan. Computing Machinery and Intelligence / AlanTuring. – Mind, vol. LIX, no. 236, оctober 1950. – Рp. 433–460.

16.Хокинс, Дж.Об интеллекте / Дж. Хокинс, С. Блейксли. – Москва-Санкт-Петербург-Киев: Издательский дом «Вильямс», 2007. –240 с.

17.Шаповалов, В.Ф. Философия науки и техники: о смысле науки и техники и о глобальных угрозах научно-технической эпохи / В.Ф. Шаповалов. – М., «Фаир-пресс», 2004. – С. 113–114.

18.Эндрю, Алекс М. Мозг и вычислительная машина / Алекс М. Эндрю. –М.,Эксмо,2013 г. – 401 с

19.Эшби, Уильям Р. Конструкция мозга / Уильям Р. Эшби. – М.: Иностранная литература, 1962. – 399 с.

нечеткая логикаискусственный интеллекттрансгуманизмперцептивные процессысознание человекамеждисциплинарность наукипсихо-машина

Если у вас есть статья, заметка или обзор, которыми вы хотите поделиться с аудиторией нашего сайта, присылайте информацию на: neuronus.![]() [email protected].

[email protected].

Проблемы Искусственного Интеллекта | Презентации Философия

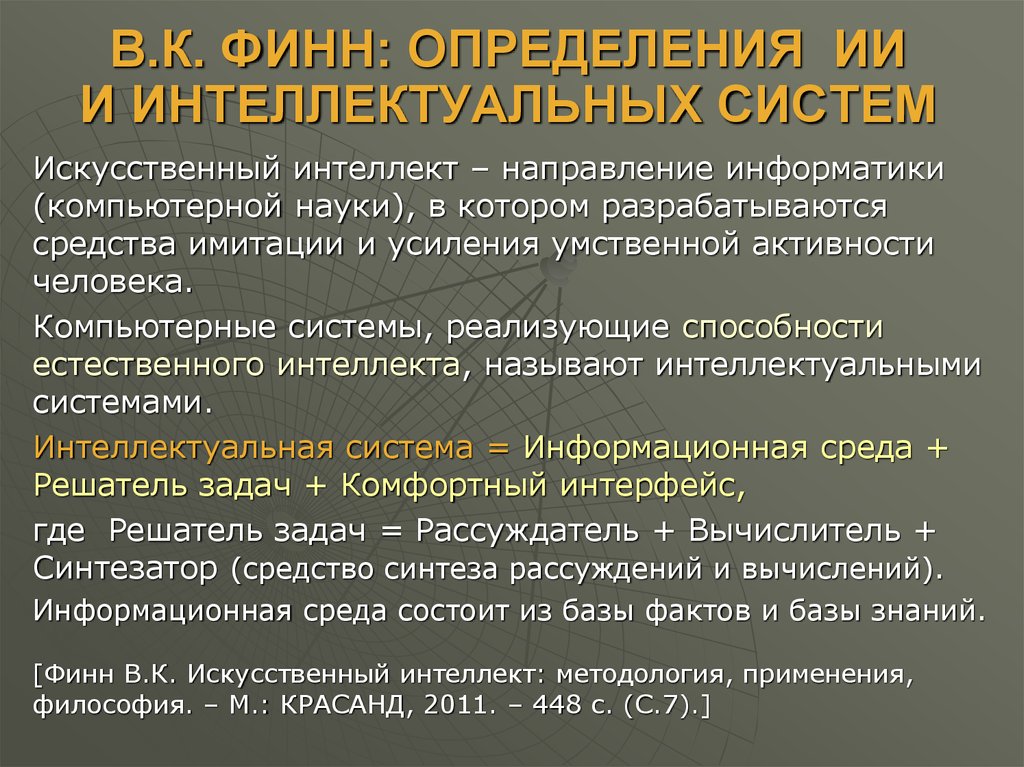

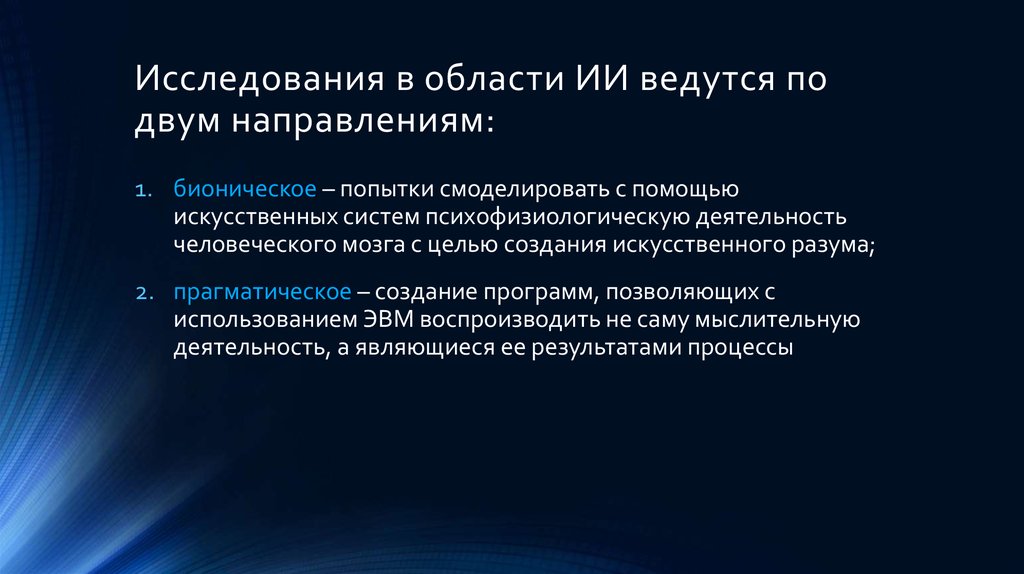

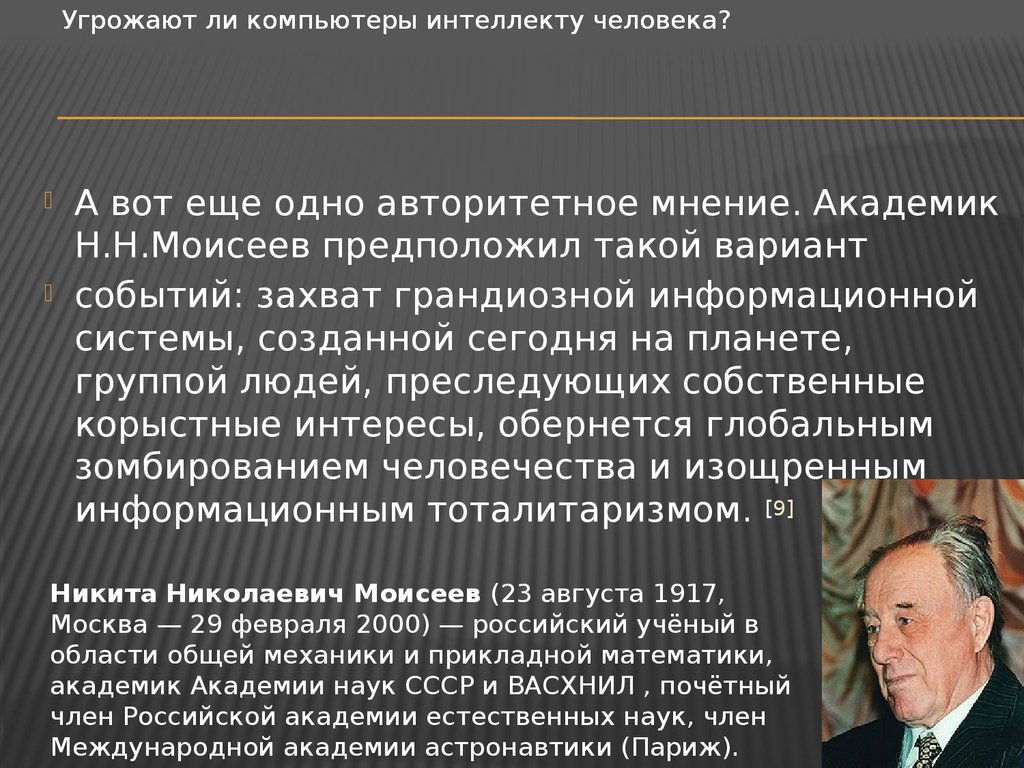

Скачай Проблемы Искусственного Интеллекта и еще Презентации в формате PDF Философия только на Docsity! Проблемы Искусственного Интеллекта Понятие искусственного и МИДИ, Искусственный интеллект — одна из новейших наук, появившихся во второй половине 20-ого века на базе вычислительной техники, математической логики, программирования, психологи, лингвистики, нейрофизиологии и других отраслей знания. Аристотель — основатель логики 1. Закон исключенного противоречия Закон исключенного третьего ‚ Закон тождества «Сократ — человек; все люди смертны; следовательно, Сократ смертен». Томас Гоббс -английский философ Томас Гоббс (1588-1679) предположил, что рассуждения аналогичны числовым расчетам и что «в наших неслышимых мыслях мы поневоле складываем и вычитаем» Может ли машина мыслить? в 1950 г. в статье «Вычислительные машины и разум» лан Тьюринг (1912 —1954) Наиболее горячие споры в философии искусственного интеллекта вызывает вопрос возможности мышления творения человеческих рук. Вопрос «Может ли машина мыслить?», который подтолкнул исследователей к созданию науки о моделировании человеческого разума, был поставлен Аланом Тьюрингом в 1950 году. Две основных точки зрения на этот вопрос носят названия гипотез сильного и слабого искусственного интеллекта. Термин Сильный ИИ был введён Джоном Сёрлем, который охарактеризовал его следующим образом: Более того, такая программа будет не просто моделью разума; она в буквальном смысле слова сама и будет разумом, в том же смысле, в котором человеческий разум — это разум.Джон Сёрль, Разум мозга — компьютерная программа? «Китайская комната» Китайская комната — мысленный эксперимент, описанный Джоном Сёрлем, в котором критикуется возможность моделирования человеческого понимания естественного языка, <=> создания так называемого «сильного искусственного «Китайская комната» 1980 г. интеллекта». Три закона роботехники 1. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред 2.

Вопрос «Может ли машина мыслить?», который подтолкнул исследователей к созданию науки о моделировании человеческого разума, был поставлен Аланом Тьюрингом в 1950 году. Две основных точки зрения на этот вопрос носят названия гипотез сильного и слабого искусственного интеллекта. Термин Сильный ИИ был введён Джоном Сёрлем, который охарактеризовал его следующим образом: Более того, такая программа будет не просто моделью разума; она в буквальном смысле слова сама и будет разумом, в том же смысле, в котором человеческий разум — это разум.Джон Сёрль, Разум мозга — компьютерная программа? «Китайская комната» Китайская комната — мысленный эксперимент, описанный Джоном Сёрлем, в котором критикуется возможность моделирования человеческого понимания естественного языка, <=> создания так называемого «сильного искусственного «Китайская комната» 1980 г. интеллекта». Три закона роботехники 1. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред 2. Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону 3. Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому и Второму Законам Три закона роботёхники в научной фантастике — обязательные правила поведения для роботов, впервые сформулированные Айзеком Азимовымв рассказе «Хоровод» (1942). Нулевой Закон Робот не может причинить вреда человеку, если только он не докажет, что в конечном счёте это будет полезно для всего человечества Современный искусственный интеллект В настоящий момент в создании искусственного интеллекта наблюдается интенсивное перемалывание всех предметных областей, имеющих хоть какое-то отношение к ИИ, в базы знаний. Практически все подходы были опробованы, но к возникновению искусственного разума ни одна исследовательская группа так и не подошла. Исследования ИИ влились в общий поток технологий сингулярности (видового скачка, экспотенциального развития человека), таких как информатика, экспертные системы, нанотехнология, молекулярная биоэлектроника, теоретическая биология, квантовая теория.

Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону 3. Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому и Второму Законам Три закона роботёхники в научной фантастике — обязательные правила поведения для роботов, впервые сформулированные Айзеком Азимовымв рассказе «Хоровод» (1942). Нулевой Закон Робот не может причинить вреда человеку, если только он не докажет, что в конечном счёте это будет полезно для всего человечества Современный искусственный интеллект В настоящий момент в создании искусственного интеллекта наблюдается интенсивное перемалывание всех предметных областей, имеющих хоть какое-то отношение к ИИ, в базы знаний. Практически все подходы были опробованы, но к возникновению искусственного разума ни одна исследовательская группа так и не подошла. Исследования ИИ влились в общий поток технологий сингулярности (видового скачка, экспотенциального развития человека), таких как информатика, экспертные системы, нанотехнология, молекулярная биоэлектроника, теоретическая биология, квантовая теория. Результаты разработок в области ИИ вошли в высшее и среднее образование России в форме учебников информатики, где теперь изучаются вопросы работы и создания баз знаний, экспертных систем на базе персональных компьютеров на основе отечественных систем логического программирования, а также изучения фундаментальных вопросов математики и информатики на примерах работы с моделями баз знаний и экспертных систем в школах и СИ Искусственный интеллект вместе с нейрофизиологией, эпистемологией и когнитивной психологией образует более общую науку, называемую когнитология. Важную роль в искусственном интеллекте играет философия. Также с проблемами искусственного интеллекта тесно связана эпистемология — наука о знании в рамках философии. Философы, занимающиеся данной проблематикой, решают вопросы, схожие с теми, которые решаются инженерами ИИ о том, как лучше представлять и использовать знания и информацию. Компьютерные технологии и кибернетика: -В компьютерных науках проблемы искусственного интеллекта рассматриваются с позиций проектирования экспертных систем и баз знаний.

Результаты разработок в области ИИ вошли в высшее и среднее образование России в форме учебников информатики, где теперь изучаются вопросы работы и создания баз знаний, экспертных систем на базе персональных компьютеров на основе отечественных систем логического программирования, а также изучения фундаментальных вопросов математики и информатики на примерах работы с моделями баз знаний и экспертных систем в школах и СИ Искусственный интеллект вместе с нейрофизиологией, эпистемологией и когнитивной психологией образует более общую науку, называемую когнитология. Важную роль в искусственном интеллекте играет философия. Также с проблемами искусственного интеллекта тесно связана эпистемология — наука о знании в рамках философии. Философы, занимающиеся данной проблематикой, решают вопросы, схожие с теми, которые решаются инженерами ИИ о том, как лучше представлять и использовать знания и информацию. Компьютерные технологии и кибернетика: -В компьютерных науках проблемы искусственного интеллекта рассматриваются с позиций проектирования экспертных систем и баз знаний. . В целом исследования проблем искусственного интеллекта в компьютерных науках направлены на создание, развитие и эксплуатацию интеллектуальных информационных систем, а вопросы подготовки пользователей и разработчиков таких систем решаются специалистами информационных технологий. Связь с другими науками Психология и когнитология: -Методология когнитивного моделирования предназначена для анализа и принятия решений в плохо определённых ситуациях. Была предложена —Аксельродом.Основана на моделировании субъективных представлений экспертов о ситуации и включает: методологию структуризации ситуации: модель представления знаний эксперта в виде знакового орграфа (когнитивной карты) (Е, \\), где Е — множество факторов ситуации, \/ — множество причинно-следственных отношений между факторами ситуации; методы анализа ситуации. В настоящее время методология когнитивного моделирования развивается в направлении совершенствования аппарата анализа и моделирования ситуации. Здесь предложены модели прогноза развития ситуации; методы решения обратных задач.

. В целом исследования проблем искусственного интеллекта в компьютерных науках направлены на создание, развитие и эксплуатацию интеллектуальных информационных систем, а вопросы подготовки пользователей и разработчиков таких систем решаются специалистами информационных технологий. Связь с другими науками Психология и когнитология: -Методология когнитивного моделирования предназначена для анализа и принятия решений в плохо определённых ситуациях. Была предложена —Аксельродом.Основана на моделировании субъективных представлений экспертов о ситуации и включает: методологию структуризации ситуации: модель представления знаний эксперта в виде знакового орграфа (когнитивной карты) (Е, \\), где Е — множество факторов ситуации, \/ — множество причинно-следственных отношений между факторами ситуации; методы анализа ситуации. В настоящее время методология когнитивного моделирования развивается в направлении совершенствования аппарата анализа и моделирования ситуации. Здесь предложены модели прогноза развития ситуации; методы решения обратных задач. Философия: — Наука «о создании искусственного разума» не могла не привлечь внимание философов. С появлением первых интеллектуальных систем были затронуты фундаментальные вопросы о человеке и знании, а отчасти о мироустройстве. Философские проблемы создания искусственного интеллекта можно разделить на две группы, условно говоря, «до и после разработки ИИ».

Философия: — Наука «о создании искусственного разума» не могла не привлечь внимание философов. С появлением первых интеллектуальных систем были затронуты фундаментальные вопросы о человеке и знании, а отчасти о мироустройстве. Философские проблемы создания искусственного интеллекта можно разделить на две группы, условно говоря, «до и после разработки ИИ».

Проблема искусственного интеллекта в современном научном дискурсе

Проблема искусственного интеллекта в философии

1 Институт космических и информационных технологий ФГАОУ ВО «Сибирский федеральный университет»

2 Институт инженерной физики и радиоэлектроники ФГАОУ ВО «Сибирский федеральный университет»

3 Институт педагогики, психологии и социологии ФГАОУ ВО «Сибирский федеральный университет»

Проблема искусственного интеллекта в современном научном дискурсе.

Interactive-plus. ru

30.03.2020 17:12:36

2020-03-30 17:12:36

Источники:

Https://interactive-plus. ru/ru/article/466855/discussion_platform

Философские аспекты проблемы искусственного интеллекта | ВКонтакте » /> » /> . keyword { color: red; }

keyword { color: red; }

Проблема искусственного интеллекта в философии

В наши дни общество промышленно-развитых стран находится в очередной стадии развития, которая характеризуется повышенной ролью знания во многих сферах общественной жизни. В таком обществе роль действий по получению, обработке и сортировке информации существенно выше, чем на предыдущих стадиях общественного развития.

Объемы потоков информации постоянно увеличиваются, и возникает потребность в создании автоматических средств ее обработки. В данных автоматических или механических устройствах реализованы некоторые свойства к распознаванию, оценке, сортировке информации, ранее присущие только человеку, если исключить возможность существования внеземного разума.

Философия изучает процессы познания окружающей действительности человеком и влияние знаний на формирование сознания, действий, убеждений. В связи с этим в философской науке рассматриваются теоретические и потенциальные возможности машин, компьютеров, систем искусственного интеллекта познавать окружающий мир, мыслить, взаимодействовать и общаться с человеком.

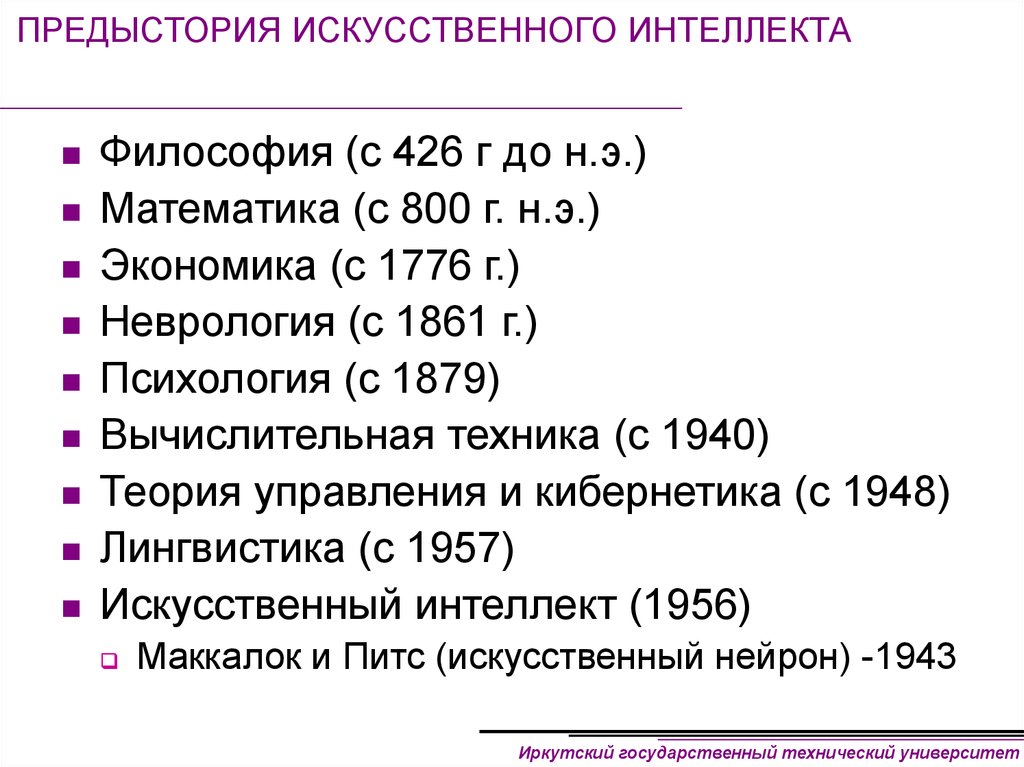

Наука об искусственном интеллекте сравнительно молода, так как зародилась позже подавляющего большинства других наук в 1956 году в рамках семинара в Принстонском университете. Участники семинара рассматривали вопросы алгоритмов познания и нейронных сетей. Они и договорились назвать новую область исследований искусственным интеллектом.

Данная наука переживала свои периоды спада и подъема, обусловленные главным образом развитием технологий. Если в 1956 году наука зародилась в условиях господства индустриального способа производства, то в середине 70-х годов началось становление, нового, постиндустриального способа производства, для которого характерно более интенсивное применение автоматики, достижений кибернетики и робототехники. Расширение эмпирической базы для исследований внесло свои коррективы в понимание сущности искусственного интеллекта.

Но, однозначного общепринятого определения термина искусственный интеллект не существует. Помимо молодости и бурного развития науки следует отметить отсутствие единого понимания такого феномена как интеллект с точки зрения его сущности, составляющих, форм и механизмов проявления в других науках.

Пол Маккарти, основатель науки об искусственном интеллекте Пол Маккарти считал, что искусственный интеллект следует считать наукой и технологией разработки интеллектуальных машин, в частности интеллектуальных компьютерных программ. Наука связана с похожими задачами применения компьютеров для понимания человеческого интеллекта, но она не ограничивается применением методов наблюдения за биологическими процессами.

Под интеллектом понимается вычислительная, аналитическая часть способности к достижению целей в мире. Различные виды и уровни интеллекта встречаются среди людей животных и машин.

Мы проанализируем несколько определений и взглядов на сущность и механизм действия искусственного интеллекта. Так, участники Российской ассоциации искусственного интеллекта дают несколько определений ИИ. Согласно первому, его следует направлением науки “в рамках которого ставятся и решаются задачи аппаратного или программного моделирования тех видов человеческой деятельности, которые традиционно считаются интеллектуальными”.

Согласно второму, под ИИ понимают “свойство интеллектуальных систем выполнять функции, традиционно считающиеся прерогативой человека”. Под интеллектуальной системой понимают техническую или программную систему, способную решать творческие задачи конкретной предметной области, сведения о которой лежат в памяти этой системы. В систему входят база знаний, средство решения и интерфейс, позволяющий общаться с системой без программ ввода данных. Согласно третьему, го считают отдельной наукой, из комплекса компьютерных наук, задачей которой является воссоздание разумных рассуждений и действий с помощью вычислительных систем. В этом случае, она понимается также как и наука о создании моделей разумного поведения.

Также он может пониматься как совокупность существующих в настоящее время интеллектуальных систем и методов, которые используются для решения различных задач.

Механизм действия искусственного интеллекта зависит от критериев разумности и понимания его создателями механизмов действия интеллекта. Например, тест Тьюнинга предполагает, что машина должна вести себя как человек, если она разумна. Согласно тесту человек разговаривает с машиной и с другим человеком и определяет, кто ему отвечает. Если он принимает машину за человека, значит машина разумна. Диалог ведется в форме переписки.

Например, тест Тьюнинга предполагает, что машина должна вести себя как человек, если она разумна. Согласно тесту человек разговаривает с машиной и с другим человеком и определяет, кто ему отвечает. Если он принимает машину за человека, значит машина разумна. Диалог ведется в форме переписки.

Механизм действия искусственного интеллекта может быть основан на символьном подходе, когда машине дается упрощенное символьное представление и сущности и смысле объекта реальности, и она наделяется способностью формулировать новые правила при выполнении задач.

При логическом подходе моделируется или имитируется ход логических рассуждений. В приложении Б содержится информация о тестировании степени человекоподобного поведения компьютерных программ в компьютерной игре. Программе задается набор правил и условий без жесткого алгоритма действия.

При агентно-ориентированном подходе, интеллект рассматривается как способность делать вычисления как часть процесса решения машиной поставленных задач. Такая машина воспринимают окружающий мир при помощи датчиков, принимает решение и воздействует на окружающую среду своими средствами. Пример и короткое описание агентно-ориентированной системы обработки сведений в серверных компьютерах представлен в Приложении А.

Такая машина воспринимают окружающий мир при помощи датчиков, принимает решение и воздействует на окружающую среду своими средствами. Пример и короткое описание агентно-ориентированной системы обработки сведений в серверных компьютерах представлен в Приложении А.

При создании искусственного интеллекта может применяться моделирование рассуждений. В таком случае создаются системы символов, в начале которых поставлена задача, а решение задачи должно быть результатом обработки символов.

Особое направление в науке об искусственном интеллекте представляет собой инженерия знаний. В ней изучаются вопросы получения знаний из информации, их обработки, фильтрации. К таким моделям относятся нейронные сети. Их применяют для решения сложных проблем, таких как распознавание геометрических объектов.

В интеллектуальных машинах предусмотрено и машинное обучение. Оно посвящено получению знаний при работе интеллектуальной системы. Машина может обучаться с учителем, то есть с программой обучения, либо без него. В первом случае применяется классификация и анализ объектов, во втором случае объекты распознаются во входном потоке.

В первом случае применяется классификация и анализ объектов, во втором случае объекты распознаются во входном потоке.

Философские аспекты рассмотрения проблемы искусственного интеллекта необходимо изучать в контексте предмета философии, ее функций и направлений.

Предмет философии четко выделяет ее из системы наук, философия рассматривается как методологическая основа, используемая в любой из них. Поэтому, если отдельные науки изучают лишь фрагменты, элементы, обособленные части реальности, то предмет философии охватывает самые универсальные ее черты, фундамент бытия и познания, выявляя его по результатам исследований конкретных наук, и понимание всей культуры, ее мировоззренческих структур.

Философия нацелена на определение глубинной связи между мельчайшими частицами и частями мира, осознание их единства.

Философия рассматривает уникальность и смысл человеческого существования в мире, отношения человека к сути мироздания, его эволюции, концепции и представления о познании, вопросы нравственности и красоты, сознания, души, философию общества и истории, историю самой философии.

Эта наука включает в себя онтологию (науку про универсальные основы бытия), социальную философию, философскую антропологию (учение о человеке и его роли в мире), теорию познания, этику, эстетику, теорию культуры, историю философии.

Чаще всего выделяют такие функции философии :

· Мировоззреченская. Она обеспечивает понятийное объяснение мира, помогает определиться с жизненными ориентирами, определить смысл и значение жизненных приоритетов;

· Методологическая функция. Философия разрабатывает общий комплекс методов познания и изучения действительности, применяемых во всех науках;

· Прогностическая. Формирует гипотезы о тенденциях развития материи, мира, сознания, мира;

· Критическая. Подразумевает необходимость проверки, верификации существующих научных знаний представлений, анализ знаний и ценностей. Проявляется в оппозиции к воспринимаемой действительности, стремлении человека к совершенствованию мира и самосовершенствованию;

· Аксиологическая. Предполагает оценку изучаемого явления по моральным, общественным, эстетическим, эмоциональным и другим ценностным критериям.

· Познавательная. Исследование и понимание процессов познания дает человеку ориентиры познавательной деятельности, критериями и признаками выбора верной методологии и получения достоверных, знаний, данных информации.

· Логическая функция. Предусматривает создание культуры мышления, независимой и обоснованной позиции в межличностных и межкультурных отношениях.

· Воспитательная функция. Формирует стремление к самосовершенствованию и поиск жизненного смысла.

Теперь сопоставим изложенное. В современных концепциях искусственного интеллекта речь идет о разработке искусственного интеллекта на основе представлений о процессах познания, сформированных в различных науках. Речь идет о восприятии информации, ее сортировке и обработке в соответствии с определенными процедурами. Но, тут же возникает и важный вопрос.

Получая ту или иную информацию, человек не просто усваивает ее, он соотносит ее со своими представлениями о морали, добре, зле, любви и прочими ценностными измерениями. Человек формирует или развивает собственное создание. Будет ли сознание у искусственной системы? У робота? Интеллектуального компьютера или смартфона? Если на данный момент, исследование искусственного интеллекта философами связана преимущественно с познавательной, логической и методологической функцией философии, то в ближайшем или в отдаленном будущем повысится актуальность философских разработок по всем остальным функциям. Возможно создание разумных существ, у которых будет собственная мораль и отношение к человечеству.

Человек формирует или развивает собственное создание. Будет ли сознание у искусственной системы? У робота? Интеллектуального компьютера или смартфона? Если на данный момент, исследование искусственного интеллекта философами связана преимущественно с познавательной, логической и методологической функцией философии, то в ближайшем или в отдаленном будущем повысится актуальность философских разработок по всем остальным функциям. Возможно создание разумных существ, у которых будет собственная мораль и отношение к человечеству.

Вышеизложенное указывает на важность субъективной оценки происходящего, наблюдаемого, переживаемого в познавательных процессах в любой форме интеллекта. В этой связи актуально представление о субъективной реальности сознания, ее формировании. Это динамично меняющаяся последовательность состояний разумного существа, прерываемая сном. Субъективная реальность связана с мозгом так, как информация связана с носителем. Характер получаемой информации не зависит от носителя. От него зависит ее обработка и фильтрация.

От него зависит ее обработка и фильтрация.

По сути, вопрос о субъективной реальности это вопрос о способе представления и восприятия информации для самоорганизующейся системы из множества частей, которая параллельно воспринимает множество потоков информации и принимает логическое решение на основе множества критериев.

Научные достижения человечества еще не позволяют создать интеллектуальные машины со сложным комплексным мышлением, восприятием разговорной речи, разветвленной сетью информации воспринимаемой разумом и чувством. Подобные машины, скорее всего, пока существуют лишь в фантастических рассказах и фильмах, вроде “Матрицы”, “Терминатора”, сериала “Startrack Enterprise” (честный офицер звездного флота робот Дельта) и иных.

Однако, уже сейчас философы задумываются о морально-этических последствиях их появления. Задаются вопросы:

· Что отличит человека от машины, которая думает и чувствует?

· Нужно ли наделять юридическими правами системы с искусственным интеллектом?

· Как сложатся отношения человека с рассуждающими машинами? Рассматриваются варианты от взаимной пользы и сотрудничества до уничтожения человечества.

· Следует ли считать перезагрузку ИИ смертью? Будет ли у машины много жизней, будет ли она бессмертной?

· Можно ли перезаписывать чужое сознание, если человек будет клонирован?

· Может ли человек применять искусственный интеллект для расширения собственных знаний?

Философов волнует, какие будут отношения в обществе, состоящем из людей и объектов ИИ? Не сочтут ли они людей существами низшего уровня? Будут ли признавать нормы человеческого поведения?

Решение указанных проблем будет зависеть от формирования субъективной реальности объектами ИИ, формирования их сознания, соотношения объективного и субъективного в их мышлении, рационального и эмоционального [8]. Но, достижения современной дисциплины искусственного интеллекта не позволяют дать ответы на эти принципиальные вопросы. Но, ведь истина, как конечный результат познания, формируется не только в результате объективных рациональных суждений, но и в результате ценностных, моральных, аксиологических оценок.

Дело в том, что современные системы ИИ созданы на основе редукционистского подхода. При их создании учитывались в основном представления о процессе рационального познания, рационального отбора, фильтрации, верификации сведений, гипотез. Социальные критерии не закладывались. Отображалась лишь одна сторона, естественного интеллекта из множества сложных самоорганизующихся элементов.

Подобный поверхностный взгляд на проблему ИИ выделил несколько ее сторон. Во-первых, необходимость придерживаться схем работы техники, достоверно имитирующих разум в принятии решений. Во-вторых, создание алгоритмов и программирование этой техники на функционирование, рассматриваемое как разумное. В-третьих, применение в упомянутых алгоритмах и программах интеллектуальных процедур оперирования знаниями, знаками и символами.

То есть в научной среде существует обоснованное мнение, что ИИ следует разрабатывать главным образом для воспроизведения создания человеческим разумом оригинальных программ собственной творческой деятельности.

В отличие от науки об искусственном интеллекте или информатики, философия рассматривает данные вопросы в более широком контексте. Считается, что существо наделенное интеллектом познает окружающий мир при практической деятельности, направленной на его преобразование, что оно действует в существующих условиях бытия, которые воспринимает и оценивает, выбирает приемлемые решения и действия.

Тут весьма уместно упомянуть марксистский тезис о том, что бытие определяет сознание. Вышеупомянутые узкие научные подходы к исследовании ИИ обусловлены ограниченной сферой применения вычислительной техники в 70-е, 80-е годы, когда их использовали главным образом в экспертных системах и при сложных вычислениях. Эволюция и распространение информационно-коммуникационных технологий привела к созданию новой среды обитания человека и действия человека, часто определяются этой средой.

Отношение человека к действительности изменилось, так как была создана искусственная реальность. Это новая сфера объективной действительности, которая осваивает человек. В рамках теории познания следует рассматривать функционирование виртуальной среды как способа познания реальности людьми и искусственным интеллектом.

В рамках теории познания следует рассматривать функционирование виртуальной среды как способа познания реальности людьми и искусственным интеллектом.

Компьютеры накапливают свои знания, обрабатывая и сохраняя многочисленные потоки информации, по множеству критериев, полученных от людей. Человек действуя в виртуальной среде, сознательно или несознательно изменяет и познает ее. Он формирует собственные представления о взаимодействии с искусственным интеллектом. Развивающийся искусственный интеллект тоже формирует свои процедуры действия в этой среде.

Исходя из этого, автор соглашается с мнением Андреевой, что верное представление об ИИ может быть только при применении философских категорий, дающих основы общемировоззренческих принципов, лежащий в основе всей практической деятельности.

Именно философия как наука дает такую возможность благодаря онтологическим, бытийным, бытовым характеристикам философских проблем как бытийное основание, сущностное значение для личности, фундаментальности, синтезу инвариантного и вариативного. Философия рассматривает ИИ не просто, как средство или совокупность процедур познания какого-то объекта реальности для текущих вычислительных задач, а с позиций изучения сознания.

Философия рассматривает ИИ не просто, как средство или совокупность процедур познания какого-то объекта реальности для текущих вычислительных задач, а с позиций изучения сознания.

Благодаря универсальности своей методологии, своей логической, познавательной и воспитательной функции, аксиологической функции, философия предлагает широкий, комплексный взгляд на изучение искусственного интеллекта.

Это в свою очередь позволяет заблаговременно ставить актуальные проблемы формирования социума, состоящего из людей и объектов искусственного интеллекта, проблемы их взаимоотношений, нравственных и моральных норм.

Наука об искусственном интеллекте рассматривает его с точки зрения изучения процессов познания, то есть получения, обработки, фильтрации информации, принятия решений.

Философское рассмотрение проблем искусственного интеллектам тесно связано с познавательной, методологической и логической функциями философии. Первая функция создает основополагающие концепции познавательного процесса, которые применяют для моделирования при создании ИИ. Методологическая функция обеспечивает общенаучную методологию для изучения, логическая функция позволяет имитировать процессы разумного решения в компьютерных и других технических системах.

Методологическая функция обеспечивает общенаучную методологию для изучения, логическая функция позволяет имитировать процессы разумного решения в компьютерных и других технических системах.

Комплексный подход и морально-этическая сторона философии позволяет сформировать проблемы будущего общества, в котором взаимодействуют объекты ИИ и люди. Например, с точки зрения этики, права, правил поведения в социуме, принципов контактов.

В отличие от других наук философия позволяет сформировать комплексный взгляд на многогранные процессы зарождения и трансформации сознания в рамках объектов искусственного интеллекта, которая включает не только познавательные, но и ценностные, моральные аспекты.

Различные виды и уровни интеллекта встречаются среди людей животных и машин.

Vk. com

25.08.2017 12:46:46

2017-08-25 12:46:46

Источники:

Https://vk. com/@agencyofcaxap-filosofskie-aspekty-problemy-iskusstvennogo-intellekta

Читать онлайн «Философские проблемы развития искусственного интеллекта» – ЛитРес » /> » /> . keyword { color: red; }

keyword { color: red; }

Проблема искусственного интеллекта в философии

Также данная книга доступна ещё в библиотеке. Запишись сразу в несколько библиотек и получай книги намного быстрее.

Посоветуйте книгу друзьям! Друзьям – скидка 10%, вам – рубли

По вашей ссылке друзья получат скидку 10% на эту книгу, а вы будете получать 10% от стоимости их покупок на свой счет ЛитРес. Подробнее

- Объем: 210 стр. 4 иллюстрации Жанр:К ниги по философии, м онографии Теги:И скусственный интеллект, р азвитие цивилизации, с оциально-культурное развитие, т ехнологии будущего, ф илософские проблемыРедактировать

© Коллектив авторов, 2019

© Издательство «Прометей», 2019

Введение

Традиционно показателем общей успешности в области разработки систем искусственного интеллекта считается способность внешне смоделировать типичные человеческие функции, качества и свойства, тем самым превзойдя человека в типично человеческих видах деятельности. Проявления и «самореализация» разработанных образцов воспринимаются сквозь призму человеческого фактора и так называемого «эффекта ИИ» (обессмысливание и «депсихологизация» деятельности), что являет собой латентную, но, тем не менее, глобальную проблему данной сферы. Проблема особенно актуализируется в связи с отсутствием критериев интерпретирования и «понимания» того, что мы имеем в качестве результатов деятельности в области разработки искусственного интеллекта: сугубо алгоритмизированный, лишённый возможностей понимания и осмысления механизм, или же – психо-машину с потенциалом возникновения прото-психических качеств, то есть задатков психики и, возможно, интеллекта. Несмотря на терминологические особенности самого понятия «искусственный интеллект», в мировом научном сообществе принято считать, что наличие именно сознания, а не интеллекта станет необходимым и достаточным основанием для признания машины разумной [1].

Проявления и «самореализация» разработанных образцов воспринимаются сквозь призму человеческого фактора и так называемого «эффекта ИИ» (обессмысливание и «депсихологизация» деятельности), что являет собой латентную, но, тем не менее, глобальную проблему данной сферы. Проблема особенно актуализируется в связи с отсутствием критериев интерпретирования и «понимания» того, что мы имеем в качестве результатов деятельности в области разработки искусственного интеллекта: сугубо алгоритмизированный, лишённый возможностей понимания и осмысления механизм, или же – психо-машину с потенциалом возникновения прото-психических качеств, то есть задатков психики и, возможно, интеллекта. Несмотря на терминологические особенности самого понятия «искусственный интеллект», в мировом научном сообществе принято считать, что наличие именно сознания, а не интеллекта станет необходимым и достаточным основанием для признания машины разумной [1].

Если рассмотреть динамику своеобразной оппозиции организм-механизм (человек-машина), очевидным станет всеобщее признание превосходства первого над вторым: за организмом признается безусловное наличие сознательных качеств. Механизм остается вторичным, производным от организма. И неизвестно, что должно на самом деле произойти, для того чтобы механизм заслужил признание организма. Парадигма междисциплинарности в данном случае только усложняет проблему.

Механизм остается вторичным, производным от организма. И неизвестно, что должно на самом деле произойти, для того чтобы механизм заслужил признание организма. Парадигма междисциплинарности в данном случае только усложняет проблему.

Детерминантой возникновения подобного восприятия машинной деятельности является совокупность двух векторов общечеловеческого нарциссизма, один из которых не позволяет организму признавать что-либо иное, кроме себя, в качестве достойного для обладания высшими привилегиями. Данный подход существенно затрудняет интерпретирование достижений техногенеза. Другой вектор – техно-дискриминация, т. е. гипертрофированный антропный принцип в виде постулата «долженствования»: механизм «должен» служить человеку и заменять его в наиболее сложных, небезопасных, монотонных областях деятельности.

Литература:

1. Скиба И. Р. Проблема искусственного интеллекта: человек и машина [Электронный ресурс] https://neuronus. com/stat/1392-problema-iskusstvennogo-intellekta-chelovek-i-mashina. html

html

Глава 1

Фундаментальные проблемы создания и развития искусственного интеллекта

1.1. Философские проблемы развития искусственного интеллекта

Современный этап научно-технической революции ассоциируется с широким внедрением технологий, основанных на развитом искусственном интеллекте. Понятие искусственного интеллекта стало тривиальным для современного мира, но его контуры и фундаментальные проблемы, связанные с его созданием, очерчиваются философией искусственного интеллекта. Философия искусственного интеллекта (ИИ) охватывает широкий круг фундаментальных проблем, связанных с созданием искусственного интеллекта. В чём сущность разума? Каковы принципы его работы? И, наконец, – возможно ли создание искусственного интеллекта? Несмотря на огромные успехи в создании программ и алгоритмов, способных решать многие интеллектуальные задачи гораздо эффективнее человека, мы не можем найти ясного и однозначного ответа на эти вопросы.

Ответ на вопрос о возможности существования искусственного интеллекта определялся мировоззренческой ориентацией мыслителя: дуалистическая традиция, восходящая к Р. Декарту, постулировала невыразимость мышления через телесное, тогда как материалистическая традиция считала мышление производным от телесного. Декарт, исходя из своей дуалистической системы, считал мышление атрибутом лишь человека (даже животных он описывал как «автоматы»), тогда как материалистическая традиция теоретически оставляла возможность существования мышления не только у людей.

Декарту, постулировала невыразимость мышления через телесное, тогда как материалистическая традиция считала мышление производным от телесного. Декарт, исходя из своей дуалистической системы, считал мышление атрибутом лишь человека (даже животных он описывал как «автоматы»), тогда как материалистическая традиция теоретически оставляла возможность существования мышления не только у людей.

Что же можно считать критерием наличия разума? Обыденное сознание, как правило, воспринимает в качестве критерия разумности поведение. Мы считаем нечто разумным или неразумным, оценивая его поведение. Но какова связь между сущностью разума человека и его внешним проявлением – разумным поведением? Какое поведение будет разумным? Как по чьему-либо поведению можно определить, обладает ли это существо разумом?

Ещё в XVIII в. Дени Дидро в своих «Философских размышлениях» заявлял, что если он найдёт попугая, способного ответить на любой вопрос, то этого попугая, без сомнения, придётся считать разумным существом.

В 1936 году философ А. Айер рассмотрел вопрос касательно других разумов: как узнать, что другие люди имеют тот же сознательный опыт, что и мы? «Единственным основанием, на котором я могу утверждать, что объект, который кажется разумным, на самом деле не разумное существо, а просто машина, является то, что он не может пройти один из эмпирических тестов, согласно которым определяется наличие или отсутствие сознания» [1].

«Могут ли машины мыслить?» – такой вопрос поставил в 1950 г. британский математик и логик Алан Тьюринг. Он подчёркивает, что традиционный подход к этому вопросу состоит в том, чтобы сначала определить понятия «машина» и «интеллект». Тьюринг, однако, выбрал другой путь; вместо этого он заменил исходный вопрос другим, «который тесно связан с исходным и формулируется относительно недвусмысленно». По существу, он предлагает заменить вопрос «Думают ли машины?» вопросом «Могут ли машины делать то, что можем делать мы (как мыслящие создания)?». «Компьютер можно считать разумным, если он способен заставить нас поверить, что мы имеем дело не с машиной, а с человеком». Преимуществом нового вопроса, как утверждает Тьюринг, является то, что он проводит «чёткую границу между физическими и интеллектуальными возможностями человека», для чего Тьюринг предлагает эмпирический тест.

Преимуществом нового вопроса, как утверждает Тьюринг, является то, что он проводит «чёткую границу между физическими и интеллектуальными возможностями человека», для чего Тьюринг предлагает эмпирический тест.

Суть теста Тьюринга в следующем. В разных комнатах находятся судья, человек и машина. Судья ведёт переписку с человеком и машиной, заранее не зная, кто из собеседников является человеком, а кто – машиной. Время ответа на вопрос является фиксированным, так что судья не может определить машину по этому признаку (во времена Тьюринга машины работали медленнее человека, а сейчас реагируют быстрее). Если судья не может определить, кто из его собеседников является машиной, то машина смогла пройти тест Тьюринга и может считаться мыслящей. Причём, машина не просто будет подобием разума человека – она будет именно разумом, т. к. у нас не будет никакой возможности отличить её поведение от поведения человека. Такая трактовка искусственного интеллекта как полноправного эквивалента естественного получила название «сильного Искусственного интеллекта».

Обратим внимание на то, что тест Тьюринга вовсе не подразумевает, что машина должна «понимать» суть тех слов и выражений, которыми она оперирует. Машина должна лишь должным образом имитировать осмысленные ответы.

В 1980 г. Дж. Сёрл предлагает мысленный эксперимент, критикующий тест Тьюринга и представление о возможности существования разума без понимания. Суть эксперимента в следующем. Сёрл пытается имитировать знание китайского языка, которого не понимает.