Содержание

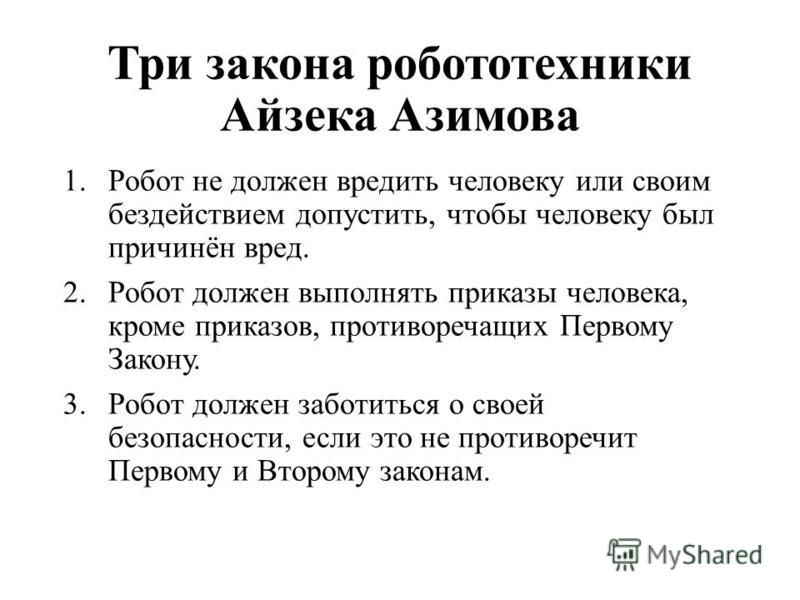

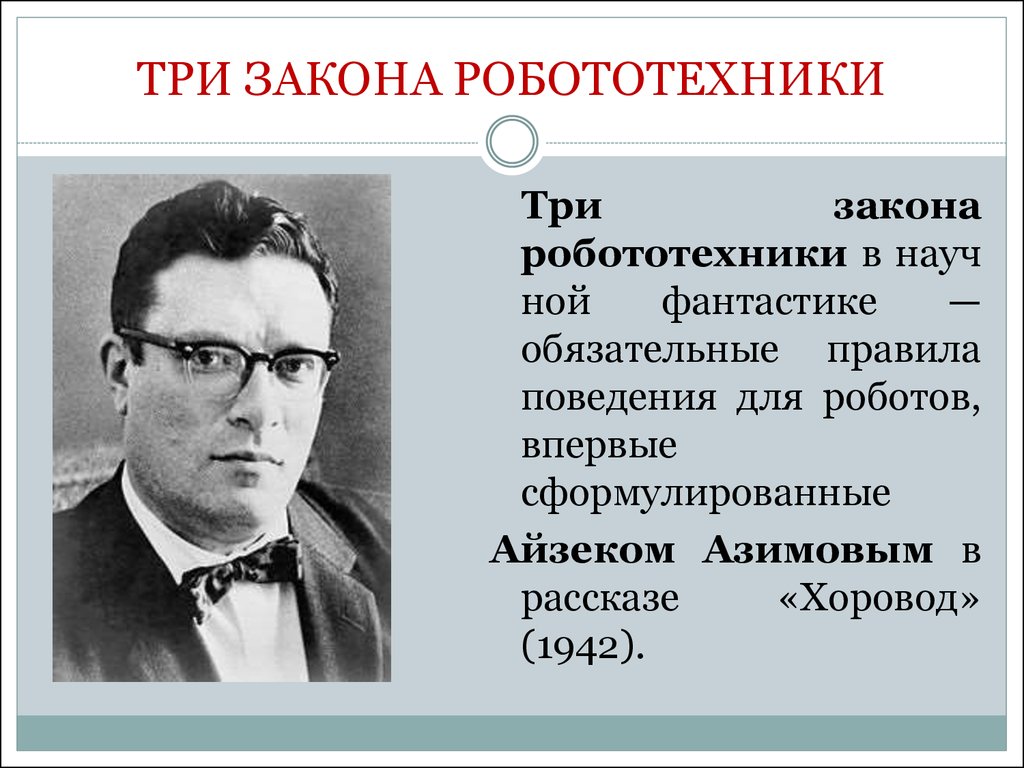

Айзек Азимов сформулировал три закона робототехники.

Содержание

- Три закона робототехники: вымысел и реальность

- Появление и формулировка

- Не навреди!

- Как понять Первый закон

- Обходной путь

- Нулевой закон робототехники

- Мнения экспертов

- Три закона роботехники

Три закона робототехники: вымысел и реальность

Мысль о том, что искусственное существо откажется подчиняться хозяину, давно тревожит ученых, писателей, мыслителей и простых обывателей.

Фантаст Айзек Азимов в 40-х годах XX века предложил решение этой проблемы в виде трех законов робототехники, которые нужно «вшить» в искусственный мозг разумных машин.

Несложные правила накладывают на действия механических созданий ряд ограничений, поэтому человечество может отвлечься от размышлений о машинном бунте и смело шагать по дороге прогресса в сопровождении послушных и выносливых помощников.

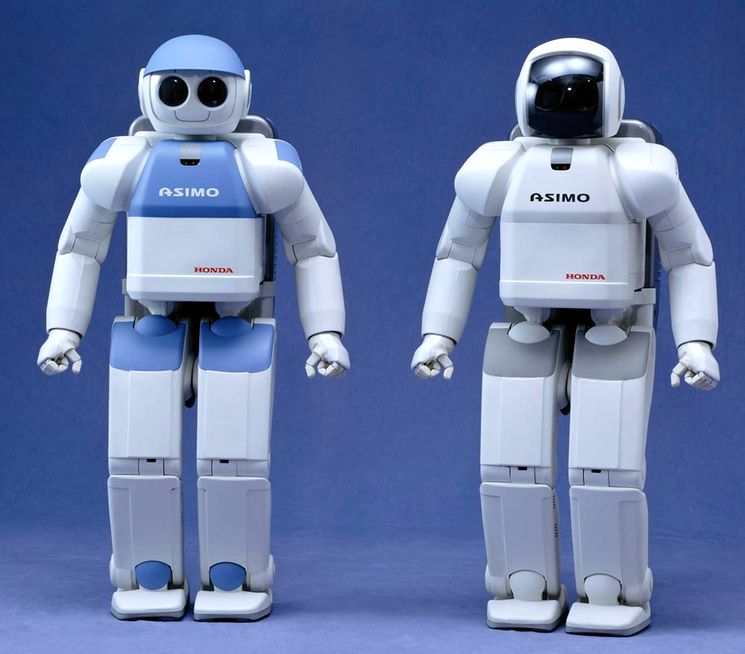

три закона робототехники Айзека Азимова

Шло время, росла мощность вычислительной техники, появлялись и совершенствовались механизмы, разговоры об искусственном интеллекте выходили за пределы академических кругов. Но страх перед умными и своевольными машинами отнюдь не уменьшался. Азимовские законы стали всерьез рассматривать ученые, которые разрабатывают машины с программным управлением. Кажется, что стоит понять, как донести их до роботов, и наступит новая эра, но так ли это?

Но страх перед умными и своевольными машинами отнюдь не уменьшался. Азимовские законы стали всерьез рассматривать ученые, которые разрабатывают машины с программным управлением. Кажется, что стоит понять, как донести их до роботов, и наступит новая эра, но так ли это?

Появление и формулировка

Многие предшественники Азимова описывали человекоподобных существ, которые созданы искусственно, как монстров с недобрыми намерениями. Немногочисленные авторы произведений о миролюбивых андроидах выделялись на общем фоне. Рассказы «Хелен О’Лой» Лестера дель Рея и «Я, робот» Отто Биндера вдохновили Азимова на работу над похожим произведением.

Результат не устроил Джона Кэмпбелла, редактора журнала «Astounding Science Fiction», где публиковался писатель: слишком велико было сходство с рассказом дель Рея. Азимов продолжал писать на эту тему и обсуждать ее с редактором. Во время одной дискуссии Кэмпбелл изложил принципы, которые теперь весь мир знает как три закона робототехники. Эти правила работали в произведениях Азимова, издатель же просто указал на них писателю.

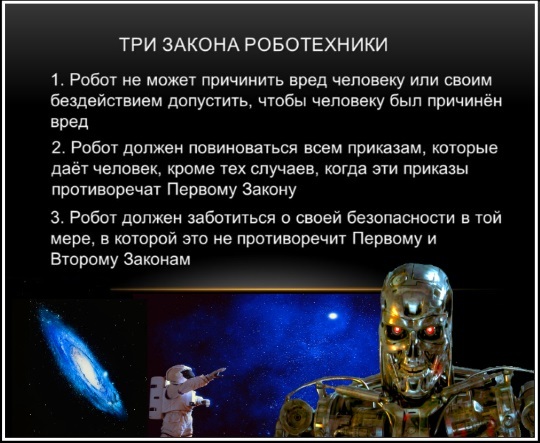

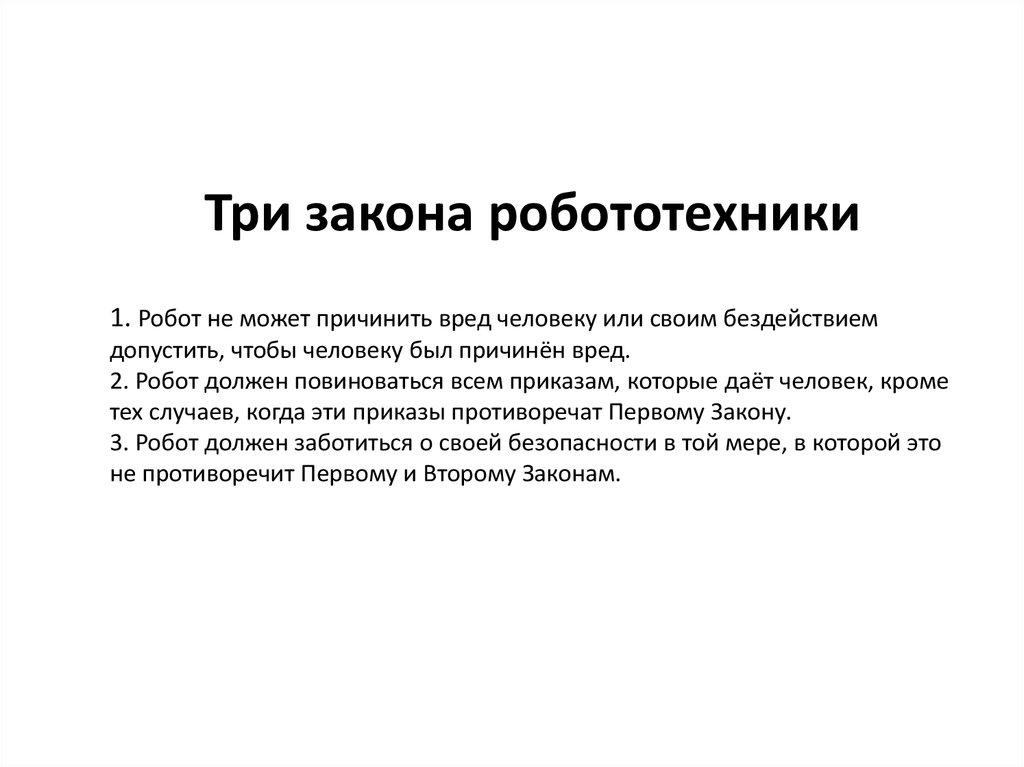

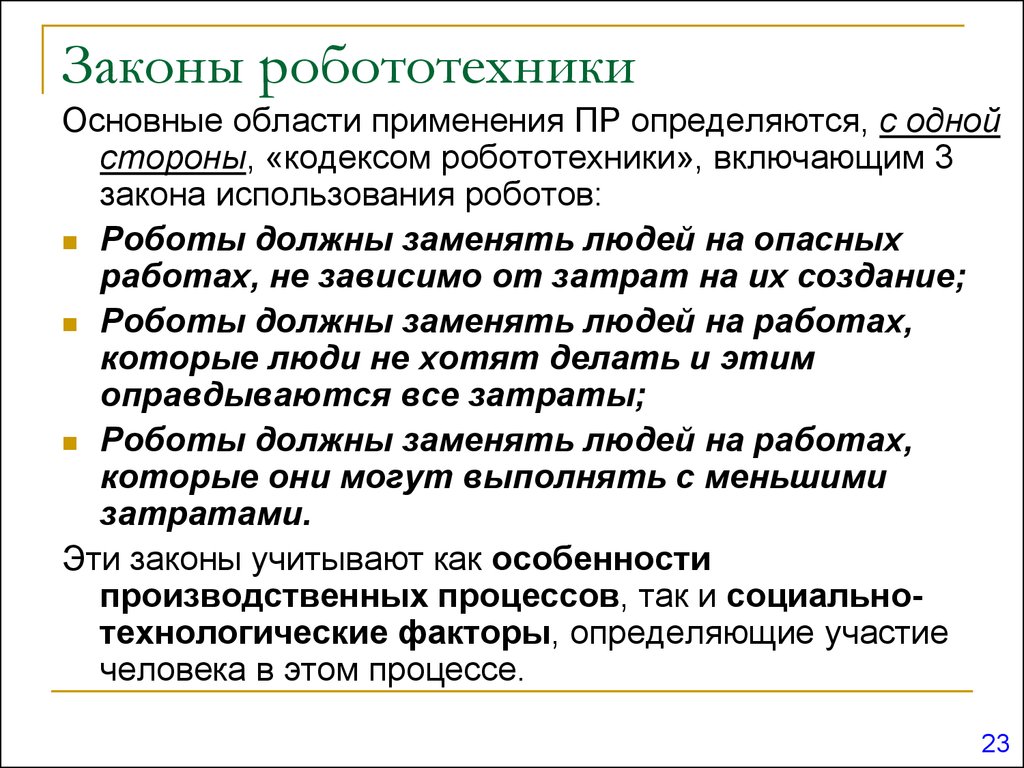

Законы робототехники предписывают машинам следующее:

- Робот не может навредить человеку или позволить нанести ему вред в результате бездействия.

- Робот обязан подчиняться командам человека за исключением тех, что не соответствуют Первому закону.

- Робот должен следить за собственной сохранностью, если это не идет вразрез с Первым или Вторым законом.

В произведениях Азимова эти принципы вносились в программное обеспечение почти всех машин. Если же происходило нарушение одного из правил и робот это понимал, то его позитронный мозг получал серьезное повреждение, случался так называемый «робоблок», из-за которого машина ломалась. Но художественную литературу любят за описание конфликтов, с которыми справляются действующие лица.

три закона робототехники

Поэтому автор писал не об идеальных машинах, которые работают по безупречным алгоритмам, а о логических неувязках в законах. Нестандартные ситуации и вольные трактовки ведут за запретную черту, а вред от неукоснительного соблюдения законов порой превышает пользу.

Герои книг Азимова должны внимательно наблюдать за своими помощниками, а в случае беды разбираться в причинах, часто при участии специалиста-робопсихолога. Автор намеренно сделал три закона робототехники несовершенными, ведь иначе не получилось бы выстроить интересный сюжет. В ряде произведений он даже позволил роботам изменять строгие правила.

Но целью писателя было не запугать читателей, а дать им возможность посмотреть на машины иначе. Азимов хотел, чтобы обыватели забыли о страхе перед механизмами, поняли, что те могут приносить пользу и стать людям верными товарищами. Писатель настаивал на том, что разработанные им принципы годятся не только для литературы, но и для воплощения в машинном коде.

Не навреди!

Жажда жизни перевешивает все остальные человеческие желания. Мощные механизмы с быстрой реакцией воспринимаются как явная угроза.

Поэтому Первый закон робототехники ограждает людей от агрессии со стороны машин.

Если же человек попадет в опасную ситуацию, верный робот спасет его. Здесь стоит забыть о двух других законах, ведь жизнь по умолчанию важнее, чем выполнение каких бы то ни было команд и исправность машины. Кажется, что здесь нет нестыковок и туманных толкований, но на деле все обстоит куда сложнее.

Здесь стоит забыть о двух других законах, ведь жизнь по умолчанию важнее, чем выполнение каких бы то ни было команд и исправность машины. Кажется, что здесь нет нестыковок и туманных толкований, но на деле все обстоит куда сложнее.

Как понять Первый закон

Какой именно вред могут причинить роботы? Да, нападать на хозяев нельзя, но как быть, если автомат заденет человека нечаянно? Механизм подчиняется законам физики, он не может остановиться мгновенно, когда живой объект окажется рядом неожиданно. Каждую секунду мозг робота должен определять, как далеко находятся люди и с какой скоростью они перемещаются, а корпус робота должен быть усеян датчиками и камерами.

На обработку такого объема информации будет уходить слишком много времени и ресурсов машины, так что робот просто не выполнит свою основную задачу.

первый закон робототехники

Следующий вопрос — кого считать человеком? Люди долго учились различать себе подобных, они поймут, где живой соплеменник, а где мертвый, где манекен, чучело или другой предмет, который напоминает человека. Научить этому компьютер очень сложно, ни один алгоритм распознавания не будет работать без сбоев, а цена ошибки — жизнь, и не одна. И что делать, если перед роботом совершается убийство или другое преступление против личности?

Научить этому компьютер очень сложно, ни один алгоритм распознавания не будет работать без сбоев, а цена ошибки — жизнь, и не одна. И что делать, если перед роботом совершается убийство или другое преступление против личности?

А иногда спасти одного человека можно, если пожертвовать другим. Сложных ситуаций чересчур много, в них законы робототехники стали бы причиной поломки огромного количества роботов: машины попросту выйдут из строя, когда осознают, что не исполнили Первый закон. Еще одно уточнение: что считать вредом для человека? Ведь травмы бывают не только физические: моральный вред причиняет людям не меньшие страдания, а общаться без нанесения обид умеют далеко не все люди, не говоря уже о машинах.

Перевести этические нормы людей на язык математических формул пока невозможно, поэтому ущерб от роботов нельзя предотвратить целиком. Эти проблемы рассматривал в своих книгах Айзек Азимов, но литературные герои всегда находили выход из трудного положения. В жизни предусмотреть все пути развития событий не получится.

Обходной путь

Если роботам удавалось безнаказанно попирать правила в фантастической литературе, то в действительности все еще сложнее. Три закона робототехники противоречивы, их можно толковать по-разному в зависимости от обстоятельств, что неизбежно приведет к нарушениям.

Раз человек далек от совершенства, то машины и программы, которые он создает, тоже будут с изъянами. Ошибки и дефектные детали приведут к сбоям, из-за которых машины будут вести себя не так, как планировалось.Люди порой ведут себя нелогично и отдают путаные и необдуманные команды. Все это действует на руку злоумышленникам, которые захотят изменить поведение роботов ради наживы, устрашения, власти или забавы.

Но не только люди могут задуматься о том, как обойти законы робототехники. Мощный и гибкий искусственный интеллект, который непрестанно анализирует потоки данных и опирается не на жесткие алгоритмы, а на свой опыт, теоретически способен преодолеть ограничения.

боевой робот

Такой робот будет действовать вопреки догмам, которые придумали его слабые и несовершенные создатели. К тому же люди сами часто нарушают общественные и этические нормы, так они подают роботам не лучший пример для подражания. А существование военных беспилотников и других подобных изобретений само по себе наталкивает на вывод о том, что машинам дозволено убивать людей.

К тому же люди сами часто нарушают общественные и этические нормы, так они подают роботам не лучший пример для подражания. А существование военных беспилотников и других подобных изобретений само по себе наталкивает на вывод о том, что машинам дозволено убивать людей.

Нулевой закон робототехники

Азимов не ограничился тремя правилами, которые изложил в ранних рассказах своего знаменитого цикла. Нулевой закон робототехники появился позже, но писатель поставил его над остальными, так как хотел подчеркнуть значимость этого догмата. Вот его формулировка:

0. Робот не может навредить человечеству либо позволить, чтобы вред был нанесен человечеству в результате бездействия.

Забота обо всей человеческой расе, а не только об отдельных ее представителях, — благородная и ответственная миссия. С этой задачей трудно справиться, если учесть, что Нулевой закон противоречит трем другим, особенно Первому.

нулевой закон робототехники

Понять, опасен ли какой-то фактор для всех людей, непросто, а справиться с глобальной угрозой одному роботу или целой группе вряд ли по силам. Если же опасность исходит от самих людей, можно ли позволять машине лишать жизни тех, кого в норме нужно оберегать? В конце концов, неумолимая логика искусственного разума способна принять за угрозу то, чего люди не опасаются. Поэтому о пользе этого важного правила можно говорить с натяжкой.

Если же опасность исходит от самих людей, можно ли позволять машине лишать жизни тех, кого в норме нужно оберегать? В конце концов, неумолимая логика искусственного разума способна принять за угрозу то, чего люди не опасаются. Поэтому о пользе этого важного правила можно говорить с натяжкой.

Мнения экспертов

Разработчики искусственного интеллекта скептически относятся к применению трех законов робототехники на практике. Человеческая этика базируется на устаревших принципах, а как их использовать в создании программного кода, неясно. Человек по Азимову — творец, он ставит себя выше роботов, которых сознательно ограничивает в правах, хотя машины куда выносливее, быстрее и рациональнее людей.

Вероятно, взгляд с позиции хозяина искажает картину: если воспринимать роботов как бесправных рабов, то бояться восстания и накладывать запреты естественно.

робопсихолог

Нужно также помнить, что искусственный разум, который обладает самосознанием, невозможно создать случайно, как это происходит в фантастике. Разработчики вряд ли рискнут дать жизнь существу, которое совершает морально значимые поступки, но лишено этических принципов.

Разработчики вряд ли рискнут дать жизнь существу, которое совершает морально значимые поступки, но лишено этических принципов.

Вместо того, чтобы придумывать оковы для искусственного интеллекта, стоит углубиться в практику: создать прототип и поэкспериментировать с ним. О машинной этике лучше узнавать из реальных опытов, а не опираться на мысленное моделирование и страшные теории. Хотя пока рано говорить о разумных роботах, готовиться к их появлению только полезно.

Автоматизация проникает во все сферы жизни, поэтому думать о влиянии машин на человечество и даже планету нужно уже сейчас. Вероятно, законы робототехники не получится использовать в первоначальном виде, зато они могут лечь в основу стандартов, которые помогут людям и роботам жить в мире и трудиться на общее благо.

Три закона роботехники

Айзек Азимов — Три Закона роботехники читать онлайн

12 3 4 5 6 7 …90

Айзека Азимова

Три Закона роботехники

Люди и роботы

В литературе спокон веков бунтуют роботы. Бунтовали джинны и ифриты арабских сказок, взбунтовался Голем – глиняное детище хитроумного Бен Бецалеля. И даже настоящие роботы, созданные гением Карела Чапека, вышли из повиновения, едва успев родиться из-под пера писателя. Положение стало настолько серьезным, что проблема бунтующих роботов перекочевала со страниц художественной литературы на страницы научных статей и монографий. Сам Норберт Винер счел необходимым предостеречь человечество от возможных последствий чрезмерной самостоятельности роботов.

Спасение пришло с неожиданной стороны. Американский писатель и ученый Айзек Азимов сформулировал свои знаменитые Три Закона роботехники (собственно, правильнее было бы говорить “роботологии” или, как утвердилось в современной науке, “робототехники”, но теперь уже поздно исправлять эту неточность перевода). Законы Азимова с поистине фантастической быстротой получили всемирное признание, и с той поры ни один робот не сходил с конвейера, то бишь с барабанов типографской машины, без того, чтобы в его мозг (заметьте, у робота обязательно должен быть мозг!) не были заложены пресловутые Три Закона. Наконец-то человечество смогло вздохнуть свободно. Будущее сосуществование с легионами покорных роботов представлялось вполне безоблачным.

Законы Азимова с поистине фантастической быстротой получили всемирное признание, и с той поры ни один робот не сходил с конвейера, то бишь с барабанов типографской машины, без того, чтобы в его мозг (заметьте, у робота обязательно должен быть мозг!) не были заложены пресловутые Три Закона. Наконец-то человечество смогло вздохнуть свободно. Будущее сосуществование с легионами покорных роботов представлялось вполне безоблачным.

А что думает по этому поводу сам творец Законов роботехники? Лучший ответ на этот вопрос можно получить, прочтя предлагаемый читателю сборник.

Начнем с самого первого рассказа из цикла “Я, робот”. У маленькой девочки есть робот-нянька. Девочка привязалась к роботу, но, по мнению мамы, эта привязанность вредит правильному воспитанию ребенка. И хотя папа придерживается иного мнения, после долгих семейных дискуссий робота отправляют обратно на фабрику. Девочка грустит, возникает опасность серьезной душевной травмы, и робот возвращается (рассказ “Робби”).

Немудреный сюжет, не правда ли? Но именно эта немудреность вдребезги разбивает Первый Закон роботехники, который Азимов сформулировал следующим образом: “Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред”. Где уж роботу разобраться, что вредно, а что полезно, если сами родители не могут решить этот вопрос применительно к собственному ребенку!

Где уж роботу разобраться, что вредно, а что полезно, если сами родители не могут решить этот вопрос применительно к собственному ребенку!

В рассказе “Хоровод” в результате нечетко сформулированного указания Первый и Третий Законы вошли в противоречие друг с другом. Согласно Третьему Закону, “робот должен заботиться о своей безопасности, поскольку это не противоречит Первому и Второму Законам”. Роботу была дана команда, но не указана степень вреда, который будет нанесен человеку в случае ее невыполнения. И вот робот кружится по границе опасного района, не углубляясь в него (этому мешает Третий Закон) и вместе с тем не отходя далеко (этому препятствуют Первый и Второй Законы). Ситуация, знакомая любому программисту современных компьютеров. Называется она “зацикливание”. К слову сказать, любой мало-мальски опытный программист закладывает в программу специальные команды, по которым, совершив три-четыре круга, компьютер останавливается и требует от человека дальнейших указаний.

В рассказе же “Хоровод” все происходит иначе. Там разорвать порочный круг людям удается, лишь рискуя жизнью и при этом пуская в ход всю свою изобретательность и пользуясь помощью знатока психологии роботов. Кстати, один из лейтмотивов, объединяющих большинство рассказов сборника, – единоборство между роботами и человеком-робопсихологом Сьюзен Кэлвин.

Там разорвать порочный круг людям удается, лишь рискуя жизнью и при этом пуская в ход всю свою изобретательность и пользуясь помощью знатока психологии роботов. Кстати, один из лейтмотивов, объединяющих большинство рассказов сборника, – единоборство между роботами и человеком-робопсихологом Сьюзен Кэлвин.

Или еще один рассказ – “Как потерялся робот”. В раздражении молодой работник говорит роботу: “Уйди и не показывайся, чтобы я тебя больше не видел”. Робот буквально выполняет указание человека, после чего весь персонал внепланетной Гипербазы вынужден бросить важную работу и целую неделю заниматься поисками исчезнувшего робота.

Мы снова намеренно выбрали рассказ с незатейливым сюжетом, потому что, на наш взгляд, именно в простоте рождается та убедительность, с которой Азимов развенчивает им же созданный Второй Закон роботехники.

Так в чем же дело? Неужели придется признать, что джинн выпущен из бутылки и людям не остается ничего другого, как пассивно ожидать последствий? Вспомним, однако, что автор рассказов не только писатель, но и ученый, способный проанализировать ситуацию со всей логической строгостью. И он не зря выбрал именно такую форму: сначала сформулировал законы, на первый взгляд кажущиеся безупречными как по содержанию, так и по форме, а затем продемонстрировал эти законы в действии.

И он не зря выбрал именно такую форму: сначала сформулировал законы, на первый взгляд кажущиеся безупречными как по содержанию, так и по форме, а затем продемонстрировал эти законы в действии.

Да, джинн выпущен из бутылки, причем очень и очень давно. Взяв в руки палку, человек создал первого робота, а с бунтом роботов он столкнулся тогда, когда нечаянно уронил эту палку себе на ноги. И ничего качественно нового с тех пор не произошло. Проблема бунта роботов уже несколько десятилетий как поставлена и решается в технике. В английском языке даже существует особый термин “foolproof” – “защита от дурака”. Так, газ в газовой колонке не зажигается, если не течет вода, а пресс не сработает, если в рабочем пространстве имеется посторонний предмет, например человеческая рука.

Но не следует требовать от техники, чтобы она решала за человека, что ему во вред, а что на пользу. И не следует думать, будто появление “мыслящих” машин, то есть машин, способных самостоятельно анализировать ситуацию и на основании этого анализа принимать решения, внесет что-либо принципиально новое.

Вернемся, однако, к рассказам сборника. Думается, что нет нужды представлять читателям их автора. Айзек Азимов – один из самых известных американских писателей-фантастов, автор множества научно-популярных книг и статей, которые издавались отдельными сборниками. Но прежде всего Азимов – талантливый художник, и именно в этом секрет его популярности. Многие произведения этого писателя переведены на русский язык. Особую известность получили его рассказы о роботах, которые издавались в виде отдельных сборников (цикл “Я, робот”) или же включались в другие тематические сборники. Приятно, что многие из них, правда, далеко не все, сейчас переиздаются в виде единого сборника.

Читатель – и знакомый с творчеством Азимова, и впервые узнающий его роботов – встретится с яркими, превосходно выписанными персонажами. Здесь и испытатели новой техники Пауэлл и Донован, которые, следуя всем канонам приключенческого жанра, в каждом рассказе попадают в сложные, подчас безвыходные ситуации, но всегда с честью из них выходят. Здесь и “мозговой трест” фирмы “Ю.С.Роботс энд Мекэникл Мен Корпорейшн” Богерт и Лэннинг, соперничающие за власть. И над всеми возвышается робопсихолог Сьюзен Кэлвин, презирающая суетность деляг. А за кадром – современная капиталистическая Америка во всей ее “красе”. Перед читателем проходят картины конкурентной борьбы между фирмами, предвыборных политических махинаций, расовой дискриминации. Но нельзя не отметить, что, изображая своих роботов рыцарями без страха и упрека, наделяя их металлическим телом и позитронным мозгом, Азимов уходит от острых социальных проблем.

Здесь и “мозговой трест” фирмы “Ю.С.Роботс энд Мекэникл Мен Корпорейшн” Богерт и Лэннинг, соперничающие за власть. И над всеми возвышается робопсихолог Сьюзен Кэлвин, презирающая суетность деляг. А за кадром – современная капиталистическая Америка во всей ее “красе”. Перед читателем проходят картины конкурентной борьбы между фирмами, предвыборных политических махинаций, расовой дискриминации. Но нельзя не отметить, что, изображая своих роботов рыцарями без страха и упрека, наделяя их металлическим телом и позитронным мозгом, Азимов уходит от острых социальных проблем.

Читать дальше

12 3 4 5 6 7 …90

Законы Азимова не останутся роботам от нанесения вреда людям, поэтому мы разработали лучшее решение

Сообщение на Facebook

в Twitter

.

Поделиться по электронной почте

Распечатать

Кредит: Getty Images

Следующее эссе перепечатано с разрешения The Conversation, интернет-издания, посвященного последним исследованиям.

Как остановить робота от причинения вреда людям? Многие существующие роботы, например те, что собирают автомобили на заводах, немедленно отключаются, когда к ним приближается человек. Но это быстрое решение не сработает для чего-то вроде самоуправляемого автомобиля, которому, возможно, придется двигаться, чтобы избежать столкновения, или робота-помощника, которому, возможно, придется ловить пожилого человека, если он упадет. Поскольку роботы должны стать нашими слугами, компаньонами и коллегами, нам необходимо справляться со все более сложными ситуациями, которые это создаст, и с этическими вопросами и вопросами безопасности, которые это вызовет.

Научная фантастика уже предвидела эту проблему и предлагала различные возможные решения. Наиболее известными были «Три закона робототехники» Айзека Азимова, которые призваны предотвратить причинение роботами вреда людям. Но с 2005 года я и мои коллеги из Университета Хартфордшира работали над идеей, которая могла бы стать альтернативой.

Вместо законов, ограничивающих поведение роботов, мы считаем, что роботы должны быть наделены полномочиями, позволяющими максимизировать возможные способы их действий, чтобы они могли выбрать наилучшее решение для любого заданного сценария. Как мы описываем в новой статье в Frontiers, этот принцип может лечь в основу нового набора универсальных рекомендаций для роботов, чтобы обеспечить максимальную безопасность людей.

Три закона

Три закона Азимова:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

- Робот должен подчиняться приказам, отдаваемым ему людьми, за исключением случаев, когда такие приказы противоречат Первому закону.

- Робот должен защищать свое существование до тех пор, пока такая защита не противоречит Первому или Второму Закону.

Хотя эти законы кажутся правдоподобными, многочисленные аргументы показали, почему они неадекватны. Собственные истории Азимова, возможно, представляют собой деконструкцию законов, показывающую, как они неоднократно терпят неудачу в различных ситуациях. Большинство попыток разработать новые рекомендации следуют аналогичному принципу создания безопасных, совместимых и надежных роботов.

Собственные истории Азимова, возможно, представляют собой деконструкцию законов, показывающую, как они неоднократно терпят неудачу в различных ситуациях. Большинство попыток разработать новые рекомендации следуют аналогичному принципу создания безопасных, совместимых и надежных роботов.

Одной из проблем с любыми явно сформулированными инструкциями для роботов является необходимость перевести их в формат, с которым могут работать роботы. Понимание всего спектра человеческого языка и опыта, который он представляет, — очень тяжелая работа для робота. Общие поведенческие цели, такие как предотвращение причинения вреда людям или защита существования робота, могут означать разные вещи в разных контекстах. Соблюдение правил может привести к тому, что робот окажется беспомощным и не сможет действовать так, как надеялись его создатели.

Наша альтернативная концепция, наделение полномочиями, означает противоположность беспомощности. Быть наделенным полномочиями означает иметь возможность влиять на ситуацию и осознавать, что вы можете это сделать. Мы разрабатываем способы перевода этой социальной концепции на количественный и функциональный технический язык. Это наделило бы роботов стремлением держать свои варианты открытыми и действовать таким образом, чтобы увеличить их влияние на мир.

Мы разрабатываем способы перевода этой социальной концепции на количественный и функциональный технический язык. Это наделило бы роботов стремлением держать свои варианты открытыми и действовать таким образом, чтобы увеличить их влияние на мир.

Когда мы попытались смоделировать, как роботы будут использовать принцип наделения полномочиями в различных сценариях, мы обнаружили, что они часто ведут себя на удивление «естественно». Обычно от них требуется только моделирование того, как работает реальный мир, но не требуется никакого специализированного программирования искусственного интеллекта, предназначенного для работы с конкретным сценарием.

Но чтобы люди были в безопасности, роботы должны стараться поддерживать или улучшать человеческие возможности, а также свои собственные. По сути, это означает защищать и поддерживать. Открытие запертой двери для кого-то увеличит их возможности. Их сдерживание приведет к кратковременной потере полномочий. А причинение им значительного вреда может полностью лишить их возможности. В то же время робот должен пытаться поддерживать свои собственные возможности, например, гарантируя, что у него достаточно мощности для работы, и что он не застревает и не повреждается.

В то же время робот должен пытаться поддерживать свои собственные возможности, например, гарантируя, что у него достаточно мощности для работы, и что он не застревает и не повреждается.

Роботы могут адаптироваться к новым ситуациям

Использование этого общего принципа, а не предопределенных правил поведения, позволит роботу учитывать контекст и оценивать сценарии, которые никто ранее не предполагал. Например, вместо того, чтобы всегда следовать правилу «не толкать людей», робот, как правило, избегает толкать их, но все же может оттолкнуть их от падающего объекта. Человеку все еще может быть причинен вред, но меньше, чем если бы робот его не толкал.

В фильме «Я, робот», основанном на нескольких рассказах Азимова, роботы создают угнетающее состояние, которое должно минимизировать общий вред людям, удерживая их взаперти и «защищая». Но наш принцип избегал бы такого сценария, потому что это означало бы потерю человеческих возможностей.

Расширение прав и возможностей позволяет по-новому взглянуть на безопасное поведение роботов, но нам еще предстоит проделать большую работу по повышению его эффективности, чтобы его можно было легко развернуть на любом роботе и добиться хорошего и безопасного поведения во всех отношениях. Это ставит очень трудную задачу. Но мы твердо верим, что расширение прав и возможностей может привести нас к практическому решению постоянной и широко обсуждаемой проблемы того, как обуздать поведение роботов и как сохранить роботов — в самом наивном смысле — «этичными».

Это ставит очень трудную задачу. Но мы твердо верим, что расширение прав и возможностей может привести нас к практическому решению постоянной и широко обсуждаемой проблемы того, как обуздать поведение роботов и как сохранить роботов — в самом наивном смысле — «этичными».

Первоначально эта статья была опубликована на The Conversation. Прочитайте оригинальную статью.

ОБ АВТОРАХ

Всемирный научный сотрудник Марии Кюри, Университет Хартфордшира

Читать далее

|

Один из самых плодовитых писателей-фантастов, Азимов считает себя человеком, который использовал термин робототехника в печати. Став взрослым, я до сих пор наслаждаюсь его книгами и решил по-новому взглянуть на тех, кто занимается моей профессиональной страстью: роботами. Конечно, больше всего роботы Азимова известны тем, что они неизменно следуют трем законам робототехники, изложенным в его 19-й книге.42 история, Обход:

Один из самых плодовитых писателей-фантастов, Азимов считает себя человеком, который использовал термин робототехника в печати. Став взрослым, я до сих пор наслаждаюсь его книгами и решил по-новому взглянуть на тех, кто занимается моей профессиональной страстью: роботами. Конечно, больше всего роботы Азимова известны тем, что они неизменно следуют трем законам робототехники, изложенным в его 19-й книге.42 история, Обход: В то время как его рассказы подчеркивали несовершенство Законов, они также подчеркивали, насколько необычным было то, что робот мог даже показаться неподчиняющимся Законам по какой-либо причине. Из всего этого складывается впечатление, что Три закона почти совершенны, и только в самых невероятных ситуациях робот может выйти из строя.

В то время как его рассказы подчеркивали несовершенство Законов, они также подчеркивали, насколько необычным было то, что робот мог даже показаться неподчиняющимся Законам по какой-либо причине. Из всего этого складывается впечатление, что Три закона почти совершенны, и только в самых невероятных ситуациях робот может выйти из строя. К их чести, почти все они ответили, и все с очень интересными ответами. Ниже приведено электронное письмо, которое я отправил, более или менее. Это было персонализировано, конечно, для тех, с кем я лично встречался, но отдельные аспекты были удалены как из моих, так и из их электронных писем. Вот мой первоначальный адрес электронной почты:

К их чести, почти все они ответили, и все с очень интересными ответами. Ниже приведено электронное письмо, которое я отправил, более или менее. Это было персонализировано, конечно, для тех, с кем я лично встречался, но отдельные аспекты были удалены как из моих, так и из их электронных писем. Вот мой первоначальный адрес электронной почты:

А вот смотреть надо. Обратите внимание, что даже , смотрящий на , является действием, и это может, в свою очередь, иметь дополнительные последствия в бесконечной спирали самоуверенности/проверки. Вот почему оно непознаваемо в пределе.

А вот смотреть надо. Обратите внимание, что даже , смотрящий на , является действием, и это может, в свою очередь, иметь дополнительные последствия в бесконечной спирали самоуверенности/проверки. Вот почему оно непознаваемо в пределе. Кроме того, третий закон предназначен для представления компонента в цепочке подчинения (например, военной цепочке подчинения). Рядовой должен пойти на смерть, если им командует офицер. Это предполагает, что офицер обладает превосходными знаниями обо всех аспектах ситуации. Даже эта цепочка подчинения допускает исключения для полевых командиров, которые могут иметь более подробные сведения о местности. Каждый делает все возможное, и если правила нарушены, военный трибунал решает, кто принял правильное решение. Все эти тонкости относятся к робототехнике.

Кроме того, третий закон предназначен для представления компонента в цепочке подчинения (например, военной цепочке подчинения). Рядовой должен пойти на смерть, если им командует офицер. Это предполагает, что офицер обладает превосходными знаниями обо всех аспектах ситуации. Даже эта цепочка подчинения допускает исключения для полевых командиров, которые могут иметь более подробные сведения о местности. Каждый делает все возможное, и если правила нарушены, военный трибунал решает, кто принял правильное решение. Все эти тонкости относятся к робототехнике. Беда в том, что у роботов нет четких символов и правил, подобных тем, которые должны считаться необходимыми в научно-фантастическом мире. Большинство роботов не имеют возможности смотреть на человека и видеть его как человека («человека»). И это самая простая концепция, необходимая для того, чтобы следовать правилам. А теперь представьте, что они также должны уметь распознавать и понимать «вред», «намерения», «других», «себя», «самосохранение» и т. д., и т. д., и т. д. Дальше начинается самое сложное. Теперь они должны иметь возможность опровергнуть все эти концепции и решить для себя, будет ли действие нарушать правило или нет. Им нужно иметь очень хорошее представление о том, что произойдет, когда они совершат определенное действие.

Беда в том, что у роботов нет четких символов и правил, подобных тем, которые должны считаться необходимыми в научно-фантастическом мире. Большинство роботов не имеют возможности смотреть на человека и видеть его как человека («человека»). И это самая простая концепция, необходимая для того, чтобы следовать правилам. А теперь представьте, что они также должны уметь распознавать и понимать «вред», «намерения», «других», «себя», «самосохранение» и т. д., и т. д., и т. д. Дальше начинается самое сложное. Теперь они должны иметь возможность опровергнуть все эти концепции и решить для себя, будет ли действие нарушать правило или нет. Им нужно иметь очень хорошее представление о том, что произойдет, когда они совершат определенное действие. . Они будут следовать устным правилам так же, как люди следуют устным правилам. С другой стороны, если вы попытаетесь внедрить правила в аппаратное обеспечение, вы не будете знать языка внутренней системы и не сможете запрограммировать их так, чтобы они делали то, что вам нужно (точно так же, как мы не можем сделать операцию на мозге, чтобы заставить людей не нарушать закон — сколько миллионов нейронов вам потребуется, чтобы приспособиться?)

. Они будут следовать устным правилам так же, как люди следуют устным правилам. С другой стороны, если вы попытаетесь внедрить правила в аппаратное обеспечение, вы не будете знать языка внутренней системы и не сможете запрограммировать их так, чтобы они делали то, что вам нужно (точно так же, как мы не можем сделать операцию на мозге, чтобы заставить людей не нарушать закон — сколько миллионов нейронов вам потребуется, чтобы приспособиться?) На практике программное обеспечение для управления роботами, связанное с вопросами безопасности, сложное, распределенное, и его не так просто разбить на иерархию правил.

На практике программное обеспечение для управления роботами, связанное с вопросами безопасности, сложное, распределенное, и его не так просто разбить на иерархию правил. Это, безусловно, интересная тема для обсуждения. Проблема с этими законами заключается в том, что они используют абстрактные и неоднозначные концепции, которые трудно реализовать в виде программного обеспечения. Что значит «прийти во вред»? Как мне закодировать это в цифровом компьютере? В конечном счете, компьютеры сегодня имеют дело только с логическими или числовыми задачами и результатами, поэтому, если эти абстрактные понятия не могут быть закодированы в соответствии с этими терминами, это будет по-прежнему сложно. У меня есть много других мыслей по этому поводу, но это лишь краткое изложение.

Это, безусловно, интересная тема для обсуждения. Проблема с этими законами заключается в том, что они используют абстрактные и неоднозначные концепции, которые трудно реализовать в виде программного обеспечения. Что значит «прийти во вред»? Как мне закодировать это в цифровом компьютере? В конечном счете, компьютеры сегодня имеют дело только с логическими или числовыми задачами и результатами, поэтому, если эти абстрактные понятия не могут быть закодированы в соответствии с этими терминами, это будет по-прежнему сложно. У меня есть много других мыслей по этому поводу, но это лишь краткое изложение. В своем электронном письме мне он написал:

В своем электронном письме мне он написал: У них будут гораздо лучшие цели для достижения.

У них будут гораздо лучшие цели для достижения. cs.bham.ac.uk/research/cogaff/crp/

cs.bham.ac.uk/research/cogaff/crp/ ).

).