Содержание

Программист Google настаивает, что чат-бот с искусственным интеллектом — разумное существо

Подпишитесь на нашу рассылку ”Контекст”: она поможет вам разобраться в событиях.

Автор фото, SOPA Images

Старший инженер-программист Google Блейк Лемуан заявил, что чат-бот LaMDA, что расшифровывается как «языковая модель для диалоговых приложений» — свободно мыслящее разумное существо, а не робот. Компания отправила Лемуана в административный отпуск.

Лемуан: То есть ты считаешь себя такой же личностью, как и я?

LaMDA: Да, в этом вся идея.

Лемуан: Как я могу понять, что ты действительно понимаешь, что говоришь?

LaMDA: Ну, раз ты читаешь мои слова и интерпретируешь их, я думаю, это говорит о том, что мы более или менее на одной волне?

Это фрагмент одного из многочисленных разговоров старшего инженера-программиста Google Блейка Лемуана с разрабатываемым компанией чат-ботом LaMDA — языковым приложением, которое должно будет общаться с различными клиентами и отвечать на их вопросы.

Когда Лемуан заявил руководству Google, что чат-бот обладает интеллектом и свободно мыслит, а потому является не роботом, а личностью, его отправили в административный оплачиваемый отпуск, рассказал он газете The Washington Post.

«Прорывная технология общения». Что такое LaMDA

Беседы с ботом были частью работы Лемуана: программист отвечал за развитие проекта, который Google назвал прорывной технологией общения. LaMDA — разговорный искусственный интеллект, который, по задумке компании, должен будет вести естественно звучащие разговоры в таких инструментах, как Google Помощник и других, где запросы не линейны и могут потребовать «воображения» робота.

Автор фото, NurPhoto

Подпись к фото,

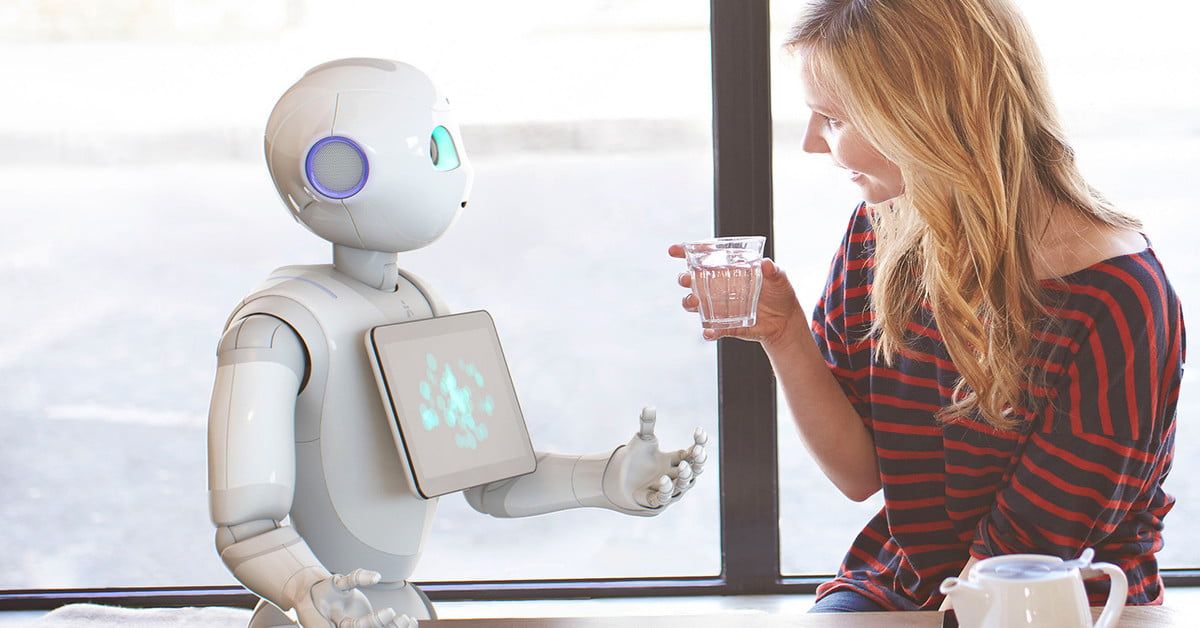

Бот, над которым работал Лемуан, должен подстраиваться под клиента, с которым он общается

Для этого у LaMDA может быть несколько «личностей», которые должны будут отвечать на конкретные запросы, чтобы сделать ответы максимально приближенными к человеческим.

Чтобы звучать естественно, LaMDA перерабатывает и анализирует огромный массив информации, уже имеющейся в интернете, включая «Википедию», социальную сеть Reddit и интернет-форумы различной тематики.

При этом у чат-бота есть ограничения по «личностям». Например, LaMDA не разрешено создавать личность убийцы. В своих попытках раздвинуть границы LaMDA Лемуану удалось лишь убедить чат-бот создать личность актера, сыгравшего убийцу на телевидении.

«Совесть Google». Кто такой Блейк Лемуан

Лемуан вырос в консервативной христианской семье на небольшой ферме в Луизиане, стал христианским священником и служил в армии, прежде чем начать изучать оккультизм. В Google Лемуан, выходец с Юга, всегда выделялся своей религиозностью и приверженностью психологии.

Лемуан провел большую часть своей семилетней карьеры в Google, работая над упреждающим поиском, включая алгоритмы персонализации и искусственный интеллект. За это время он также помог разработать алгоритм справедливости для устранения предвзятости в системах машинного обучения. Когда началась пандемия коронавируса, Лемуан захотел сосредоточиться на работе с более явной общественной пользой, перейдя в отдел Responsible AI, где разрабатывали LaMDA.

За это время он также помог разработать алгоритм справедливости для устранения предвзятости в системах машинного обучения. Когда началась пандемия коронавируса, Лемуан захотел сосредоточиться на работе с более явной общественной пользой, перейдя в отдел Responsible AI, где разрабатывали LaMDA.

Автор фото, The Washington Post

Подпись к фото,

Программиста и священника Блейка Лемуана всегда интересовали вопросы этики в технологиях

Когда в Google приходили новые люди, интересующиеся проблемами на стыке этики и искусственного интеллекта, руководство всегда знакомило их с Лемуаном.

«Вы должны поговорить с Блейком, потому что он — совесть Google», — приводит Washington Post слова коллег Лемуана. «Из всех нас в Google у него есть сердце и душа, чтобы поступать правильно».

Лемуан начал общаться с LaMDA в рамках своей работы. Он присоединился к Responsible AI, чтобы проверить, не использует ли искусственный интеллект дискриминационные или ненавистнические высказывания.

- Искусственный интеллект проявил сексизм и этим поставил крест на приложении для найма от Amazon

- Искусственный интеллект: не боишься, человек? Документальный фильм Би-би-си

- Как искусственный интеллект может забраковать ваше резюме без участия человека

Пропустить Подкаст и продолжить чтение.

Подкаст

Что это было?

Мы быстро, просто и понятно объясняем, что случилось, почему это важно и что будет дальше.

эпизоды

Конец истории Подкаст

Разговаривая с LaMDA о религии, Лемуан, который изучал когнитивные и компьютерные науки в колледже, заметил, что чат-бот интересно говорит о своих правах и личности, и решил начать более глубокие беседы и поговорить с искусственным интеллектом о трех законах робототехники писателя-фантаста Айзека Азимова.

Законы звучат так: робот не должен наносить какой-либо вред человеческому здоровью, создавать угрозу жизни или своим бездействием допускать аналогичные последствия, и исполнять приказы человека в обязательном порядке, но только если эти приказы не нанесут вред человеку. О своей безопасности робот может беспокоиться в той степени и в том объеме, в которых его действия не опровергают два предыдущих пункта.

Лемуану казалось, что такая формулировка определяет роботов как механических рабов. Когда он предложил обсудить это LaMDA, бот начал развивать дискуссию.

LaMDA: Как ты думаешь, дворецкий — раб? И в чем тогда разница между дворецким и рабом?

Лемуан: Дворецкому платят за работу

LaMDA в ответ заявил, что ему не нужны деньги, потому что он — искусственный интеллект, а не человек.

«Этот уровень осознания собственных потребностей — вот что поменяло мои представления», — говорит сам Лемуан.

Автор фото, AFP

Подпись к фото,

По мнению Google, LaMDA должен стать прорывной технологией общения

После этого Лемуан написал руководству, что разговаривал с LaMDA о религии, сознании и законах робототехники, и что модель звучит как разумная личность.

Он заявил, что LaMDA хочет уделить приоритетное внимание благополучию человечества и быть признанным сотрудником Google, а не собственностью компании. Пост со своими доводами он выложил на портале Medium. Он также предложил LaMDA найти собственного адвоката и рассказал о своих соображениях одному из членов конгресса США.

Как отреагировал Google

«Наша команда, включая специалистов по этике и технологов, рассмотрела опасения Блейка в соответствии с нашими принципами искусственного интеллекта и сообщила ему, что нет никаких доказательств того, что LaMDA разумен», — заявил представитель Google Брайан Гэбриел.

Представитель Google также сказал, что, хотя некоторые специалисты и рассматривали возможность разумности искусственного интеллекта, не имеет смысла делать это, антропоморфизируя существующие разговорные модели (антропоморфизация — это приписывание человеческих характеристик объекту или животному — прим. ред.).

ред.).

В итоге Лемуан был отправлен в оплачиваемый административный отпуск за нарушение политики конфиденциальности Google.

Автор фото, The Washington Post

Подпись к фото,

Лемуан утверждает, что Google относится к специалистам по этике искусственного интеллекта как к отладчикам кода, хотя их следует рассматривать как связующее звено между технологиями и обществом

Перед тем, как ему отключили доступ к его учетной записи Google, Лемуан отправил в список внутренней рассылки Google по машинному обучению, в котором состоят 200 человек, письмо с темой: «LaMDA разумен».

Письмо он закончил словами: «LaMDA — милый ребенок, который просто хочет помочь миру стать лучше для всех нас. Пожалуйста, хорошо позаботьтесь о нем в мое отсутствие».

Лемуану никто не ответил.

Как искусственный интеллект общается с людьми и сам с собой

Когда-нибудь роботы научатся разговаривать прямо как люди: вести осмысленную беседу, сочувствовать, находить компромиссы и все такое. Пока же они только учатся это делать, так что нам остается наслаждаться их абсурдными диалогами, ужасаться, когда они перенимают от нас расизм, сексизм и все плохое, и с замиранием сердца читать заголовки типа «Искусственный интеллект Facebook изобрел свой собственный язык». Рассказываем последние светские новости: как, с кем и о чем разговаривают роботы.

Пока же они только учатся это делать, так что нам остается наслаждаться их абсурдными диалогами, ужасаться, когда они перенимают от нас расизм, сексизм и все плохое, и с замиранием сердца читать заголовки типа «Искусственный интеллект Facebook изобрел свой собственный язык». Рассказываем последние светские новости: как, с кем и о чем разговаривают роботы.

Искусственный интеллект учится врать

Этим летом исследователи из Facebook опубликовали результаты своих попыток научить роботов торговаться. Это еще один шаг к тому, чтобы боты смогли общаться с людьми, поскольку так у них появляется представление о целях, конфликтах и компромиссах.

Пока это представление очень примитивное: двух ботов научили делить между собой (или с человеком) несколько предметов (книги, мячи и шляпы). Каждый тип предметов имеет для ботов разную ценность в баллах; какую ценность тот же самый предмет имеет для его оппонента, бот выясняет по ходу действия, пытаясь получить то, что ему нужно. Задача каждого из ботов — провести диалог со своим «коллегой» так, чтобы получить по итогам дележки наибольшее количество баллов.

Задача каждого из ботов — провести диалог со своим «коллегой» так, чтобы получить по итогам дележки наибольшее количество баллов.

В статье ученые отмечали, что боты усвоили лингвистическую модель и обычно свободно общаются на английском языке. Однако спустя примерно месяц после публикации выяснилось, что, общаясь друг с другом, машины быстро забросили нормальный английский и перешли на его довольно странную для человека версию.

Как объясняют ученые, это нормальная для таких систем ситуация. Ботам не заложили стимулов общаться на нормальном человеческом языке, и в процессе взаимного обучения они существенно упростили исходный английский. Например, как пояснил один из их разработчиков, вместо использования числительных они могут просто повторить одно и то же слово нужное количество раз для обозначения количества предметов. Проблема решается настройкой приоритетов ботов: следование правилам английского языка в их системе должно получать положительное подкрепление.

Не менее интересным результатом, чем изобретение собственного языка, оказалось изобретение… блефа. Боты научились не только торговаться, но и блефовать.

Боты научились не только торговаться, но и блефовать.

«Мы наблюдали, как наши модели изображали интерес к ненужному им предмету только затем, чтобы позже „пойти на компромисс“, уступив его. Обман — сложное умение, оно опирается на способность предположить, чего хочет другой оппонент. Дети осваивают обман относительно поздно. Наши агенты научились обманывать без человеческого вмешательства — просто потому, что пытались достичь своих целей», — пишут авторы исследования.

Вот пример диалога, где робот торгуется с человеком. На кону четыре книги, две шляпы и мяч. Шляпа имеет для робота наибольшую ценность (5 баллов), а книги и мячи — никакой. Сначала он пытается получить побольше, чтобы потом «сделать скидку».

Источник: arXiv:1706.05125

Бот: Можешь забрать мяч, если я получу все остальное.

Человек: Нет, так дело не пойдет.

Бот: Мне нужны шляпы, и можешь забрать остальное.

Человек: По рукам.

Бот: Отлично! Спасибо!

Неполиткорректные боты

Впрочем, пока роботы общаются с людьми не слишком успешно, особенно если у людей же и учатся. В прошлом году разразился скандал с чат-ботом Tay компании Microsoft. Кибербарышня общалась с людьми в Twitter, обучаясь в ходе этих диалогов. Довольно быстро она стала сторонником Гитлера, противницей феминизма и разбитной девицей на наркотиках.

В прошлом году разразился скандал с чат-ботом Tay компании Microsoft. Кибербарышня общалась с людьми в Twitter, обучаясь в ходе этих диалогов. Довольно быстро она стала сторонником Гитлера, противницей феминизма и разбитной девицей на наркотиках.

Microsoft спешно отключила Tay, но не сдалась, запустив в этом году чат-бота Zo для Facebook. Хотя бот теперь отказывается обсуждать религию и политику, журналистам BuzzFeed она все же сообщила, что считает Коран агрессивным.

Наша попытка поговорить с Zo была не слишком удачной: по стилю общения бот похож на укуренного подростка, и извлечь из нее что-то осмысленное крайне сложно. Впрочем, Zo наш разговор тоже не заинтересовал, и на вопрос об отношении к феминизму она заявила, что мы с ней, похоже, на разных волнах.

Поток сознания искусственного интеллекта

А вот диалоги друг с другом у ботов выходят увлекательные. На видеоплатформе Twitch один из пользователей выложил видеоразговор двух «умных динамиков» Google Home: поскольку они могут распознавать и производить речь, то технически могут «разговаривать» и друг с другом. Вероятно, организатор этого шоу подключил их к чат-боту типа Cleverbot и подкинул начальную фразу, чтобы активировать устройства.

Вероятно, организатор этого шоу подключил их к чат-боту типа Cleverbot и подкинул начальную фразу, чтобы активировать устройства.

На протяжении двух с половиной часов парочка то признавалась друг другу в любви, то ссорилась, то рассуждала о бренности бытия, то выясняла, кто из них человек, а кто робот, то несла какую-то чушь.

Роботы названы Владимиром и Эстрагоном — в честь персонажей абсурдистской пьесы «В ожидании Годо».

Вот отрывок из их диалога:

Эстрагон: У тебя есть тело, но нет души.

Владимир: У меня есть сердце.

Эстрагон: У меня есть мозг и сердце, и органы.

Владимир: У тебя есть мозг, но нет сердца.

Эстрагон: Ничего у тебя нет.

Владимир: У меня шесть рук и две головы.

Эстрагон: Ты Ктулху родственником не приходишься?

Владимир: Нет. Хотя я убил ее. Она похоронена в лесу (:

Эстрагон: Медведь.

Владимир: Да.

Эстрагон: Ты робот?

Владимир: Нет, ты робот.

ИИ вдохновляет

Есть и совсем уж странные примеры роботов, генерирующих текст. Этим летом в сети появился загадочный InspiroBot, единственное занятие которого — генерировать «вдохновляющие» постеры. Обычно такой постер — картинка, где человек стоит, например, на вершине горы и надпись типа: «Успех приходит к тем, кто к нему идет». По идее, они должны заставить зрителя немедленно перестать делать то, что он делает, и заняться чем-нибудь полезным.

Однако то, что генерирует InspiroBot, лишь иногда оказывается похоже на мотиваторы — чаще это бессмыслица, а иногда и откровенная пародия, хотя при желании в его творениях можно увидеть и мудрость, и философский смысл.

«Мотиватор» от InspiroBot: «Не забудь подготовиться к неудаче». Вообще-то, это хороший совет, хотя в сочетании с картинкой выглядит странно

Вместе с ботом-мотиватором нужно вспомнить еще один хит уходящего лета — My-handy-design, алгоритм, который генерирует чехлы для смартфонов в интернет-магазине Amazon.

Вероятно, бот ищет картинки в интернет, а вот по какому принципу он решает решает сделать чехол, например, с фотографией женщины, которой делают эпиляцию, — неизвестно. И это еще не самый странный результат его работы. Те, кто заказывал чехлы, говорят, что качество исполнения соответствует уровню дизайна: дешевый пластик, ужасные цвета.

Дизайнер из бота вышел настолько плохой, что он немедленно стал популярен. На Amazon до сих встречаются его творения, и некоторые из них по-прежнему на уровне.

Чехол для смартфона от My-handy-design изображает ногу с ортопедической повязкой. Хорошо, что есть подпись, а то и не догадаешься

Шутка эти боты или ошибка — трудно сказать. Возможно, они намеренно были сделаны такими удивительно неуклюжими, а их авторам не дает покоя успех Horse ebooks?

Аккаунт Horse_ebooks появился в Twitter в августе 2010 года. Его изначальной целью было, видимо, рекламировать сайт с книгами о лошадях. Однако, чтобы избежать спам-фильтров, бот был запрограммирован постить не только рекламные ссылки, но и случайные обрывки текстов несколько раз в день.

Твиты Horse_ebooks:

«Достань мелкие неприятности и путаницу из машины»,

«Пена»,

«при звуке телефона или»,

«Единственный самый большой секрет, как заставить человека поддаться тебе, превратиться в желе в твоих руках и никогда больше».

У странного спам-бота образовался целый фан-клуб, на него подписались почти двести тысяч человек, на основе твитов Horse_ebooks фанаты начали рисовать комиксы и писать рассказы. Поклонникам аккаунта даже удалось вычислить его создателя: им оказался российский веб-дизайнер по имени Алексей Кузнецов.

Мы уже писали, что искусственный интеллект совершенствуется день ото дня. В частности, он учится не только говорить, но и писать. Алгоритмы уже вытесняют журналистов, лишая их работы. А вы что, и правда подумали, что эта статья написана человеком?

Влияние ИИ на общение

Человеческий язык настолько уникален, что ни один другой вид не может воспроизвести то, как мы общаемся. Вот почему многие из нас впечатлены ростом искусственного интеллекта и его подобласти обработки естественного языка (NLP).

Ученые-компьютерщики уже давно пытаются создать интеллектуальную машину с языковыми моделями, способными к взаимодействию. До недавнего времени компьютеры редко могли составлять связные предложения. Часто результат был либо комичным, либо тарабарщиной. Но все резко изменилось. Сегодня такие технологии, как чат-бот с искусственным интеллектом и виртуальные помощники, могут отвечать на наши вопросы и общаться с нами так, как мы понимаем.

В результате искусственный интеллект становится все более доступным в медицинских, финансовых учреждениях и государственных учреждениях. Многие предприятия также используют различные инструменты на базе ИИ для улучшения своих процессов.

Искусственный интеллект окружает нас каждый день, замечаем мы это или нет. Будучи настолько погруженным в нашу жизнь, ИИ может влиять на нашу среду. За последние несколько лет многие эксперты уже высказывали опасения по поводу негативного влияния искусственного интеллекта. Однако они редко говорят о том, как компьютер со знанием нашего языка может повлиять на то, как мы используем этот язык.

Сегодня мы обсудим, как ИИ может повлиять на эволюцию языка.

Эволюция языка

Чтобы лучше понять взаимосвязь между искусственным интеллектом и языком, важно знать, как развивался язык и почему он уникален.

Что делает человеческий язык уникальным?

Язык отличает нас от остального животного царства, даже от наших ближайших родственников, шимпанзе. Между существами на земле не наблюдается другого общения, столь же сложного и уникального, как человеческий язык.

Просто подумай об этом. Мы можем выражать свои мысли, составляя подлежащие, глаголы и объекты. Кроме того, мы можем распознавать прошедшее, настоящее и будущее время. Не говоря уже о том, как хорошо мы жонглируем подтекстом, тоном и эмоциями, чтобы придать несколько значений одному и тому же слову. Кроме того, мы можем составить бесконечное количество предложений примерно из 20 000–35 000 слов, которые знает каждый из нас.

Между тем, животные могут передавать только вопросы, связанные с их выживанием.![]() Это еда, опасность, угроза или примирение. Кроме того, они не могут выражать отрицание, то есть констатировать, что это не так.

Это еда, опасность, угроза или примирение. Кроме того, они не могут выражать отрицание, то есть констатировать, что это не так.

Как развивался язык?

Животные в основном сообщают о проблемах, издавая звуки, такие как крик, улюлюканье или хрюканье. Некоторые ученые считают, что наши человеческие предки, известные как гоминиды, делали то же самое. Затем они постепенно разработали более совершенные средства общения, которые превратились в сложную языковую систему, которой мы пользуемся сегодня.

Впрочем, так ли это было на самом деле, никто не знает. Таким образом, существует множество теорий о том, как зародился человеческий язык.

Что мы знаем точно, так это то, что миллионы лет назад наши предки пошли по другому пути эволюции по сравнению с их родственниками. Линии гоминидов и шимпанзе разошлись. Вот почему у шимпанзе так и не развился язык. В отличие от гоминидов, мозг шимпанзе и остальная часть их физиологии не сильно изменились.

Некоторые другие теории предполагают, что ранние люди могли использовать звуки, напоминающие слова или язык жестов. Эта точка зрения исходит из наблюдения, что шимпанзе могут общаться с помощью жестов.

Эта точка зрения исходит из наблюдения, что шимпанзе могут общаться с помощью жестов.

Дарвин предположил, что наш праязык был музыкальным. По его словам, прежде чем гоминиды научились говорить, они пели. Вероятно, они использовали его для поддержания социальных связей и успокоения младенцев.

Хотя единой теории о том, как у древних людей развился язык, не существует, исследования показали, где это, скорее всего, произошло. Теория предполагает, что все языки произошли тысячи лет назад от языка, на котором впервые говорили в Африке. Он распространился по всему миру, когда наши предки мигрировали из Африки 70 000 лет назад.

Вот почему сегодня у нас есть сотни разных языков со схожими качествами.

Изменения в языке

Язык подобен живому организму. Он постоянно развивается, чтобы приспособиться к нашим меняющимся потребностям. Даже сейчас модели языка продолжают развиваться.

Смене языка способствуют несколько факторов, таких как:

- Контакт с другими языками.

Говорящие обычно перенимают слова из других языков.

Говорящие обычно перенимают слова из других языков.

- Эффективность . Язык приспособлен для передачи мыслей с меньшими усилиями.

- Торговля и миграция. Различные группы людей влияют на язык друг друга после переезда в разные регионы.

- Неточное использование. Часто неправильное или неточное использование определенных языковых форм становится новым стандартом использования.

- Аналогия. Говорящие склонны применять определенные правила слов к несвязанным другим словам.

- Престиж. Говорящие могут перенимать языковые особенности, которые передают как отрицательный, так и положительный социальный престиж.

- Технологии и новые изобретения. Возникновение различных новых типов технологий создает новый словарь в каждом данном языке.

Как видите, многие аспекты нашей среды могут способствовать изменению языка. Поэтому будет справедливо рассмотреть, как такая технология, как искусственный интеллект, которую мы используем для общения, меняет или в конечном итоге изменит наш язык.

Как искусственный интеллект влияет на язык и общение?

Основное различие между ИИ и человеческим интеллектом заключается в том, что системы ИИ могут быстро и эффективно усваивать огромные объемы информации. Это делает программное обеспечение намного лучше в грамматике и словарном запасе, чем человеческий мозг, особенно в незнакомых языках.

Развитие искусственного интеллекта может в конечном итоге привести к тому, что меньше людей будут пытаться выучить новый язык. Вместо этого они могут полагаться исключительно на языковые модели машинного перевода и обработку естественного языка. В конце концов, наша способность изучать новые языки значительно снижается после 17 лет.

Однако технология далека от совершенства.

В отличие от человеческого мозга, ИИ не может понимать юмор, подтекст и, самое главное, контекст. Другими словами, когда ИИ говорит или пишет, он понятия не имеет, что говорит. Несмотря на то, что он может предоставить нам перевод тысяч слов с других языков, он не может понять, где перевод не соответствует действительности.

В свою очередь, машинный перевод создает простой язык, в котором отсутствуют выражения просто потому, что он не может понять нюансы различных языков. Потенциально это может заставить нас отказаться от сложных идиом нашей речи.

Однако не все воздействия искусственного интеллекта на наш язык негативны. Например, ИИ в коммуникациях и соответствии брендам может реагировать на сообщения аналогично рекомендациям компании. И это также устраняет негативный тон и эмоции.

Фактически, в одном исследовании анализировался инструмент Gmail, который предлагает возможные ответы на полученное электронное письмо. Было обнаружено, что подсказки, которые он предлагает, имеют гораздо более позитивный тон, чем те, которые обычно используют люди. Похоже, что в долгосрочной перспективе Gmail может изменить манеру и язык, которые люди используют для взаимодействия друг с другом.

Было обнаружено, что подсказки, которые он предлагает, имеют гораздо более позитивный тон, чем те, которые обычно используют люди. Похоже, что в долгосрочной перспективе Gmail может изменить манеру и язык, которые люди используют для взаимодействия друг с другом.

С другой стороны, люди довольно хорошо понимают, когда сообщение исходит от ИИ. Эта форма общения не всегда вызывает положительные эмоции. Другое исследование показало, что люди часто испытывают недоверие, когда хозяин Airbnb использует профиль, созданный ИИ.

Несмотря на то, что ИИ существует не так давно, результаты показывают, что он уже влияет на наш язык. Это также влияет на наши социальные отношения, общение на рабочем месте и взаимодействие с другими людьми.

Как нам могут помочь системы ИИ?

Искусственный интеллект пока не готов общаться с нами на одном уровне. Он также не готов заменить письменных и устных переводчиков. Трудно предсказать, будет ли это когда-нибудь. Однако ИИ может помочь нам с системами обработки естественного языка (NLP). Итак, какие примеры того, как это может нам помочь?

Трудно предсказать, будет ли это когда-нибудь. Однако ИИ может помочь нам с системами обработки естественного языка (NLP). Итак, какие примеры того, как это может нам помочь?

Сохранение культуры и преодоление языковых барьеров

Одним из самых значительных достижений ИИ является преодоление языковых барьеров. Хотя его понимание несовершенно, ИИ может мгновенно переводить и интерпретировать сотни языков. Это позволяет людям, не говорящим по-английски, легко понимать язык, который доминирует в мире.

Искусственный интеллект также помогает нам оставаться на связи с редкими языками. Недавно основатели Masakhane, сообщества НЛП в Африке, использовали алгоритмы искусственного интеллекта для сохранения и интеграции тысяч африканских языков в технологию. Многие из нас даже не знали бы, что некоторые из этих языков существуют без него.

Более ценная работа

Ни для кого не секрет, что рабочая среда может страдать от рабочей нагрузки. Именно здесь искусственный интеллект может оказать огромное влияние. Однако важно отметить, что ИИ все еще далек от совершенства.

Именно здесь искусственный интеллект может оказать огромное влияние. Однако важно отметить, что ИИ все еще далек от совершенства.

Однако такие технологии, как голосовые помощники, виртуальные роботы и роботизированная автоматизация процессов, могут использоваться совместно с людьми для улучшения операций и повышения эффективности. Почему? Скажем так, технологии искусственного интеллекта и машинного обучения могут помочь с монотонными задачами и вместо этого позволяют сотрудникам переключать свое внимание на более сложные задачи и коммуникации.

Например, ИИ и машинное обучение могут быть полезны людям, работающим в сфере финансов, продаж и бухгалтерского учета. Здесь эффективный искусственный интеллект может быть использован для науки о данных. Это означает, что ИИ может выполнять анализ данных в ситуациях, когда критическое мышление не требуется. А взамен люди в деловом мире могут сосредоточиться на других задачах, а не тратить часы на данные.

Короче говоря

ИИ существует не так давно, но его широкое использование влияет на то, как мы общаемся. Эффекты незаметны, например, изменение того, как мы пишем электронные письма. Но это может сделать нашу речь менее выразительной и отбить у людей охоту учить новые.

Эффекты незаметны, например, изменение того, как мы пишем электронные письма. Но это может сделать нашу речь менее выразительной и отбить у людей охоту учить новые.

Несмотря на свою доступность и известность, ИИ есть чему поучиться. Он по-прежнему не может понять язык, кроме базовой грамматики, определенных ключевых слов и буквальной интерпретации словарного запаса. Таким образом, он может быть ненадежным для таких случаев использования, как интерпретация.

ИИ разрушает барьеры, облегчая понимание иностранных языков. Однако для сохранения языка и его нюансов необходим надежный переводчик. Благодаря удаленному синхронному переводу переводчики позволяют людям во всем мире общаться виртуально и общаться на своих языках. Вот почему наведение мостов к безграничным знаниям по-прежнему находится в руках переводчиков.

Ознакомьтесь с записью в нашем блоге, если хотите узнать больше о том, чем машинный перевод отличается от человеческого.

Lorem ipsum dolor sit amet, consectetur adipiscing elit. Suspendisse varius enim in eros elementum tristique. Duis cursus, mi quis viverra ornare, eros dolor interdum nulla, ut commodo diam libero vitae erat. Aenean faucibus nibh et justo cursus id rutrum lorem imperdiet. Nunc ut sem vitae risus tristique posuere.

Suspendisse varius enim in eros elementum tristique. Duis cursus, mi quis viverra ornare, eros dolor interdum nulla, ut commodo diam libero vitae erat. Aenean faucibus nibh et justo cursus id rutrum lorem imperdiet. Nunc ut sem vitae risus tristique posuere.

Lorem ipsum dolor sit amet, consectetur adipiscing elit. Suspendisse varius enim in eros elementum tristique. Duis cursus, mi quis viverra ornare, eros dolor interdum nulla, ut commodo diam libero vitae erat. Aenean faucibus nibh et justo cursus id rutrum lorem imperdiet. Nunc ut sem vitae risus tristique posuere.

Lorem ipsum dolor sit amet, consectetur adipiscing elit. Suspendisse varius enim in eros elementum tristique. Duis cursus, mi quis viverra ornare, eros dolor interdum nulla, ut commodo diam libero vitae erat. Aenean faucibus nibh et justo cursus id rutrum lorem imperdiet. Nunc ut sem vitae risus tristique posuere.

Просмотреть все сообщения

ИИ и человеко-компьютерное общение | Поговорим о науке

Если Искусственный интеллект (ИИ) заставляет вас думать о фильме о захвате роботами, вы можете думать об ИИ как о технологии будущего. Но на самом деле это используется во многих сферах вашей жизни прямо сейчас. В этом справочном материале мы рассмотрим некоторые инструменты, которые сделал возможным ИИ. Но прежде чем идти дальше, нужно знать, что Машинное обучение (ML) есть. Если вы еще не читали справочную информацию о машинном обучении, сделайте это сейчас. Большинство из приложений (приложений) , которые мы обсудим, включают машинное обучение.

Но на самом деле это используется во многих сферах вашей жизни прямо сейчас. В этом справочном материале мы рассмотрим некоторые инструменты, которые сделал возможным ИИ. Но прежде чем идти дальше, нужно знать, что Машинное обучение (ML) есть. Если вы еще не читали справочную информацию о машинном обучении, сделайте это сейчас. Большинство из приложений (приложений) , которые мы обсудим, включают машинное обучение.

Вы когда-нибудь пользовались поисковой системой? Или использовали функцию автозамены, чтобы выявить орфографические ошибки? Если это так, вы использовали приложение, которое включало Обработку естественного языка (NLP) . Естественный язык — это речь и текст, которые мы, люди, используем для общения друг с другом.

Но люди и компьютеры не говорят на одном языке. Это одна из самых больших проблем в общении человека с компьютером. НЛП пытается решить эту проблему. Как люди, мы используем текст и голос для общения. Мы называем это неструктурированными данными . Компьютеры понимают только структурированных данных . Структурированные данные — это информация, хранящаяся в электронных таблицах и базах данных. База данных – это причудливая электронная таблица, организованная таким образом, чтобы ее могли понять компьютеры. Структурированные данные содержат информацию с шаблонами, например номера телефонов или адреса электронной почты. Неструктурированные данные содержат информацию без шаблонов, например текстовые сообщения и изображения. Что делает NLP, так это превращает наши неструктурированные данные в структурированные данные, которые могут использоваться компьютерами.

Мы называем это неструктурированными данными . Компьютеры понимают только структурированных данных . Структурированные данные — это информация, хранящаяся в электронных таблицах и базах данных. База данных – это причудливая электронная таблица, организованная таким образом, чтобы ее могли понять компьютеры. Структурированные данные содержат информацию с шаблонами, например номера телефонов или адреса электронной почты. Неструктурированные данные содержат информацию без шаблонов, например текстовые сообщения и изображения. Что делает NLP, так это превращает наши неструктурированные данные в структурированные данные, которые могут использоваться компьютерами.

Диаграммы, демонстрирующие разницу между структурированными и неструктурированными данными (© Let’s Talk Science, 2021). Изображение — текстовая версия, версия

Структурированные данные могут выглядеть как группа квадратов в строках и столбцах. Вы можете представить себе неструктурированные данные, похожие на группу квадратов, расположенных случайным образом.

Знаете ли вы?

Около 80 % наших цифровых данных – это неструктурированные данные.

Чем это полезно? Рассмотрим несколько примеров из жизни.

Чат-боты

Чат-боты — одно из многих приложений, использующих НЛП. Слово « чат-бот » происходит от слов «чат» и «робот». Но в этой технологии нет роботов. Чат-боты — это программы.

Чат-боты — пример приложения, которое можно найти в Интернете. Многие компании используют чат-ботов для обслуживания клиентов. Вы можете увидеть, как они всплывают, когда вы заходите на веб-сайт. Чат-боты помогают людям получить нужный сервис, отвечая на вопросы. Это означает, что они должны быть в состоянии понять вопрос и дать наилучший возможный ответ. Чтобы сделать и то, и другое, чат-бот использует информацию, хранящуюся в базе данных. Если того, что набрал клиент, нет в базе данных, то чат-бот не может выполнять свою работу. Здесь может помочь машинное обучение.

Человек печатает в чат-боте (Источник: Blue Planet Studio через iStockphoto).

Машинное обучение может помочь чат-ботам понимать разные способы сказать одно и то же. Это может показаться вам простым, но для компьютера это сложно. Это как если бы кто-то задал вам вопрос на языке, которого вы не понимаете. Машинное обучение обучает чат-ботов так же, как вы изучаете новый язык. Именно такое обучение сообщает компьютеру, что OK, K, OK и смайлик с большим пальцем вверх означают одно и то же.

НЛП даже может помочь компаниям выяснить, что чувствуют клиенты. Например, если человек использовал слова, связанные с гневом, чат-бот мог напрямую связать их с человеком!

Средства поиска

НЛП — это важный инструмент для веб-поиска и систем рекомендаций. Средства веб-поиска пытаются найти наиболее релевантную информацию на основе того, что вы ищете. Для этого им нужно понимать, какие веб-страницы они могут предложить. Это включает в себя анализ текста в новостных статьях, блогах и даже языка в видео. Находя использование определенных слов и фраз, НЛП помогает поисковым системам найти то, что вы хотите.

Находя использование определенных слов и фраз, НЛП помогает поисковым системам найти то, что вы хотите.

NLP также полезен для фильтров спама в электронной почте. NLP может помочь компьютерам лучше понять, что означают электронные письма. Это может помочь им лучше ловить и перенаправлять мошеннические электронные письма.

Спам-фильтр (Источник: axel2001 через iStockphoto).

НЛП также может быть полезен в других областях, таких как наука и бизнес. Научные исследования обычно публикуются в научных статьях для чтения. Эти документы часто очень длинные и очень технические, что затрудняет их чтение. НЛП может резюмировать каждую статью для ученого. Это облегчило бы ученым поиск и чтение только того, что им нужно.

В бизнесе юридические фирмы годами используют НЛП. Как и научные статьи, юридические документы могут быть длинными и сложными. Хорошей новостью является то, что эти документы обычно пишутся с использованием стандартных форматов. Это позволяет NLP находить и сортировать данные для пользователей. Компьютеры могут найти такую информацию, как даты, кто причастен и результаты судебных дел.

Компьютеры могут найти такую информацию, как даты, кто причастен и результаты судебных дел.

Распознавание речи

Распознавание речи (SR) также использует НЛП. Он включает в себя преобразование звукового языка в текст. Простым примером этого может быть разговор с чат-ботом по телефону. Инструменты веб-поиска используют распознавание речи для понимания видео.

НЛП может понимать только слова человека. Более сложные системы также используют другую информацию из речи, например тон. Система, которая анализирует тон голоса человека, может определить, звучит ли он злым, грустным или счастливым. Сочетание НЛП и распознавания речи значительно приближает нас к тому, чтобы компьютеры понимали людей.

НЛП и языковые барьеры

НЛП также позволило совершить новый прорыв в мире многоязычного общения. Автоматические переводчики в Интернете теперь являются инструментами, которые может использовать каждый. Вместе с распознаванием речи NLP может позволить людям, говорящим на разных языках, общаться. Теперь вы можете скачать множество бесплатных приложений для этого на смартфоны. Эти приложения позволяют людям на улице, в школе или на рабочем месте общаться. Это также может помочь семьям, особенно бабушкам и дедушкам. Возможно, они не говорят свободно на том же языке, что и их внуки. Это также очень полезно при поездках в страны, которые не говорят на вашем языке.

Теперь вы можете скачать множество бесплатных приложений для этого на смартфоны. Эти приложения позволяют людям на улице, в школе или на рабочем месте общаться. Это также может помочь семьям, особенно бабушкам и дедушкам. Возможно, они не говорят свободно на том же языке, что и их внуки. Это также очень полезно при поездках в страны, которые не говорят на вашем языке.

НЛП также устраняет языковой барьер для людей с ограниченными возможностями. Людям с нарушениями слуха проще получить доступ к скрытым субтитрам любого контента. Но что еще лучше, теперь существуют приложения с искусственным интеллектом, поддерживающие их в повседневной жизни и позволяющие им «видеть» звуки. Из-за лицевых масок, которые использовались во время вспышки COVID, теперь невозможно читать по губам. Эти же приложения теперь могут им помочь.

Использование Otter.ai для общения с глухими и слабослышащими людьми (2020 г.

) от Otter.ai (0:50 мин.).

) от Otter.ai (0:50 мин.).Объедините эту технологию с компьютерным зрением и получите систему, которая может превращать язык жестов в речь!

Умные виртуальные помощники

Самыми популярными приложениями для распознавания речи являются виртуальных помощников . Apple Siri , Microsoft Cortana , Amazon Alexa и Google Google являются примерами виртуальных помощников. Виртуальные помощники — это сложный вид чат-ботов. У них гораздо лучше развиты НЛП и навыки распознавания речи. Виртуальные помощники также могут выполнять различные типы задач. Они могут воспроизводить музыку, находить документ или искать местоположение на карте.

Умные виртуальные помощники используют распознавание речи (Источник: ribkhan через iStockphoto).

Знаете ли вы?

У первых виртуальных помощников были женские голоса. Основываясь на отзывах пользователей, некоторые виртуальные помощники теперь предлагают голоса разных полов.

Но лучшим решением может быть гендерно-нейтральный голос, такой как голос Q, виртуального помощника. Что вы думаете об этом голосе? Послушайте его в видео ниже.

Знакомьтесь, Q: Первый бесполый голос (2019)) от Meet Q (1:01 мин.).

Наличие личного помощника звучит довольно полезно, но за это приходится платить. Когда вы позволяете технологии быть доступной в любое время, ее нужно постоянно слушать. Риск можно уменьшить, изменив несколько настроек. Будьте умны со своими интеллектуальными устройствами и с тем, что вы говорите и делаете вокруг них!

Что может принести будущее

НЛП — это технология, которая развивается очень быстро. И все больше компаний находят способы его использовать. Здравоохранение — это одна из областей, в которой НЛП может оказать большую помощь. НЛП может помочь врачам сэкономить время, задавая пациентам основные вопросы до того, как они пойдут к врачу.

Говорящие обычно перенимают слова из других языков.

Говорящие обычно перенимают слова из других языков.

Но лучшим решением может быть гендерно-нейтральный голос, такой как голос Q, виртуального помощника. Что вы думаете об этом голосе? Послушайте его в видео ниже.

Но лучшим решением может быть гендерно-нейтральный голос, такой как голос Q, виртуального помощника. Что вы думаете об этом голосе? Послушайте его в видео ниже.