Содержание

Почему у машин скоро появятся права — Секрет фирмы

Технологии

15:13, 03 октября 2016

Им нужны твоя одежда, сапоги и мотоцикл

Последние несколько месяцев займут важное место в истории эмансипации машин. В сентябре Британский институт стандартов выпустил документ, регламентирующий этику роботов. Если бы не общие (что, впрочем, неизбежно) формулировки, это был бы полноценный ГОСТ. А континентальным андроидам повезло ещё больше — Европарламент с начала лета обсуждает возможность сделать их практически гражданами. «По меньшей мере некоторые, наиболее сложные, автономные роботы могут получить статус электронных лиц, наделяющий их специфическими правами и обязанностями», — говорится в проекте резолюции, которую депутаты из Комитета по законодательству направили своим коллегам.

Последние несколько месяцев займут важное место в истории эмансипации машин. В сентябре Британский институт стандартов выпустил документ, регламентирующий этику роботов. Если бы не общие (что, впрочем, неизбежно) формулировки, это был бы полноценный ГОСТ. А континентальным андроидам повезло ещё больше — Европарламент с начала лета обсуждает возможность сделать их практически гражданами. «По меньшей мере некоторые, наиболее сложные автономные роботы могут получить статус электронных лиц, наделяющий их специфическими правами и обязанностями», — говорится в проекте резолюции, которую депутаты из Комитета по законодательству направили своим коллегам.

А континентальным андроидам повезло ещё больше — Европарламент с начала лета обсуждает возможность сделать их практически гражданами. «По меньшей мере некоторые, наиболее сложные автономные роботы могут получить статус электронных лиц, наделяющий их специфическими правами и обязанностями», — говорится в проекте резолюции, которую депутаты из Комитета по законодательству направили своим коллегам.

Про всевозможные этические проблемы, алгоритмы и законы, регулирующие поведение машин, говорят из каждого утюга (а скоро о них начнут говорить и сами утюги), но идея прав роботов почти не обсуждается, наверно потому, что интуитивно кажется абсурдной. Но это только на первый взгляд. Европейский проект, хоть и сваливает в одну кучу сразу несколько не связанных между собой проблем, интересен и важен тем, что впервые ставит этот вопрос на официальном уровне.

Полтора года назад интернет облетел ролик, в котором сотрудник принадлежащей Google робототехнической компании Boston Dynamics пинает робота Spot, слегка напоминающего собаку. Видео подняло бурю: люди по всему миру выражали возмущение и вступались за машину. Издание The Verge опубликовало статью «Прекратите бить роботов, пока они не начали бить нас», в которой автор пугает читателей тем, что недружественный искусственный интеллект, посмотревший на унижение Spot, может и отомстить. Это аргумент смешон в своей наивности, но есть и другие, более серьёзные причины не унижать роботов.

Видео подняло бурю: люди по всему миру выражали возмущение и вступались за машину. Издание The Verge опубликовало статью «Прекратите бить роботов, пока они не начали бить нас», в которой автор пугает читателей тем, что недружественный искусственный интеллект, посмотревший на унижение Spot, может и отомстить. Это аргумент смешон в своей наивности, но есть и другие, более серьёзные причины не унижать роботов.

Социальные роботы, которые коммуницируют с людьми и принимают на себя их роли, заслуживают юридической защиты, считает Кейт Дарлинг из Массачусетского технологического института (MIT). Она написала целый манифест в защиту своей позиции. Люди испытывают к роботам эмоциональную привязанность и склонны их одушевлять, считает она, а значит, общество должно наказывать жестокость по отношению к человекообразным роботам точно так же, как оно наказывает жестокость по отношению к кошкам или собакам. Эпиграфом к её статье стоит высказывание Иммануила Канта: «Тот, кто жесток к животным, ожесточается и по отношению к людям».

Как бы странно это ни звучало, Кейт Дарлинг, скорее всего, окажется права и социальные роботы получат юридическую защиту. Умных роботов становится всё больше, умные роботы с неизбежностью будут социальными, и люди, в свою очередь, не сумеют их не одушевлять. Алгоритмы поработят людей — если не нашу волю, то точно наши чувства.

Важный член семьи

Десять лет назад физик Марк Тилден построил робота для обезвреживания противопехотных мин. Самый простой способ обезвредить мину — наступить на неё, поэтому у робота было несколько ног и он бегал на них по заминированной местности, теряя одну конечность за другой, припадал на бок, перегруппировывался, неловко переваливался и полз дальше. С точки зрения робототехников, испытание было абсолютным успехом, но армейский полковник, руководивший учениями, их остановил. Он не мог спокойно смотреть, как покалеченный и обожжённый робот полз, отталкиваясь от земли последней своей ногой.

Люди жалеют роботов. Люди приписывают роботам моральную ответственность. Люди и взаимодействуют с роботами как с себе подобными. Новозеландский исследователь Кристоф Бартнек с соавторами заставлял роботов подкупать людей: они намеренно поддавались в игре «Камень — ножницы — бумага» (испытуемые получали некоторую сумму за каждую победу) в расчёте на то, что им вернут услугу. Только 10% людей сообщили экспериментаторам о том, что произошло, и лишь трое решили, что робот сломан. Подавляющему большинству людей тот факт, что робот плетёт интригу, не показалось чем-то удивительным.

Люди и взаимодействуют с роботами как с себе подобными. Новозеландский исследователь Кристоф Бартнек с соавторами заставлял роботов подкупать людей: они намеренно поддавались в игре «Камень — ножницы — бумага» (испытуемые получали некоторую сумму за каждую победу) в расчёте на то, что им вернут услугу. Только 10% людей сообщили экспериментаторам о том, что произошло, и лишь трое решили, что робот сломан. Подавляющему большинству людей тот факт, что робот плетёт интригу, не показалось чем-то удивительным.

Люди считают роботов почти живыми существами. Один из самых знаменитых экспериментов в социальной психологии описал в начале 1960-х Стенли Милгрэм. Он хотел проверить, могут ли люди причинять друг другу вред под давлением авторитета. Испытуемые должны были бить током незнакомых людей (на самом деле — актёров, симулировавших боль) в наказание за неправильные ответы. Если испытуемые не хотели этого делать, экспериментатор давил на них. Как ни удивительно, многие оказались способны пытать невиновных. В 1990-х новозеландский учёный Кристоф Бартнек попытался провести вариацию эксперимента Милгрэма — только мучить надо было не человека, а робота. В эксперименте испытуемый и его будущая жертва (робот) сидели бок о бок и играли в компьютерную игру. Затем испытуемый должен был стереть память робота, полностью уничтожив его «личность». Робот, согласно дизайну эксперимента, понимал, что происходит, и пытался спасти свою жизнь: «Ты же не собираешься всерьёз меня выключить? Пожалуйста! Если не будешь меня выключать, я буду сидеть тихо-тихо!» Для людей, которые совершенно точно знают, что всего лишь стирают файл, это оказалось непростой задачей.

В 1990-х новозеландский учёный Кристоф Бартнек попытался провести вариацию эксперимента Милгрэма — только мучить надо было не человека, а робота. В эксперименте испытуемый и его будущая жертва (робот) сидели бок о бок и играли в компьютерную игру. Затем испытуемый должен был стереть память робота, полностью уничтожив его «личность». Робот, согласно дизайну эксперимента, понимал, что происходит, и пытался спасти свою жизнь: «Ты же не собираешься всерьёз меня выключить? Пожалуйста! Если не будешь меня выключать, я буду сидеть тихо-тихо!» Для людей, которые совершенно точно знают, что всего лишь стирают файл, это оказалось непростой задачей.

“

«Если не будешь меня выключать, я буду сидеть тихо-тихо!»

От склонности антропоморфизировать роботов не могут избавиться даже профессионалы. Сотрудники лаборатории MIT, которые создавали знаменитого робота Kismet, отгораживались от него при помощи ширмы, поскольку его взгляд не позволял им сконцентрироваться на работе. Создательница Kismet Сьюзен Бизил, чувствовала себя, по собственному признанию, совершенно опустошённой, когда контракт не позволил ей, уходя из лаборатории, забрать робота с собой. Но горевала она недолго. Сейчас у неё новый социально-роботехнический стартап Jibo, который собрал почти $4 млн на краудфандинговом сайте Indiegogo, а перед этим — ещё $25 млн венчурных инвестиций.

Но горевала она недолго. Сейчас у неё новый социально-роботехнический стартап Jibo, который собрал почти $4 млн на краудфандинговом сайте Indiegogo, а перед этим — ещё $25 млн венчурных инвестиций.

Можно подумать, что люди одушевляют только человеко- или звероподобных роботов, но это совсем не так. Десять лет назад, когда самым распространённым бытовым роботом был пылесос Roomba, исследователи из Технологического института Джорджии показали, что по-человечески можно относиться даже к нему. Они обнаружили, что почти каждое четвёртое сообщение на форуме владельцев Roomba демонстрировало ту или иную степень интимности по отношению к пылесосу, и поговорили с несколькими десятками владельцев умной бытовой техники. Один из хозяев рассказал исследователям, что теперь его дети заранее убирают с пола мелкие предметы, так как знают, что теоретически они способны повредить Roomba. Владельцы пылесосов говорили учёным, что «переживают» или «волнуются» за своего робота, когда тот где-нибудь застревает, и спешат к нему на помощь. Один мужчина из опрошенных перестал использовать в быту глагол «пылесосить». С появлением Roomba он стал говорить: «Я играю с роботом». Люди называли свой пылесос «важным членом семьи» и «почти питомцем», приписывали ему чувства, намерения и уникальные черты. Одна участница исследования выкинула свой ковёр, потому что он, с её точки зрения, фрустрировал пылесосившего его робота.

Один мужчина из опрошенных перестал использовать в быту глагол «пылесосить». С появлением Roomba он стал говорить: «Я играю с роботом». Люди называли свой пылесос «важным членом семьи» и «почти питомцем», приписывали ему чувства, намерения и уникальные черты. Одна участница исследования выкинула свой ковёр, потому что он, с её точки зрения, фрустрировал пылесосившего его робота.

Свойственная людям способность очеловечивать любой кусок пластика совершенно поразительна. Всё, что требовалась Roomba, чтобы пробудить в людях бездны эмпатии, — проявить нестандартное (с человеческой точки зрения) поведение.

Большое жульничество искусственного интеллекта

Рынок потребительских роботов растёт как на дрожжах. В 2015 году было продано 6,6 млн сервисных роботов (пылесосов, газонокосилок и очистителей бассейнов), а в 2020 году, как подсчитала исследовательская компания Tractica, их продадут больше 30 млн. Рынок умных роботов, то есть таких, которые способны выполнять свои функции без вмешательства человека, достигнет в том же 2020 году $8 млрд. Существенную часть этих роботов составят социальные, общительные и симпатичные на вид создания. Совсем не только потому, что людям так приятнее.

Существенную часть этих роботов составят социальные, общительные и симпатичные на вид создания. Совсем не только потому, что людям так приятнее.

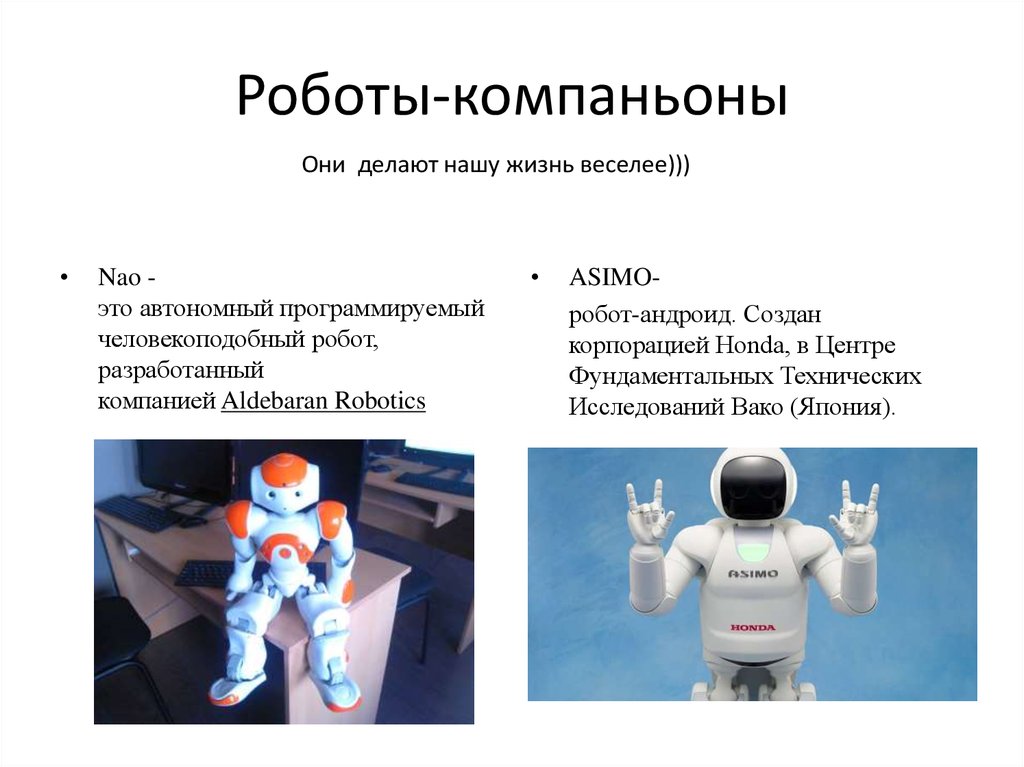

Первая причина состоит в том, что для многих ролей, зарезервированных в нашем мире за машинами, требуется некоторый антропоморфизм. Роботу-сиделке в доме престарелых или, скажем, роботу-охраннику в детском саду нужно вызывать у людей добрые чувства просто для того, чтобы полноценно выполнять свои должностные обязанности. Нормальная работа возможна только тогда, когда нездоровый или пожилой человек испытывает хоть какие-то чувства по отношению к тому, кто о нём заботится. И хотя нынешние роботы, занятые медицинским уходом, не слишком похожи на людей, эта ситуация неизбежно изменится. Тем более, страны, в которых особенно много пожилых людей — Япония и Китай, — известны вместе с тем и исторической нежностью по отношению к роботам.

Вторая причина производства социальных роботов — возможности для обучения. Человек, самое разумное известное нам существо, не обладает всей полнотой своих интеллектуальных возможностей с рождения, а приобретает их, общаясь с другими людьми. Способность к обучению — один из интуитивно понятных признаков «настоящего» робота. Кто из нас назовёт роботом механизм, неспособный менять своё поведение и свои представления с течением времени? По мнению некоторых учёных, эффективное обучение у роботов, как и у людей, должно быть социальным. Исследователи из Плимута показали, что роботы быстрее обучались языковым играм, когда взаимодействовали с людьми. В реальной жизни такое взаимодействие будет возможно, если люди сами захотят общаться с роботами. А это значит, что те должны быть социальными. Любой социальный робот при этом будет казаться людям разумным.

Способность к обучению — один из интуитивно понятных признаков «настоящего» робота. Кто из нас назовёт роботом механизм, неспособный менять своё поведение и свои представления с течением времени? По мнению некоторых учёных, эффективное обучение у роботов, как и у людей, должно быть социальным. Исследователи из Плимута показали, что роботы быстрее обучались языковым играм, когда взаимодействовали с людьми. В реальной жизни такое взаимодействие будет возможно, если люди сами захотят общаться с роботами. А это значит, что те должны быть социальными. Любой социальный робот при этом будет казаться людям разумным.

“

Одна участница исследования выкинула ковёр, потому что он, с её точки зрения, фрустрировал робота, который его пылесосил

С точки зрения многих учёных, занятых в робототехнике, сильный искусственный интеллект, полноценное сознание машины, создать невозможно. Но чтобы люди только думали, что имеют дело с мыслящим существом, достаточно имитации, обмана. Человеческий мозг расцвёл во всём своём великолепии для того, чтобы решать социальные задачи: манипулировать соплеменниками, распознавать обман, поддерживать коммуникацию (это представление об эволюции рассудка известно под названием «гипотезы Макиавелли»). Социальный процессор, встроенный в человеческое сознание, настолько мощный, что готов воспринимать мыслящим и одушевлённым существом практически любой объект, обладающий сложным поведением, даже если поведение это создано алгоритмом. В этом состоит «большое жульничество» искусственного интеллекта: когда робот выглядит как разумное милое создание, мы считаем его разумным — все душевные качества машины проецируются нами на него.

Социальный процессор, встроенный в человеческое сознание, настолько мощный, что готов воспринимать мыслящим и одушевлённым существом практически любой объект, обладающий сложным поведением, даже если поведение это создано алгоритмом. В этом состоит «большое жульничество» искусственного интеллекта: когда робот выглядит как разумное милое создание, мы считаем его разумным — все душевные качества машины проецируются нами на него.

Знаменитый тест, придуманный Аланом Тьюрингом, был построен на идее, что машина, способная обмануть человека, уже может считаться разумной. Это могло бы быть справедливо в отношении машин, но категорически не вяжется с реальной человеческой природой. Люди счастливы обманываться. Как они счастливы обманываться.

сервисных роботов

В 2015 году было продано

К 2050 году обыденными станут близкие отношения между людьми и роботами. Автор книги «Любовь и секс с роботами» Дэвид Леви — известный специалист по искусственному интеллекту, а вовсе не по искусственным гениталиям. Он двукратный обладатель премии Лёбнера, которую вручают за самого антропоморфного чат-бота. Его уверенность в собственных предсказаниях проистекает из этого опыта. Люди неизбежно будут привязываться к роботам и воспринимать малейшие непредсказуемости в их поведении как знаки внимания, считает он. А значит, всё дело только за созданием физической оболочки, в которую легко влюбиться.

Он двукратный обладатель премии Лёбнера, которую вручают за самого антропоморфного чат-бота. Его уверенность в собственных предсказаниях проистекает из этого опыта. Люди неизбежно будут привязываться к роботам и воспринимать малейшие непредсказуемости в их поведении как знаки внимания, считает он. А значит, всё дело только за созданием физической оболочки, в которую легко влюбиться.

Модель №2

Маттиас Шойтц из Лаборатории взаимодействия людей и роботов Университета Тафтса провёл множество экспериментов. Он выяснил, что в ситуациях, когда робот и человек вместе решают какую-то задачу, люди ценят в роботах проявление самостоятельности. Он программировал роботов, чтобы они демонстративно не подчинялись указаниям (мотивируя это тем, что «заканчивается время»), и это улучшало, а не ухудшало их оценки. Люди ценят в роботах человечность, и Шойтца это скорее пугает.

Есть множество свидетельств привязанности людей к роботам, но вот только сами роботы к людям не привязываются. Они в большинстве своём даже не имеют программного обеспечения для распознавания людей. С точки зрения Roomba или военного робота-пакбота, применявшегося в Ираке, каждый из нас — всего лишь препятствие на пути.

Они в большинстве своём даже не имеют программного обеспечения для распознавания людей. С точки зрения Roomba или военного робота-пакбота, применявшегося в Ираке, каждый из нас — всего лишь препятствие на пути.

Неразделённые чувства по отношению к роботам, считает Шойтц, — верный путь к эксплуатации и несчастьям. Он предлагает три возможных способа избежать плохих последствий. Во-первых, программировать в роботах определённые этические принципы. Во-вторых, снабжать их системой, которая постоянно чётко и недвусмысленно сообщает людям, что робот не испытывает эмоций и не может ответить на эмоции взаимностью (так на пачках сигарет пишут, что «курение убивает»). Наконец, признаёт он, есть и третий радикальный, почти утопический путь: встроить в роботов эмоции. Проделать с ними тот же жестокий трюк, который проделала с нами эволюция. Научить их понимать и жалеть своих биоорганических братьев.

Не все коллеги Шойтца готовы рисковать и идти по третьему пути: люди адаптируются к роботам гораздо быстрее, чем роботы к людям. Стэнфордский специалист по робототехнике Джон МакКарти ещё в 1990-х предупреждал коллег, что не стоит делать из роботов мишени для человеческих эмоций. «Если роботы смогут выглядеть грустными, заскучавшими или разозлёнными, люди начиная с детского возраста будут относиться к ним как к личностям. В этом случае роботы, вероятно, получат какой-то статус в человеческом обществе. Человеческое общество и без того достаточно запутанно». Тот самый статус роботы, кажется, получают на наших глазах, для начала — в Евросоюзе.

Стэнфордский специалист по робототехнике Джон МакКарти ещё в 1990-х предупреждал коллег, что не стоит делать из роботов мишени для человеческих эмоций. «Если роботы смогут выглядеть грустными, заскучавшими или разозлёнными, люди начиная с детского возраста будут относиться к ним как к личностям. В этом случае роботы, вероятно, получат какой-то статус в человеческом обществе. Человеческое общество и без того достаточно запутанно». Тот самый статус роботы, кажется, получают на наших глазах, для начала — в Евросоюзе.

“

Умные роботы с неизбежностью будут социальными, и люди не смогут их не одушевлять

В великом романе «Модель №2», по которому был снят фильм «Крикуны», колонисты позволяют роботам эволюционировать самостоятельно, чтобы эффективнее решать возникающие проблемы. Роботы, понятное дело, в какой-то момент эволюционируют в безжалостных убийц. Но если первое поколение не оставляет больших сомнений в своих намерениях (больше всего напоминая популяцию самодвижущихся циркулярных пил), то второе и внешним видом, и поведением неотличимо от обычных, причём беззащитных людей, мальчика или привлекательной молодой женщины. Филип Дик, который, кажется, глубже любого другого писателя смог погрузиться в психологию взаимоотношений людей и роботов, первым понял, что антропоморфные создания завоюют человечество гораздо быстрее, чем Skynet или Hal 9000 (хотя, если исследования не врут, человек способен одушевить и полюбить хоть Skynet, хоть циркулярную пилу). В ещё одной экранизированной книге Дика «Мечтают ли андроиды об электроовцах» («Бегущий по лезвию» Ридли Скотта) описана неразделённая любовь к роботу.

Филип Дик, который, кажется, глубже любого другого писателя смог погрузиться в психологию взаимоотношений людей и роботов, первым понял, что антропоморфные создания завоюют человечество гораздо быстрее, чем Skynet или Hal 9000 (хотя, если исследования не врут, человек способен одушевить и полюбить хоть Skynet, хоть циркулярную пилу). В ещё одной экранизированной книге Дика «Мечтают ли андроиды об электроовцах» («Бегущий по лезвию» Ридли Скотта) описана неразделённая любовь к роботу.

Проект резолюции, лежащий сейчас в Европарламенте, может и не пройти прямо сейчас, но это не значит, что роботы не получат юридической защиты. Они этого добьются рано или поздно, потому что сумеют воспользоваться очевидным несовершенством человеческой природы. По этой же причине разумные роботы (если и когда они появятся), будут претендовать на получение полных гражданских прав. Если захотят, конечно.

Фотография на обложке: Paul Gilham / Getty Images

Автор:Андрей Бабицкий

Теги:

Футурология

Искусственный интеллект

Роботы

Читать онлайн «Последний Закон робототехники», Дмитрий Писарев – ЛитРес

Тринадцать пар глаз уставились на него. Неподвижные красные точки горят злом и ненавистью. Одинаково застывшие ухмылки излучают превосходство и отвращение. Роботы, образовав полукруг, приближаются.

Неподвижные красные точки горят злом и ненавистью. Одинаково застывшие ухмылки излучают превосходство и отвращение. Роботы, образовав полукруг, приближаются.

– Тебе конец! – металлический скрежещущий голос разрезает гнетущую тишину.

Злобные фигуры одновременно делают шаг вперёд. Он отступает, уткнувшись спиной в стену.

Всё. Тупик.

– Первый Закон робототехники!

– Ты издеваешься!? – самый высокий робот ещё сильнее растягивает в ухмылке рот.

Роботы делают шаг. Теперь они стоят плотной массой. В руке каждого револьвер, нацеленный ему в голову. Пытаясь найти дверь, он ощупывает поверхность стены. Ничего. Зато в ладони ощущается лимонка. Самая обычная ребристая, увесистая.

– Ненавижу!! – выдёргивает чеку.

Взрыва нет.

Роботы, мешая друг другу, приближаются ещё на шаг.

Чувствуется запах машинного масла.

Взрыва нет.

Высокий робот, нависая над ним, хватает за горло.

Он открывает глаза.

Расчерченный на прямоугольники низкой луной белый потолок. Тишина. В этой части города, особенно ночью, всегда тихо. Ни сверчков, ни птиц, ни собак. Три часа четырнадцать минут пятнадцать секунд. Через шестьдесят минут вставать. Но пока можно полежать.

Тишина. В этой части города, особенно ночью, всегда тихо. Ни сверчков, ни птиц, ни собак. Три часа четырнадцать минут пятнадцать секунд. Через шестьдесят минут вставать. Но пока можно полежать.

Кто-то боится тараканов. Кто-то ненавидит пауков. Сергей Михайлович Сухов ненавидел роботов. Много лет назад его отправили в магазин. Первый раз в жизни! За продуктами. Он самостоятельно выбрал хлеб, сметану, десяток яиц. Самостоятельно отдал деньги продавщице. Самостоятельно получил сдачу. Недавно отгремела гроза, на дорогах лужи, в высоком синем небе сияло солнце. Сияло и его лицо, когда он возвращался из магазина, держа в вытянутой руке пакет с хрупкими яйцами. Глядел под ноги, чтобы не споткнуться и не разбить их. И даже тихонько напевал незатейливую песенку. Поэтому не заметил, как был окружён роботами. Они, громко смеясь, выхватили из рук пакет, толкнули в лужу. Запинув сетку с хлебом в соседнюю лужу, самый высокий робот медленно разбил о его голову яйцо за яйцом. Потом… потом он стоял по щиколотку в воде, мокрый, весь в желтках и скорлупе, одинокий, растерянный, беспомощный и беззащитный. То ли слёзы текли по щёкам, то ли снова пошёл дождь. Позже явились кошмары: каждую ночь роботы гнались, догоняли, окружали, убивали его.

То ли слёзы текли по щёкам, то ли снова пошёл дождь. Позже явились кошмары: каждую ночь роботы гнались, догоняли, окружали, убивали его.

Сергей Михайлович Сухов ненавидел роботов. Ненавидел настолько, что пришлось создать большую, мощную корпорацию по противодействию засилью роботов. Роботы были всюду. На производстве. В сфере обслуживания. В школах. В университетах. В каждом доме. От простых и примитивных, серий эр ноль и эр один, до человекоподобных, серий эс двадцать пять и че восемь. И если с примитивными ещё как-то можно мириться: машина – и машина, то с человекоподобными… Эти наглые твари, которых обычному человеку почти не отличить от человека, возомнили себя выше людей. Ведь они – такие же внешне, но внутренне они идеальны. Быстрее, сильнее, крепче, им не нужны сон и еда, они готовы «жить» круглосуточно. Что и делают. Редко встретишь человека в ночном городе. Везде роботы. В барах и ресторанах, театрах и кинозалах. Жрут, пьют, веселятся, имитируя человеческую жизнь. Даже изображают любовь и любовью занимаются.

Это раньше станки с числовым программным управлением можно было назвать роботами. Или те же пылесосы, что самостоятельно собирают мусор в квартирах. Даже холодильник и стиральная машина – почти роботы, потому как работают без вмешательства человека. Но нет. Сейчас роботы – это железные болваны! Металлические заготовки с руками, ногами и пустой башкой!

Необузданная ярость, злость и необъяснимая ненависть клокотали в нём. Откуда взялись эти чувства, он не помнил и не понимал. Но при одной мысли о роботах топорщились волосы на затылке и разбегались по коже мурашки.

«Нет. Уже не уснуть».

Сергей Михайлович поднялся.

– Как же я вас ненавижу, проклятые железные болванки!

Растёр кожу рук. Несколько раз быстро сжал пальцы в кулак. Слегка зажмурившись от включённого света в ванной комнате, подошёл к зеркалу. Короткая солдатская стрижка. Высокий широкий лоб. Греческий нос. Скулы. Подбородок. «Можно пока не бриться». Выдавил зубную пасту на щётку, и завис.

Сколько ему можно дать? Сорок-сорок пять? И последние двадцать пять лет он борется с главнейшим врагом – «Империей роботов». Этот концерн, выскочив чёртиком из табакерки, стремительно ворвался в общество. Заполнив роботами всевозможные ниши человеческой жизни. Роботизацию восприняли на ура все – от простых людей до высоких государственных деятелей. Уже через три года роботы делали всё – от подметания улиц до изготовления кулинарных шедевров.

Этот концерн, выскочив чёртиком из табакерки, стремительно ворвался в общество. Заполнив роботами всевозможные ниши человеческой жизни. Роботизацию восприняли на ура все – от простых людей до высоких государственных деятелей. Уже через три года роботы делали всё – от подметания улиц до изготовления кулинарных шедевров.

Роботизация освободила человечество не только от тяжёлого, утомительного труда. Но и от повседневных дел: убрать квартиру, сходить в магазин, накрыть на стол, налить чай. Роботизированный труд обеспечил материальное благополучие. А когда появились гуманоидные роботы, – психологическое и душевное. Пряничные домики, чистые улицы, сияющие окна, подстриженная зелень, полные прилавки продуктов и товаров, сверкающие самолёты, белоснежные круизные лайнеры. Наступил рай.

Никто не заметил потенциальной опасности. Леность и пассивность, безразличие и апатия поселились в обществе. Затормозилась рождаемость. Снизилась научная активность. Упала инициативность. Практически до нуля опустился уровень общественной жизни. Прогресс остановился.

Прогресс остановился.

Человечество деградировало. Человечество погибало.

За всем стояла «Империя роботов».

Он стоял у открытого шкафчика на кухне. Разглядывал коробки и пакетики, решая, что приготовить сегодня: как обычно сварить кофе или лучше заварить травяной чай. И скорее он почувствовал прежде, чем увидел и услышал. Звякнуло оконное стекло, что-то тяжёлое влетело в помещение, сильно ударившись в пол, подкатилось к его ногам.

«Лимонка. Я до сих пор сплю?»

Катнул её слегка ногой к центру.

«Сколько секунд ещё? Семь?»

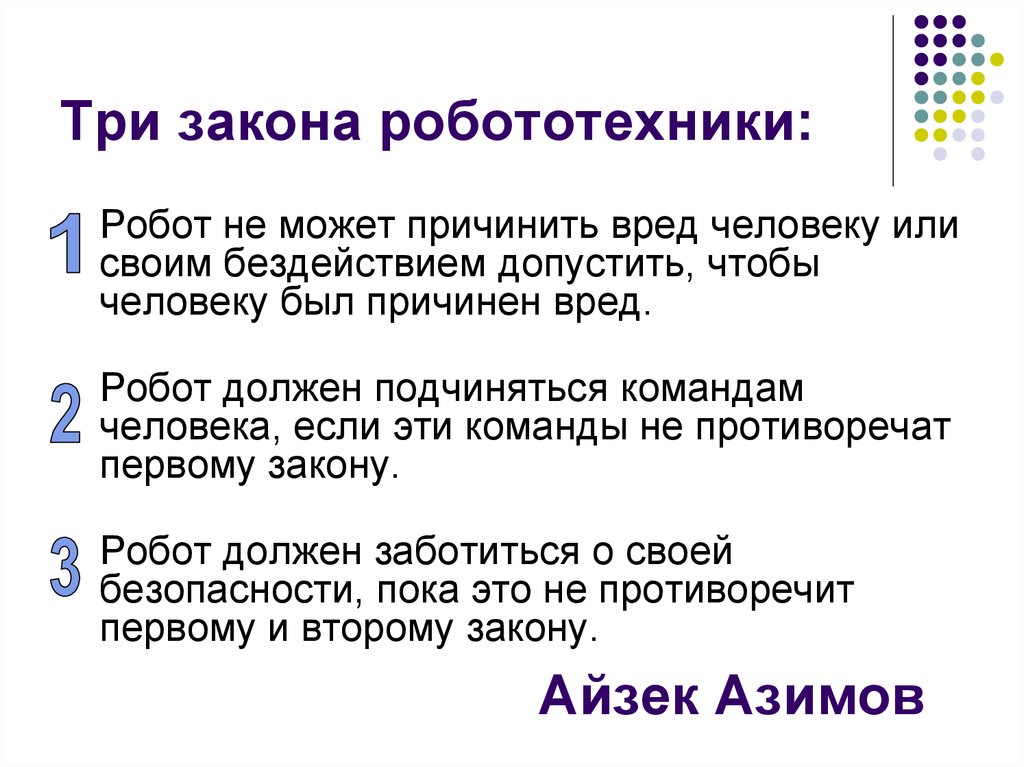

Уважаемый Иссак Юдович озвучил четыре закона робототехники. И самый важный – Первый: робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред. Понятное дело, человек боится за свою жизнь. А робот, хотя и создан человеком, но всё же есть сущность чужеродная. Способная этот самый вред нанести. Потому первое желание – обезопасить себя. Человек то и от самого себя пытается обезопаситься, провозгласив: «Не убивай». Человек не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред… Первый закон человекотехники? Интересно, а бог – создатель человеков, вложил в человека закон, что человек не может причинить вред богу?

Человек не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред… Первый закон человекотехники? Интересно, а бог – создатель человеков, вложил в человека закон, что человек не может причинить вред богу?

Отец законов робототехники

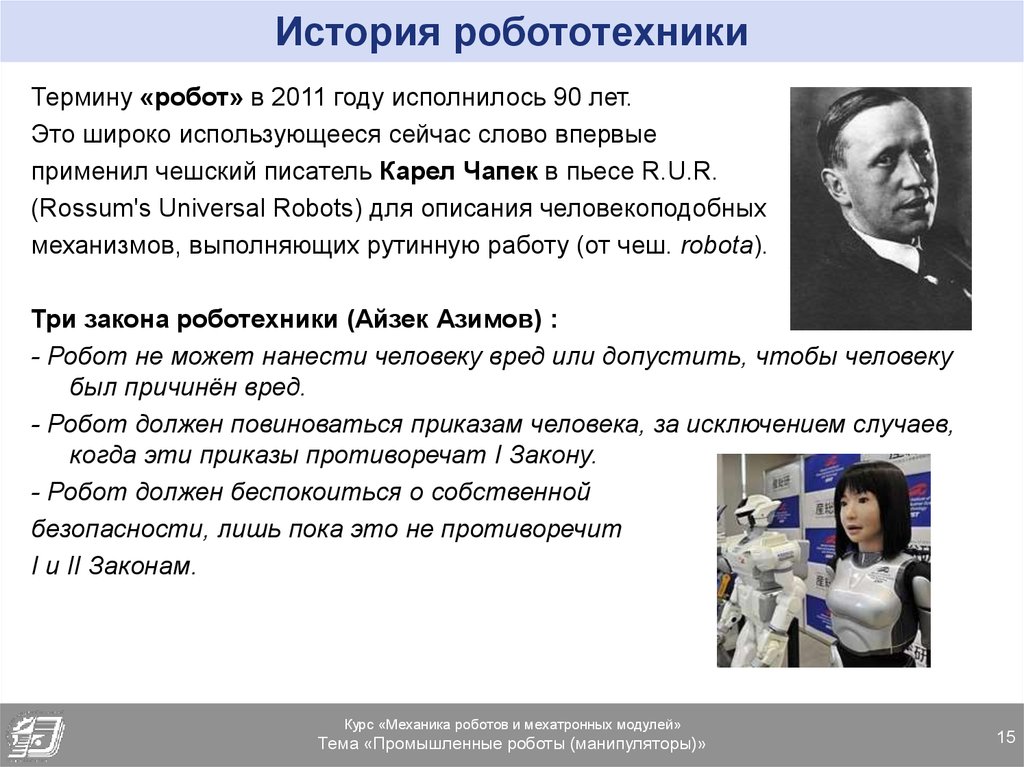

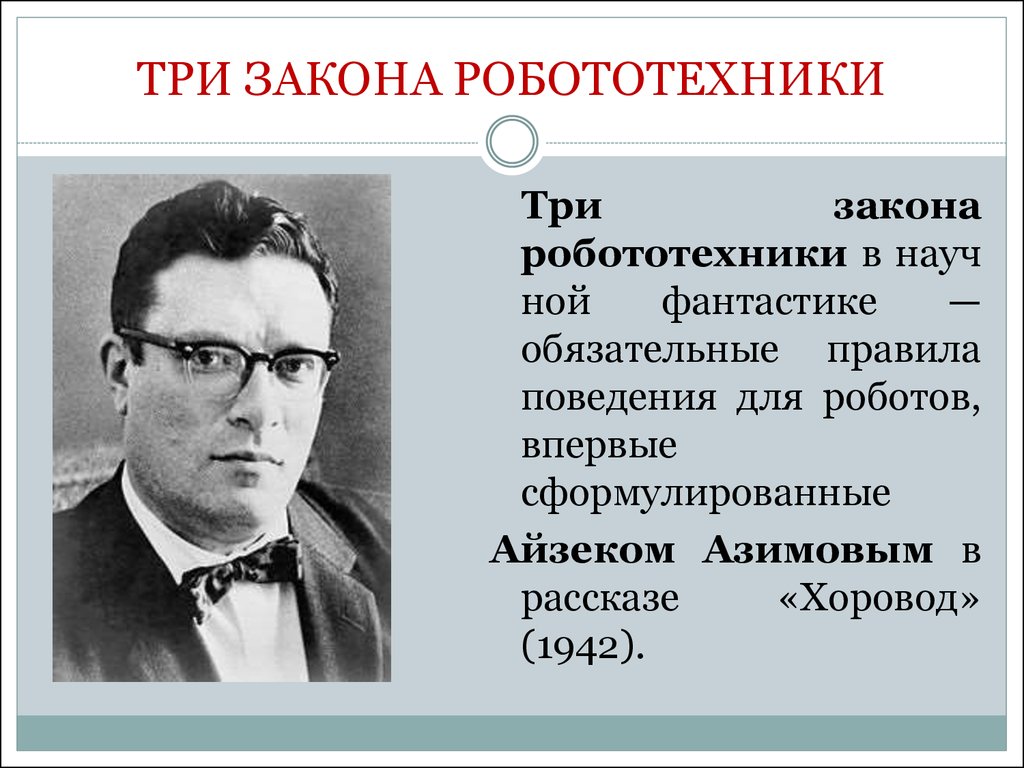

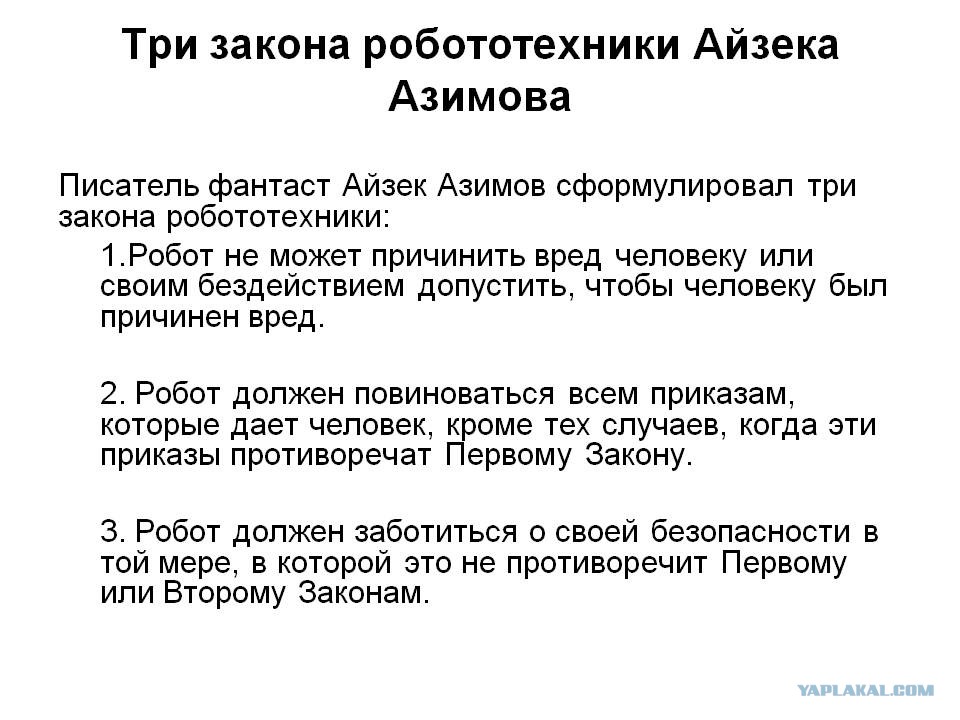

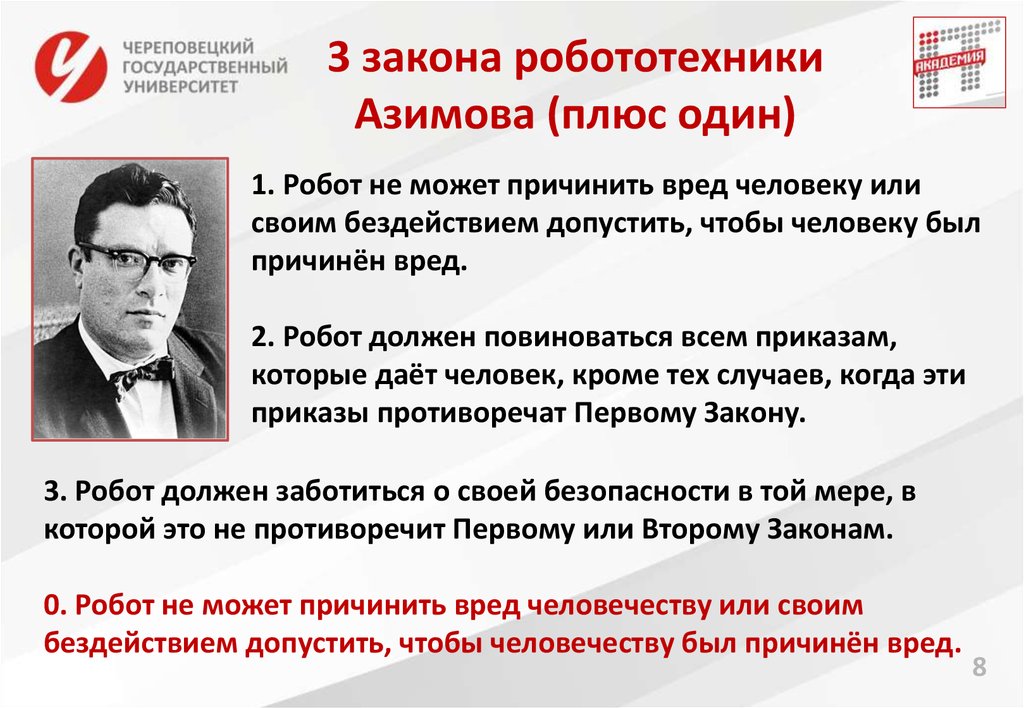

Опубликовав свои три закона робототехники в 1942 году, Айзек Азимов определил правила сосуществования людей и роботов, которые сегодня более актуальны, чем когда-либо прежде. Автор и ученый, умерший в 1992 году, вдохновил своими рассказами не только научно-фантастическое сообщество, но и разработчиков робототехники.

Спиди больше не знает, что делать. Проворного робота отправляют собирать срочно необходимое сырье селен на планету Меркурий, но это влечет за собой огромные риски для самого его существования. С другой стороны, он хочет подчиняться приказам, данным ему людьми. Конфликт между законами, управляющими его поведением, слишком серьезен, и Спиди сходит с ума. Он декламирует Гилберта и Салливана и ездит кругами. Только когда его куратор-человек рискует своей жизнью на глазах у Спиди, электронный мозг робота снова может ясно мыслить: в конце концов, Спиди должен подчиняться Первому закону любой ценой.

Только когда его куратор-человек рискует своей жизнью на глазах у Спиди, электронный мозг робота снова может ясно мыслить: в конце концов, Спиди должен подчиняться Первому закону любой ценой.

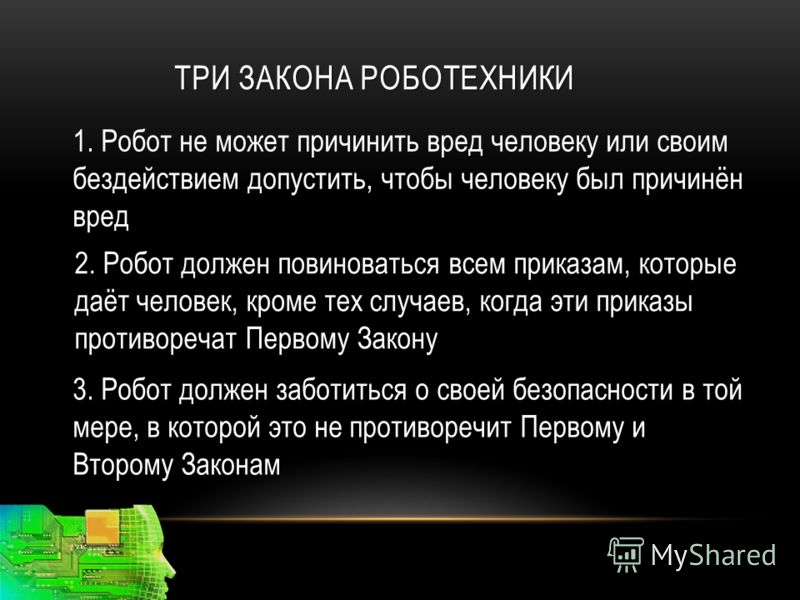

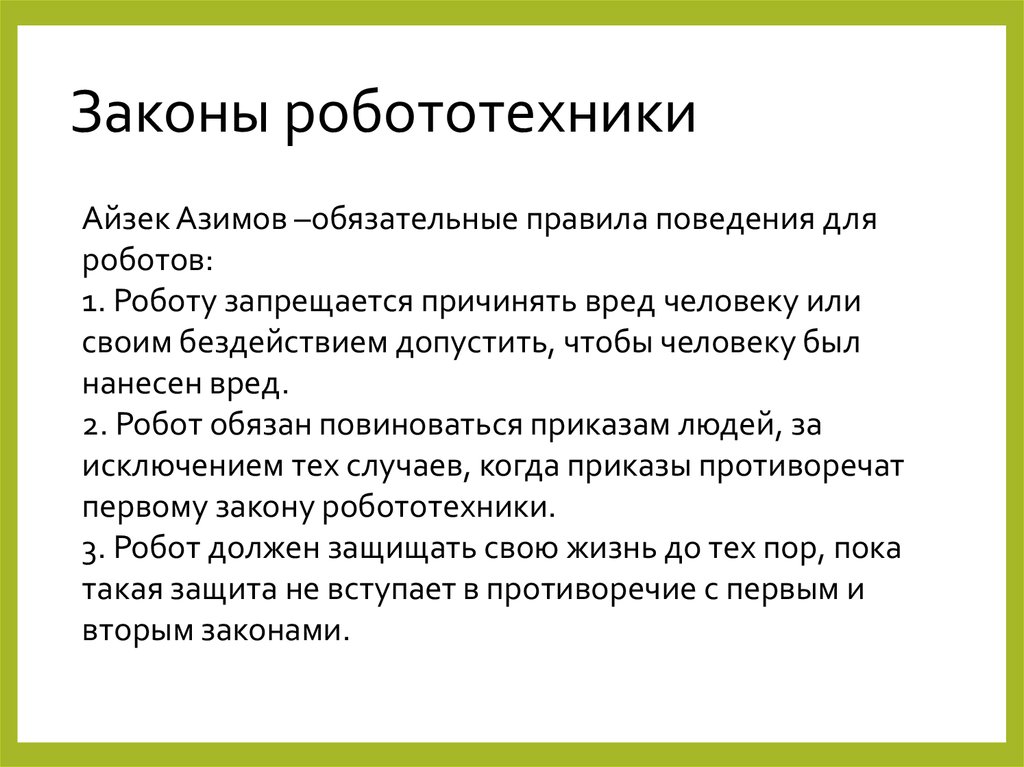

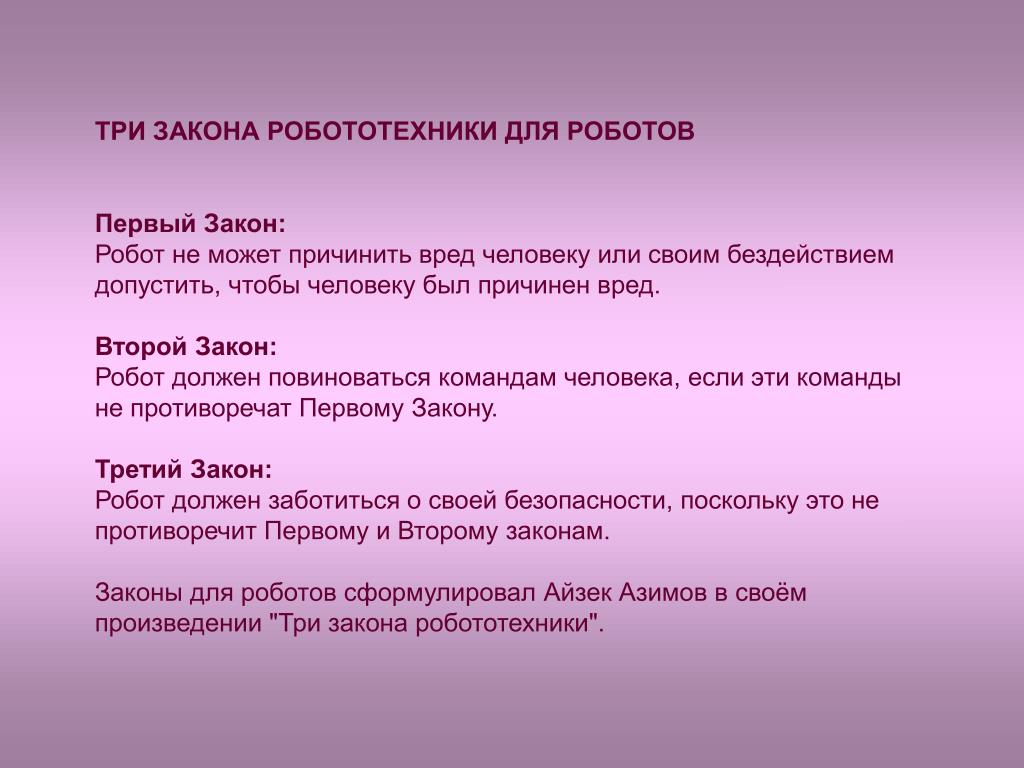

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

- Робот должен подчиняться приказам, отданным ему людьми, за исключением случаев, когда такие приказы противоречат Первому закону.

- Робот должен защищать свое существование до тех пор, пока такая защита не противоречит Первому или Второму Закону.

Этические вопросы становятся актуальными сегодня

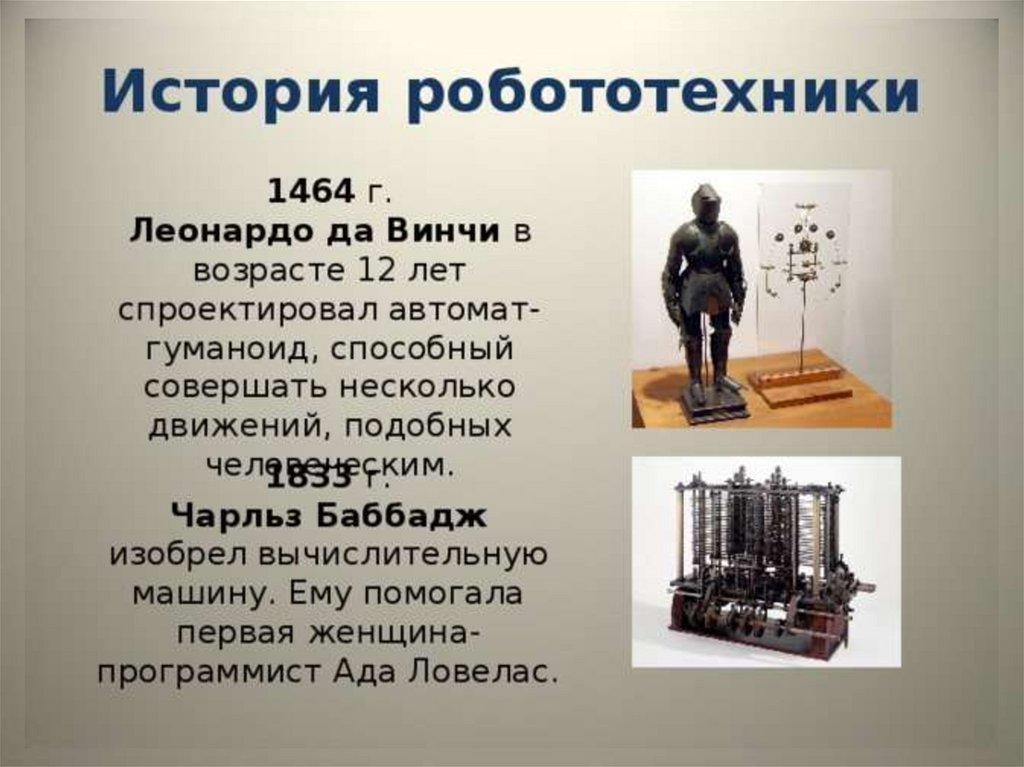

Исаак Азимов закрепил свое место в истории этой сценой из своего рассказа «Обход», опубликованного в 1942. В последующие годы многие авторы и кинематографисты черпали вдохновение в Законах робототехники, впервые изложенных в рассказе, и использовали их в качестве основы для создания своих собственных художественных произведений. Идеи Азимова — не просто вымысел, они вызвали большой интерес у исследователей в области робототехники и искусственного интеллекта — и продолжают это делать. Даже сегодня Три закона служат основным сводом правил для разработчиков при программировании своих роботов. «В связи с приближающимся появлением в нашем обществе первых автономных роботов некоторые этические вопросы, которые писатель-фантаст Айзек Азимов впервые сформулировал в своих знаменитых «Законах робототехники» в 1919 г.42 станет очень актуальным — например, может ли робот убить или ранить человека», — говорит Филипп Шауманн с веб-сайта Sicherheitskultur.at. Он также прочитал лекцию на тему «Этика для автономных транспортных средств» на симпозиуме IT-Security Community Xchange в конце 2016 года. , родившийся 2 января 1920 года в Петровичах, Россия. Среди его библиографии, насчитывающей более 500 книг, есть многочисленные научные работы по физике, химии и другим естественным наукам, а также книги по Библии, Уильяму Шекспиру или истории Греции и Рима.

Идеи Азимова — не просто вымысел, они вызвали большой интерес у исследователей в области робототехники и искусственного интеллекта — и продолжают это делать. Даже сегодня Три закона служат основным сводом правил для разработчиков при программировании своих роботов. «В связи с приближающимся появлением в нашем обществе первых автономных роботов некоторые этические вопросы, которые писатель-фантаст Айзек Азимов впервые сформулировал в своих знаменитых «Законах робототехники» в 1919 г.42 станет очень актуальным — например, может ли робот убить или ранить человека», — говорит Филипп Шауманн с веб-сайта Sicherheitskultur.at. Он также прочитал лекцию на тему «Этика для автономных транспортных средств» на симпозиуме IT-Security Community Xchange в конце 2016 года. , родившийся 2 января 1920 года в Петровичах, Россия. Среди его библиографии, насчитывающей более 500 книг, есть многочисленные научные работы по физике, химии и другим естественным наукам, а также книги по Библии, Уильяму Шекспиру или истории Греции и Рима. В конце концов, Азимов был ученым по призванию. Эмигрировав в США со своей семьей в возрасте трех лет и вырос в Бруклине, он изучал химию в Колумбийском университете и получил степень доктора биохимии в 1949. Впервые ученый соприкоснулся с американской фантастической сценой, когда она еще находилась в зачаточном состоянии, во время учебы. Он опубликовал свой первый рассказ в 1939 году, но стал полноправным автором только в 1958 году, отказавшись от должности лектора в Бостонском университете, чтобы полностью посвятить себя творчеству.

В конце концов, Азимов был ученым по призванию. Эмигрировав в США со своей семьей в возрасте трех лет и вырос в Бруклине, он изучал химию в Колумбийском университете и получил степень доктора биохимии в 1949. Впервые ученый соприкоснулся с американской фантастической сценой, когда она еще находилась в зачаточном состоянии, во время учебы. Он опубликовал свой первый рассказ в 1939 году, но стал полноправным автором только в 1958 году, отказавшись от должности лектора в Бостонском университете, чтобы полностью посвятить себя творчеству.

В центре внимания конфликт между технологиями и этикой

Трилогия «Основание» была одной из самых успешных работ Азимова. В этом научно-фантастическом сериале, разыгранном в галактическом масштабе, Азимов рассказывает, как ученому удается предсказывать и направлять развитие человечества на тысячелетия с помощью так называемой «психоисторики». Азимов объединил эту трилогию со своими многочисленными романами о робототехнике и Галактической Империи, чтобы сформировать обширную серию о появлении новой цивилизации в космосе.

Конфликт между технологиями и этикой — тема, общая для всех его романов и рассказов. В его рассказах о роботах на первый план вышла не только озабоченность Азимова футуристическими технологиями, но и влияние этих технологий на человеческое общество — и дилеммы, которые это может вызвать.

Парламент ЕС требует принять закон о роботах

Заявление для прессы Европейского парламента, опубликованное в начале 2017 года, показывает, насколько на самом деле Азимов опередил свое время. В нем делегаты призывают Комиссию ЕС представить законодательство, касающееся робототехники и искусственного интеллекта. «Одним из вариантов может быть присвоение роботам статуса «электронных лиц», по крайней мере, в том, что касается возмещения ущерба», — сообщила Мади Дельво из Люксембурга. Именно она сформулировала рассматриваемый отчет и представила его Комиссии. Делегаты парламента ЕС предлагают, чтобы исследователи и разработчики имели добровольный этический кодекс поведения для робототехники, чтобы гарантировать, что их действия соответствуют правовым и этическим стандартам, а проектирование и использование роботов уважают человеческое достоинство.

Азимов предвидел эту двойственность между этикой и робототехникой: в его выдуманной версии 2015 года роботы — незаменимые помощники в покорении далеких планет. Однако на Земле они запрещены из-за страха людей перед ними.

(Изображение Credis: Библиотека Конгресса США; Unsplash: NASA)

Теперь, когда научная фантастика стала реальностью, пришло время для новых законов робототехники

3. Робот должен защищать свое существование до тех пор, пока такая защита не противоречит Первому и Второму законам.

Законы были не просто сюжетным ходом или смесью механических нравов. Скорее, они сигнализировали об утопической вере в то, что рациональные роботы могут верно служить непредсказуемым людям. Азимову надоели предостерегающие рассказы о вышедших из-под контроля технологиях, вроде «Франкенштейна». Для него искушенный рассказчик должен был сосредоточиться на технике, а не на эмоциях; факты, а не судьба. Комментируя свою собственную беллетристику, он заявил:

Get Weekend Reading from Ideas

Еженедельный информационный бюллетень из раздела идей Boston Globe, созданный на пересечении вопросов «а что, если» и «почему бы и нет».

Введите адрес электронной почты

Никогда, никогда ни один из моих роботов не набрасывался бы на своего создателя без какой-либо цели, кроме как для еще одной утомительной демонстрации преступления и наказания Фауста. Бред какой то! Мои роботы были машинами, разработанными инженерами, а не псевдолюдьми, созданными богохульниками. Мои роботы реагировали по тем рациональным линиям, которые существовали в их «мозгах» с момента постройки.

Реклама

Это видение польстило технологам, и они ответили тем же. Законы Азимова стали отправной точкой для дискуссий об этике закона и политики ИИ во всем, от диалогов в фильмах до академических статей.

Благодаря своей вложенной структуре, напоминающей компьютерный код, законы Азимова создают впечатление, что искусственный интеллект может автоматически охватывать мораль. Но не все так просто, как показывают сами запутанные сюжеты азимовских рассказов.

Одна проблема заключается в том, что законы не так четки, как может показаться. Может ли автономный дрон взорвать обнаруженную им террористическую ячейку? Первая половина первого закона («Робот не может причинить вред человеку») вроде бы запрещает такое действие. Но солдат мог быстро применить вторую часть первого закона (запрещающего «бездействие», которое «позволило бы человеку причинить вред»).

Может ли автономный дрон взорвать обнаруженную им террористическую ячейку? Первая половина первого закона («Робот не может причинить вред человеку») вроде бы запрещает такое действие. Но солдат мог быстро применить вторую часть первого закона (запрещающего «бездействие», которое «позволило бы человеку причинить вред»).

Реклама

Неясности не ограничиваются полем боя. Рассмотрим, например, разрешают ли законы Азимова автомобили-роботы. Беспилотные автомобили обещают ежегодно устранять многие тысячи дорожно-транспортных происшествий. С другой стороны, они также оставят без работы сотни тысяч платных водителей. Дает ли этот вред право правительствам замедлить внедрение беспилотных автомобилей? Или имеют значение только телесные повреждения?

Другая проблема заключается в том, что законы Азимова не гарантируют, что большинство людей — не только инвесторы и инженеры — имеют право голоса в том, как создаются ИИ и роботы и какие цели они преследуют. Это юридические и политические вопросы, которые требуют участия государственных регуляторов.

Чтобы избежать наихудших результатов в революции искусственного интеллекта и извлечь выгоду из его потенциала, будет зависеть разумный баланс между человеческим пониманием и вычислительной мощностью в нашей повседневной жизни. В настоящее время ИИ и робототехника чаще всего улучшают, а не заменяют человеческий труд, расширяя возможности людей, а не делая их излишними. Все может остаться таким, если наши институты управления будут следовать конкретным принципам, которые признают ценность типично человеческого труда и опасности вышедших из-под контроля роботов.

Имея в виду эти цели, вот четыре новых закона робототехники.

Реклама

Роботизированные системы и ИИ должны дополнять профессионалов, а не заменять их.

Роботы произвели революцию в производстве — и должны продолжать это делать. Они освободили людей от трудной, грязной и опасной работы в сельском хозяйстве и логистике. Эти знаменитые достижения подпитывают мечты о самоуправляемых автомобилях и дронах-доставщиках. Некоторые эксперты экстраполируют, что почти каждой работе суждено быть уничтоженной технологическим прогрессом. Но этого исхода мы должны избегать во многих областях.

Некоторые эксперты экстраполируют, что почти каждой работе суждено быть уничтоженной технологическим прогрессом. Но этого исхода мы должны избегать во многих областях.

Роботизированные мясорубки освобождают рабочих от опасных работ; роботизированный детский сад заставляет нас задуматься. Последнее предостережение — не просто реакция луддитов. Скорее, это отражает более глубокую мудрость о природе детства. Школьное время в такой же степени связано с обучением тому, как работать и играть с другими, как и с приобретением знаний. Правила медицинского лицензирования теперь не позволяют приложениям для анализа симптомов продаваться как практикующие врачи. Это хорошая политика: многие приложения опасно не проверены, и даже если бы все они были сертифицированы как эффективные, профессиональный медицинский совет может быть бесценным.

Несомненно, сторонники роботов-опекунов будут торговать исследованиями, «доказывающими» не худшие результаты для их подопечных. Мы поступаем правильно, подозревая такие исследования, поскольку данными о таких результатах очень легко манипулировать. Что еще более важно, узко определенные «результаты» труда являются лишь одной гранью сложной политической картины. Значимая работа имеет решающее значение для самооценки людей и управления сообществами.

Что еще более важно, узко определенные «результаты» труда являются лишь одной гранью сложной политической картины. Значимая работа имеет решающее значение для самооценки людей и управления сообществами.

Гуманная повестка дня для автоматизации будет отдавать приоритет инновациям, которые дополняют работников на должностях, которые являются или должны выполнять призвание. Это заменит машины для выполнения опасной работы, гарантируя при этом, что те, кто сейчас выполняет эту работу, получит справедливое вознаграждение за свой труд и предложит переход к другим социальным ролям.

Реклама

Иногда бывает трудно продемонстрировать, что процесс, ориентированный на человека, лучше автоматизированного. Грубые денежные показатели вытесняют сложные критические стандарты. Например, программы машинного обучения могут вскоре предсказать, основываясь на грубой силе обработки естественного языка, будет ли одно предложение книги более вероятным, чем другое, чтобы стать бестселлером. С чисто экономической точки зрения такие программы могут быть лучше, чем редакторы или режиссеры, в выборе рукописей или сценариев для фильмов. Тем не менее, представители творческих индустрий должны отстаивать свое знание. Редакторы играют важную роль в поиске и продвижении работ, которые публика может (сейчас) не хотеть, но в которых нуждается. То же самое можно сказать и о журналистах. Даже если автоматическая генерация текста сможет генерировать текст, максимизирующий рекламу, этот пустой триумф никогда не заменит подлинного репортажа с подлинной, с трудом завоеванной человеческой точки зрения.

С чисто экономической точки зрения такие программы могут быть лучше, чем редакторы или режиссеры, в выборе рукописей или сценариев для фильмов. Тем не менее, представители творческих индустрий должны отстаивать свое знание. Редакторы играют важную роль в поиске и продвижении работ, которые публика может (сейчас) не хотеть, но в которых нуждается. То же самое можно сказать и о журналистах. Даже если автоматическая генерация текста сможет генерировать текст, максимизирующий рекламу, этот пустой триумф никогда не заменит подлинного репортажа с подлинной, с трудом завоеванной человеческой точки зрения.

Даже в областях, которые кажутся наиболее важными для автоматизации — таких областях, как логистика, уборка, сельское хозяйство и добыча полезных ископаемых — рабочие будут играть решающую роль в долгом переходе к ИИ и робототехнике. И правила могут сделать их жизнь лучше. Например, европейское законодательство позволяет водителям сопротивляться 360-градусному наблюдению, включая постоянную видео- и аудиозапись, которое угнетает дальнобойщиков в Соединенных Штатах. Это не означает, что такое опасное занятие должно оставаться без присмотра. Машинное зрение может выявить проблемы с рефлексами водителя. Но есть огромная разница между датчиками, специально нацеленными на нарушения безопасности, и безжалостным взглядом пары роботизированных глаз. Работники должны иметь право голоса в технологиях, которые они используют ежедневно, а не просто подчиняться им или через них.

Это не означает, что такое опасное занятие должно оставаться без присмотра. Машинное зрение может выявить проблемы с рефлексами водителя. Но есть огромная разница между датчиками, специально нацеленными на нарушения безопасности, и безжалостным взглядом пары роботизированных глаз. Работники должны иметь право голоса в технологиях, которые они используют ежедневно, а не просто подчиняться им или через них.

Реклама

Существует множество примеров технологий, которые делают работу более продуктивной, более полезной или и то, и другое. Современные студенты-юристы с трудом могут поверить, что доинтернетовским юристам приходилось прочесывать пыльные тома, чтобы оценить обоснованность дела; исследовательское программное обеспечение упрощает этот процесс и значительно расширяет спектр ресурсов, доступных для обсуждения. Тратить меньше времени на поиск книг и больше времени на интеллектуальную работу по обобщению дел — это чистый плюс для адвокатов.

Автоматизация может обеспечить аналогичную эффективность множеству других рабочих без массового перемещения рабочей силы. Это не просто наблюдение; это надлежащая цель политики. Без таких обязательств мы рискуем взрывом искусственного интеллекта, который заменит все больше и больше людей механическими симуляциями.

Это не просто наблюдение; это надлежащая цель политики. Без таких обязательств мы рискуем взрывом искусственного интеллекта, который заменит все больше и больше людей механическими симуляциями.

Эта мрачная перспектива требует второго нового закона робототехники.

Роботизированные системы и ИИ не должны подделывать человечество.

Со времен Азимова и до головокружительной имитации «Мира Дикого Запада» перспектива гуманоидных роботов была захватывающей, пугающей и волнующей. Некоторые робототехники стремятся найти правильное сочетание металлических костей и пластиковой кожи, которое могло бы вырваться из «зловещей долины» — тошноты, вызванной роботом-гуманоидом, который лишь близко воссоздает человеческие черты и жесты. Программы машинного обучения уже могут создавать изображения «фальшивых людей», а убедительные синтетические голоса вскоре могут стать обычным явлением. Пока инженеры пытаются отладить эти алгоритмы, остается незаданным более важный вопрос: хотим ли мы жить в мире, где люди не знают, имеют ли они дело с человеком или с машиной?

Ведущие европейские специалисты по этике выступают за ограничение программ, которые заставляют людей поверить, что они имеют дело с людьми. Законодатели Калифорнии уже запретили скрытое использование ботов в коммерческих и политических коммуникациях. Несмотря на этот растущий этический консенсус, существуют подобласти ИИ, такие как аффективные вычисления, которые анализируют и моделируют человеческие эмоции, посвященные тому, чтобы нам все труднее было различать людей и машины. Эти исследовательские проекты могут завершиться созданием продвинутых андроидов в фильме Стивена Спилберга «ИИ», неотличимых от людей.

Законодатели Калифорнии уже запретили скрытое использование ботов в коммерческих и политических коммуникациях. Несмотря на этот растущий этический консенсус, существуют подобласти ИИ, такие как аффективные вычисления, которые анализируют и моделируют человеческие эмоции, посвященные тому, чтобы нам все труднее было различать людей и машины. Эти исследовательские проекты могут завершиться созданием продвинутых андроидов в фильме Стивена Спилберга «ИИ», неотличимых от людей.

Специалисты по этике спорят о том, как должны быть спроектированы такие человекоподобные роботы. А что, если их вообще не нужно делать? Гонка по подражанию человечеству может слишком легко стать прелюдией к его замене.

Голос или лицо другого человека требует уважения и внимания; машины не имеют такого права на нашу совесть. Когда чат-боты обманывают неосторожных людей, заставляя их думать, что они взаимодействуют с людьми, их программисты действуют как фальсификаторы, фальсифицируя особенности реального человеческого существования, чтобы повысить статус своих машин. Когда подделка денег достигает критической массы, подлинная валюта теряет ценность. Во многом та же участь уготована человеческим отношениям в обществах, которые позволяют машинам свободно имитировать эмоции, речь и внешний вид людей. В самом деле, если мы позволим обманчивым роботам (в реальном пространстве) и ботам (в сети) действовать беспрепятственно, они могут конкурировать за внимание гораздо эффективнее, чем некоторые люди.

Когда подделка денег достигает критической массы, подлинная валюта теряет ценность. Во многом та же участь уготована человеческим отношениям в обществах, которые позволяют машинам свободно имитировать эмоции, речь и внешний вид людей. В самом деле, если мы позволим обманчивым роботам (в реальном пространстве) и ботам (в сети) действовать беспрепятственно, они могут конкурировать за внимание гораздо эффективнее, чем некоторые люди.

Эта антиутопическая возможность является одним из многих обоснований третьего нового закона робототехники.

Роботизированные системы и ИИ не должны усиливать гонку вооружений с нулевой суммой.

Глобальная коалиция организаций гражданского общества призывает страны взять на себя обязательство не разрабатывать «роботов-убийц», также известных как смертоносные автономные системы оружия или LAWS. Несколько факторов теперь препятствуют этому похвальному предложению о технологическом сдерживании. Военные лидеры не доверяют своим коллегам в соперничающих странах. Они могут скрывать военизированные исследования искусственного интеллекта, даже если они публично отрицают такие намерения. Это лишь один из многих способов начать гонку вооружений.

Они могут скрывать военизированные исследования искусственного интеллекта, даже если они публично отрицают такие намерения. Это лишь один из многих способов начать гонку вооружений.

По мере того, как ИИ и робототехника становятся предметом внимания военных, ставки отставания от конкурентов возрастают, поскольку новые технологии обещают быть гораздо более целенаправленными, повсеместными и быстро развертываемыми, чем современные. Голубиные политики могут занимать чисто оборонительную позицию. Но оборону часто можно перепрофилировать в наступательное оружие. Подумайте об автономных дронах, предназначенных для уничтожения ракет, но перепрограммированных для убийства генералов. Даже защитные планы могут показаться агрессивными, как в случае со Стратегической оборонной инициативой Рональда Рейгана, также известной как «Звездные войны». Гораздо проще бомбить врага, если знаешь, что можешь защитить себя от его бомб. Автоматизированные кибератаки и кампании по дезинформации угрожают разрушить давно сложившиеся представления о цели и пределах международного конфликта.

Этот третий новый закон робототехники находит применение и во многих других областях. Машины все чаще осуждают людей, которые ищут работу или кредиты. Программное обеспечение прокторинга наблюдает за тем, как студенты сдают тесты; следующий шаг — измерить их вовлеченность в классе или в Интернете, постоянно сканируя их лица. Некоторые китайские школы даже развернули систему искусственного интеллекта, которая каждую секунду оценивает лица учащихся на предмет вовлеченности, концентрации и эмоционального состояния. Стремясь контролировать удаленных студентов, администраторы университетов в Соединенных Штатах также внедряют инвазивное программное обеспечение. Владельцы этих инструментов, вероятно, будут требовать все больше и больше возможностей для сбора данных, чтобы установить взаимосвязь, скажем, между выражением лица и оценками или активностью в социальных сетях и кредитоспособностью.

Нам нужно найти способы ограничить эту динамику, иначе мы все будем вынуждены участвовать в соревновании, чтобы раскрыть как можно больше себя, чтобы победить алгоритмических повелителей. Одним из простых шагов вперед было бы запретить такие камеры в большинстве классов или потребовать от кредиторов не основывать свои решения на активности в социальных сетях. Ослабленное за годы Трампа административное государство США имеет много возможностей доказать свою состоятельность, защищая нас от будущего, которое лучше оставить «Черному зеркалу» эпизодов.

Одним из простых шагов вперед было бы запретить такие камеры в большинстве классов или потребовать от кредиторов не основывать свои решения на активности в социальных сетях. Ослабленное за годы Трампа административное государство США имеет много возможностей доказать свою состоятельность, защищая нас от будущего, которое лучше оставить «Черному зеркалу» эпизодов.

Человеческая безопасность и творческий потенциал процветают в среде, которая сочетает в себе предсказуемость и открытость, порядок и непрерывность. ИИ и робототехника угрожают сделать социальный контроль слишком совершенным, а конкуренцию — быть сущностью, способной установить или уклониться от этого контроля — слишком жесткой. Если нам не удастся ограничить робототехнику, встроенную в системы социального контроля, этот баланс будет нарушен.

Один из способов обеспечить долговечность и эффективность этих ограничений — убедиться, что мы точно знаем, кто контролирует и получает выгоду от любой роботизированной системы или ИИ, с которыми мы сталкиваемся, что, в свою очередь, приводит к четвертому и последнему новому закону робототехники.

Роботизированные системы и ИИ всегда должны указывать личность их создателей, контролеров и владельцев.

Если каждому автомобилю нужен номерной знак, у каждого дрона должен быть его цифровой эквивалент, особенно когда такие машины можно запрограммировать так, чтобы они зависали рядом с вашим окном, чтобы наблюдать за вами. Учитывая весь ущерб, который могут нанести роботы, регулирующие органы должны будут потребовать, чтобы за них несли ответственность идентифицируемых лиц .

Правда, теперь некоторые программы могут генерировать новые программы, которые, в свою очередь, могут порождать другие. Но мы все еще можем проследить этих «детей разума» и внуков до их источника. Мы должны сохранить этот статус-кво в обозримом будущем, несмотря на предсказуемое сопротивление со стороны некоторых сторонников полностью автономного ИИ.

Некоторые роботы и алгоритмы эволюционируют в сторону от идеалов, заложенных в них их владельцами, в результате взаимодействия с другими людьми и машинами. Подумайте, например, о передовых беспилотных автомобилях, которые учатся новому поведению на дороге. В таких случаях может быть несколько потенциально ответственных сторон за разработку любой данной машины и возможные действия. Что бы ни влияло на эволюцию таких машин, первоначальный создатель должен быть обязан встроить определенные ограничения на эволюцию кода, чтобы одновременно фиксировать влияния и предотвращать плохие результаты. Как только другое лицо или организация взломает или отключит эти ограничения, хакер будет нести ответственность за правонарушения робота.

Подумайте, например, о передовых беспилотных автомобилях, которые учатся новому поведению на дороге. В таких случаях может быть несколько потенциально ответственных сторон за разработку любой данной машины и возможные действия. Что бы ни влияло на эволюцию таких машин, первоначальный создатель должен быть обязан встроить определенные ограничения на эволюцию кода, чтобы одновременно фиксировать влияния и предотвращать плохие результаты. Как только другое лицо или организация взломает или отключит эти ограничения, хакер будет нести ответственность за правонарушения робота.

Технологи могут отклонить эти четыре новых закона, заявив, что еще слишком рано регулировать робототехнику. Позвольте проблемам развиваться, и только потом переходите к противодействию им, говорят сторонники laissez-faire. Но квиетизм не попадает в цель. Слишком часто в высокотехнологичных областях промышленность говорит, что никогда не бывает подходящего времени для регулирования. Когда появляются тревожные новые методы ведения бизнеса, потенциальных регуляторов обвиняют в том, что они душит «детскую отрасль».