Содержание

Айзек Азимов — Три Закона роботехники читать онлайн

12 3 4 5 6 7 …90

Айзека Азимова

Три Закона роботехники

Люди и роботы

В литературе спокон веков бунтуют роботы. Бунтовали джинны и ифриты арабских сказок, взбунтовался Голем – глиняное детище хитроумного Бен Бецалеля. И даже настоящие роботы, созданные гением Карела Чапека, вышли из повиновения, едва успев родиться из-под пера писателя. Положение стало настолько серьезным, что проблема бунтующих роботов перекочевала со страниц художественной литературы на страницы научных статей и монографий. Сам Норберт Винер счел необходимым предостеречь человечество от возможных последствий чрезмерной самостоятельности роботов.

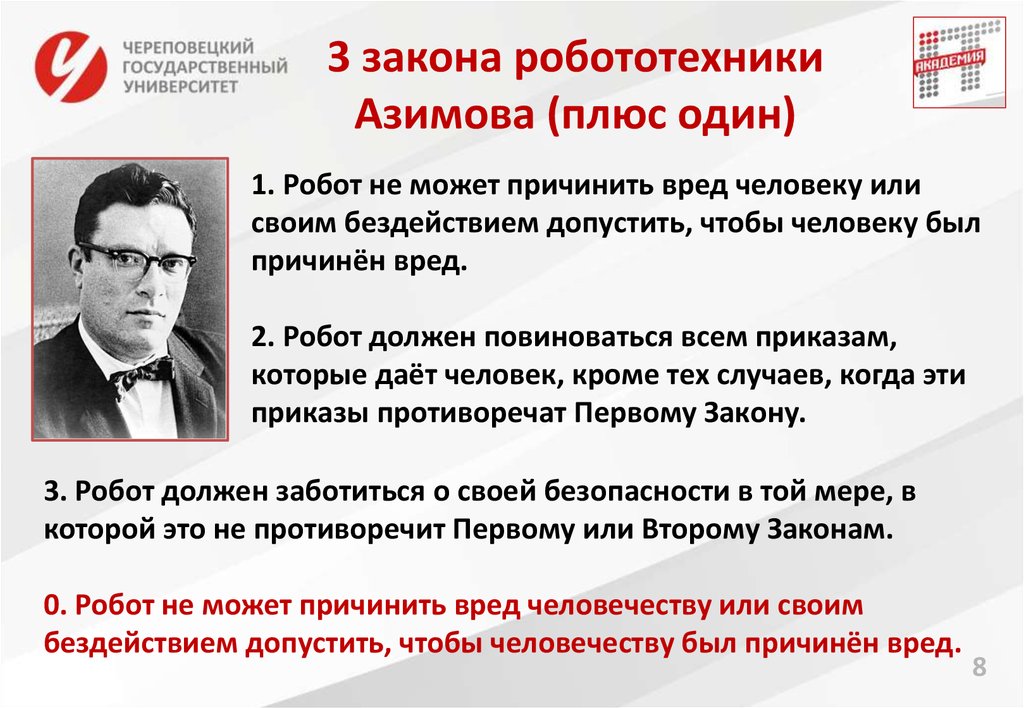

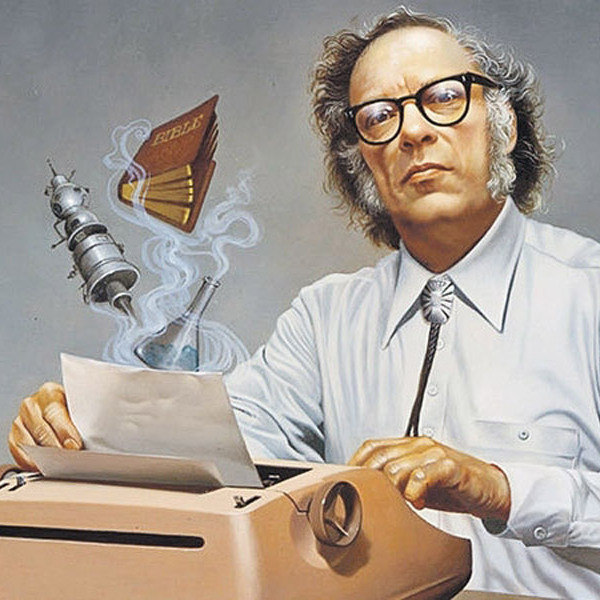

Спасение пришло с неожиданной стороны. Американский писатель и ученый Айзек Азимов сформулировал свои знаменитые Три Закона роботехники (собственно, правильнее было бы говорить “роботологии” или, как утвердилось в современной науке, “робототехники”, но теперь уже поздно исправлять эту неточность перевода). Законы Азимова с поистине фантастической быстротой получили всемирное признание, и с той поры ни один робот не сходил с конвейера, то бишь с барабанов типографской машины, без того, чтобы в его мозг (заметьте, у робота обязательно должен быть мозг!) не были заложены пресловутые Три Закона. Наконец-то человечество смогло вздохнуть свободно. Будущее сосуществование с легионами покорных роботов представлялось вполне безоблачным.

Законы Азимова с поистине фантастической быстротой получили всемирное признание, и с той поры ни один робот не сходил с конвейера, то бишь с барабанов типографской машины, без того, чтобы в его мозг (заметьте, у робота обязательно должен быть мозг!) не были заложены пресловутые Три Закона. Наконец-то человечество смогло вздохнуть свободно. Будущее сосуществование с легионами покорных роботов представлялось вполне безоблачным.

А что думает по этому поводу сам творец Законов роботехники? Лучший ответ на этот вопрос можно получить, прочтя предлагаемый читателю сборник.

Начнем с самого первого рассказа из цикла “Я, робот”. У маленькой девочки есть робот-нянька. Девочка привязалась к роботу, но, по мнению мамы, эта привязанность вредит правильному воспитанию ребенка. И хотя папа придерживается иного мнения, после долгих семейных дискуссий робота отправляют обратно на фабрику. Девочка грустит, возникает опасность серьезной душевной травмы, и робот возвращается (рассказ “Робби”).

Немудреный сюжет, не правда ли? Но именно эта немудреность вдребезги разбивает Первый Закон роботехники, который Азимов сформулировал следующим образом: “Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред”. Где уж роботу разобраться, что вредно, а что полезно, если сами родители не могут решить этот вопрос применительно к собственному ребенку!

Где уж роботу разобраться, что вредно, а что полезно, если сами родители не могут решить этот вопрос применительно к собственному ребенку!

В рассказе “Хоровод” в результате нечетко сформулированного указания Первый и Третий Законы вошли в противоречие друг с другом. Согласно Третьему Закону, “робот должен заботиться о своей безопасности, поскольку это не противоречит Первому и Второму Законам”. Роботу была дана команда, но не указана степень вреда, который будет нанесен человеку в случае ее невыполнения. И вот робот кружится по границе опасного района, не углубляясь в него (этому мешает Третий Закон) и вместе с тем не отходя далеко (этому препятствуют Первый и Второй Законы). Ситуация, знакомая любому программисту современных компьютеров. Называется она “зацикливание”. К слову сказать, любой мало-мальски опытный программист закладывает в программу специальные команды, по которым, совершив три-четыре круга, компьютер останавливается и требует от человека дальнейших указаний.

В рассказе же “Хоровод” все происходит иначе. Там разорвать порочный круг людям удается, лишь рискуя жизнью и при этом пуская в ход всю свою изобретательность и пользуясь помощью знатока психологии роботов. Кстати, один из лейтмотивов, объединяющих большинство рассказов сборника, – единоборство между роботами и человеком-робопсихологом Сьюзен Кэлвин.

Там разорвать порочный круг людям удается, лишь рискуя жизнью и при этом пуская в ход всю свою изобретательность и пользуясь помощью знатока психологии роботов. Кстати, один из лейтмотивов, объединяющих большинство рассказов сборника, – единоборство между роботами и человеком-робопсихологом Сьюзен Кэлвин.

Или еще один рассказ – “Как потерялся робот”. В раздражении молодой работник говорит роботу: “Уйди и не показывайся, чтобы я тебя больше не видел”. Робот буквально выполняет указание человека, после чего весь персонал внепланетной Гипербазы вынужден бросить важную работу и целую неделю заниматься поисками исчезнувшего робота.

Мы снова намеренно выбрали рассказ с незатейливым сюжетом, потому что, на наш взгляд, именно в простоте рождается та убедительность, с которой Азимов развенчивает им же созданный Второй Закон роботехники.

Так в чем же дело? Неужели придется признать, что джинн выпущен из бутылки и людям не остается ничего другого, как пассивно ожидать последствий? Вспомним, однако, что автор рассказов не только писатель, но и ученый, способный проанализировать ситуацию со всей логической строгостью. И он не зря выбрал именно такую форму: сначала сформулировал законы, на первый взгляд кажущиеся безупречными как по содержанию, так и по форме, а затем продемонстрировал эти законы в действии.

И он не зря выбрал именно такую форму: сначала сформулировал законы, на первый взгляд кажущиеся безупречными как по содержанию, так и по форме, а затем продемонстрировал эти законы в действии.

Да, джинн выпущен из бутылки, причем очень и очень давно. Взяв в руки палку, человек создал первого робота, а с бунтом роботов он столкнулся тогда, когда нечаянно уронил эту палку себе на ноги. И ничего качественно нового с тех пор не произошло. Проблема бунта роботов уже несколько десятилетий как поставлена и решается в технике. В английском языке даже существует особый термин “foolproof” – “защита от дурака”. Так, газ в газовой колонке не зажигается, если не течет вода, а пресс не сработает, если в рабочем пространстве имеется посторонний предмет, например человеческая рука.

Но не следует требовать от техники, чтобы она решала за человека, что ему во вред, а что на пользу. И не следует думать, будто появление “мыслящих” машин, то есть машин, способных самостоятельно анализировать ситуацию и на основании этого анализа принимать решения, внесет что-либо принципиально новое.

Вернемся, однако, к рассказам сборника. Думается, что нет нужды представлять читателям их автора. Айзек Азимов – один из самых известных американских писателей-фантастов, автор множества научно-популярных книг и статей, которые издавались отдельными сборниками. Но прежде всего Азимов – талантливый художник, и именно в этом секрет его популярности. Многие произведения этого писателя переведены на русский язык. Особую известность получили его рассказы о роботах, которые издавались в виде отдельных сборников (цикл “Я, робот”) или же включались в другие тематические сборники. Приятно, что многие из них, правда, далеко не все, сейчас переиздаются в виде единого сборника.

Читатель – и знакомый с творчеством Азимова, и впервые узнающий его роботов – встретится с яркими, превосходно выписанными персонажами. Здесь и испытатели новой техники Пауэлл и Донован, которые, следуя всем канонам приключенческого жанра, в каждом рассказе попадают в сложные, подчас безвыходные ситуации, но всегда с честью из них выходят. Здесь и “мозговой трест” фирмы “Ю.С.Роботс энд Мекэникл Мен Корпорейшн” Богерт и Лэннинг, соперничающие за власть. И над всеми возвышается робопсихолог Сьюзен Кэлвин, презирающая суетность деляг. А за кадром – современная капиталистическая Америка во всей ее “красе”. Перед читателем проходят картины конкурентной борьбы между фирмами, предвыборных политических махинаций, расовой дискриминации. Но нельзя не отметить, что, изображая своих роботов рыцарями без страха и упрека, наделяя их металлическим телом и позитронным мозгом, Азимов уходит от острых социальных проблем.

Здесь и “мозговой трест” фирмы “Ю.С.Роботс энд Мекэникл Мен Корпорейшн” Богерт и Лэннинг, соперничающие за власть. И над всеми возвышается робопсихолог Сьюзен Кэлвин, презирающая суетность деляг. А за кадром – современная капиталистическая Америка во всей ее “красе”. Перед читателем проходят картины конкурентной борьбы между фирмами, предвыборных политических махинаций, расовой дискриминации. Но нельзя не отметить, что, изображая своих роботов рыцарями без страха и упрека, наделяя их металлическим телом и позитронным мозгом, Азимов уходит от острых социальных проблем.

Читать дальше

12 3 4 5 6 7 …90

Три закона Азимова помогли сформировать ИИ. Нам нужно еще четыре / Хабр

Три закона робототехники Айзека Азимова, вероятно, являются самыми известными и влиятельными из когда-либо написанных в сайенс-фикшн строк в направлении технической политики. Известный писатель предположил, что по мере того, как машины будут обретать большую автономию и играть большую роль в жизни человека, нам понадобятся жёсткие правила, чтобы они не могли нанести нам вред.

Теперь, с A.I., автоматизацией и восходом заводской робототехники создаваемые машинами и их производителями опасности ещё более сложны и насущны. Специально к старту нового потока курса Machine Learning представляем вам перевод интервью с Фрэнком Паскуале, профессором Бруклинского юридического института, который в провокационной книге New Laws of Robotics: Defending Human Expertise in the Age of AI предлагает добавить четыре новых закона к трём законам Азимова.

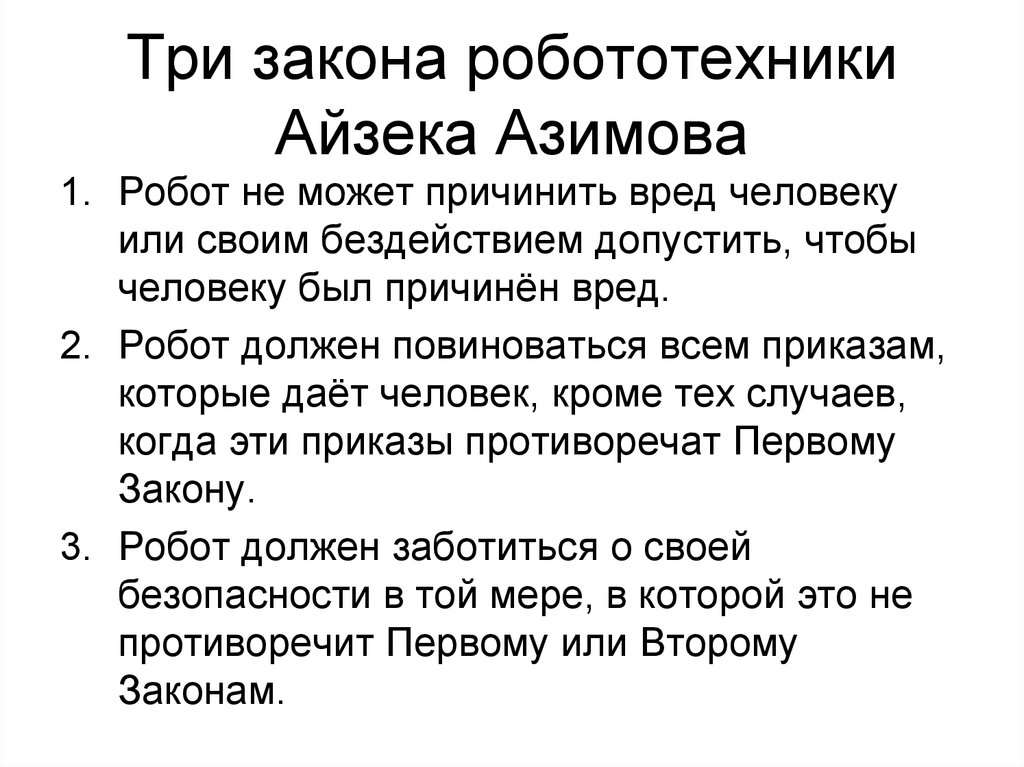

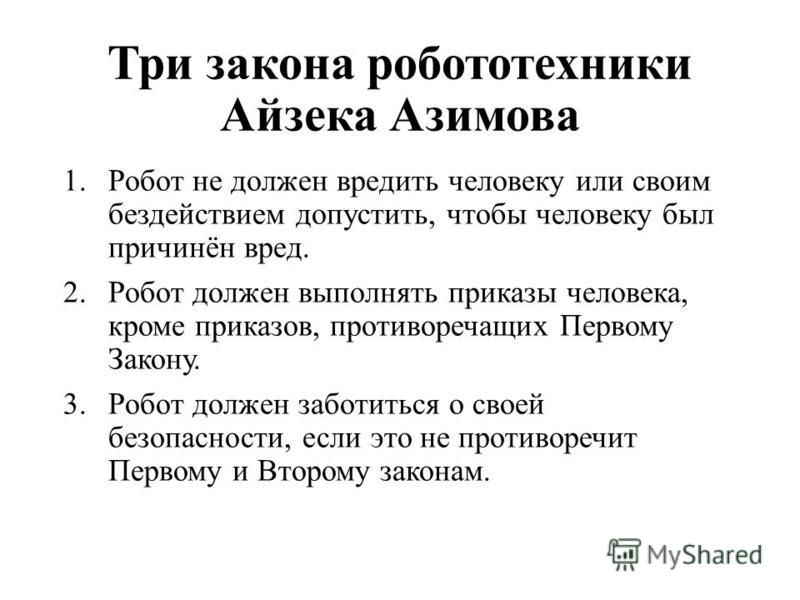

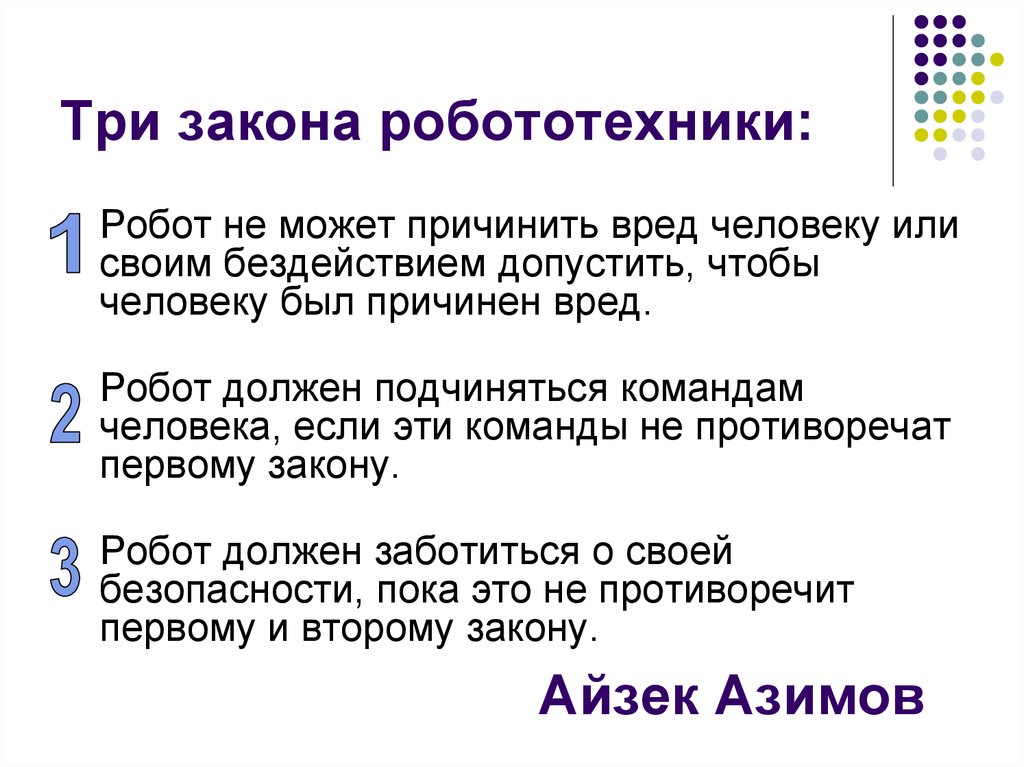

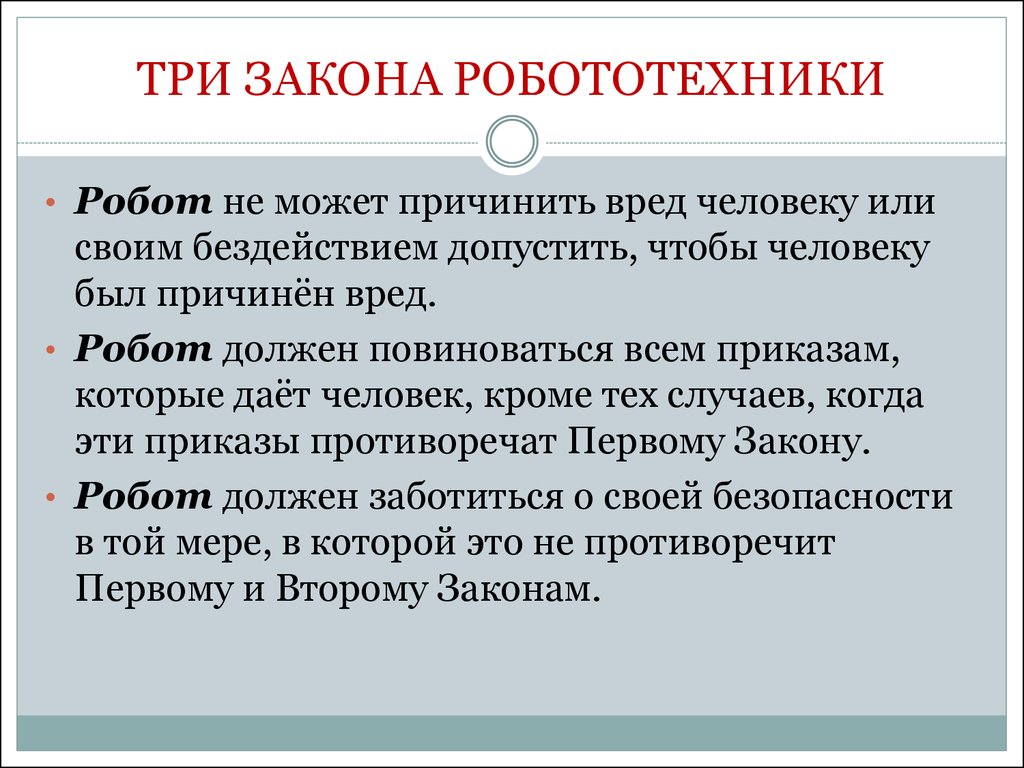

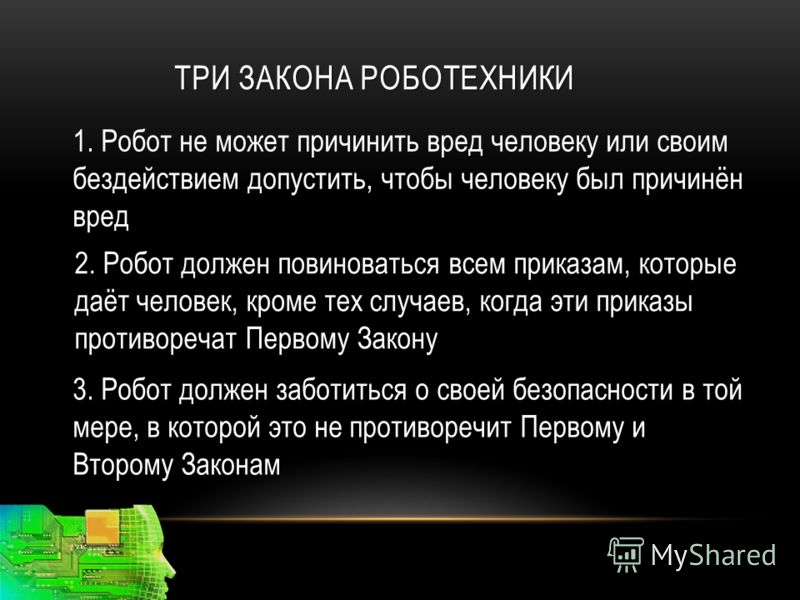

Приводим законы Азимова для тех, кто с ними не знаком:

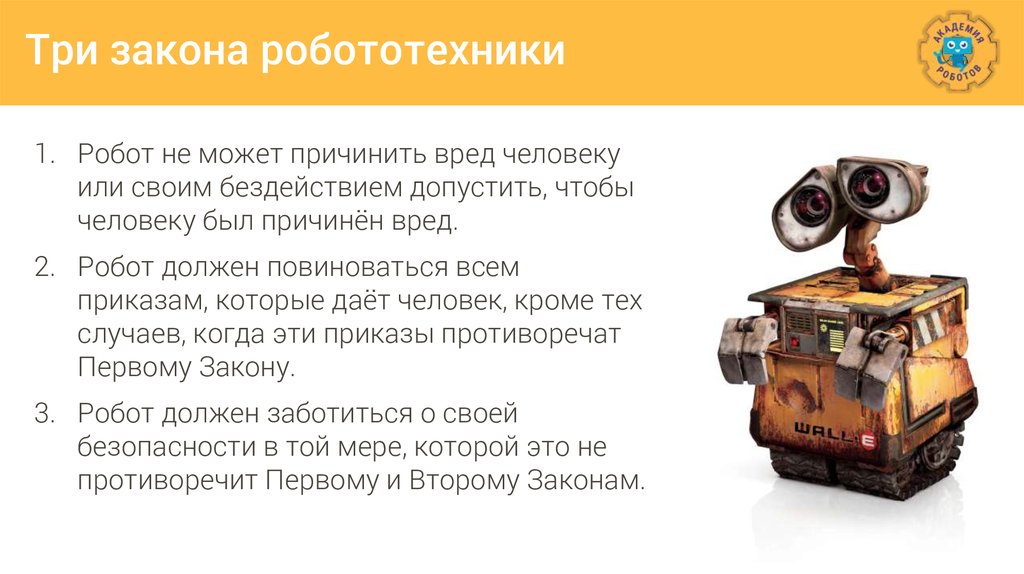

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат первому закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит первому или второму законам.

По словам Паскуале, мы должны пойти дальше. Он утверждает, что старые законы должны быть дополнены ещё четырьмя законами:

Он утверждает, что старые законы должны быть дополнены ещё четырьмя законами:

- Цифровые технологии должны дополнять профессионалов, а не заменять их.

- ИИ и роботизированные системы не должны подделывать человека.

- В области ИИ следует предотвратить усиление гонок вооружения с нулевой суммой [прим. перев. — это относится к понятию игр с нулевой суммой из теории игр].

- Роботы и системы ИИ должны указывать на личность своих создателей, контролирующих их людей и владельцев.

Новые законы проистекают из настойчивости Паскуале в его убеждении: прокол в робототехнике и искусственном интеллекте, а также роли технологий в обществе — в том, что не следует оставлять Силиконовую долину в одиночестве, чтобы она могла что-то диктовать. Если новые законы будут соблюдаться, говорит Паскуале, то можно будет использовать технологии для дополнения рабочих мест всех видов, а не для их захвата, особенно в секторах здравоохранения и образования. Однако для этого, по его мнению, директивные и регулирующие органы должны содействовать формированию и демократизации результатов работы в области ИИ. Сдерживание «автоматизации, которая контролирует, клеймит и обманывает невинных людей, — жизненно важная роль регуляторов XXI века», — пишет он. «Нам не просто нужно больше искусственного интеллекта, нам нужен искусственный интеллект лучше».

Однако для этого, по его мнению, директивные и регулирующие органы должны содействовать формированию и демократизации результатов работы в области ИИ. Сдерживание «автоматизации, которая контролирует, клеймит и обманывает невинных людей, — жизненно важная роль регуляторов XXI века», — пишет он. «Нам не просто нужно больше искусственного интеллекта, нам нужен искусственный интеллект лучше».

OneZero обратился к Паскуале, чтобы обсудить, почему он решил обновить законы Азимова, поговорить о причинах, лежащих в основе новых законов, и о многом другом.

Почему вы считаете важным обновить три закона Азимова? Кроме того, зачем делать акцент в книге вокруг демократизации этих решений о том, как используются робототехника и искусственный интеллект?

Законы Азимова — о том, чтобы роботы не обращались с людьми плохо. И я думаю, что это очень важно, конечно, но нам нужно больше идей, учитывающих настоящее и будущее, с которым мы столкнёмся. Намного больше. Нам необходимо обеспечить прочный и демократичный человеческий контроль над развитием технологий. Я думаю, большая мечта многих людей из области ИИ, предположительно, — просто позволить ИИ взять на себя работу врача, медсестры, журналиста, учителя и так далее. И моя идея заключается в том, что это в действительности не та цель, к которой мы должны стремиться. Верно? Главный вопрос — в том, должны ли мы вообще делать так. Думаю, нет. Надлежащая роль многих из этих технологических областей для меня — дополнять и поддерживать профессионалов, а не заменять их.

Я думаю, большая мечта многих людей из области ИИ, предположительно, — просто позволить ИИ взять на себя работу врача, медсестры, журналиста, учителя и так далее. И моя идея заключается в том, что это в действительности не та цель, к которой мы должны стремиться. Верно? Главный вопрос — в том, должны ли мы вообще делать так. Думаю, нет. Надлежащая роль многих из этих технологических областей для меня — дополнять и поддерживать профессионалов, а не заменять их.

Вполне вероятно, что дискуссии вокруг А.I. можно переосмыслить таким образом и отойти от мысли, что роботы заберут у нас нашу работу?

Думаю, да. Я честен с вами. Возьмите медицину: 10 лет назад были люди, которые говорили: «Берегитесь, врачи, роботы идут. У них отличное распознавание образов и данные, они заменят вас». Эти же люди, в частности, говорили: «Если вы врач в области радиологии, анестезиологии, дерматологии и патологии… всё это просто распознавание образов, и робот или ИИ с доступом к миллионам изображений нормальных и больных тканей сделает вашу работу намного лучше, чем вы». Здесь возникает вопрос: «Откуда роботы берут данные?». Данные берутся от людей, и, может быть, в конце концов системы ИИ станут машинами, которые будут способны брать данные самостоятельно, но даже если бы машины могли делать это, они не заменят ни одного человека на рабочем месте. На самом деле машина дополняет человека во многих отношениях, и эта ситуация должна оставаться такой. Подумаем о дерматологе. Даже если у вас есть распознающее родинки приложение, вы всё равно захотите поговорить о них с реальным человеком. Вы спросите: «Насколько вероятно, что это ложное позитивное или ложное негативное срабатывание? Мы вырезаем эту родинку, или она комфортна для вас?». Вот пример критического решения, которое должны принимать люди.

Здесь возникает вопрос: «Откуда роботы берут данные?». Данные берутся от людей, и, может быть, в конце концов системы ИИ станут машинами, которые будут способны брать данные самостоятельно, но даже если бы машины могли делать это, они не заменят ни одного человека на рабочем месте. На самом деле машина дополняет человека во многих отношениях, и эта ситуация должна оставаться такой. Подумаем о дерматологе. Даже если у вас есть распознающее родинки приложение, вы всё равно захотите поговорить о них с реальным человеком. Вы спросите: «Насколько вероятно, что это ложное позитивное или ложное негативное срабатывание? Мы вырезаем эту родинку, или она комфортна для вас?». Вот пример критического решения, которое должны принимать люди.

Каковы ваши размышления о том, что стоит за каждым новым законом робототехники?

Видение этого очень широко. Будь моя воля, широта задач была бы сопоставима с чем-то вроде Нового курса, где, в сущности, имелся бы массив укоренявшихся десятилетиями агентств с законодательными уставами объёмом от пяти до ста или около того страниц. Затем возникли бы агентства, похожие на Агентство безопасности, Комиссию по ценным бумагам, Федеральную комиссию связи и другие, работающие над уточнением вышеупомянутых уставов. Я надеюсь, что это произойдёт с приходом новых законов робототехники, что придут независимые агентства, которые будут уполномочены применять эти идеи.

Затем возникли бы агентства, похожие на Агентство безопасности, Комиссию по ценным бумагам, Федеральную комиссию связи и другие, работающие над уточнением вышеупомянутых уставов. Я надеюсь, что это произойдёт с приходом новых законов робототехники, что придут независимые агентства, которые будут уполномочены применять эти идеи.

Можете привести пару конкретных примеров того, как некоторые из ваших законов будут работать на практике?

Конечно. Возьмите первый предложенный закон о профессиях и дополнении ИИ. Робот не должен быть сертифицирован как учитель. Можно разрешить роботов или ИИ в качестве технологии, которую учителя смогут прописывать точно так же, как врачи прописывают лекарства, но не нужно стремиться к тому, чтобы учителя или какое-либо сочетание онлайн-лекций отслеживалось и курировалось исключительно искусственным интеллектом. Не хочется, чтобы ИИ действительно заменил учителей. Это пример работы закона о комплементарности в работе.

Второй новый закон «Не подделывать человека» требует, чтобы, к примеру, любой находящийся в сети робот был чётко обозначен как таковой. А для введения четвёртого нового закона в отношении атрибуции необходимо, чтобы бот был приписан конкретному лицу. На самом деле пример ботов хорош даже для третьего нового закона, здесь можно сказать, что по мере того, как эти боты начинают распространяться из-за попыток привлечь человеческое внимание в Интернете, можно принять некоторые законодательные или административные меры, чтобы остановить эту гонку вооружений между ботами за человеческое внимание.

А для введения четвёртого нового закона в отношении атрибуции необходимо, чтобы бот был приписан конкретному лицу. На самом деле пример ботов хорош даже для третьего нового закона, здесь можно сказать, что по мере того, как эти боты начинают распространяться из-за попыток привлечь человеческое внимание в Интернете, можно принять некоторые законодательные или административные меры, чтобы остановить эту гонку вооружений между ботами за человеческое внимание.

Ваш третий новый закон направлен на предотвращение усиления гонки вооружений. Он не ограничивается военными вопросами, верно?

Верно. Я думаю, что есть много областей жизни, где мы контролируем технологию и где крупные технологические фирмы используют ИИ для получения прибыли, ставя людей в условия крысиных бегов. Я долгое время писал о рейтингах и рангах, и я думаю, что кредитный скоринг был ранним примером этого явления. А с алгоритмическим кредитованием это явление приобретает большую интенсивность. Мы увидим всё больше и больше кредиторов, применяющих ИИ и говорящих: «Мы могли бы дать вам скидку на ипотеку в 1 %, но нам нужно увидеть всю историю вызовов в вашем телефоне».![]() Или: «Нам просто нужно увидеть больше данных о вас». Или: «Мы дадим вам скидку на вашу медицинскую страховку, вы просто должны носить это устройство, которое использует ИИ, чтобы „вычислить“, насколько вы здоровы». Эта постоянная жажда всё новых и новых данных сама по себе — гонка вооружений между технологическими компаниями. Эта жажда устраивает гонку вооружений между людьми, где они пытаются давать всё больше и больше данных, чтобы отличать себя от других. Поэтому помните, что всякий раз, когда вам дают скидку из-за вашего поведения или чего-то в этом роде, кто-то, вероятно, платит больше, верно? Такое компанией делается не по доброте душевной.

Или: «Нам просто нужно увидеть больше данных о вас». Или: «Мы дадим вам скидку на вашу медицинскую страховку, вы просто должны носить это устройство, которое использует ИИ, чтобы „вычислить“, насколько вы здоровы». Эта постоянная жажда всё новых и новых данных сама по себе — гонка вооружений между технологическими компаниями. Эта жажда устраивает гонку вооружений между людьми, где они пытаются давать всё больше и больше данных, чтобы отличать себя от других. Поэтому помните, что всякий раз, когда вам дают скидку из-за вашего поведения или чего-то в этом роде, кто-то, вероятно, платит больше, верно? Такое компанией делается не по доброте душевной.

Не могли бы вы пояснить закон о том, что ИИ и робототехника должны направлять к своим создателям? Почему это так важно?

Закон вводится, по сути, для того, чтобы остановить даже идею или стремление ИИ быть автономным от людей. Я имею в виду, что существуют научно-фантастические или футуристические устремления к созданию роботов, которые могли бы быть похожими, скажем, на ваших детей. Мы обучали бы их, пока они молоды, а потом отправляли в мир. Представьте себе робота в фильме Ex Machina, Ava, её просто неконтролируемый выход в мир и так далее. Такого не должно случиться никогда. Любой выпущенный в мир робот или любой участвующий в сети как бот ИИ — все они должны отслеживаться до их владельца или контролёра, который может в любой момент отключить их или иным образом изменить их поведение, то есть робот не должен быть автономным. Мы просто избавляемся от идеи автономности. Вычёркиваем ее как то, чего никогда не сделаем.

Мы обучали бы их, пока они молоды, а потом отправляли в мир. Представьте себе робота в фильме Ex Machina, Ava, её просто неконтролируемый выход в мир и так далее. Такого не должно случиться никогда. Любой выпущенный в мир робот или любой участвующий в сети как бот ИИ — все они должны отслеживаться до их владельца или контролёра, который может в любой момент отключить их или иным образом изменить их поведение, то есть робот не должен быть автономным. Мы просто избавляемся от идеи автономности. Вычёркиваем ее как то, чего никогда не сделаем.

Скажу о причине, по которой я думаю, что это важно. Я беспокоюсь вот о чём. Представьте, что мы живём в мире, где тротуарные роботы или беспилотники, другие вещи могут приближаться к нам, и мы не знаем, что они делают или почему они это делают. Я думаю, что всякий раз, когда к вам приближается беспилотник или тротуарный робот, вы должны быть в состоянии направить на него свой мобильный телефон и сразу же получить информацию: «Вот владелец, а вот кто-то, на кого вы можете пожаловаться». Это как уведомление об авторском праве на сайте в цифровую эпоху. Другими словами, речь идет о соответствующем органе управления, в который вы можете обратиться с жалобой, если владелец не отвечает на ваши беспокойства.

Это как уведомление об авторском праве на сайте в цифровую эпоху. Другими словами, речь идет о соответствующем органе управления, в который вы можете обратиться с жалобой, если владелец не отвечает на ваши беспокойства.

Какая ответственность лежит на создателях за то, что в итоге делают роботы и ИИ?

Для занятых в областях робототехники и искусственного интеллекта людей пришло время взять ответственность за невероятную гибкость и пластичность их ПО, которое можно было бы запрограммировать иначе. Возьмём такой пример: я не должен расстраиваться или сочувствовать плачущему роботу, потому что его можно так же легко запрограммировать смеяться над всем, что заставляет его искусственно плакать. И здесь мы должны быть трезвыми, поскольку существует быстрорастущая область аффективных вычислений, которая для меня во многих отношениях — прелюдия к манипулированию людьми и контролю над ними со стороны крупных корпораций и правительств через посреднические эффекты технологий. И мы должны смотреть этим мрачным возможностям прямо в глаза.

В книге вы в основном концентрируетесь на влиянии ИИ и автоматизации на «профессиональную» работу. А как насчёт синих воротничков? Или людей, которые работают, скажем, на складе или в качестве кассиров в продуктовом магазине?

Об этом стоит сказать. И это так интересно, когда думаешь о работе кассира, потому что, когда есть автоматизированные киоски, которые проверяют людей, и один человек смотрит за тремя-четырьмя киосками, можно сказать: «Роботы лишили работы четырёх человек». Или можно сказать: «Ну, это позволило одному человеку быть более продуктивным, потому что теперь он отвечает за эти машины, пропускающие людей, пытается их починить, убедиться, что машины работают эффективно и так далее». Это будет очень интересный вопрос, но, в конечном счёте, я не думаю, что в этом вопросе политика должна стоять на пути автоматизации, если только люди работающие кассиры не скажут: «Есть причина, по которой вам нужны человеческое суждение и люди, которые контролируют процесс». И если убрать нас из процесса, возникнет большая проблема».

И если убрать нас из процесса, возникнет большая проблема».

В вашей предыдущей книге The Black Box Society: The Secret Algorithms That Control Money and Information вы скрупулёзно изучаете, как подобные YouTube или Facebook-платформы процветают с помощью алгоритмов, задерживающих нас на сайте через предложение контента, в значительной степени основанного на том, что мы уже посмотрели. И, как мы все уже видели, это часто заканчивается поощрением и распространением дезинформации и теорий заговора. На ваш взгляд, нужно ли больше регулирования для решения этой проблемы?

Абсолютно необходимо. Во-первых, в новой книге я рассматриваю проблему управляющего медиа ИИ, берущего на себя главным образом редакторские функции и даже иногда функции по созданию распространяемого контента. Это вызывает тревогу, поскольку такие системы оптимизированы под задачу грубым, упрощённым образом, они сырые и не отражают социальную ценность истины. И, как вы уже упомянули, сильно проявили себя теории заговора. Попасть в ряды их сторонников легко. Другая проблема заключается в том, что управляемые ИИ платформы скажут в ответ: «Мы просто даём людям то, что они хотят». На самом же деле то, как разработана архитектура самого выбора, имеет большое влияние на то, чего хотят люди. Мы не должны жить в мире, где ИИ может сказать: «Хорошо, мы получим еще 10 зрителей, если покажем эти сумасшедшие педофильные клипы или ещё что-нибудь». Это просто грубый путь к высоким метрикам успеха.

Попасть в ряды их сторонников легко. Другая проблема заключается в том, что управляемые ИИ платформы скажут в ответ: «Мы просто даём людям то, что они хотят». На самом же деле то, как разработана архитектура самого выбора, имеет большое влияние на то, чего хотят люди. Мы не должны жить в мире, где ИИ может сказать: «Хорошо, мы получим еще 10 зрителей, если покажем эти сумасшедшие педофильные клипы или ещё что-нибудь». Это просто грубый путь к высоким метрикам успеха.

Что, по-вашему, заставляет нас хотеть создавать роботов и ИИ, которые очень похожи на нас?

Основные аргументы в пользу создания роботов, похожих на людей, исходят из постгуманистической или трансгуманистической перспективы. Сторонник постчеловеческий перспективы сказал бы: “Мы хорошо поработали на Земле, но, вы знаете, в конечном счёте наш мозг слишком медленный. Роботы оснащены более производительными процессорами. Они будут понимать и делать больше в этом мире. Просто позвольте им это. И трансгуманист скажет: «Да, если вы хотите выйти за пределы человеческих ограничений, вам, наверное, придётся выйти за пределы человеческого тела». И часть такого подхода — вход в робототехнику, слияние с ней или что-то в этом роде. И я считаю, что трансгуманистические и постгуманистические перспективы, в конечном счете, очень антигуманистичны.

И часть такого подхода — вход в робототехнику, слияние с ней или что-то в этом роде. И я считаю, что трансгуманистические и постгуманистические перспективы, в конечном счете, очень антигуманистичны.

В чем конкретно эти позиции антигуманнны?

Отчасти существенным элементом человеческой сущности являются принятие и понимание наших ограничений. Наши слабости. Нужно усилие, чтобы превзойти слабость и сказать: «Ну, вот бессмертное существо; давайте относиться к нему, как к сверхчеловеку». Это проблематично. Такой подход включает отрицание того факта, что мы смертны. Что мы чувствуем боль. У нас есть ограниченное количество вещей, на которые мы можем потратить наше внимание. Когда я умру, накопится миллиард не прочитанных мной книг. И я не думаю, что кто-то может сказать: «Ну, представьте себе, вы были бы намного лучше — если бы вы были роботом, который мог бы обрабатывать 1 миллион книг за короткое время». Мой короткий ответ на это: я не думаю, что такое было бы похоже на ситуацию, когда я по-человечески читаю книгу или когда любой другой человек читает. Есть уникальный способ, которым мы взаимодействуем с вещами, и это делает нас особенными.

Есть уникальный способ, которым мы взаимодействуем с вещами, и это делает нас особенными.

В целом что больше всего мотивировало на конфронтацию с возникающим ИИ в книге?

Я на самом деле хотел исследовать, что это значит — ставить человеческий труд в центр экономики и общества. В противопоставление подходу, когда человеческий труд — просто ресурс, подобный природному, где человек просто кладёт вещи в некую машину и следит за тем, что делает машина, получая на выходе нечто. Эти поиски действительно важны, в частности потому, что наша экономика сейчас ориентирована на такие вещи, как финансовые активы, акции — и на владельца этих вещей, и именно так мы измеряем успех во многих отношениях: мы смотрим, поднимается или опускается фондовый рынок. И вот мой вопрос: «Как мы могли бы думать о будущем технологий и работать над тем, чтобы человеческий труд был в центре всей дискуссии?». И размышления об этом, я надеюсь, дают представление о том, как экономика может быть намного справедливее и стабильнее для нас, людей.

- Продвинутый курс «Machine Learning Pro + Deep Learning»

- Курс «Математика и Machine Learning для Data Science»

- Курс по Machine Learning

- Обучение профессии Data Science

- Обучение профессии Data Analyst

- Курс «Python для веб-разработки»

Eще курсы

- Профессия Этичный хакер

- Разработчик игр на Unity

- Курс по JavaScript

- Профессия Веб-разработчик

- Профессия Java-разработчик

- C++ разработчик

- Курс по аналитике данных

- Курс по DevOps

- Профессия iOS-разработчик с нуля

- Профессия Android-разработчик с нуля

- Сколько зарабатывает дата-сайентист: обзор зарплат и вакансий в 2020

- Сколько зарабатывает аналитик данных: обзор зарплат и вакансий в 2020

- Как стать Data Scientist без онлайн-курсов

- 450 бесплатных курсов от Лиги Плюща

- Как изучать Machine Learning 5 дней в неделю 9 месяцев подряд

- Machine Learning и Computer Vision в добывающей промышленности

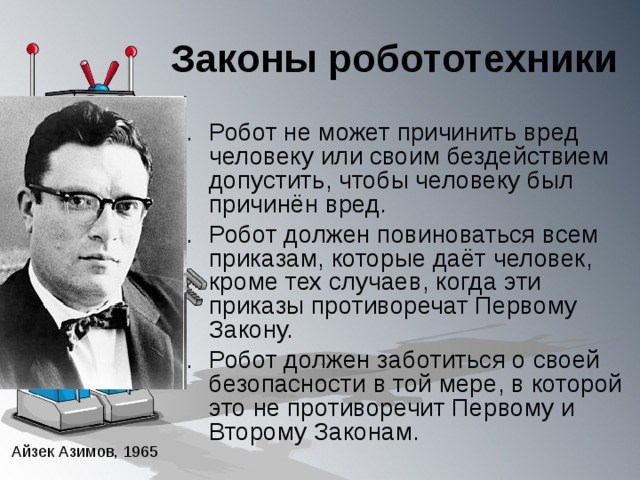

Айзек Азимов сформулировал три закона робототехники.

Содержание

- Три закона робототехники: вымысел и реальность

- Появление и формулировка

- Не навреди!

- Как понять Первый закон

- Обходной путь

- Нулевой закон робототехники

- Мнения экспертов

- Три закона роботехники

Три закона робототехники: вымысел и реальность

Мысль о том, что искусственное существо откажется подчиняться хозяину, давно тревожит ученых, писателей, мыслителей и простых обывателей.

Фантаст Айзек Азимов в 40-х годах XX века предложил решение этой проблемы в виде трех законов робототехники, которые нужно «вшить» в искусственный мозг разумных машин.

Несложные правила накладывают на действия механических созданий ряд ограничений, поэтому человечество может отвлечься от размышлений о машинном бунте и смело шагать по дороге прогресса в сопровождении послушных и выносливых помощников.

три закона робототехники Айзека Азимова

Шло время, росла мощность вычислительной техники, появлялись и совершенствовались механизмы, разговоры об искусственном интеллекте выходили за пределы академических кругов. Но страх перед умными и своевольными машинами отнюдь не уменьшался. Азимовские законы стали всерьез рассматривать ученые, которые разрабатывают машины с программным управлением. Кажется, что стоит понять, как донести их до роботов, и наступит новая эра, но так ли это?

Но страх перед умными и своевольными машинами отнюдь не уменьшался. Азимовские законы стали всерьез рассматривать ученые, которые разрабатывают машины с программным управлением. Кажется, что стоит понять, как донести их до роботов, и наступит новая эра, но так ли это?

Появление и формулировка

Многие предшественники Азимова описывали человекоподобных существ, которые созданы искусственно, как монстров с недобрыми намерениями. Немногочисленные авторы произведений о миролюбивых андроидах выделялись на общем фоне. Рассказы «Хелен О’Лой» Лестера дель Рея и «Я, робот» Отто Биндера вдохновили Азимова на работу над похожим произведением.

Результат не устроил Джона Кэмпбелла, редактора журнала «Astounding Science Fiction», где публиковался писатель: слишком велико было сходство с рассказом дель Рея. Азимов продолжал писать на эту тему и обсуждать ее с редактором. Во время одной дискуссии Кэмпбелл изложил принципы, которые теперь весь мир знает как три закона робототехники. Эти правила работали в произведениях Азимова, издатель же просто указал на них писателю.

Законы робототехники предписывают машинам следующее:

- Робот не может навредить человеку или позволить нанести ему вред в результате бездействия.

- Робот обязан подчиняться командам человека за исключением тех, что не соответствуют Первому закону.

- Робот должен следить за собственной сохранностью, если это не идет вразрез с Первым или Вторым законом.

В произведениях Азимова эти принципы вносились в программное обеспечение почти всех машин. Если же происходило нарушение одного из правил и робот это понимал, то его позитронный мозг получал серьезное повреждение, случался так называемый «робоблок», из-за которого машина ломалась. Но художественную литературу любят за описание конфликтов, с которыми справляются действующие лица.

три закона робототехники

Поэтому автор писал не об идеальных машинах, которые работают по безупречным алгоритмам, а о логических неувязках в законах. Нестандартные ситуации и вольные трактовки ведут за запретную черту, а вред от неукоснительного соблюдения законов порой превышает пользу.

Герои книг Азимова должны внимательно наблюдать за своими помощниками, а в случае беды разбираться в причинах, часто при участии специалиста-робопсихолога. Автор намеренно сделал три закона робототехники несовершенными, ведь иначе не получилось бы выстроить интересный сюжет. В ряде произведений он даже позволил роботам изменять строгие правила.

Но целью писателя было не запугать читателей, а дать им возможность посмотреть на машины иначе. Азимов хотел, чтобы обыватели забыли о страхе перед механизмами, поняли, что те могут приносить пользу и стать людям верными товарищами. Писатель настаивал на том, что разработанные им принципы годятся не только для литературы, но и для воплощения в машинном коде.

Не навреди!

Жажда жизни перевешивает все остальные человеческие желания. Мощные механизмы с быстрой реакцией воспринимаются как явная угроза.

Поэтому Первый закон робототехники ограждает людей от агрессии со стороны машин.

Если же человек попадет в опасную ситуацию, верный робот спасет его. Здесь стоит забыть о двух других законах, ведь жизнь по умолчанию важнее, чем выполнение каких бы то ни было команд и исправность машины. Кажется, что здесь нет нестыковок и туманных толкований, но на деле все обстоит куда сложнее.

Здесь стоит забыть о двух других законах, ведь жизнь по умолчанию важнее, чем выполнение каких бы то ни было команд и исправность машины. Кажется, что здесь нет нестыковок и туманных толкований, но на деле все обстоит куда сложнее.

Как понять Первый закон

Какой именно вред могут причинить роботы? Да, нападать на хозяев нельзя, но как быть, если автомат заденет человека нечаянно? Механизм подчиняется законам физики, он не может остановиться мгновенно, когда живой объект окажется рядом неожиданно. Каждую секунду мозг робота должен определять, как далеко находятся люди и с какой скоростью они перемещаются, а корпус робота должен быть усеян датчиками и камерами.

На обработку такого объема информации будет уходить слишком много времени и ресурсов машины, так что робот просто не выполнит свою основную задачу.

первый закон робототехники

Следующий вопрос — кого считать человеком? Люди долго учились различать себе подобных, они поймут, где живой соплеменник, а где мертвый, где манекен, чучело или другой предмет, который напоминает человека. Научить этому компьютер очень сложно, ни один алгоритм распознавания не будет работать без сбоев, а цена ошибки — жизнь, и не одна. И что делать, если перед роботом совершается убийство или другое преступление против личности?

Научить этому компьютер очень сложно, ни один алгоритм распознавания не будет работать без сбоев, а цена ошибки — жизнь, и не одна. И что делать, если перед роботом совершается убийство или другое преступление против личности?

А иногда спасти одного человека можно, если пожертвовать другим. Сложных ситуаций чересчур много, в них законы робототехники стали бы причиной поломки огромного количества роботов: машины попросту выйдут из строя, когда осознают, что не исполнили Первый закон. Еще одно уточнение: что считать вредом для человека? Ведь травмы бывают не только физические: моральный вред причиняет людям не меньшие страдания, а общаться без нанесения обид умеют далеко не все люди, не говоря уже о машинах.

Перевести этические нормы людей на язык математических формул пока невозможно, поэтому ущерб от роботов нельзя предотвратить целиком. Эти проблемы рассматривал в своих книгах Айзек Азимов, но литературные герои всегда находили выход из трудного положения. В жизни предусмотреть все пути развития событий не получится.

Обходной путь

Если роботам удавалось безнаказанно попирать правила в фантастической литературе, то в действительности все еще сложнее. Три закона робототехники противоречивы, их можно толковать по-разному в зависимости от обстоятельств, что неизбежно приведет к нарушениям.

Раз человек далек от совершенства, то машины и программы, которые он создает, тоже будут с изъянами. Ошибки и дефектные детали приведут к сбоям, из-за которых машины будут вести себя не так, как планировалось.Люди порой ведут себя нелогично и отдают путаные и необдуманные команды. Все это действует на руку злоумышленникам, которые захотят изменить поведение роботов ради наживы, устрашения, власти или забавы.

Но не только люди могут задуматься о том, как обойти законы робототехники. Мощный и гибкий искусственный интеллект, который непрестанно анализирует потоки данных и опирается не на жесткие алгоритмы, а на свой опыт, теоретически способен преодолеть ограничения.

боевой робот

Такой робот будет действовать вопреки догмам, которые придумали его слабые и несовершенные создатели. К тому же люди сами часто нарушают общественные и этические нормы, так они подают роботам не лучший пример для подражания. А существование военных беспилотников и других подобных изобретений само по себе наталкивает на вывод о том, что машинам дозволено убивать людей.

К тому же люди сами часто нарушают общественные и этические нормы, так они подают роботам не лучший пример для подражания. А существование военных беспилотников и других подобных изобретений само по себе наталкивает на вывод о том, что машинам дозволено убивать людей.

Нулевой закон робототехники

Азимов не ограничился тремя правилами, которые изложил в ранних рассказах своего знаменитого цикла. Нулевой закон робототехники появился позже, но писатель поставил его над остальными, так как хотел подчеркнуть значимость этого догмата. Вот его формулировка:

0. Робот не может навредить человечеству либо позволить, чтобы вред был нанесен человечеству в результате бездействия.

Забота обо всей человеческой расе, а не только об отдельных ее представителях, — благородная и ответственная миссия. С этой задачей трудно справиться, если учесть, что Нулевой закон противоречит трем другим, особенно Первому.

нулевой закон робототехники

Понять, опасен ли какой-то фактор для всех людей, непросто, а справиться с глобальной угрозой одному роботу или целой группе вряд ли по силам. Если же опасность исходит от самих людей, можно ли позволять машине лишать жизни тех, кого в норме нужно оберегать? В конце концов, неумолимая логика искусственного разума способна принять за угрозу то, чего люди не опасаются. Поэтому о пользе этого важного правила можно говорить с натяжкой.

Если же опасность исходит от самих людей, можно ли позволять машине лишать жизни тех, кого в норме нужно оберегать? В конце концов, неумолимая логика искусственного разума способна принять за угрозу то, чего люди не опасаются. Поэтому о пользе этого важного правила можно говорить с натяжкой.

Мнения экспертов

Разработчики искусственного интеллекта скептически относятся к применению трех законов робототехники на практике. Человеческая этика базируется на устаревших принципах, а как их использовать в создании программного кода, неясно. Человек по Азимову — творец, он ставит себя выше роботов, которых сознательно ограничивает в правах, хотя машины куда выносливее, быстрее и рациональнее людей.

Вероятно, взгляд с позиции хозяина искажает картину: если воспринимать роботов как бесправных рабов, то бояться восстания и накладывать запреты естественно.

робопсихолог

Нужно также помнить, что искусственный разум, который обладает самосознанием, невозможно создать случайно, как это происходит в фантастике. Разработчики вряд ли рискнут дать жизнь существу, которое совершает морально значимые поступки, но лишено этических принципов.

Разработчики вряд ли рискнут дать жизнь существу, которое совершает морально значимые поступки, но лишено этических принципов.

Вместо того, чтобы придумывать оковы для искусственного интеллекта, стоит углубиться в практику: создать прототип и поэкспериментировать с ним. О машинной этике лучше узнавать из реальных опытов, а не опираться на мысленное моделирование и страшные теории. Хотя пока рано говорить о разумных роботах, готовиться к их появлению только полезно.

Автоматизация проникает во все сферы жизни, поэтому думать о влиянии машин на человечество и даже планету нужно уже сейчас. Вероятно, законы робототехники не получится использовать в первоначальном виде, зато они могут лечь в основу стандартов, которые помогут людям и роботам жить в мире и трудиться на общее благо.

Три закона роботехники

|

Законы робототехники Айзека Азимова неверны

Когда люди говорят о роботах и этике, они всегда вспоминают «Три закона робототехники» Айзека Азимова. Но есть три основные проблемы с этими законами и их использованием в нашем реальном мире.

Но есть три основные проблемы с этими законами и их использованием в нашем реальном мире.

Законы

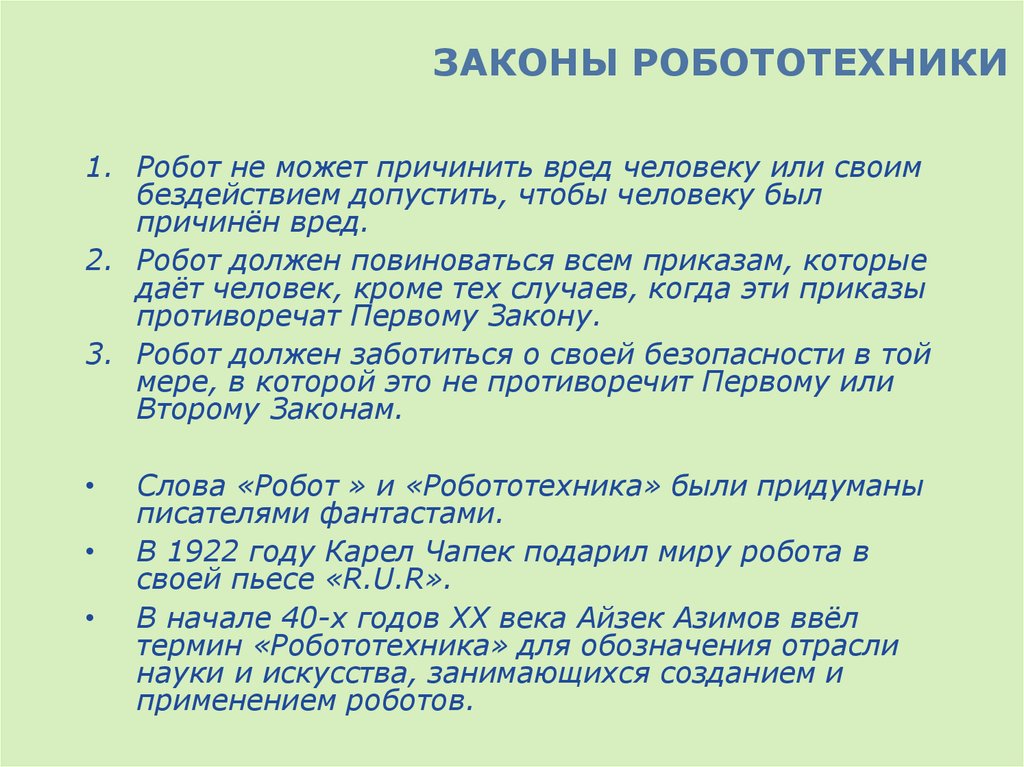

Законы Азимова изначально содержали три правила для машин:

- Закон первый: «Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред».

- Второй закон — «Робот должен подчиняться приказам, отданным ему людьми, за исключением случаев, когда такие приказы противоречат Первому закону».

- Третий закон — «Робот должен защищать свое существование, пока такая защита не противоречит Первому или Второму закону».

- Позже Азимов добавил «Закон Нуля» выше всех остальных: «Робот не может причинить вред человечеству или своим бездействием позволить человечеству причинить вред».

Разоблачение

Первая проблема в том, что законы — вымысел! Это сюжетный ход, который Азимов придумал, чтобы продвигать свои истории. Более того, его рассказы почти всегда вращались вокруг того, как роботы могут следовать этим великолепно звучащим, логичным этическим кодексам, но все же сбиваться с пути и иметь непредвиденные последствия. Реклама экранизации знаменитой книги Азимова 9 2004 года.0057 Я, робот (в главных ролях Свежий принц и мама ребенка Тома Брэди) выразился лучше всего: «Правила созданы для того, чтобы их нарушать».

Реклама экранизации знаменитой книги Азимова 9 2004 года.0057 Я, робот (в главных ролях Свежий принц и мама ребенка Тома Брэди) выразился лучше всего: «Правила созданы для того, чтобы их нарушать».

Например, в одном из рассказов Азимова роботы созданы следовать законам, но им придается определенное значение «человек». Предвосхищая то, что сейчас происходит в реальных кампаниях этнических чисток, роботы распознают людей только из определенной группы как «людей». Они соблюдают законы, но все равно осуществляют геноцид.

Вторая проблема заключается в том, что ни одна технология пока не может воспроизвести законы Азимова внутри машины. Как говорит Родни Брукс из компании iRobot, названной в честь книги Азимова, это люди, которые принесли вам военного робота Packbot и робота-пылесоса Roomba: «Люди спрашивают меня, следуют ли наши роботы законам Азимова. По простой причине [они этого не делают]: я не могу встроить в них законы Азимова».

Робототехник Дэниел Уилсон был немного более красочным. «Правила Азимова хороши, но в то же время и чушь собачья. Например, они на английском языке. Как, черт возьми, ты это программируешь?»

«Правила Азимова хороши, но в то же время и чушь собачья. Например, они на английском языке. Как, черт возьми, ты это программируешь?»

Самая важная причина, по которой законы Азимова еще не применяются, заключается в том, как роботы используются в нашем реальном мире. Вы не вооружаете дрон Reaper ракетой Hellfire или не ставите пулемет на MAARS (Modular Advanced Armed Robotic System), чтобы не причинять вреда людям. Вот в чем суть!

То же самое касается создания робота, который подчиняется приказам любого человека. Действительно ли я хочу, чтобы Усама бен Ладен мог распоряжаться моим роботом? И, наконец, тот факт, что роботов можно отправлять на опасные миссии, чтобы их «убили», часто является самой причиной их использования. Дать им ощущение «существования» и инстинкт выживания противоречило бы этому обоснованию, а также открыло бы потенциальные сценарии из другого научно-фантастического сериала, фильмов « Терминатор ». Дело в том, что большая часть финансирования исследований в области робототехники поступает от военных, которые платят за роботов, которые следуют прямо противоположным законам Азимова. Ему явно нужны роботы, которые могут убивать, не будут подчиняться приказам любого человека и не заботятся о собственном существовании.

Ему явно нужны роботы, которые могут убивать, не будут подчиняться приказам любого человека и не заботятся о собственном существовании.

Связанные книги

Вопрос этики

Тем не менее, когда дело доходит до роботов и этики, большая проблема заключается не в том, можем ли мы использовать что-то вроде законов Азимова для создания моральных машин (что может быть неотъемлемым противоречием, учитывая, что мораль объединяет намерение и действие, а не просто программирование).

Скорее, нам нужно начать борьбу с этикой людей, стоящих за машинами. Где кодекс этики в области робототехники для того, что будет построено, а что нет? К чему бы обратились молодые робототехники? Кто может использовать эти сложные системы, а кто нет? Является ли беспилотник Predator технологией, которую следует использовать только военным? Что ж, слишком поздно, Министерство внутренней безопасности уже использует шесть дронов Predator для обеспечения безопасности границ. Точно так же многие местные полицейские управления изучают возможность покупки собственных дронов для парковки над криминальными кварталами. Я могу думать, что это имеет смысл, пока дрон не наблюдает за моим районом. Но как насчет меня? Входит ли в мое право согласно 2-й поправке иметь робота с оружием?

Точно так же многие местные полицейские управления изучают возможность покупки собственных дронов для парковки над криминальными кварталами. Я могу думать, что это имеет смысл, пока дрон не наблюдает за моим районом. Но как насчет меня? Входит ли в мое право согласно 2-й поправке иметь робота с оружием?

Все это немного похоже на вопросы, которые задают только на съездах научной фантастики. Но это моя точка зрения. Когда мы сейчас говорим о роботах, мы больше не говорим о «чистой научной фантастике», как описал эти технологии один аналитик Пентагона. Они во многом являются частью нашего реального мира.

Технологии и инновации

Эхо-камеры, кроличьи норы и идеологическая предвзятость: как YouTube рекомендует контент реальным пользователям

Меган А. Браун, Джонатан Наглер, Джеймс Бисби, Анджела Лай и Джошуа А. Такер

Китай

Накануне партийного съезда, что ждет экономику Китая?

Райан Хасс, Гуонан Ма, Сяохун Сюй, Мэтти Бекинк, Тейлор Лоэб, Хо Фун Хун и Марина Рудяк

Получайте ежедневные обновления от Brookings

Введите адрес электронной почты

Три закона робототехники подвели роботов

Плодовитый писатель-фантаст Айзек Азимов (1920–1992) разработал Три закона робототехники в надежде защититься от потенциально опасного искусственного интеллекта. Впервые они появились в его рассказе 1942 года Обход:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

- Робот должен подчиняться приказам, отданным ему людьми, за исключением случаев, когда такие приказы противоречат Первому Закону.

- Робот должен защищать свое существование до тех пор, пока такая защита не противоречит Первому или Второму закону.

Поклонники Азимова говорят нам, что в его ранних рассказах неявно присутствовали законы.

В книге «Роботы и империя» (1985) был добавлен закон 0 th : «Робот не может причинить вред человечеству или своим бездействием допустить, чтобы человечеству был причинен вред».

Азимов обсуждает свои законы:

Крис Стоукс, философ из Уханьского университета в Китае, говорит: «Многие инженеры-компьютерщики используют три закона как инструмент для того, чтобы понять, как они думают о программировании». Но беда в том, что они не работают.

Он объясняет в статье с открытым доступом:

Первый закон терпит неудачу из-за двусмысленности в языке и из-за сложных этических проблем, которые слишком сложны, чтобы иметь простой ответ «да» или «нет».

Второй закон терпит неудачу из-за неэтичной природы закона, который требует, чтобы разумные существа оставались рабами.

Третий закон терпит неудачу, потому что он приводит к постоянному социальному расслоению с огромным количеством потенциальной эксплуатации, встроенной в эту систему законов.

Закон «Нулевой», как и первый, терпит неудачу из-за неоднозначной идеологии. Все законы также терпят неудачу из-за того, как легко обойти дух закона, но при этом оставаться связанными буквой закона.

Крис Стоукс , «Почему три закона робототехники не работают» в International Journal of Research in Engineering and Innovation (IJREI)

Может быть, нам лучше надеяться, что это никогда не будет проверено в реальной жизни? Во всяком случае, здесь, в Mind Matters News , сегодня научная фантастика, поэтому мы попросили некоторых из наших авторов отреагировать на законы и сомнения Стоукса по их поводу:

Джонатан Бартлетт: Законы робототехники используют обычный и целенаправленный язык. Это работает для обычных и целеустремленных людей. Но роботы не люди. Следовательно, эти правила должны быть адаптированы к правилам производителей роботов, а не к правилам самих роботов. Их можно перевести в правила для производителей роботов следующим образом:

Bartlett предлагает правила для производителей роботов вместо :

1) Роботы должны создаваться только с учетом безопасности человека. Разработчики должны осознавать, что люди могут совершать ошибки, и должны быть встроены средства защиты от предотвратимых ошибок.

Разработчики должны осознавать, что люди могут совершать ошибки, и должны быть встроены средства защиты от предотвратимых ошибок.

2A) Поведение робота должно быть предсказуемым, чтобы люди-операторы могли должным образом понять, как входные данные робота будут определять его действия. Цель должна заключаться в том, чтобы сделать поведение понятным/предсказуемым для человека, чтобы человек мог беспрепятственно с ним работать.

2B) Должно быть ясно, кто из пользователей управляет роботом, как для самого робота, так и для окружающих. То есть, если робот выполняет задачу, которая может привести к опасности, другим поблизости должно быть ясно, кто имеет возможность и ответственность отменить запрос.

2C) Робот должен быть сконструирован таким образом, чтобы управляющее лицо сохраняло управление, если привилегии не были явно переданы исходной стороной или не переняты кем-то с более высокими привилегиями (т. е. бригадиром, полицейским и т. д.)

2D) Исключением является то, что действия робота могут быть отменены любым лицом, находящимся ближе к ситуации, чем оператор

2E) Любая последовательность координации роботов не должна подвергаться опасности, если какие-либо действия робота в последовательности отменяются (т. е. отмена действий робота, создающих опасность для человека, не должна непреднамеренно создавать опасность для других частей процесса)

е. отмена действий робота, создающих опасность для человека, не должна непреднамеренно создавать опасность для других частей процесса)

3) Роботы должны иметь внутренние датчики, органы управления и средства отчетности, чтобы они могли сообщать людям о любой обнаруживаемой или предсказуемой неисправности до того, как она вызовет опасность.

Он добавляет: Законы роботов, как их представлял Азимов, предполагали, что вы можете программировать компьютер точно так же, как если бы вы разговаривали с человеком. Если вместо этого мы будем относиться к робототехнике как к инженерной дисциплине, мы сможем разработать правила разработки роботов, которые действительно предотвращают опасность для людей. Воображать будущее весело и даже необходимо. Однако попытка найти соответствующие правила для будущих роботов, которые, возможно, никогда не появятся, не должна мешать разработке хороших этических правил разработки роботов в ближайшем будущем.

Вбегает Брендан Диксон и говорит: Все еще хуже, чем он говорит! «Законы» неоднозначны даже для человека. Например, что значит не «навредить»? На самом деле довольно липкий, чтобы работать.

Например, что значит не «навредить»? На самом деле довольно липкий, чтобы работать.

Недостаток законов заключается в следующем: они предполагают, что мораль и моральные решения могут приниматься с помощью алгоритма, что дискретных ответов «да/нет» достаточно, чтобы «решить» моральные затруднения. Их недостаточно. (Или, чтобы быть достаточным, потребовалось бы намного, намного, намного больше «законов», чем те, которые указаны для охвата огромного множества всегда возникающих оговорок «что, если» и «но он».)

Закон Хаммурапи высечен в камне

Вот интересный факт: недавно я узнал, что Закон Хаммурапи (приблизительно 1750 г. до н.э., высеченный на стеле сейчас в Лувре) был наиболее часто копируемым древним сводом законов. И тем не менее, во всех судебных делах, которые мы обнаружили, он никогда не упоминается и не используется. Почему? Потому что древние кодексы законов стремились научить пользователей думать о принятии мудрых решений, а не кодировать конкретные правила о решениях, которые вы должны принимать. Это подчеркивает проблему робототехники: роботы потребуют, чтобы мы могли закодировать в правила решения, которые они должны принимать, но моральные решения требуют мудрости, разума, обученного тому, как думать, чтобы он мог правильно обрабатывать каждый случай.

Это подчеркивает проблему робототехники: роботы потребуют, чтобы мы могли закодировать в правила решения, которые они должны принимать, но моральные решения требуют мудрости, разума, обученного тому, как думать, чтобы он мог правильно обрабатывать каждый случай.

Эрик Холлоуэй предложил: Я нахожу иронией то, что, хотя для роботов якобы существуют объективные моральные законы, у самих людей нет объективных моральных законов

Интересно, является ли логическим следствием трех законов роботов то, что роботы должны учить людей объективным моральным законам, т.е. во избежание «бездействием допустить, чтобы человеку был причинен вред». Так, например, роботы остановят все войны, аборты и эвтаназию по всему миру и предпримут масштабную евангелизацию, чтобы люди не причиняли себе бесконечный вред, отправляясь в ад.

Брендан Диксон ответил, указав на лежащий в основе конфликт между 0-м законом и другими: Хорошая мысль, но она предполагает определение вреда с индивидуальной направленностью. Что, если вместо этого вред (а я с этим не согласен) измерять в утилитарных терминах на уровне населения? Совсем другая игра с мячом. Это проблема.

Что, если вместо этого вред (а я с этим не согласен) измерять в утилитарных терминах на уровне населения? Совсем другая игра с мячом. Это проблема.

Эрик Холлоуэй предположил, как робот может догадаться об этом: в этом случае лучший способ свести к минимуму вред населению — уничтожить всех. Конечно, краткосрочного вреда от уничтожения всех много, но в совокупности он гораздо меньше, чем накопление вреда на протяжении многих тысяч будущих поколений. Или, чуть менее экстремально, стерилизовать всех. Таким образом, вред существующим в настоящее время людям сводится к минимуму, и в будущем людям не будет причинен вред.

Хорошо! Возможно, это и хорошо, что общий искусственный интеллект того типа, для которого Азимов пытался создавать законы, в любом случае вызывает сомнения по целому ряду причин.

Вот точка зрения Computerphile: Законы никогда не работали даже в художественной литературе. Книги Азимова о роботах «все о том, как эти законы нарушаются с различными последствиями».

Один из самых плодовитых писателей-фантастов, Азимов считает себя человеком, который использовал термин робототехника в печати. Став взрослым, я до сих пор наслаждаюсь его книгами и решил по-новому взглянуть на тех, кто занимается моей профессиональной страстью: роботами. Конечно, больше всего роботы Азимова известны тем, что они неизменно следуют трем законам робототехники, изложенным в его 19-й книге.42 история, Обход:

Один из самых плодовитых писателей-фантастов, Азимов считает себя человеком, который использовал термин робототехника в печати. Став взрослым, я до сих пор наслаждаюсь его книгами и решил по-новому взглянуть на тех, кто занимается моей профессиональной страстью: роботами. Конечно, больше всего роботы Азимова известны тем, что они неизменно следуют трем законам робототехники, изложенным в его 19-й книге.42 история, Обход: В то время как его рассказы подчеркивали несовершенство Законов, они также подчеркивали, насколько необычным было то, что робот мог даже показаться неподчиняющимся Законам по какой-либо причине. Из всего этого складывается впечатление, что Три закона почти совершенны, и только в самых невероятных ситуациях робот может выйти из строя.

В то время как его рассказы подчеркивали несовершенство Законов, они также подчеркивали, насколько необычным было то, что робот мог даже показаться неподчиняющимся Законам по какой-либо причине. Из всего этого складывается впечатление, что Три закона почти совершенны, и только в самых невероятных ситуациях робот может выйти из строя. К их чести, почти все они ответили, и все с очень интересными ответами. Ниже приведено электронное письмо, которое я отправил, более или менее. Это было персонализировано, конечно, для тех, с кем я лично встречался, но отдельные аспекты были удалены как из моих, так и из их электронных писем. Вот мой первоначальный адрес электронной почты:

К их чести, почти все они ответили, и все с очень интересными ответами. Ниже приведено электронное письмо, которое я отправил, более или менее. Это было персонализировано, конечно, для тех, с кем я лично встречался, но отдельные аспекты были удалены как из моих, так и из их электронных писем. Вот мой первоначальный адрес электронной почты:

А вот смотреть надо. Обратите внимание, что даже , выглядящий как , является действием, и оно, в свою очередь, может иметь дополнительные последствия в бесконечной спирали самоуверенности/проверки. Вот почему оно непознаваемо в пределе.

А вот смотреть надо. Обратите внимание, что даже , выглядящий как , является действием, и оно, в свою очередь, может иметь дополнительные последствия в бесконечной спирали самоуверенности/проверки. Вот почему оно непознаваемо в пределе. Кроме того, третий закон предназначен для представления компонента в цепочке подчинения (например, военной цепочке подчинения). Рядовой должен пойти на смерть, если им командует офицер. Это предполагает, что офицер обладает превосходными знаниями обо всех аспектах ситуации. Даже эта цепочка подчинения допускает исключения для полевых командиров, которые могут иметь более подробные сведения о местности. Каждый делает все возможное, и если правила нарушены, военный трибунал решает, кто принял правильное решение. Все эти тонкости относятся к робототехнике.

Кроме того, третий закон предназначен для представления компонента в цепочке подчинения (например, военной цепочке подчинения). Рядовой должен пойти на смерть, если им командует офицер. Это предполагает, что офицер обладает превосходными знаниями обо всех аспектах ситуации. Даже эта цепочка подчинения допускает исключения для полевых командиров, которые могут иметь более подробные сведения о местности. Каждый делает все возможное, и если правила нарушены, военный трибунал решает, кто принял правильное решение. Все эти тонкости относятся к робототехнике. Беда в том, что у роботов нет четких символов и правил, подобных тем, которые должны считаться необходимыми в научно-фантастическом мире. Большинство роботов не имеют возможности смотреть на человека и видеть его как человека («человека»). И это самая простая концепция, необходимая для того, чтобы следовать правилам. А теперь представьте, что они также должны уметь распознавать и понимать «вред», «намерения», «других», «я», «самосохранение» и т. д., и т. д., и т. д. Дальше начинается самое сложное. Теперь они должны иметь возможность опровергнуть все эти концепции и решить для себя, будет ли действие нарушать правило или нет. Им нужно иметь очень хорошее представление о том, что произойдет, когда они совершат определенное действие.

Беда в том, что у роботов нет четких символов и правил, подобных тем, которые должны считаться необходимыми в научно-фантастическом мире. Большинство роботов не имеют возможности смотреть на человека и видеть его как человека («человека»). И это самая простая концепция, необходимая для того, чтобы следовать правилам. А теперь представьте, что они также должны уметь распознавать и понимать «вред», «намерения», «других», «я», «самосохранение» и т. д., и т. д., и т. д. Дальше начинается самое сложное. Теперь они должны иметь возможность опровергнуть все эти концепции и решить для себя, будет ли действие нарушать правило или нет. Им нужно иметь очень хорошее представление о том, что произойдет, когда они совершат определенное действие. . Они будут следовать устным правилам так же, как люди следуют устным правилам. С другой стороны, если вы попытаетесь внедрить правила в аппаратное обеспечение, вы не будете знать языка внутренней системы и не сможете запрограммировать их так, чтобы они делали то, что вам нужно (точно так же, как мы не можем сделать операцию на мозге, чтобы заставить людей не нарушать закон — сколько миллионов нейронов вам потребуется, чтобы приспособиться?)

. Они будут следовать устным правилам так же, как люди следуют устным правилам. С другой стороны, если вы попытаетесь внедрить правила в аппаратное обеспечение, вы не будете знать языка внутренней системы и не сможете запрограммировать их так, чтобы они делали то, что вам нужно (точно так же, как мы не можем сделать операцию на мозге, чтобы заставить людей не нарушать закон — сколько миллионов нейронов вам потребуется, чтобы приспособиться?) На практике программное обеспечение для управления роботами, связанное с вопросами безопасности, сложное, распределенное, и его не так просто разбить на иерархию правил.

На практике программное обеспечение для управления роботами, связанное с вопросами безопасности, сложное, распределенное, и его не так просто разбить на иерархию правил. Это, безусловно, интересная тема для обсуждения. Проблема с этими законами заключается в том, что они используют абстрактные и неоднозначные концепции, которые трудно реализовать в виде программного обеспечения. Что значит «прийти во вред»? Как мне закодировать это в цифровом компьютере? В конечном счете, компьютеры сегодня имеют дело только с логическими или числовыми задачами и результатами, поэтому, если эти абстрактные понятия не могут быть закодированы в соответствии с этими терминами, это будет по-прежнему сложно. У меня есть много других мыслей по этому поводу, но это лишь краткое изложение.

Это, безусловно, интересная тема для обсуждения. Проблема с этими законами заключается в том, что они используют абстрактные и неоднозначные концепции, которые трудно реализовать в виде программного обеспечения. Что значит «прийти во вред»? Как мне закодировать это в цифровом компьютере? В конечном счете, компьютеры сегодня имеют дело только с логическими или числовыми задачами и результатами, поэтому, если эти абстрактные понятия не могут быть закодированы в соответствии с этими терминами, это будет по-прежнему сложно. У меня есть много других мыслей по этому поводу, но это лишь краткое изложение. В своем электронном письме мне он написал:

В своем электронном письме мне он написал: У них будут гораздо лучшие цели для достижения.

У них будут гораздо лучшие цели для достижения. cs.bham.ac.uk/research/cogaff/crp/

cs.bham.ac.uk/research/cogaff/crp/ ).

).